7月4日舉辦的百度開發者大會上,李彥宏宣布百度L4級自動駕駛路測里程破兩百萬公里,百度的level4自動駕駛已經發展到了一個新的階段。

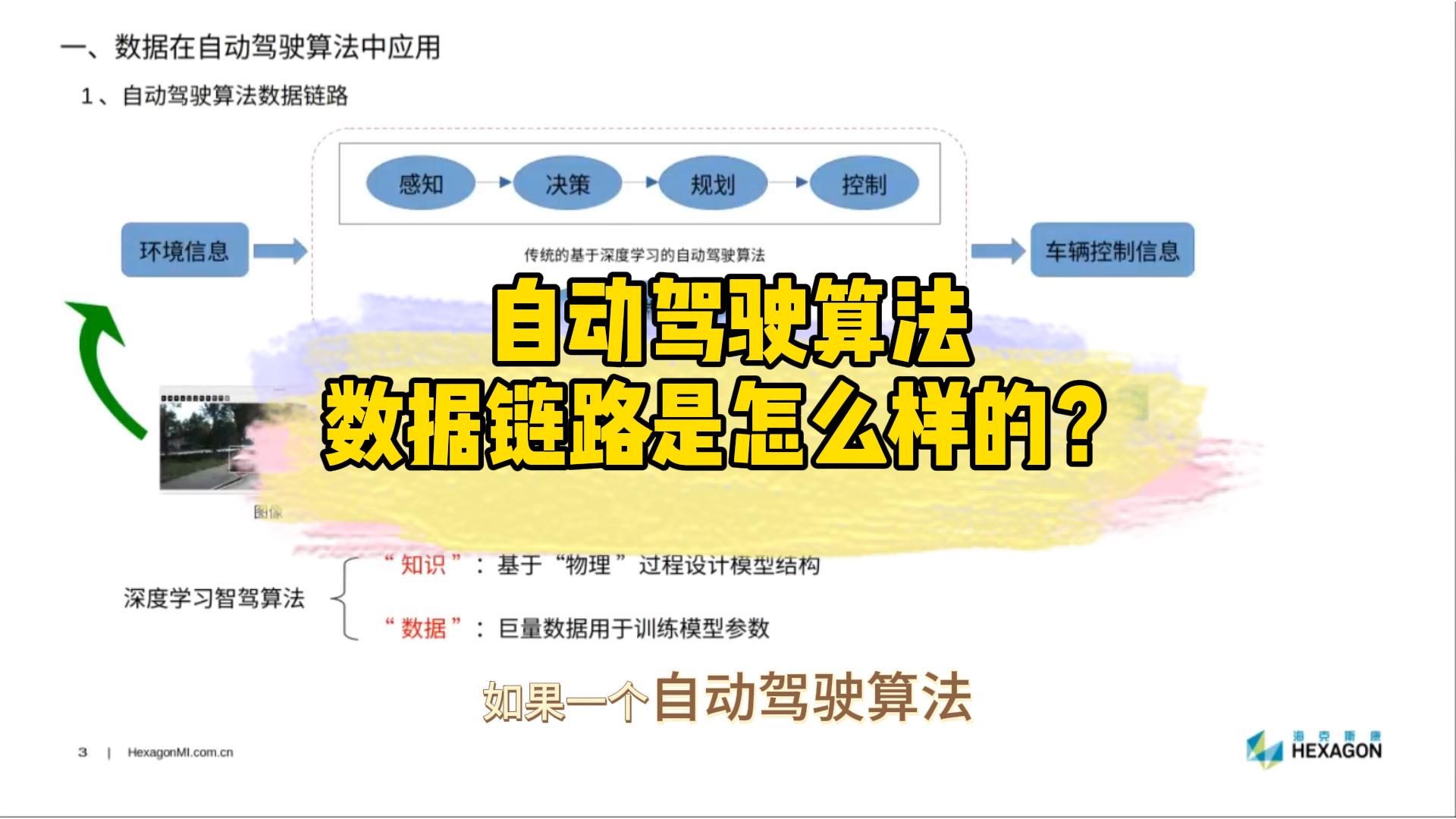

自動駕駛依賴高度精確的目標檢測能力,以應對路上可能出現的各種情況,而想訓練一個完善的目標檢測模型,則需要大量的車載傳感器提供的數據。所以說百度在自動駕駛方面取得的成就,基礎就是那兩百萬公里的路測數據。

許多想嘗試做目標識別的機構或者個人,都苦于無法獲取足夠的數據而無法進行相關研究。

最近,Lyft公司專注于自動駕駛的Lyft level5團隊公開了一組他們采集的數據集,并且預計在12月舉辦一次基于該數據集的比賽,數據集一共將近60G,注冊一個賬戶即可下載。

數據來之不易

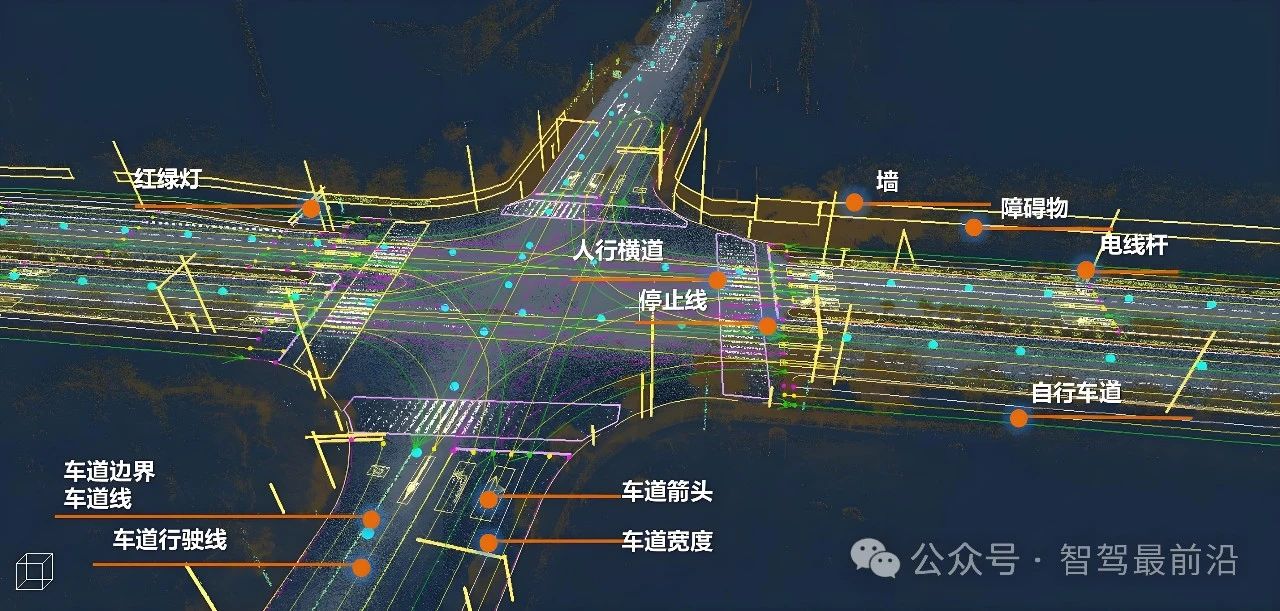

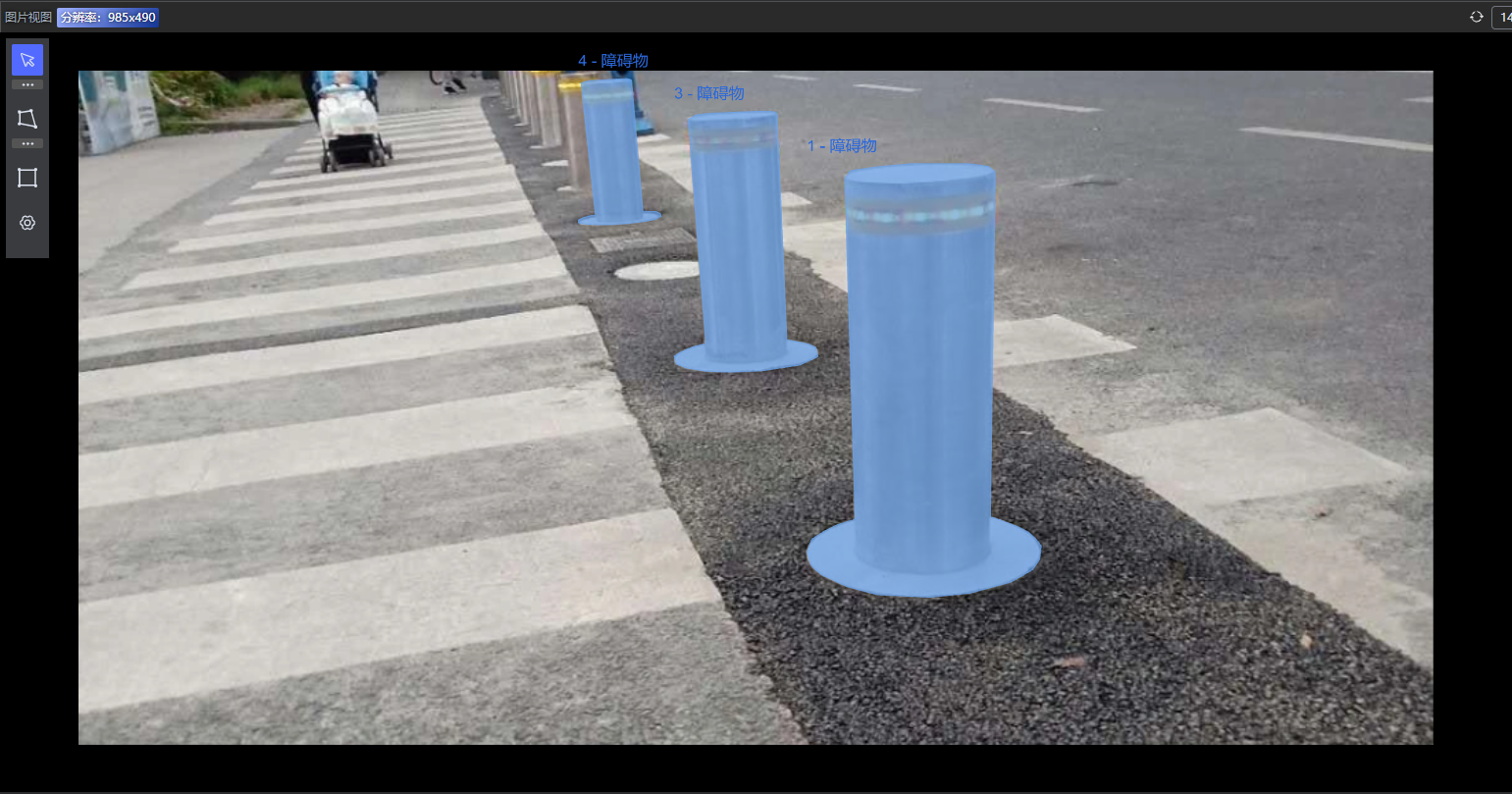

該數據集包括高質量的語義圖, 語義圖提供關于場景中車輛位置和移動方向的上下文推理,所有地圖元素都映射到基礎幾何圖,是數據集中所有場景的相同參照系。

提供的地圖有超過4000個車道段(2000個路段車道和約2000個車道),197個人行橫道,60個停車標志,54個停車區,8X減速帶,11X減速帶。

所有數據均采集于福特Fusion車隊, 每輛車都配有以下傳感器:

激光雷達:

一個安裝在車頂的40束激光雷達和兩個安裝在保險杠的40束激光雷達;

每個雷達的方位角分辨率為0.2度;

所有三個激光雷達共同產生約216,000個點,頻率為10赫茲;

所有雷達的發射方向在任何給定時間都是相同的。

攝像頭:

六個寬視角(WFOV)攝像機均勻覆蓋360度視角(FOV), 每臺相機的分辨率為1224x1024,FOV為70°x60°;

一個長焦距攝像頭略微向上安裝,主要用于檢測交通信號燈,相機的分辨率為2048x864,FOV為35°x15°;

每個攝像機與雷達同步,使得當攝像機捕獲圖像時,雷達光束位于攝像機視野的中心。

-

自動駕駛

+關注

關注

784文章

13906瀏覽量

166752 -

lyft

+關注

關注

0文章

36瀏覽量

7455

原文標題:Lyft公開了一個自動駕駛數據集,還要舉辦比賽!

文章出處:【微信號:BigDataDigest,微信公眾號:大數據文摘】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

Lyft攜手Mobileye推動自動駕駛出行服務規模化發展

Lyft攜手多家企業部署自動駕駛出租車

Apollo自動駕駛開放平臺10.0版即將全球發布

60G電梯人在檢測傳感器 雷達藍牙二合一

FPGA在自動駕駛領域有哪些優勢?

FPGA在自動駕駛領域有哪些應用?

標貝數據采集標注在自動駕駛場景中落地應用實例

特斯拉擬在華建數據中心,加速自動駕駛發展

未來已來,多傳感器融合感知是自動駕駛破局的關鍵

自動駕駛數據集的生成模型之WoVoGen框架原理

Lyft自動駕駛數據集公開!60G數據開放下載

Lyft自動駕駛數據集公開!60G數據開放下載

評論