(文章來源:雷鋒網)

美國西部時間 11 月 12 日,2019 英特爾人工智能峰會期間(Intel AI Summit 2019)在舊金山舉行,英特爾展示了一系列 AI 相關新產品和相關進展,其中,包括面向訓練 (NNP-T1000) 和面向推理 (NNP-I1000) 的英特爾 Nervana 神經網絡處理器 (NNP) 都重磅亮相,而英特爾也公布了新一代 Movidius Myriad 視覺處理單元。

隨著人工智能的進一步發展,計算硬件和內存都將到達臨界點。如果要在該領域繼續取得巨大進展,專用型硬件必不可少,如英特爾 Nervana NNP 和 Movidius Myriad VPU。采用更先進的系統級人工智能,我們將從“數據到信息的轉換”階段發展到 “信息到知識的轉換階段”。

對于英特爾來說,Nervana NNP 是它在神經網絡處理器方面的重要產品,可以說是第一款 AI 商用芯片,而且這款產品從發布、測試、量產到應用,實際上是經歷了一個漫長的產品周期。

新一代 Nervana NNP 首先亮相是在 2018 年 5 月。當時,在英特爾人工智能開發者大會 (AIDevCon 2018) 上,Naveen Rao 發布了新一代專為機器學習設計的神經網絡處理器(NNP)芯片,并表示這是英特爾第一款商業 NNP 芯片,將不止是提供給小部分合作伙伴,將在 2019 年發貨。

而 Nervana NNP-I,代號為 Spring Hill,是一款專門用于大型數據中心的推理芯片。這款芯片是基于 10nm 技術和 Ice Lake 內核打造的,打造地點是以色列的 Haifa ,Intel 號稱它能夠利用最小的能量來處理高負載的工作,它在 ResNet50 的效率可達 4.8TOPs/W,功率范圍在 10W 到 50W 之間。

按照官方說法,英特爾 Nervana 神經網絡訓練處理器(Intel Nervana NNP-T)在計算、通信和內存之間取得了平衡,不管是對于小規模群集,還是最大規模的 pod 超級計算機,都可進行近乎線性且極具能效的擴展。英特爾 Nervana 神經網絡推理處理器(Intel Nervana NNP-I)具備高能效和低成本,且其外形規格靈活,非常適合在實際規模下運行高強度的多模式推理。這兩款產品面向百度、 Facebook 等前沿人工智能客戶,并針對他們的人工智能處理需求進行了定制開發。

另外,百度 AI 研究員 Kenneth Church 在現場表示,在今年 7 月,百度與英特爾合作宣布了雙方在 Nervana NNP-T 的合作,雙方通過硬件和軟件的合作來實現用最大的效率來訓練日益增長的復雜模型。Kenneth Church 還宣布,在百度 X-Man 4.0 的加持下,英特爾的 NNP-T 已經推向市場。

下一代英特爾 Movidius VPU 的代號是 Keem Bay,它是專門為邊緣 AI 打造的一款產品,專注于深度學習推理、計算機視覺和媒體處理等方面,采用全新的高效能架構,并且通過英特爾的 OpenVINO 來加速。按照官方數據,它在速度上是英偉達 TX2 的 4 倍,是華為海思 Ascend 310 的 1.25 倍。另外在功率和尺寸上,它也遠遠超過對手。

Intel 方面表示,新一代 Movidius 計劃于 2020 年上半年上市,它憑借獨一無二的高效架構優勢,能夠提供業界領先的性能:與上一代 VPU 相比,推理性能提升 10 倍以上,能效則可達到競品的 6 倍。

除了新一代 Movidius,英特爾還發布了全新的英特爾 DevCloud for the Edge,該產品旨在與英特爾 Distribution of OpenVINO 工具包共同解決開發人員的主要痛點,即在購買硬件前,能夠在各類英特爾處理器上嘗試、部署原型和測試 AI 解決方案。

英特爾方面表示,推進深度學習推理和應用需要極其復雜的數據、模型和技術,因此在架構選擇上需要有不同的考量。事實上,業界大部分組織都基于英特爾至強可擴展處理器部署了人工智能。英特爾將繼續通過英特爾矢量神經網絡指令 (VNNI) 和英特爾深度學習加速技術(DL Boost)等功能來改進該平臺,從而在數據中心和邊緣部署中提升人工智能推理的性能。英特爾強調稱,在未來很多年中,英特爾至強可擴展處理器都將繼續成為強有力的人工智能計算支柱。

(責任編輯:fqj)

-

芯片

+關注

關注

456文章

50927瀏覽量

424594 -

英特爾

+關注

關注

61文章

9982瀏覽量

171937

發布評論請先 登錄

相關推薦

今日看點丨龍芯中科:下一代桌面芯片3B6600預計明年上半年交付流片;消息稱英偉達 Thor 芯片量產大幅推遲

英偉達新一代AI芯片過熱問題引關注

全球首款!RoboSense全自研專用SoC芯片M-Core獲AEC-Q100認證

全球首款!RoboSense全自研專用SoC芯片M-Core獲AEC-Q100認證

英特爾向聯想交付首款18A工藝CPU樣品

龍芯中科首款GPGPU芯片9A1000計劃明年流片

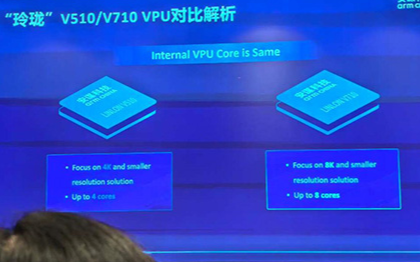

安謀科技發布“玲瓏”DPU和新一代VPU

本土自研再上新!安謀科技發布首款“玲瓏”DPU和新一代VPU

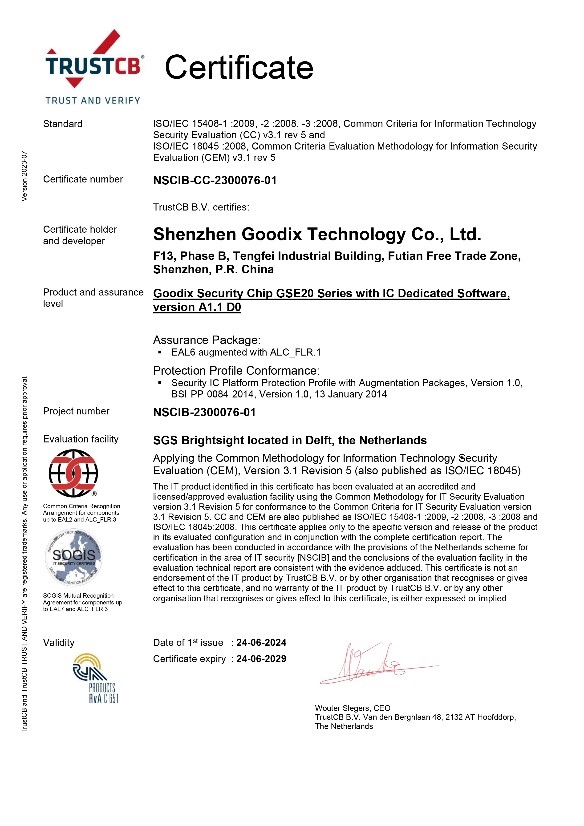

匯頂科技新一代安全芯片榮獲CC EAL6+安全認證

再獲突破!匯頂科技新一代安全芯片榮獲CC EAL6+安全認證

韓國兩大芯片公司尋求合并,以開發新一代AI芯片

英偉達宣布推出新一代GPU Blackwell,SK海力士已量產HBM3E

Intel宣布首款智能芯片已交付,新一代Movidius VPU明年見

Intel宣布首款智能芯片已交付,新一代Movidius VPU明年見

評論