5G時代對于視頻行業(yè)的發(fā)展和業(yè)務形態(tài)將是一個重要的助推,但5G時代帶來的改變不只是帶寬提升和延遲降低這兩個最直接的因素。本次LiveVideoStackCon 2020線上峰會我們邀請到了阿里巴巴高級算法專家盛驍杰,他將介紹在5G時代,視頻信息承載將逐步從目前的平面視頻形態(tài)過渡到信息表達更為豐富的三維視頻,而這種過渡中包含的可能性一方面需要我們充分利用5G技術本身的云、邊、端架構帶來的技術紅利,另一方面,也需要我們對于快速發(fā)展的三維視覺,AI,AR等技術進行綜合性的創(chuàng)新運用,使得視頻體驗通過可互動的三維信息表達在5G時代不斷給用戶創(chuàng)造出更多的價值。

大家好,本次我分享的主題是5G時代的互動視頻——探索從平面到三維視頻信息表達的新可能。

本次演講的內容將分為四個部分,分別為:什么是互動6DoF視頻、視頻體驗的發(fā)展和5G時代的新機遇、6DoF視頻的標準(MPEG/AVS)和對互動6DoF視頻的未來展望。

1

什么是互動6DoF視頻

首先通過三個演示視頻來認識互動6DoF視頻。第一個視頻是CBA的運動場景,它是通過相機陣列和三維重建所得到的一個互動6DoF視頻,并且通過實際的網絡傳輸以及用戶終端的實時互動所展現出來的一個效果。 第二個視頻也是相同的場景,但對原先的互動方式進行了一些調整和改變,在這樣的視頻中,用戶觸摸屏幕會使整體場景靜止,用戶可以有一個靜態(tài)場景下360°的對場景每一個瞬間進行精細化觀看的互動體驗,這樣的體驗特別適合于體育等競技性和專業(yè)性較強的場景。 首先,通過對這個視頻的體驗,可以感受到之前普通的平面體育點播和直播視頻當中所沒有的新體驗。 其次,在一個三維的空間中對傳統(tǒng)體育賽事的觀看方式進行革新,使得用戶能夠自由地切換自己的視點,觀看其感興趣的區(qū)域。通過這種方式,用戶會感覺到視頻的觀看過程通過可互動的方式,已經和某些游戲的體驗有相似性。從來沒有體驗過這種視頻的用戶,在第一次體驗之后會感覺這種體驗很像游戲。之所以有這種感受,是因為它其中包含了3D和互動的體驗,而普通的游戲給予用戶的正是這樣一種體驗。這也是互動6DoF視頻和平面視頻最大的區(qū)別, 即互動6DoF視頻有著和平面視頻不同的三大特點:互動性、三維立體感和場景沉浸感。 互動6DoF視頻除了應用在體育的場景當中,在綜藝場景中也有著廣泛的應用前景。以上展示的是一個綜藝場景的效果,視頻中的整個綜藝場景,通過三維的建模并且通過傳輸和實時互動,使用戶產生很強的現場沉浸感和立體感體驗效果。此外,在綜藝場景中它可以給予用戶一種全方位的信息接受方式。比如這個視頻演示是優(yōu)酷《這就是街舞2》決賽當中的一段視頻,我們的交互范圍是可以覆蓋整體場景正面的180°,基本上可以囊括正面的所有舞蹈視角,通過這種方式的交互,用戶可以很方便的把握住舞臺的整體,體驗到每個舞者在跳舞過程中全方位的信息。今年在優(yōu)酷的《這就是街舞3》節(jié)目中,我們會在優(yōu)酷的APP端正式上線這樣的體驗。 這種體驗在街舞當中或者其他技巧類、動作類的綜藝當中都有很好的應用前景,在整個互動效果當中,它的交互是非常流暢的,用戶手指的滑動、畫面的重建和渲染都可以達到實時的效果。而且現在手機終端的運算能力越來越強,已經可以使這樣的形態(tài)讓用戶在大部分的手機上體驗到。 以上的三個例子是通過具體的呈現方式使大家對互動6DoF視頻有一個感性的認識。下面我們再來詳細介紹下什么是互動6DoF視頻。

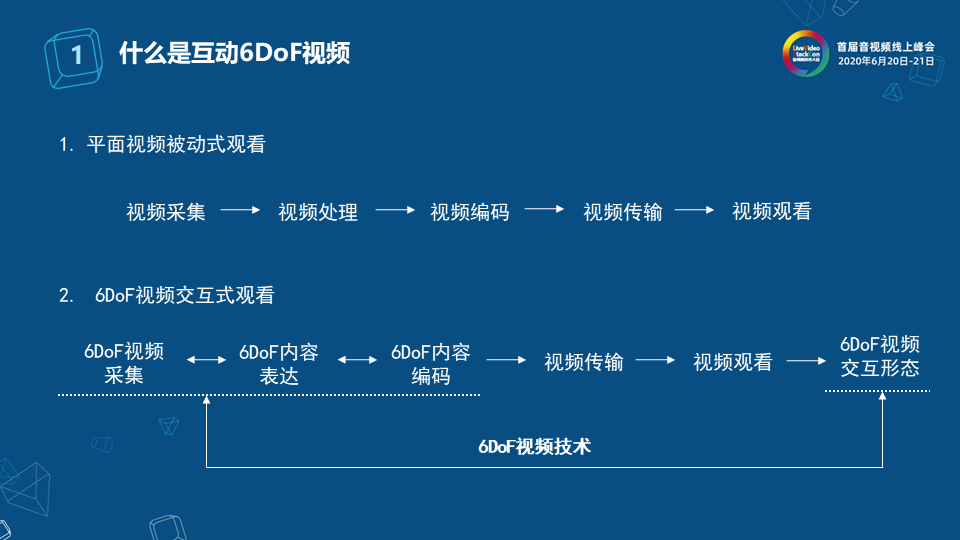

普通的平面視頻從視頻的采集、處理、編碼、傳輸、觀看的整個過程中都是單向的傳輸鏈路,所以平面視頻是一種被動式的觀看,這是因為用戶最終接收到的信息是完全被動式的接收導演想傳遞給用戶的信息,用戶不能主動選擇想看的部分,這是一種被動式的觀影體驗。并且,平面視頻每一級都是單向鏈路,就是采集完的信號會給下一級進行視頻處理,經過編碼模塊后進行視頻傳輸到用戶端播放,每一級都是一個向后單向傳遞的處理鏈路。 互動6DoF視頻在平面視頻的基礎上引入了一種交互式的觀看方式,正如前面三個視頻的例子就具有很強的交互性。它的交互性來源不只是在終端得到的交互,在視頻的采集、內容表達和編碼三個方面都和傳統(tǒng)的平面視頻有很大的區(qū)別,在這幾個模塊中都需要對用戶最終的交互形態(tài)有一個綜合性的考慮和設計。也就是說我們需要事先考慮給用戶怎么樣的交互形態(tài)和交互范圍,然后倒推回去設計視頻的采集方案、視頻的內容表達方案和編碼方案。所以它是一種非單向式的視頻處理鏈路,在6DoF視頻采集的時候我們就要在方案當中充分考慮到用戶的交互行為。 這是我們的技術人員第一次通過這種6DoF交互式的觀看獲得一種手段,即他能夠通過技術去影響和改變上游視頻的傳統(tǒng)采集和表達方式。而在普通的平面視頻的觀看當中,技術人員無法影響上游的表達,只是被動的接收上游導播給到的信號,并把它呈現出來。但是互動6DoF視頻交互式觀看給了技術人員一種有力的工具,就是可以通過提供用戶不同的交互形態(tài)去影響上游的視頻采集、表達、編碼的方案。 1.1采集

這部分我們來介紹一下互動6DoF視頻在采集、表達和編碼方面與平面視頻的一些不同點。 首先在采集方面,上圖中四個例子是業(yè)界不同的公司對6DoF視頻的采集方案在不同場景中的應用,從中可以看出對于不同的場景,6DoF技術可以去設計不同的采集方案,提供給用戶不同的體驗。從這四張圖中也可以看出,雖然它們適用的范圍和場景都不一樣,但是它們都是通過相機陣列進行采集,而不是局限于單個相機進行采集,這也是三維視頻的一個特點。第一張圖中是在體育館中有一個相機陣列,第二張圖是在攝影棚中部署了更多的相機集群,第三張圖是圍繞體育場的一圈360度進行拍攝,第四張圖是專業(yè)的物體建模采集工作室。這樣做的特點就是通過多相機進行采集以后,能夠對場景進行三維重建和表達,再通過壓縮,最終傳遞給用戶一種6DoF互動的視頻體驗。

在之前演示的CBA場景當中,我們的采集方案就是相機陣列的采集,以上的兩個圖片是在CBA廣東隊的主場拍到的效果,整個采集方式是通過相機陣列進行的采集,然后進行空間的三維重建并進行視頻的傳輸,最后給用戶一個互動的體驗。 我們可以看到,6DoF視頻的采集具有幾個特點:一是需要多相機的采集陣列;二是根據不同場景的應用有一定的靈活性,針對不同的場景我們需要有不同的采集方案和表達方案,在用戶端也就會有不同的交互體驗。 1.2 表達

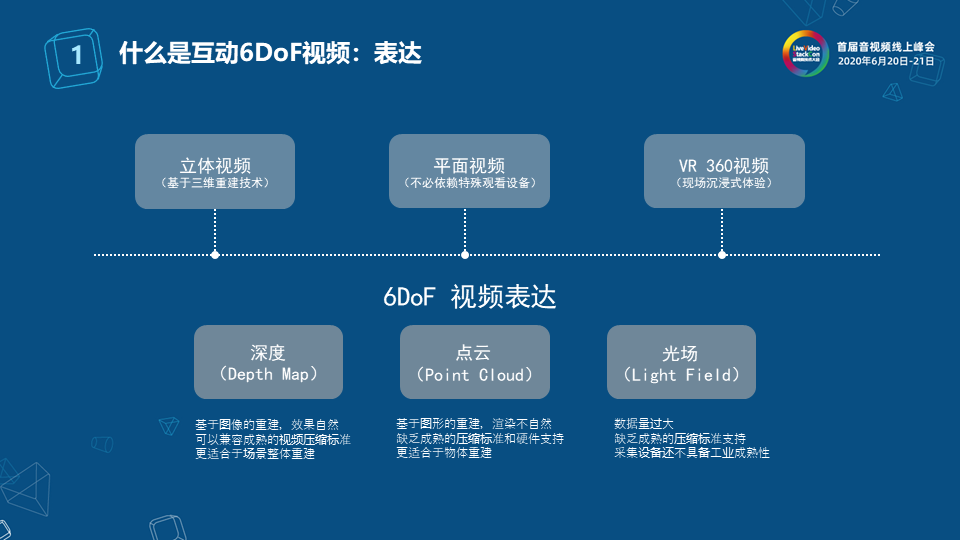

第二個重要部分就是6DoF視頻的表達。6DoF視頻和平面視頻是完全不一樣的,現在常見的三種視頻格式分別是:立體視頻、平面視頻、VR 360視頻。立體視頻是基于雙目相機拍攝以供用戶立體觀看的表達。平面視頻就是一個2D視頻,它是一種不依賴于任何特殊觀看設備的表達。VR 360視頻給用戶提供的是一種現場沉浸式的體驗,但它往往依賴于特殊的設備,所以這三種已知的視頻表達方式,它們有各自的優(yōu)缺點。 6DoF視頻表達是融合了以上三個視頻表達方式的優(yōu)點而得到的一種新的視頻表達方式,它的“新”主要表現在以下幾點: 首先,6DoF視頻和平面視頻一樣,不依賴于特殊的觀看設備。從之前的例子看出,在手機端上用戶就可以做便捷的交互。同時,它也具有VR 360視頻所提供的現場沉浸感體驗。其次,它還可以基于三維重建技術給用戶提供立體感的體驗。所以6DoF視頻是集中了這三個視頻表達方式的特點最終形成它自己的特殊表達,它所展現的形式和游戲體驗很像,這是因為游戲體驗也在平面顯示器上,能夠給人帶來沉浸感、交互性和立體感。 從技術層面來看,6DoF視頻有如下幾種不同的表達方式: 第一種表達方式是基于深度的表達,就是對每一個拍攝的像素進行深度的重建,我們有它的深度圖,通過紋理圖和深度圖兩兩成對的表達方式,再加上Multiview的視點,形成一種基于深度的表達。這種表達方式的優(yōu)點是完全基于圖像重建的表達方式,無論是紋理圖和深度圖都可以編碼成圖像,具有成熟的視頻壓縮標準來配合,在工業(yè)化和產品化下的支撐具有明顯優(yōu)勢,而且在基于圖像重建的效果自然性上更能讓用戶接受。 第二種表達方式是基于點云的表達,其實它是基于圖形的重建,Point Cloud會把空間所有像素點的三維位置表達出來,并且通過紋理的貼圖形成一個真實的三維模型。但經過點云的渲染也有它特別的地方,因為是基于Graphic,所以它的渲染不會非常自然。其次,雖然MPEG和AVS也在探索一些基于點云的壓縮方案,但點云目前還沒有一個成熟的壓縮標準去支持,包括解碼也沒有成熟的終端硬件支持。所以總結來說,目前點云表達方式的優(yōu)點在于,由于它是一種空間完全的三維重建,所以具有最大的交互自由度,可以把空間中一個全視角的三維模型重建出來,但缺點是它在壓縮傳輸和渲染自然性上不如深度重建。 最后一種表達方式是光場,也是數據量最大的表達方式。它是通過密集的相機采集陣列或者光場相機所采集到的空間非常密集的視點表達,可以提供完全的6DoF體驗。因為光場是一種非常稠密的視點表達,所以它的數據量過大,目前還缺乏成熟的壓縮標準支持,還不具有工業(yè)成熟性。 1.3 編碼

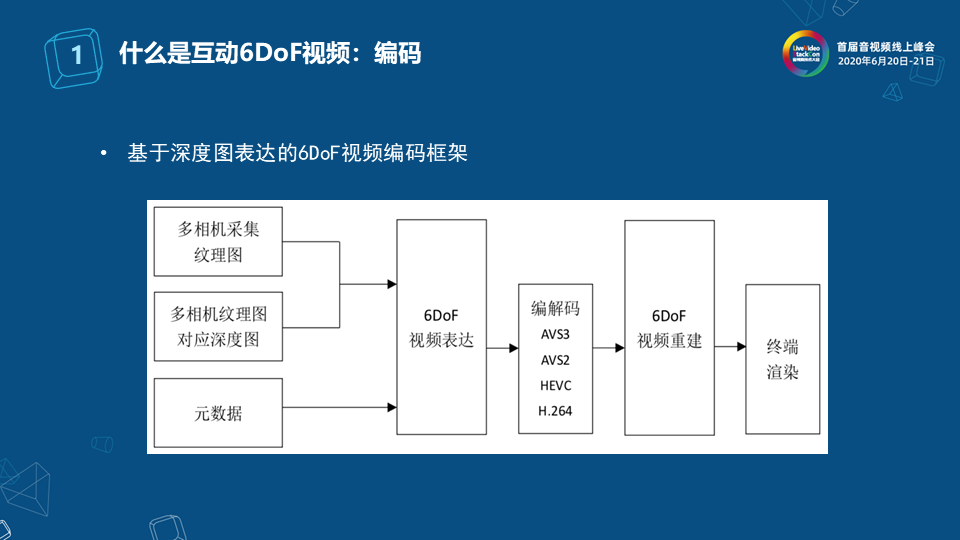

圖中展示的內容是基于深度圖表達的6DoF視頻編碼框架。首先是基于多相機采集的紋理圖,同時配備了和多相機采集紋理圖所對應的深度圖,還有基于多相機采集的紋理圖和深度圖的元數據。元數據中包含了一些多相機的攝像機參數信息以及相機紋理圖和深度圖的拼接和表達的配置信息。有了多相機采集的紋理圖、深度圖和元數據以后,我們就得到了一個基于深度的完整6DoF視頻表達。 在此基礎上就可以通過視頻的編碼方式(比如視頻的編解碼標準:AVS3、H.264、HEVC),對于前面所述的6DoF視頻表達進行編碼之后傳到終端進行解碼,然后基于多相機紋理圖、深度圖和元數據進行6DoF視頻重建,也就是在終端對用戶的虛擬視點進行重建,最后把重建完的圖像進行終端渲染輸出。上述就是整個6DoF視頻編碼框架和解碼后呈現給用戶的方案。

2

視頻體驗的發(fā)展和5G的新機遇

2.1 平面視頻

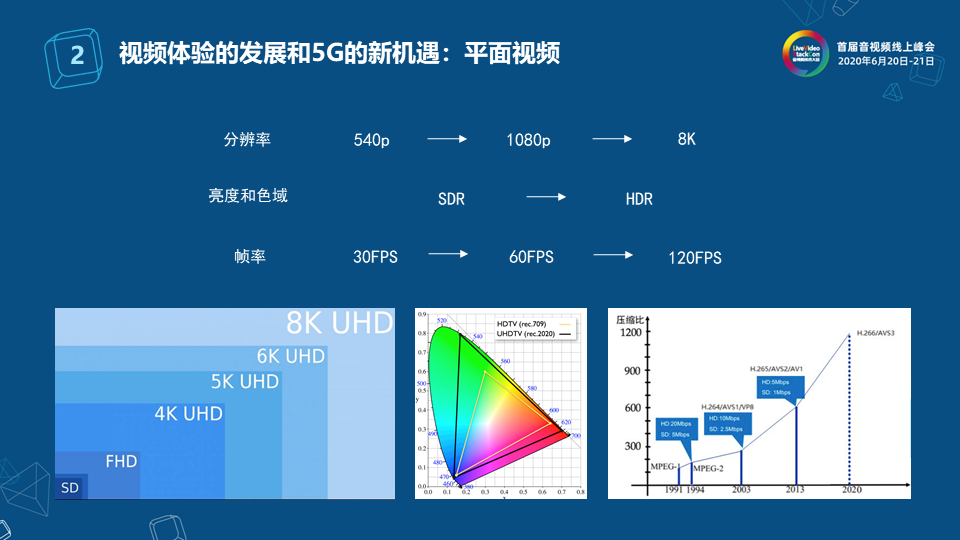

這部分回顧了視頻體驗的發(fā)展過程以及解釋一下為什么說6DoF視頻是5G時代新機遇的原因。大家對于視頻體驗的發(fā)展,最耳熟能詳的就是平面視頻,視頻介質中數量最多的也是平面視頻,平面視頻的技術發(fā)展目前還在一直向前推進。總體來看,平面視頻的視頻體驗的發(fā)展主要分為三個方面: 第一方面是平面視頻分辨率的發(fā)展。平面視頻從原先的540p逐步發(fā)展到1080p甚至8k,顯示屏幕也越來越大。 第二方面是亮度和色域的發(fā)展。由中間這張圖可知,原先的色彩表達空間比較小,因為人眼的整個色彩感受空間是非常廣泛的,但對于SDR是怕來說,它只能表達其中的一小塊,但HDR可以表達更大的色彩空間,所以可以讓用戶感受到除了分辨率的提升以外,人眼所感受到的色彩豐富度也越來越多。 第三方面是幀率的變化。原先大部分的視頻都是25FPS或者30FPS,現在由于整體視頻顯示設備刷新率的增強,比如現在很多手機都已經支持120FPS的刷新率,那么視頻的幀率也需要提高,才會給用戶絲滑流暢的感受。當前幀率的發(fā)展已經逐步從30FPS過渡到60FPS甚至到120FPS。 配合分辨率、亮度和色域、幀率這三個方面平面視頻的技術發(fā)展,平面視頻的壓縮方法也在不斷地迭代。右圖當中可以看到,平面視頻的壓縮標準基本上是以十年為一代往前推進。從2003年的H.264是為1080p視頻做準備的壓縮標準,到2013年的H.265是為4K視頻做準備的壓縮標準,再到2020年的H.266也就是VVC是為8K視頻做準備的。 國內的視頻編解碼標準H.264、H.265和H.266相對的是AVS+、AVS2和AVS3,它們分別是為1080P、4K和8K分辨率準備的視頻編解碼技術。 2.2 立體視頻

除了平面視頻以外,另外一種視頻的表達方式是立體視頻。立體視頻是通過雙目相機進行拍攝,使用戶戴上眼鏡后對視頻產生有深度的立體感體驗。 早在2009年,電影“阿凡達”就引入了全新的立體視頻觀影體驗,把這種視頻的方式帶到影院當中。 立體視頻技術推動了視頻采集、視頻制作、3D視頻壓縮標準、視頻觀看設備的全面革新,比如在視頻采集方面使用的不再是普通的相機而是雙目立體相機。 在2010年電視機廠商提出了一種新的視頻觀影體驗——FTV(Freeview TV)也叫自由視點的電視。它是在立體視頻的基礎上進一步的發(fā)展,用戶可以在屏幕前面,通過一定范圍的移動看到視頻當中的立體視頻。它不但是3D的,而且還能進行一定自由度的移動觀看。根據用戶的左右移動,電視機里面的內容也會發(fā)生變化,它是根據人在電視機前的移動,通過不同的光柵信號折射使人眼看到不同的視角。 但FTV出來之后并沒有非常火,首先是基于光柵的電視成本非常的高,其次,它的體驗方式并不是非常自然。同時,它提供的自由視角也比較小,因為FTV內容源并不是通過相機陣列進行采集的,而是基于普通的雙目相機采集,并對雙目相機的左右兩個視點進行一定的外插值,相當于做一些假的虛擬視點。但這個范圍不會特別大,因為它原先采集的素材就只有左右兩個視點,所以沒有辦法得到更大范圍的自由度。基于這幾點原因,FTV雖然提出一個非常好的概念,能夠讓用戶有自由視點的電視體驗,但是最終并未在市場上火起來,而且在后期逐步的銷聲匿跡了。 2.3 VR 360視頻

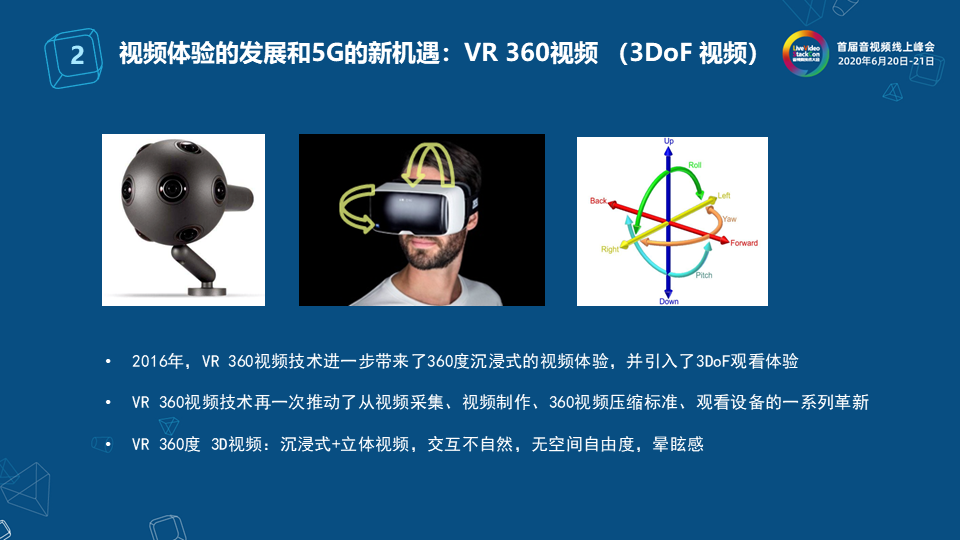

VR 360視頻是在2016年火起來的,它進一步帶來了360度沉浸式的視頻體驗,并引入了3DoF觀看體驗。VR 360視頻的采集端通過多個魚眼相機的采集以及拼接得到一個360度的視頻,如果用戶戴上頭盔可以通過轉動到任意角度進行觀看。我們來解釋一下為什么說VR 360視頻是3DoF的?右圖顯示了人在真實空間中的六個自由度的表現,六個自由度是指在空間上有X、Y、Z這三個移動的自由度,以及在這三個移動自由度基礎上的三個旋轉的自由度,加起來一共是六個自由度,這是人在真實空間中所具有的自由度空間。3DoF視頻只有三個旋轉的自由度,沒有三個移動的自由度。當戴上眼罩觀看VR 360視頻時,只能進行旋轉觀看但不能移動,因為前后走動并不影響看到的內容,所以說VR 360視頻是3DoF的視頻。 2.4 6DoF視頻

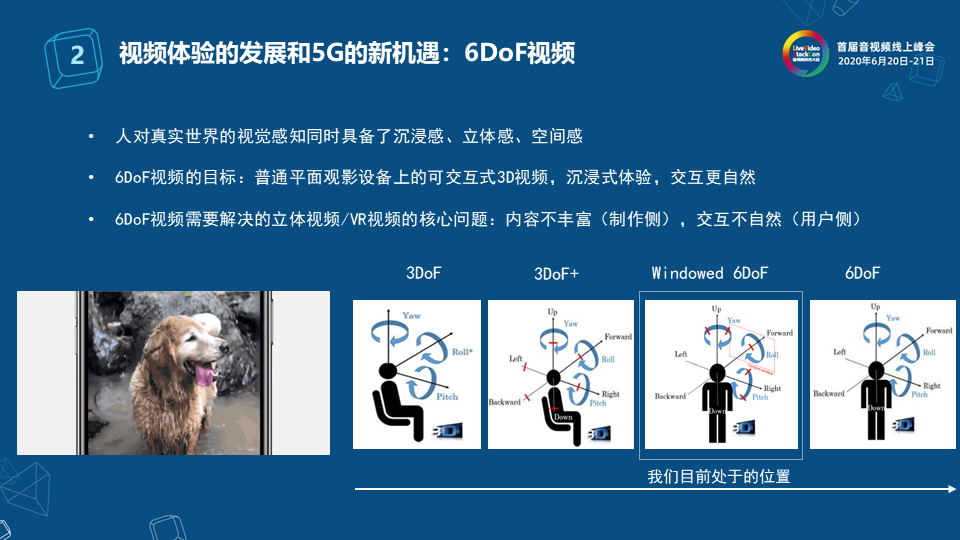

人對真實世界的視覺感知同時具備了沉浸感、立體感和空間感,這三者其實是統(tǒng)一的。 左下角的視頻是Facebook展示的一個立體視頻,這是通過一種基于深度的渲染技術得到的視頻,雖然用戶不需要帶任何的3D眼鏡就可以進行觀看,但用戶同樣可以感知到非常強烈的3D感和沉浸感。這是因為人對于空間的沉浸感、立體感和空間感的感知是一起的,所以對于視頻中的內容稍微發(fā)生變化,就感覺是3D的,而且沉浸感也會加強。 基于這種原理,6DoF視頻也有類似的特點。6DoF視頻就是普通平面觀影設備上的一個交互式立體視頻,可以帶給用戶沉浸式的體驗,而且交互更自然。6DoF視頻就是在左下角視頻的基礎上發(fā)展了一大步,能夠在一個非常大的范圍之內讓用戶體驗交互、沉浸和3D的感覺。 6DoF視頻解決了前面提到的立體視頻、VR 360視頻遇到的兩個核心問題:一是它的內容。立體視頻、VR 360視頻雖然是兩種新的內容表達方式,但在它的制作側、內容的豐富程度是不能和平面視頻相比的,立體視頻、VR 360視頻的數量是非常少的。 二是它的交互不自然。所謂交互不自然是指在用戶側,立體視頻需要用戶戴眼鏡,VR視頻需要用戶戴頭盔,這和交互的自然性是相違背的。由于這兩個原因,立體視頻和VR 360視頻始終沒有火起來。6DoF視頻在這兩點上具有天然的優(yōu)勢,它在內容豐富性上,無論是體育還是綜藝都有很強的需求。其次,在交互自然性上,用戶不需要任何的特殊設備,在手機屏幕上就能進行交互,這極大的改善了立體視頻和VR 360視頻遇到的兩個核心難點。 從右邊一組圖中可以看出關于6DoF視頻在 MPEG所定義的發(fā)展趨勢。3DoF是模擬一個人坐在椅子上,只能有旋轉的自由度,不能有空間移動的自由度。3DoF+是在三個旋轉的自由度的基礎上,向用戶提供了前傾、左傾、右傾、后傾等受約束的空間自由度。發(fā)展到我們目前處于的位置是Windowed 6DoF,它給了用戶一定的旋轉自由度,模擬用戶在一個窗前進行觀看,往前往后自由度是受限的,而且旋轉自由度在某種程度上也是受限的,給用戶的感覺是在一個窗前面自由移動看窗外變化的景色。最后是完全的6DoF,用戶在任意的六個自由度上都不會受到約束,可以任意進行前后移動和旋轉,這是視頻體驗的終極發(fā)展方向。

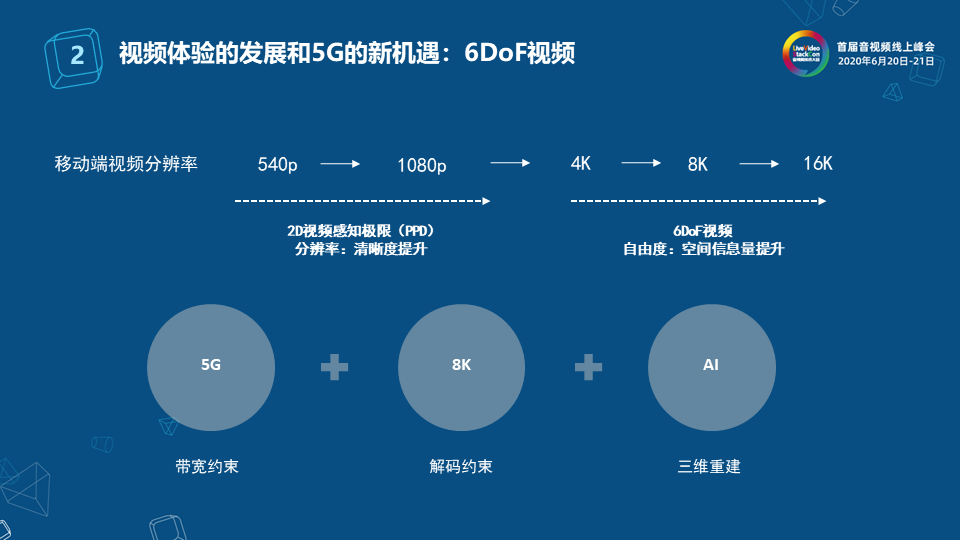

現在的6DoF視頻可以在移動端打破移動分辨率顯示的局限,原先移動端的分辨率達到1080p以上時,在移動端人眼視場角的像素數量已經接近上限,分辨率再增加人眼已經感受不到清晰度的增強了。但如果分辨率可以進一步上升,比如5G可以傳4K、8K甚至16K的視頻,那么在這個基礎上,6DoF視頻提供了一種新的可能性,就是把空間信息量的提升轉化為交互性和自由度的提升,它為移動端的視頻體驗裝上一個新的引擎,能夠在5G時代沿著全新的引擎進一步提升用戶的體驗。 在5G時代,帶寬、解碼能力和三維重建技術這三個條件都會取得長足的發(fā)展。比如5G時代的傳輸帶寬可以非常輕易的達到下行100M左右,這在4G時代是無法想象的。另外5G手機越來越多的支持8K的解碼,8K解碼讓我們有了傳輸6DoF視頻的基礎。最后基于AI技術的三維重建也使得基于6DoF視頻的三維重建的質量和速度得到大幅度的提升,所以基于5G的技術,6DoF視頻可以有非常好的基礎設施,在此基礎上能夠為用戶提供更好的觀看體驗。

3

6DoF視頻的標準

3.1 MPEG

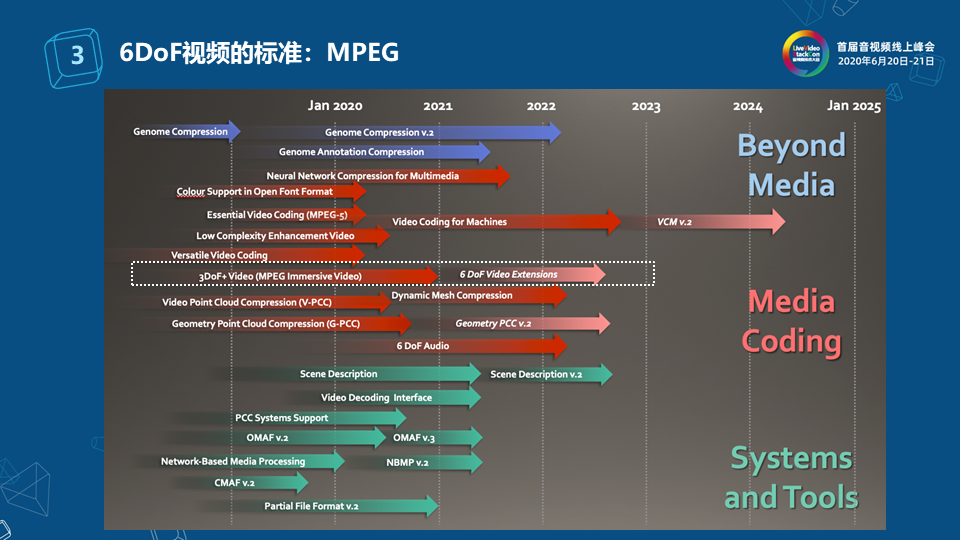

這部分我們來介紹一下MPEG標準組是怎么對6DoF視頻的標準來進行定義的。 這是一張最新的2020年MPEG路線圖,根據前文所提到的3DoF、3DoF+以及6DoF的發(fā)展,目前MPEG已經完成了普通VR 360視頻標準的建設,接下來它會沿著3DoF+發(fā)展,3DoF+還在建設當中并且預計會在2021完成標準建設,之后會進入6DoF的發(fā)展階段, 6DoF的發(fā)展會分為兩個階段:Windowed 6DoF階段和完全6DoF階段,整個6DoF標準的發(fā)展會一直延續(xù)到2023年甚至更遠。所以MPEG在6DoF視頻上規(guī)劃了非常長的路線圖,伴隨5G網絡的普及而發(fā)展,一直到2023年左右才會過渡到真正的6DoF視頻標準。 3.2 AVS

現在國內像阿里正在參與的AVS標準已經在整體的6DoF標準建設上走在了MPEG的前面,我們已經過渡到了Windowed 6DoF標準,而MPEG現在還在建設3DoF+的標準,所以說從標準的路線圖上,我們現在是跑在MPEG前面。 我們來看一下AVS標準目前的進展:首先它的標準文檔已經形成了草案的5.0版本,并且標準組計劃在2020年底將AVS 6DoF標準推進到FCD階段。 在標準測試用例方面,我們已經有了六段標準的測試用例,每段包括30個以上的相機紋理圖和深度圖,所以我們的標準測試用例是比較豐富的,并且相機陣列的數目也是比較多的。其次,在參考軟件方面,我們提供了視點重建參考軟件,這個參考軟件目前已經更新到VSS 3.0版本,所以基于標準測試用例和參考軟件,參與標準的一些公司和學校就能很快參與到6DoF視頻標準的實驗、算法開發(fā)和提案工作當中。

4

互動6DoF視頻的未來展望

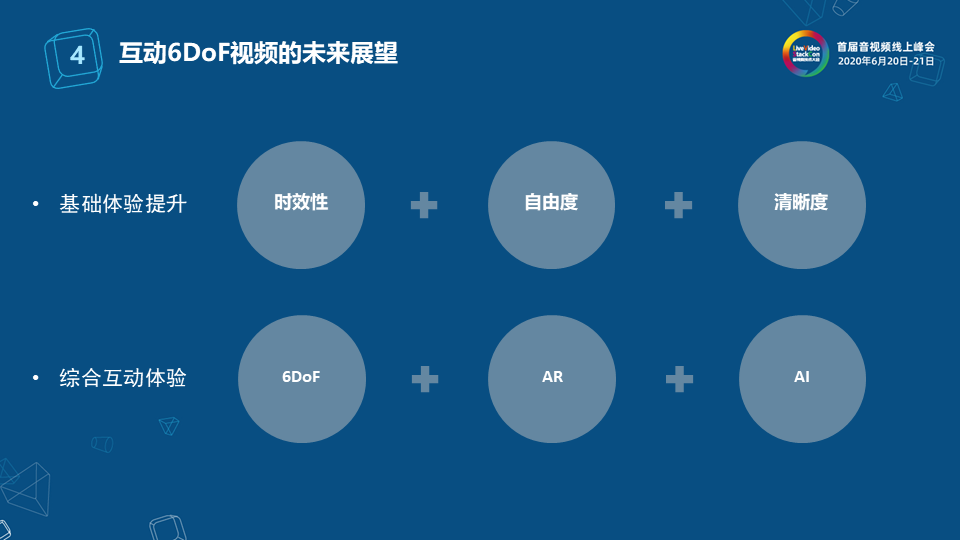

6DoF視頻未來可提升的空間也是非常大的,它的提升空間可以分為兩個部分: 第一是基礎體驗提升。基礎體驗提升意味著三個方面:首先是6DoF視頻時效性的提升,比如我們現在做6DoF視頻的點播,下一步可能要做6DoF視頻的直播。其次是自由度的提升,也就是從Windowed 6DoF發(fā)展到完全的6DoF。最后是清晰度的提升,用戶看到的任意視點的清晰度是否可以更高,比如達到1080p甚至以上。 第二是互動體驗的提升。這意味著6DoF視頻是有和其他周邊的技術進行融合的可能,因為6DoF視頻本身是一個完全三維立體化的視頻,基于這個三維立體化的視頻,我們可以把原先很多的算法在三維的場景上進行組合。比如AR原先是在平面的視頻上,如果它基于6DoF視頻可以有更好的AR展現效果,包括AI原先也是主要用在平面視頻中,在立體的空間中,AI算法能夠有更好的發(fā)揮的余地和想象空間。 首先6DoF視頻是在一個完全三維的場景下,在此基礎上,我們基于AR技術進行數據的呈現,整體三維場景中AR的貼圖,包括平面檢測都是在三維場景下發(fā)生的,這是普通2D視頻中的AR所不能展現的效果。 圖中也顯示了AI技術和6DoF的結合,在終端交互過程中可以對6DoF視頻里的人物進行點擊,通過AI技術在多相機的陣列的圖像中對人進行識別和跟蹤,相比通過單個相機進行識別跟蹤,它的檢測率會更高。 這樣的體驗可以使6DoF視頻在未來成為接近完全游戲化的體驗方式,用戶在觀看一個籃球比賽時可以有很強的交互性、沉浸感以及和AR, AI技術的有機結合,這是對6DoF視頻未來能夠做到的體驗上限的展望。邁入5G時代,我們對于6DoF的基礎體驗和互動體驗的提升還有很長的路要走。

-

三維

+關注

關注

1文章

510瀏覽量

29005 -

視頻信息

+關注

關注

0文章

3瀏覽量

5743 -

5G

+關注

關注

1355文章

48479瀏覽量

564843

原文標題:5G時代探索互動立體視頻信息承載的新可能

文章出處:【微信號:livevideostack,微信公眾號:LiveVideoStack】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

相關推薦

三維測量在醫(yī)療領域的應用

三維掃描與建模的區(qū)別 三維掃描在工業(yè)中的應用

三維電子背散射衍射(EBSD)技術:FIB-SEM與EBSD的結合應用案例

三維可視化運用的主要技術

泰來三維 三維激光掃描結合BIM在工廠掃描建模中的優(yōu)勢

三維可視化的魅力與應用

嵌入式設備中的4G/5G模塊管理

ZEX-MD3三維視頻顯微鏡(4K)

三維可視化數據大屏的設計原理和技巧

輸電線路三跨視頻監(jiān)測裝置的應用原理和功能特點介紹

泰來三維|三維掃描助力鞋企提質增效

泰來三維|文物三維掃描,文物三維模型怎樣制作

5G智慧鋼鐵廠數字孿生三維可視化,推進鋼鐵新型工業(yè)化數字化轉型

5G時代的互動視頻——探索從平面到三維視頻信息表達的新可能

5G時代的互動視頻——探索從平面到三維視頻信息表達的新可能

評論