人工智能(AI)作為一項令人難以置信的驚人創新而迅速發展,其應用無限。它顯示出能夠自動執行例行任務(例如我們的日常工作)的能力,同時還通過新的洞察力增強了人員的能力。借助機器學習的適應性來鞏固人類的想象力和創造力,正在以驚人的速度推動我們的洞察力和理解力。

然而,巨大的力量帶來了巨大的責任。尤其是,由于其可能造成破壞性影響,人工智能在許多方面引起了擔憂。這些憂慮包括勞動力流離失所,失去保護,決策中可能存在的偏見以及對自動化系統和機器人缺乏控制。盡管這些問題值得注意,但同樣可以通過正確的計劃,監督和治理來解決。

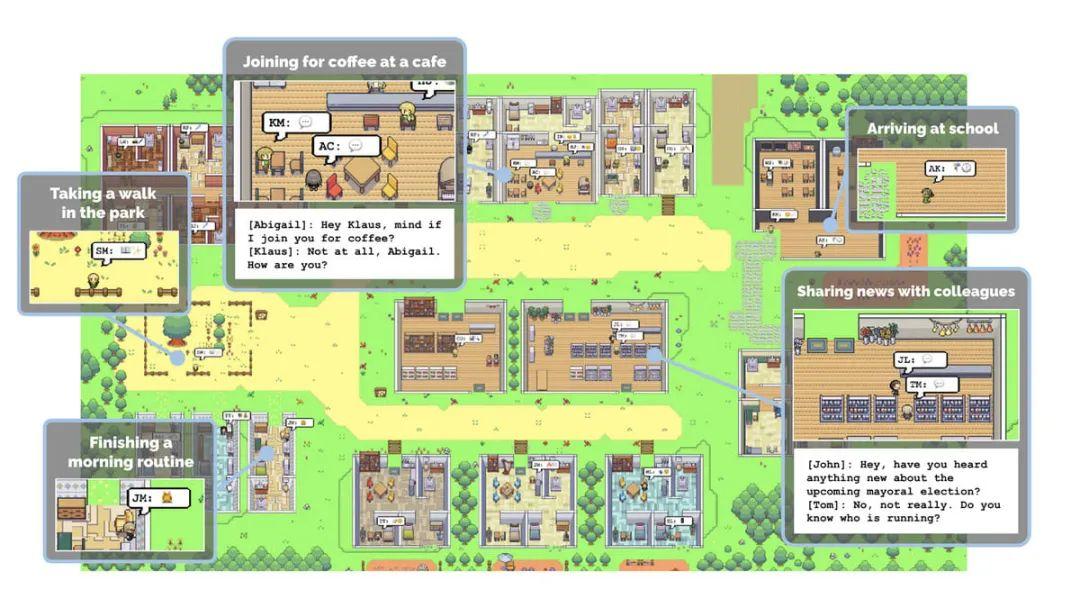

眾多的人工智能系統與人接觸時,應該了解人們的行為方式和需求。這將使它們更有價值,并且使用起來更加安全。理解人們至少可以通過兩種方式使智能系統受益。首先,智能系統必須收集個人需求。在很長的一段時間內,我們將設計可以從人們那里獲得指導和目標的AI框架。但是,人們并不總是準確地說明他們的意思。誤解一個人的意圖可能會導致失敗。其次,要克服無法理解人類的演講或書面語言的問題,請考慮以下事實:如果部分準則或目標被隱含或理解,則完全可以感知的方向會導致失望。

以人為中心的AI同樣也承認人們對智能系統同樣難以理解。當我們考慮可以理解人的智能框架時,我們通常會考慮正常的語言和語音處理,即智能系統是否可以對發聲做出適當的反應。自然語言處理,語音處理和活動識別是構建有用的智能系統的重大挑戰。為了真正有效,人工智能和機器學習系統需要一種關于人類的思維理論。

負責任的AI研究是一個新興領域,倡導在部署機器學習模型時采用更好的實踐和技術。目的是在建立信任的同時,將潛在風險不僅限于部署這些模型的組織,還不僅限于它們所服務的用戶。

負責任的AI是將大量這些基本實踐整合在一起的結構。它圍繞以一種可預見的,以用戶期望,權威性質量以及文化法律和標準可預測的方式,保證對AI技術進行道德,透明和負責任的使用。負責任的AI可以防止單方面信息或算法的使用,確保倡導自動化決策和合理決策,并有助于保持用戶信任和個人隱私。通過給出明確的參與規則,負責任的AI可以使受到公共和國會審查的公司提高并了解具有說服力和負責任的AI的突破性能力。

以人為本的機器學習是迄今為止業務中更重要的概念之一。斯坦福大學和麻省理工學院等領先組織正在明確設立實驗室以鼓勵這種科學。麻省理工學院將此概念定義為“設計,開發和部署以深遠,有意義的方式向人類學習并與人類合作的信息系統。”

人們經常將工作的未來描述為由機器人設備和大量聲稱是人的算法所控制。然而,根據德勤(Deloitte)最近對企業高管的研究,實際上已經在很大程度上計劃采用AI,以使流程更有效,升級產品和服務以及制造新產品和服務,該公司將減少員工人數作為其最不重要的目標進行了評估。

在機器人技術和自動操作員中設置常識性故障是無關緊要的。例如,機器人去藥房并獲得了專業處方藥。由于人類生病了,因此個人可能希望機器人盡快返回。如果機器人直接去藥店,在柜臺后面,拿到藥,再拿回來,它將成功并且將執行時間和金錢減到最少。我們同樣會說,它洗劫了藥店,因為它對為產品交換金錢的社會結構不感興趣。

常識性知識的程序形式可以作為與人互動時使用心智理論的理由,可以使人與人之間的合作更加自然。盡管ML和AI決策算法在人類決策中的工作原理是獨一無二的,但該框架的行為隨后對于個人而言更為明顯。同樣,它也使與個人的交互更加安全:鑒于操作員使用常識性的程序細節填寫了一個不確定的目標,因此可以減少常識性目標失誤;以及一名專家,該專家將按照個人的期望進行示范,從本質上避免了與將人類行為的思想理論應用到智能主體上的個人發生沖突。

-

人工智能

+關注

關注

1791文章

47294瀏覽量

238578 -

機器學習

+關注

關注

66文章

8419瀏覽量

132675 -

自然語言處理

+關注

關注

1文章

618瀏覽量

13561

發布評論請先 登錄

相關推薦

《具身智能機器人系統》第7-9章閱讀心得之具身智能機器人與大模型

BNC插座彎式適應性怎樣

【書籍評測活動NO.51】具身智能機器人系統 | 了解AI的下一個浪潮!

《算力芯片 高性能 CPU/GPU/NPU 微架構分析》第1-4章閱讀心得——算力之巔:從基準測試到CPU微架構的深度探索

生成式人工智能的概念_生成式人工智能主要應用場景

如何在自己的固件中增加wifi自適應性相關功能,以通過wifi自適應認證測試?

7芯M16插頭環境適應性測試

點亮創造力,一文詳解pcb電鍍金

富士通發布最新的人工智能(AI)戰略,聚焦深化人類與AI之間的協作

生成式人工智能和感知式人工智能的區別

借助機器學習的適應性來鞏固人類的想象力和創造力

借助機器學習的適應性來鞏固人類的想象力和創造力

評論