在今天舉行的中國移動“5G+E”網邊融合技術峰會”上,清華大學計算機科學與技術系教授、網絡技術研究所所長崔勇發表了“基于邊緣計算的沉浸式VR”的主題演講。崔勇表示:基于現有通信技術的MEC VR成為創新思路,可通過MEC提升計算能力,通過協同渲染解決帶寬、時延等問題。

2016年就進入了VR元年。而近兩年,VR新品與核心技術不斷涌現,例如愛奇藝VR一體機,高通推出了VR芯片驍龍835,谷歌推出AR Core,Facebook推出社交VR等實時互動的最新相關VR,索尼推出VR實時互動桌游,華為VR眼鏡獲得2019世界VR產業大會創新金獎,近日華為發布VR Glass 6DOF游戲套裝等,說明大廠依然在VR/AR方面發力。

但業界也有人認為VR寒冬將至——應用未果,投資遇冷。究竟是缺乏應用場景,還是技術不夠呢?

在崔勇看來,VR/AR的技術痛點包括:由于VR響應時延需要非常低(小于25ms),沉浸式VR的基本需求包括高刷新率(100Hz)、4K及深度圖像等高質量圖像、360度全景視角,因此難點在于時延、高清、交互,也就是超高清實時交互。在這種情況下超高清實時交互需要計算來提供實時交互,但是高清渲染計算在哪算?如果手機或VR頭盔的GPU進行實時渲染會導致用戶體驗畫面卡頓、手機溫度過熱等問題,因此VR業界正在呼喚高性能計算設備。

崔勇分析了移動VR應用的核心技術難點,邊緣計算模式霞,PC端VR在PC上渲染計算高質量圖像,將圖像實時傳輸至移動端,畫質體驗好但移動受限制。如果讓PC服務器進行高性能的圖像計算,將計算好的圖像實時傳輸到移動端,但大家看到的商店里各式各樣VR產品都戴著小辮子,戴上VR眼鏡玩一會兒看不到小辮子在哪就很容易摔倒。如何砍斷小繩子、打造高質量移動VR呢?對此業界這幾年研究了不少方案,包括預渲染和緩存預測,都難以做到實時交互。

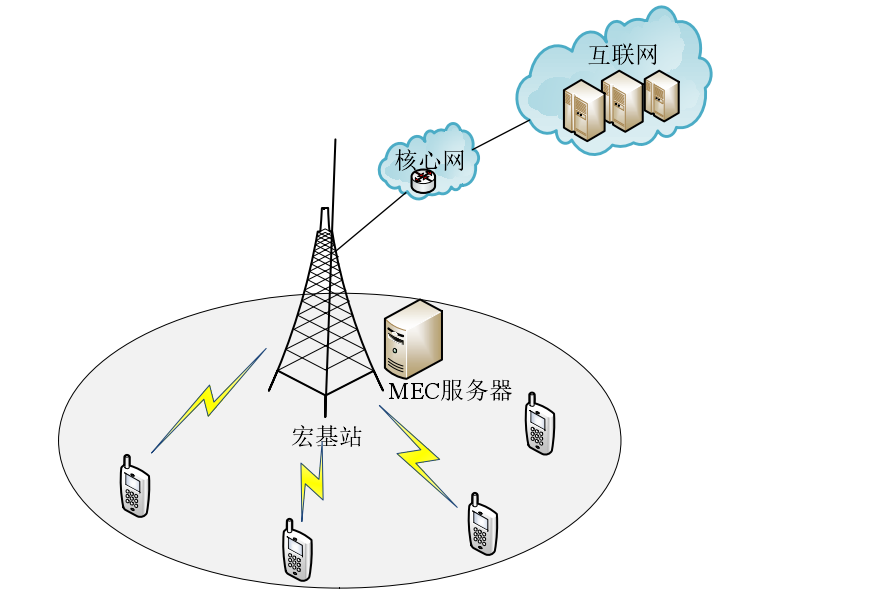

“基于現有通信技術的MEC VR成為創新思路,可通過MEC提升計算能力,通過協同渲染解決帶寬、時延等問題。”崔勇表示:移動VR的內容可以分為前景交互和背景交互,前景交互隨機、不可預測、工作量小,但要求實時渲染,可在移動端渲染;背景交互環境連續、可預測、工作量大,可提前在邊緣服務器渲染。這就需要協同渲染:一是手機GPU根據實時交互渲染前景;二是遠端GPU預渲染背景并進行編碼;三是將臨近的編碼數據幀預先傳輸到手機;四是手機CPU根據實時交互解壓并協同顯示。如果傳輸帶寬不足,可降低背景傳輸帶寬,離散化虛擬世界,預先渲染全景幀、采用H.264預先編碼;如果遇到延時挑戰,可基于移動預測,手機預取置臨近的幀;手機上解碼一個全景幀大約需要40ms的時延,通過并行解碼顯著降低解碼時延。通過這樣設計,可把原來手機上只能看到的每秒5到7幀的內容提升到每秒60多幀,跟手機刷新頻率差不多,并且30分鐘使用了手機不會發熱或發燙,GPU和CPU計算資源使用率尚可,網絡傳輸平均帶寬127-130Mbps。

邊緣計算確實是非常重要的技術創新,崔勇認為,未來MEC的新業務和新需求還包括從VR到云游戲,以及沉浸式遠程教學。

責任編輯:gt

-

高通

+關注

關注

76文章

7499瀏覽量

190935 -

vr

+關注

關注

34文章

9642瀏覽量

150576 -

邊緣計算

+關注

關注

22文章

3113瀏覽量

49269

發布評論請先 登錄

相關推薦

固定帶寬與動態帶寬的區別

dp接口帶寬和分辨率支持

邊緣計算的技術挑戰與解決方案

海外大帶寬云服務器是什么?穩定性如何

為什么ADA4638-1的單位增益帶寬和增益帶寬積不一樣?運放的斬波頻率是多少?

3GPP R16的主要特點

如何提高LoRa抗干擾能力來提升通信質量的幾種技術分享

MEC是什么意思?MEC的應用場景

如何提升嵌入式編程能力?

頻段、信道、帶寬和傳輸速率,還傻傻分不清楚?

基于通信技術的MEC VR可提升計算能力,解決帶寬和時延等問題

基于通信技術的MEC VR可提升計算能力,解決帶寬和時延等問題

評論