Speech2Video 是一種從語音音頻輸入合成人體全身運動(包括頭、口、臂等)視頻的任務,其產生的視頻應該在視覺上是自然的,并且與給定的語音一致。傳統的 Speech2Video 方法一般會使用專用設備和專業操作員進行性能捕獲,且大多數語音和渲染任務是由動畫師完成的,定制使用的成本通常比較昂貴。

近年來,隨著深度神經網絡的成功應用,數據驅動的方法已經成為現實。例如,SythesisObama 或 MouthEditing 通過使用 RNN 通過語音驅動嘴部運動來合成說話的嘴部。泰勒 提出使用音頻來驅動高保真圖形模型,該模型不僅可以將嘴部動畫化,而且還可以對面部的其他部分進行動畫處理以獲得更豐富的語音表達。

然而,嘴部運動的合成大部分是確定性的:給定發音,在不同的人和環境中嘴部的運動或形狀是相似的。但現實生活中,相同情況下的全身手勢運動具有更高的生成力和更多的變異性,這些手勢高度依賴于當前的上下文和正在執行語音的人類。傳遞重要信息時,個性化的手勢會在特定時刻出現。因此,有用的信息僅稀疏地存在于視頻中,這為簡單的端到端學習算法 有限的錄制視頻中捕獲這種多樣性帶來了困難。

近日,百度提出了一種新的方法,將給定文字或音頻轉換為具有同步、逼真、富表現力的肢體語言的實感視頻。該方法首先使用遞歸神經網絡(recursive neural network,RNN)從音頻序列生成 3D 骨骼運動,然后通過條件生成對抗網絡(GAN)合成輸出視頻。

為了使骨骼運動逼真并富有表現力,研究者將關節 3D 人體骨骼的知識和學習過的個性化語音手勢字典嵌入到學習和測試過程中。前者可以防止產生不合理的身體變形,而后者通過一些有意義的身體運動視頻幫助模型快速學習。為了制作富有運動細節的逼真高分辨率視頻,研究者提出一種有條件的 GAN,其中每個細節部分,例如頭和手,是自動放大過的以擁有自己的判別器。該方法與以前處理類似任務的 SOTA 方法相比效果更好。

方法

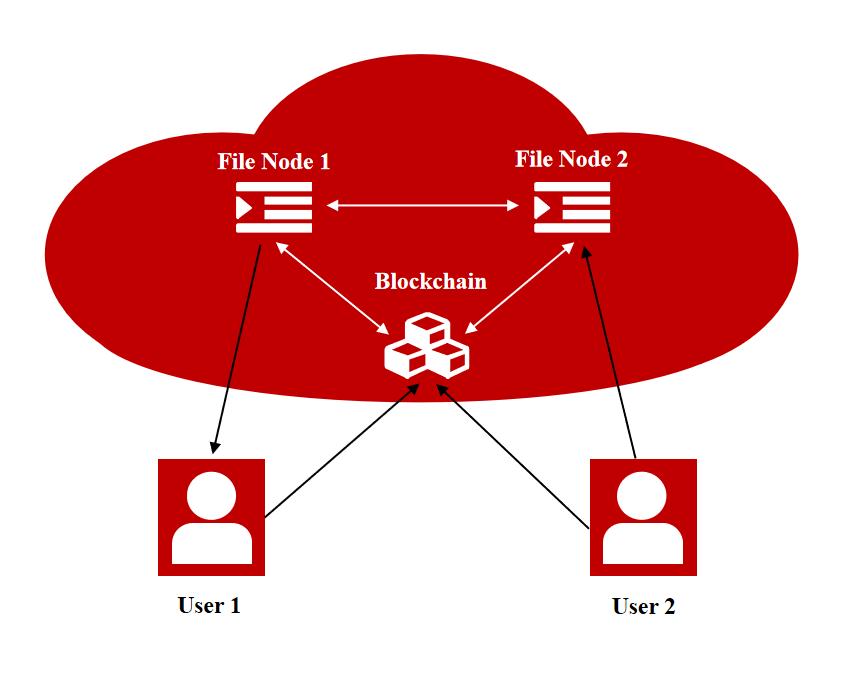

圖 1:Speech2Video 系統 pipeline

如圖 1 所示,根據用于訓練 LSTM 網絡的內容,系統的輸入是音頻或文本。考慮到文本到語音(TTS)和語音到文本(STT)技術都已經成熟并且可商用,此處假定音頻和 text 是可互換的。即使從最先進的 STT 引擎中得到一些錯誤識別的單詞 / 字符,系統也可以容忍這些錯誤,LSTM 網絡的主要目的是將文本 / 音頻映射到身體形狀。錯誤的 STT 輸出通常是與真實發音相似的單詞,這意味著它們的拼寫也很可能是相似的。因此,它們最終將映射的身體形狀或多或少相似。

LSTM 的輸出是由 SMPL-X 參數化的一系列人體姿勢。SMPL-X 是一個人體、面部和手部的 3D 聯合模型,這一動態關節 3D 模型是由一個 2D 彩色骨架圖像序列可視化的。這些 2D 圖像被進一步輸入到 vid2vid 生成網絡中,以生成最終的現實人物圖像。

在成功同步語音和動作的同時,LSTM 大部分時間只能學習重復的人類動作,這會使視頻看起來很無聊。為了使人體動作更具表現力和變化性,研究者在一些關鍵詞出現時將特定姿勢加入 LSTM 的輸出動作中,例如,巨大、微小、高、低等。研究者建立了一個字典,將這些關鍵詞映射到它們相應的姿勢。

模特站在相機和屏幕的前面,當他 / 她在屏幕上閱讀腳本時,研究者會捕獲這些視頻。最后再要求模特擺一些關鍵詞的動作,例如巨大、微小、向上、向下、我、你等等。

人體模型擬合

研究者首先將這些 2D 關鍵點作為人體模型的表示,并訓練了 LSTM 網絡,但結果不能令人滿意。

最后采用了 SMPL-X,這是一種關節式 3D 人體模型。SMPL-X 使用運動學骨架模型對人體動力學進行建模,具有 54 個關節,包括脖子、手指、手臂、腿和腳。

詞典構建和關鍵姿勢插入

研究者從錄制的視頻中手動選擇關鍵姿勢,并建立一個單詞 - 姿勢查詢字典。同樣,該姿勢表示為 106 個 SMPL-X 參數。關鍵姿勢可以是靜止的單幀姿勢或多幀運動,可以通過相同的方法將兩者插入到現有的人體骨骼視頻中。

訓練視頻生成網絡

研究者采用 vid2vid 提出的生成網絡,將骨架圖像轉換為真實的人像。

用于訓練 vid2vid 的示例圖像對。雙手均帶有特殊的色環標記。

運行時間和硬件方面,系統中最耗時和最耗內存的階段是訓練 vid2vid 網絡。在 8 個 NVIDIA Tesla M40 24G GPU 集群上完成 20 個時期的訓練大約需要一周;測試階段要快得多,在單個 GPU 上生成一幀僅需約 0.5 秒。

結果

評估與分析

研究者將使用用戶研究的結果與 4 種 SOTA 方法進行比較,結果顯示,本文方法獲得了最佳的總體質量得分。

此外,研究者使用 Inception 分數評估圖像生成結果,包括兩個方面:圖像質量和圖像多樣性。

為了評估最終輸出的視頻,研究者在 Amazon Mechanical Turk(AMT)上進行了人類主觀測試,共有 112 名參與者。研究者向參與者展示了總共五個視頻,其中四個是合成視頻,兩個由真實人的音頻生成,兩個由 TTS 音頻生成;剩下的是一個真實人物的短片。參與者以李克特量表(從 1(強烈不同意)到 5(強烈同意))對這些視頻的質量進行評分。其中包括:1)人體的完整性(沒有遺漏的身體部位或手指);2)視頻中人臉清晰;3)視頻中的人體動作(手臂,手,身體手勢)看起來自然流暢。4)身體的動作和手勢與聲音同步;5)視頻的整體視覺質量。

總結

Speech2Video 是一種新穎的框架,可以使用 3D 驅動的方法生成逼真的語音視頻,同時避免構建 3D 網格模型。作者在框架內建立了個性化關鍵手勢表,以處理數據稀疏性和多樣性的問題。更重要的是,作者利用 3D 骨骼約束來生成身體動力學,從而保證其姿勢在物理上是合理的。

責任編輯:pj

-

3D

+關注

關注

9文章

2887瀏覽量

107626 -

神經網絡

+關注

關注

42文章

4773瀏覽量

100872 -

數據驅動

+關注

關注

0文章

127瀏覽量

12354

發布評論請先 登錄

相關推薦

科大訊飛AI虛擬人交互平臺榮獲行業最高評級

數字王國與AWS達成合作,推動自主虛擬人技術云端發展

發掘3D文件格式的無限潛力:打造沉浸式虛擬世界

微軟Azure AI語音服務革新:引入虛擬人形象,文本一鍵轉生動視頻

使用NVIDIA Edify助力的服務創建3D資產和虛擬環境照明

奧比中光3D相機打造高質量、低成本的3D動作捕捉與3D動畫內容生成方案

3D建模的重要內容和應用

英倫科技10.1寸裸眼3D平板電腦的五大特點

什么是光場裸眼3D?

3D建模的特點和優勢都有哪些?

VR虛擬空間中的3D 技術

抖音嚴打不當虛擬人物AI生成行為,優化平臺生態環境

搶灘賽道先機走出科創新路,布局AI+虛擬人驅動微美全息(WIMI.US)快速搶占市場新空間

AI克隆技術可用于創建虛擬人物形象!它的技術原理和發展趨勢

關于語音驅動3D虛擬人性能介紹

關于語音驅動3D虛擬人性能介紹

評論