歐洲官方監管機構已將AI診斷用例標記為醫療診斷中的各種場景,這些用例已標記為可能危害基本人權的來源。

歐盟的基本權利機構(FRA)在12月14日發布的報告中列出了其關注的領域。其他領域包括預測性警務,社會服務和定向廣告。

該報告是在AI和大數據的廣泛計劃的一部分,它的建議,來自100多個采訪愛沙尼亞,芬蘭,法國,荷蘭和西班牙使用AI畫的人,根據公告。

法國私營部門的AI用戶告訴FRA,識別AI中的歧視非常復雜,“因為某些種族中某些疾病的發病率更高。預測要考慮到性別,種族,遺傳特征。但這不是歧視或侵犯人權。”

該報告敦促歐盟和歐盟國家:

確保AI尊重所有基本權利,而不僅僅是個人隱私或數據安全。

確保人們可以挑戰AI指導的決策。

在使用AI之前和期間評估AI,以減少負面影響。

提供有關數據保護規則的更多指導。

評估AI是否有區別。

建立有效的監督系統。

在報告的前言中,FRA主管Michael O‘Flaherty說,AI用戶和開發人員“需要擁有正確的工具來全面評估其基本權利含義,其中許多可能不會立即顯現出來。…我們有機會塑造AI [,以便它不僅尊重我們的人權和基本權利,而且還可以保護和促進它們。”

責任編輯:lq

-

醫療

+關注

關注

8文章

1824瀏覽量

58808 -

AI

+關注

關注

87文章

31028瀏覽量

269381 -

大數據

+關注

關注

64文章

8895瀏覽量

137505

發布評論請先 登錄

相關推薦

向成電子XC3588CB核心板助力POCT(快速診斷)儀器應用

施耐德電氣助力醫療診斷試劑精準配比

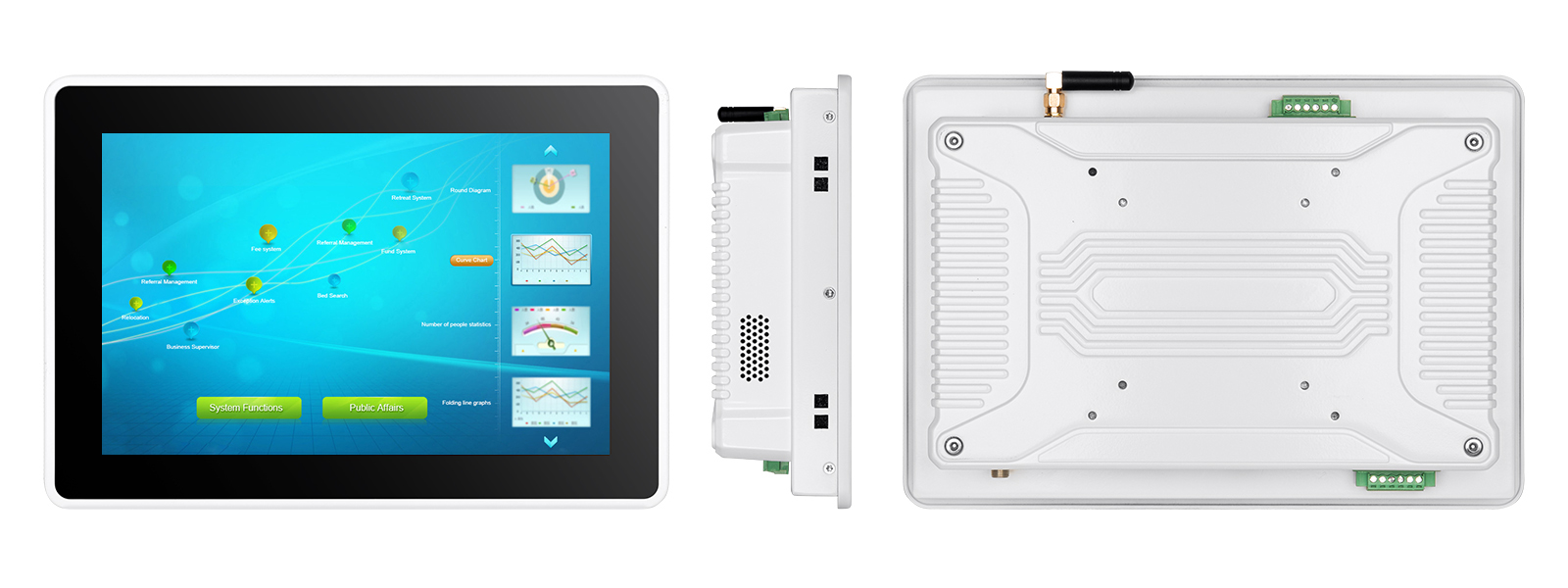

德晟達推出高性能醫療專用AI一體機

智能AI終端在故障診斷中具體是如何工作的?

車載診斷之法規協議 |OBDonUDS和ZEVonUDS

晶閘管故障診斷方法

CAN診斷線判斷教程

TSMaster 的 CAN UDS 診斷操作指南(上)

監管機構已將AI診斷用例標記為醫療診斷中的各種場景

監管機構已將AI診斷用例標記為醫療診斷中的各種場景

評論