本文將帶您了解深度學(xué)習(xí)的工作原理與相關(guān)案例。

什么是深度學(xué)習(xí)?

深度學(xué)習(xí)是機(jī)器學(xué)習(xí)的一個(gè)子集,與眾不同之處在于,DL 算法可以自動(dòng)從圖像、視頻或文本等數(shù)據(jù)中學(xué)習(xí)表征,無需引入人類領(lǐng)域的知識(shí)。深度學(xué)習(xí)中的“深度”一詞表示用于識(shí)別數(shù)據(jù)模式的多層算法或神經(jīng)網(wǎng)絡(luò)。DL 高度靈活的架構(gòu)可以直接從原始數(shù)據(jù)中學(xué)習(xí),這類似于人腦的運(yùn)作方式,獲得更多數(shù)據(jù)后,其預(yù)測(cè)準(zhǔn)確度也將隨之提升。

此外,深度學(xué)習(xí)是在語音識(shí)別、語言翻譯和物體檢測(cè)等任務(wù)中實(shí)現(xiàn)高精密和高準(zhǔn)確性的主要技術(shù)。近期,它也在 AI 領(lǐng)域?qū)崿F(xiàn)了許多突破,包括 Google DeepMind 的 AlphaGo、自動(dòng)駕駛汽車、智能語音助手等成果。

深度學(xué)習(xí)的工作原理

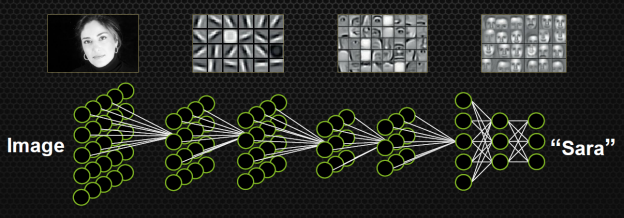

深度學(xué)習(xí)使用多層人工神經(jīng)網(wǎng)絡(luò)(ANN),這是由輸入和輸出之間節(jié)點(diǎn)的幾個(gè)“隱藏層”組成的網(wǎng)絡(luò)。

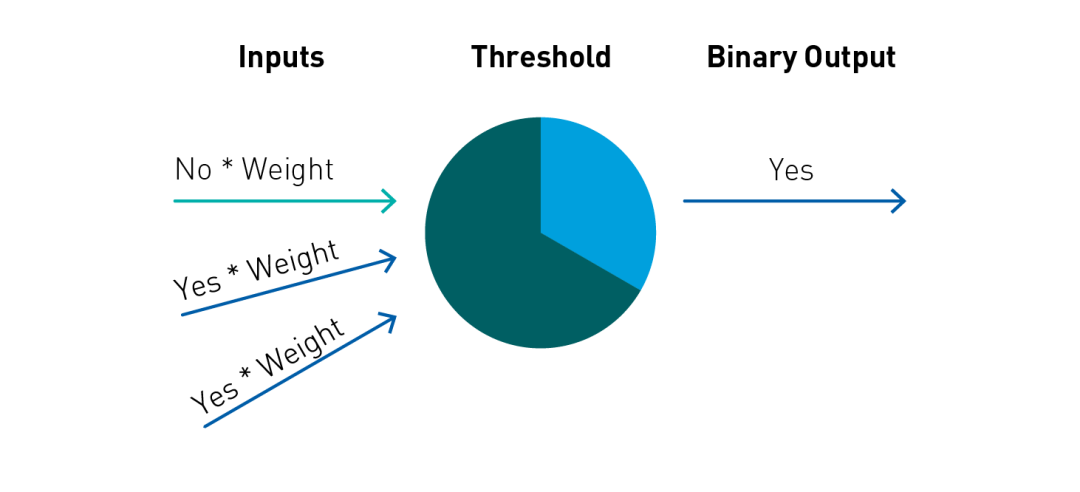

人工神經(jīng)網(wǎng)絡(luò)通過將非線性函數(shù)應(yīng)用于輸入值的加權(quán)求和,以此轉(zhuǎn)換輸入數(shù)據(jù)。該轉(zhuǎn)換叫作神經(jīng)層,該函數(shù)則稱為神經(jīng)元。

層的中間輸出稱為特征,會(huì)用作下一層的輸入。神經(jīng)網(wǎng)絡(luò)會(huì)通過重復(fù)轉(zhuǎn)換來學(xué)習(xí)多層非線性特征(比如邊緣和形狀),之后會(huì)在最后一層匯總這些特征以生成(對(duì)更復(fù)雜物體的)預(yù)測(cè)。

在一個(gè)稱為梯度下降的過程中,通過反向傳播,錯(cuò)誤會(huì)再次通過網(wǎng)絡(luò)發(fā)送回來,并調(diào)整權(quán)重,從而改進(jìn)模型。神經(jīng)網(wǎng)絡(luò)的學(xué)習(xí)方式是,改變網(wǎng)絡(luò)的權(quán)重或參數(shù)以便將神經(jīng)網(wǎng)絡(luò)的預(yù)測(cè)值與期望值之差降至最低。此過程會(huì)重復(fù)數(shù)千次,根據(jù)生成的錯(cuò)誤調(diào)整模型的權(quán)重,直到錯(cuò)誤不能再減少。我們將人工神經(jīng)網(wǎng)絡(luò)從數(shù)據(jù)中學(xué)習(xí)的這一階段稱為訓(xùn)練。 在此過程中,層會(huì)學(xué)習(xí)模型的優(yōu)化特征,而該模型的優(yōu)勢(shì)是特征不需要預(yù)先確定。

深度學(xué)習(xí)用例

深度學(xué)習(xí)常用于計(jì)算機(jī)視覺、對(duì)話式 AI 和推薦系統(tǒng)等應(yīng)用。計(jì)算機(jī)視覺應(yīng)用使用深度學(xué)習(xí)從數(shù)字圖像和視頻中獲取知識(shí)。對(duì)話式 AI 應(yīng)用程序能夠幫助計(jì)算機(jī)通過自然語言實(shí)現(xiàn)理解和交流能力。推薦系統(tǒng)使用圖像、語言和用戶興趣來提供有意義且相關(guān)的搜索結(jié)果和服務(wù)。

深度學(xué)習(xí)正在應(yīng)用于自動(dòng)駕駛汽車、智能私人助理和更智能的網(wǎng)絡(luò)服務(wù)。先進(jìn)的團(tuán)隊(duì)和組織都在使用欺詐檢測(cè)和供應(yīng)鏈現(xiàn)代化等深度學(xué)習(xí)應(yīng)用程序。

深度學(xué)習(xí)算法有許多不同的變體,比如以下幾種:

只將信息從一層向前饋送至下一層的人工神經(jīng)網(wǎng)絡(luò)稱為前饋人工神經(jīng)網(wǎng)絡(luò)。多層感知器 (MLP) 是一種前饋 ANN,由至少三層節(jié)點(diǎn)組成:輸入層、隱藏層和輸出層。MLP 擅長(zhǎng)使用已標(biāo)記的輸入進(jìn)行分類預(yù)測(cè)。它們是可應(yīng)用于各種場(chǎng)景的靈活網(wǎng)絡(luò)。

卷積神經(jīng)網(wǎng)絡(luò)是識(shí)別物體的圖像處理器。在某些情況下,CNN 圖像識(shí)別表現(xiàn)優(yōu)于人類,包括識(shí)別貓、血液中的癌癥跡象以及 MRI 掃描影像中的腫瘤。CNN 已成為當(dāng)今自動(dòng)駕駛汽車、石油勘探和聚變能源研究領(lǐng)域的點(diǎn)睛之筆。在醫(yī)療健康方面,它們可以加快醫(yī)學(xué)成像發(fā)現(xiàn)疾病的速度,并且更快速地挽救生命。

時(shí)間遞歸神經(jīng)網(wǎng)絡(luò)是解析語言模式和序列數(shù)據(jù)的數(shù)學(xué)工具。

這些網(wǎng)絡(luò)正在推動(dòng)一場(chǎng)基于語音的計(jì)算革命,并為Amazon Alexa、Google Assistant 和 Apple Siri 提供能夠?qū)崿F(xiàn)聽力和語音的自然語言處理的大腦。它們還為 Google 的自動(dòng)完成功能提供了預(yù)見性魔力,可以自行填寫搜索查詢中的行。

RNN 應(yīng)用程序不僅限于自然語言處理和語音識(shí)別。其還可用于語言翻譯、股票預(yù)測(cè)和程序化交易。

為檢測(cè)金融欺詐,可以使用 RNN 對(duì)異常支出模式進(jìn)行紅色標(biāo)記,RNN 尤其擅長(zhǎng)猜測(cè)一系列數(shù)據(jù)中接下來的變化。美國運(yùn)通已部署基于深度學(xué)習(xí)的模型,這些模型已使用 NVIDIA TensorRT進(jìn)行優(yōu)化,并運(yùn)行在 NVIDIA Triton推理服務(wù)器上,以檢測(cè)欺詐。

深度學(xué)習(xí)為何對(duì)研究人員和數(shù)據(jù)科學(xué)家至關(guān)重要

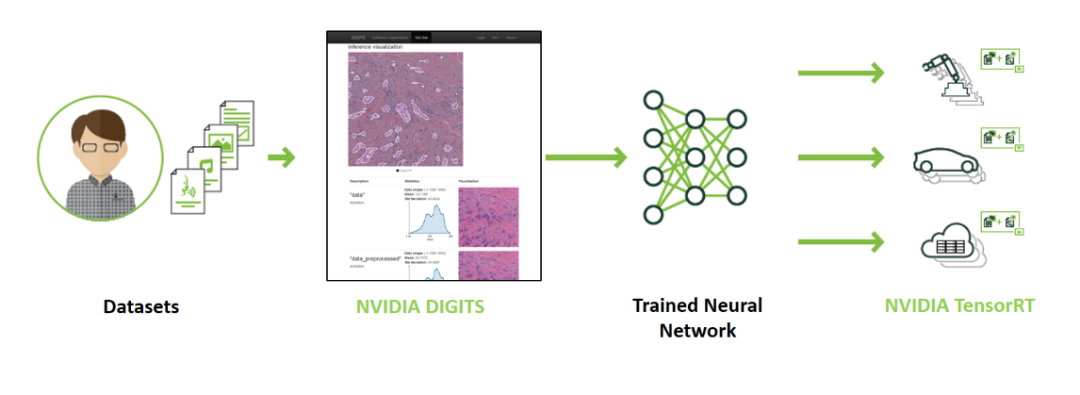

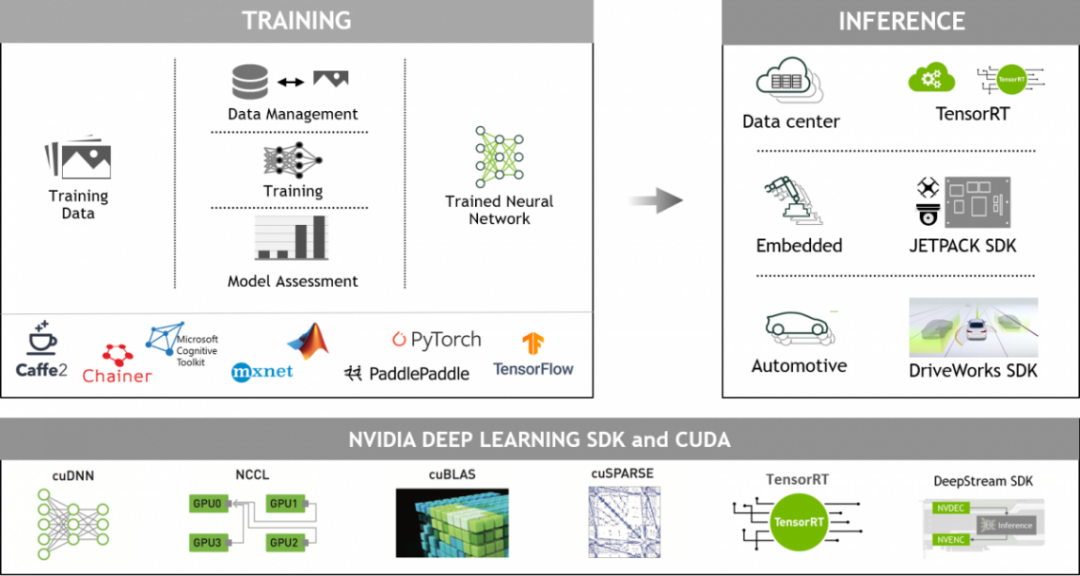

借助 NVIDIA GPU 加速的深度學(xué)習(xí)框架,研究人員和數(shù)據(jù)科學(xué)家可顯著提升深度學(xué)習(xí)訓(xùn)練的速度,只需幾小時(shí)就能完成之前需要幾天才能完成的訓(xùn)練,而原先需要幾周才能完成的訓(xùn)練只需幾天即可完成。準(zhǔn)備好部署模型后,開發(fā)者可依靠面向云、嵌入式設(shè)備或自動(dòng)駕駛汽車的 GPU 加速推理平臺(tái),為計(jì)算密集型深度神經(jīng)網(wǎng)絡(luò)實(shí)現(xiàn)高性能、低延遲的推理。

面向開發(fā)者的 NVIDIA 深度學(xué)習(xí)

GPU 加速深度學(xué)習(xí)框架能夠?yàn)樵O(shè)計(jì)和訓(xùn)練自定義深度神經(jīng)網(wǎng)絡(luò)帶來靈活性,并為 Python 和 C/C++ 等常用編程語言提供編程接口。MXNet、PyTorch、TensorFlow 等廣泛使用的深度學(xué)習(xí)框架依賴于 NVIDIA GPU 加速庫,能夠提供高性能的多 GPU 加速訓(xùn)練。

-

NVIDIA

+關(guān)注

關(guān)注

14文章

4986瀏覽量

103058 -

AI

+關(guān)注

關(guān)注

87文章

30896瀏覽量

269087 -

人工神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

1文章

119瀏覽量

14624 -

機(jī)器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8418瀏覽量

132635 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5503瀏覽量

121162

原文標(biāo)題:NVIDIA 大講堂 | 什么是深度學(xué)習(xí)(Deep Learning)?

文章出處:【微信號(hào):NVIDIA_China,微信公眾號(hào):NVIDIA英偉達(dá)】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

NPU在深度學(xué)習(xí)中的應(yīng)用

GPU深度學(xué)習(xí)應(yīng)用案例

AI大模型與深度學(xué)習(xí)的關(guān)系

深度學(xué)習(xí)中的時(shí)間序列分類方法

深度學(xué)習(xí)與nlp的區(qū)別在哪

深度神經(jīng)網(wǎng)絡(luò)的工作原理、特點(diǎn)及應(yīng)用范圍

深度學(xué)習(xí)的基本原理與核心算法

人工智能、機(jī)器學(xué)習(xí)和深度學(xué)習(xí)是什么

深度學(xué)習(xí)與卷積神經(jīng)網(wǎng)絡(luò)的應(yīng)用

深度學(xué)習(xí)模型訓(xùn)練過程詳解

深度學(xué)習(xí)與傳統(tǒng)機(jī)器學(xué)習(xí)的對(duì)比

深度解析深度學(xué)習(xí)下的語義SLAM

為什么深度學(xué)習(xí)的效果更好?

什么是深度學(xué)習(xí)?機(jī)器學(xué)習(xí)和深度學(xué)習(xí)的主要差異

詳解深度學(xué)習(xí)、神經(jīng)網(wǎng)絡(luò)與卷積神經(jīng)網(wǎng)絡(luò)的應(yīng)用

什么是深度學(xué)習(xí)(Deep Learning)?深度學(xué)習(xí)的工作原理詳解

什么是深度學(xué)習(xí)(Deep Learning)?深度學(xué)習(xí)的工作原理詳解

評(píng)論