為響應(yīng)大眾需求,微軟 宣布 在 2020 年 5 月的建造大會上推出了建造( WSL 2 ) – GPU 加速功能。這一特性為許多計算應(yīng)用程序、專業(yè)工具和工作負(fù)載打開了大門,目前這些應(yīng)用程序、專業(yè)工具和工作負(fù)載只能在 Linux 上運行,而且可以從 GPU 加速中獲益。

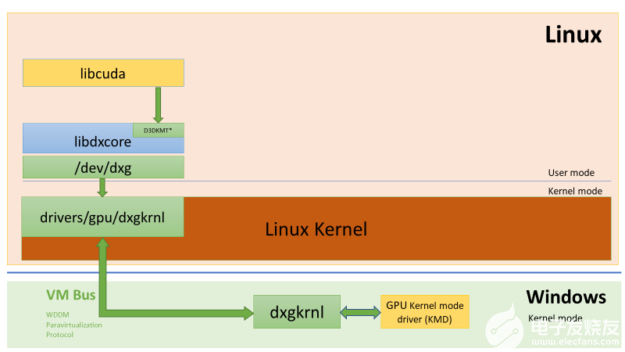

圖 1 顯示在 wsl2 容器中運行 linuxai 框架時涉及的層的堆棧圖像。

最重要的是, NVIDIA CUDA 的加速現(xiàn)在來到了 WSL 。在這篇文章中,我們將討論您對 WSL 2 的公共預(yù)覽 中的 CUDA 的期望。

什么是 WSL ?

WSL 是 windows10 的一個特性,它使您能夠直接在 Windows 上運行本機(jī) Linux 命令行工具,而不需要復(fù)雜的雙引導(dǎo)環(huán)境。在內(nèi)部, WSL 是一個與 Microsoft Windows 操作系統(tǒng)緊密集成的容器化環(huán)境。這使得它可以在傳統(tǒng) Windows 桌面和現(xiàn)代商店應(yīng)用程序的同時運行 Linux 應(yīng)用程序。

WSL 主要是開發(fā)人員的工具。如果您在 Linux 容器中處理計算工作負(fù)載,那么可以使用熟悉的本地 Linux 工具在 Windows PC 上本地開發(fā)和測試工作負(fù)載。通常,這些應(yīng)用程序需要大量的黑客攻擊、第三方框架和庫才能在 Windows 系統(tǒng)上運行。 WSL 2 改變了這一切, wsl2 為 Windows 世界帶來了完全的 Linux 內(nèi)核支持。

借助于 WSL 2 和 GPU 半虛擬化( GPU -PV )技術(shù),微軟通過允許您運行針對 GPU 硬件的計算工作負(fù)載,為 Windows 上的 Linux 支持添加了另一個旋轉(zhuǎn)。在這篇文章的后面,我們將更詳細(xì)地介紹 WSL 2 以及如何在其中添加 GPU 。

CUDA in WSL

要利用 WSL2 中的 WDDM 模型 ,目標(biāo)系統(tǒng)必須安裝支持 MicrosoftGPU 的 GPU 驅(qū)動程序。這些驅(qū)動程序由 GPU 硬件供應(yīng)商提供,如 NVIDIA 。

CUDA 允許您編程 NVIDIA GPUs 。幾十年來,它一直在 Windows 圖形的 WDDM 模型中得到支持。新的 Microsoft WSL2 容器提供了 GPU 加速, CUDA 可以利用它在 WSL 內(nèi)部運行 CUDA 工作負(fù)載。

針對 WDDM 2 . 9 模型的 NVIDIA 顯示驅(qū)動程序包含了對 WSL 中 CUDA 的支持。您只需在 Windows 主機(jī)上安裝驅(qū)動程序。 WSL ( libCUDA . so )中的 CUDA 用戶模式驅(qū)動程序會自動映射到容器內(nèi)部,并添加到那里的加載程序搜索路徑中。

NVIDIA 驅(qū)動程序開發(fā)團(tuán)隊為 CUDA 驅(qū)動程序添加了對 WDDM 模型和 GPU -PV 的支持,以便能夠在 Windows 上的 Linux 上運行它。它仍然是一個預(yù)覽驅(qū)動程序,在 Windows 10 中 WSL 的官方 GPU 支持發(fā)布之前不會發(fā)布。

圖 2 展示了如何將 CUDA 驅(qū)動程序插入到 linuxguest 中新的 WDDM 模型中的簡單圖。

圖 2 。支持在 Linux 客戶機(jī)中運行的 CUDA 用戶模式驅(qū)動程序的 WDDM 模型圖。

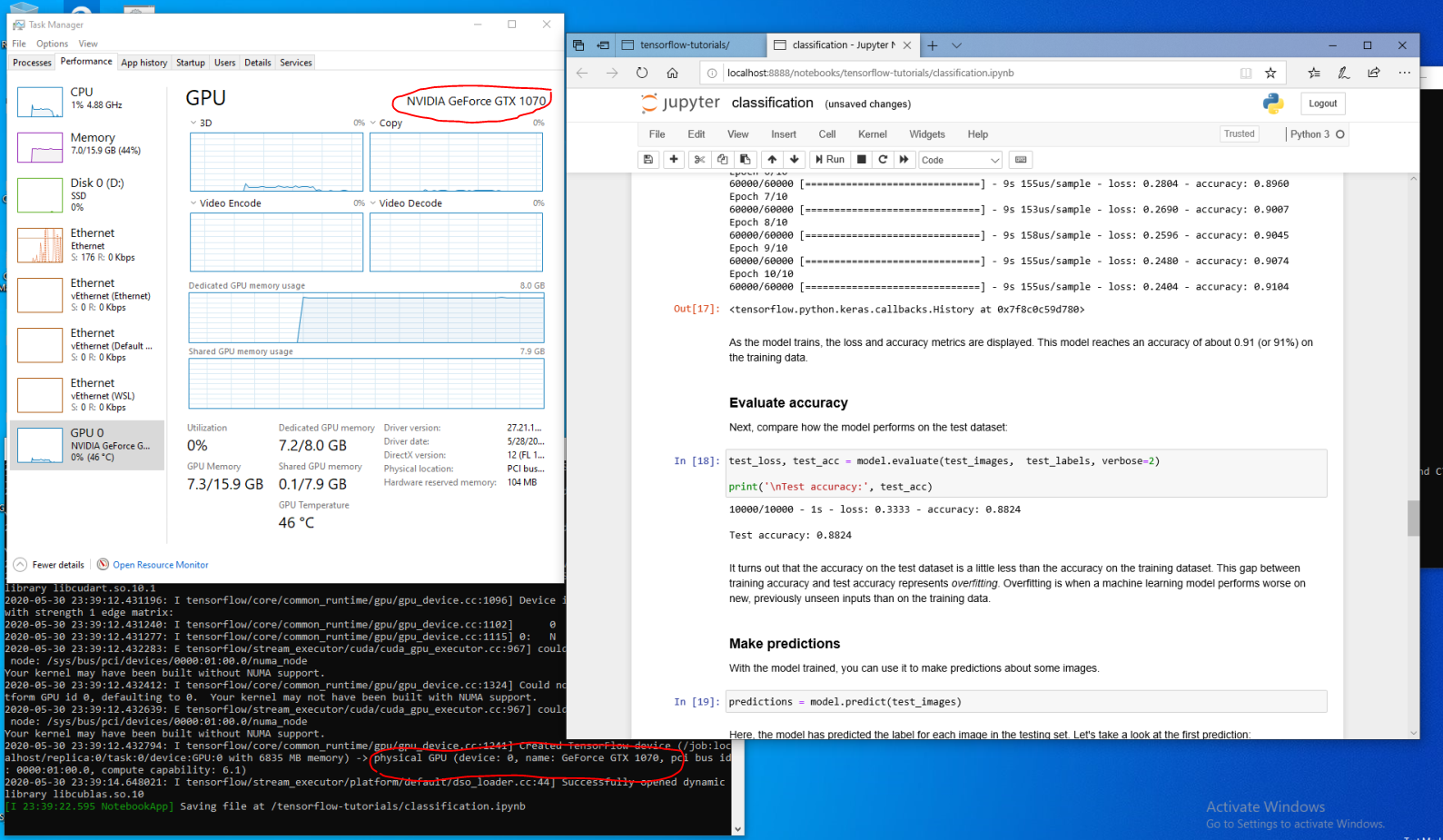

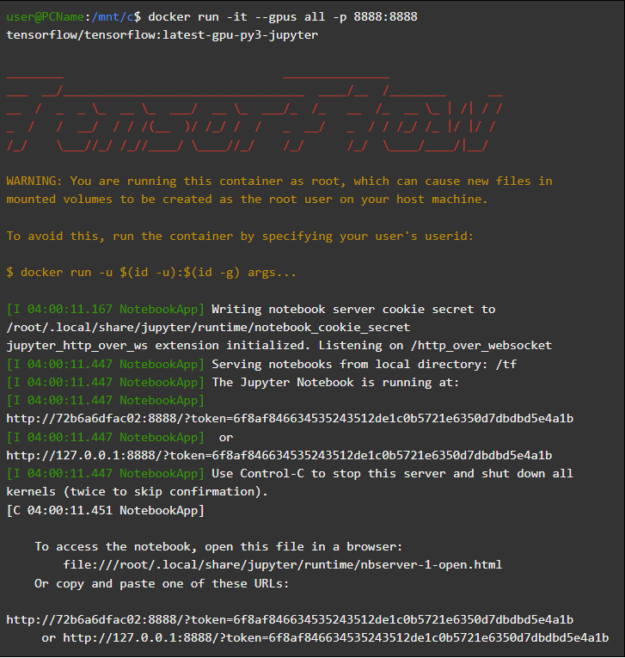

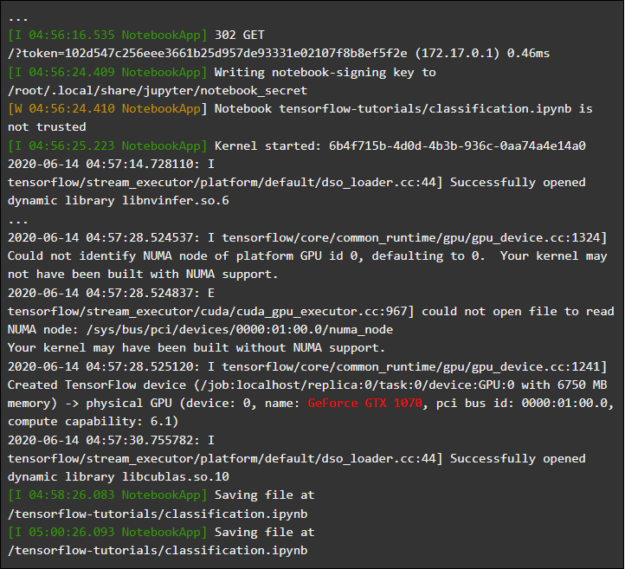

如果您是一名開發(fā)人員,在 Microsoft Windows Insider 程序 的 快速環(huán) ( build 20149 或更高版本)的最新 Windows 版本上安裝了 WSL 發(fā)行版,并將容器設(shè)置為在 WSL2 模式下運行;如果您是 PC 中的 NVIDIA GPU 的受啟發(fā)所有者,則可以嘗試該驅(qū)動程序并在 WSL2 中運行工作負(fù)載。您只需在 Windows 主機(jī)操作系統(tǒng)上安裝驅(qū)動程序,然后打開 WSL 容器。沒有任何額外的努力 CUDA 就會有 CUDA 的應(yīng)用。圖 3 顯示了在 WSL2 容器中運行 CUDA TensorFlow 工作負(fù)載的屏幕截圖。

圖 3 。 TensorFlow 在 wsl2 內(nèi)部運行的容器。

WSL 中的 GPU 為當(dāng)前僅在本機(jī) Linux 環(huán)境中運行的各種 CUDA 計算應(yīng)用程序打開了一扇大門。

NVIDIA 目前仍在積極開展本項目的工作,并進(jìn)行調(diào)整。除其他外,我們正在努力將以前特定于 Linux 的 API 引入 WDDM 層,以便越來越多的應(yīng)用程序能夠在 WSL 上立即工作。

另一個重點是性能。如前所述, WSL2 GPU 支持大量利用了 GPU -PV ,這可以在沒有任何流水線的情況下影響小的 GPU 工作負(fù)載。現(xiàn)在,我們正在盡可能減少這些開銷。

NVML 公司

NVML 不包含在初始驅(qū)動程序包中,對此有一些顧慮。為了解決這個問題,我們計劃將 NVML 與其他庫一起引入 WSL 。

我們首先介紹了核心 CUDA 驅(qū)動程序,讓您在這個早期預(yù)覽中嘗試大部分現(xiàn)有的工作負(fù)載。我們意識到有些容器和應(yīng)用程序甚至在加載 CUDA 之前就利用 NVML 來查詢 GPU 信息。這就是為什么我們把 NVML 放在 WSL 的首要任務(wù)之一。請繼續(xù)關(guān)注此主題的更多更新。

GPU WSL 中的容器

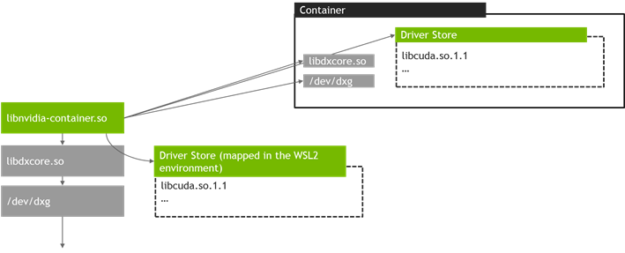

除了 DirectX 和 CUDA 支持之外, NVIDIA 還增加了對 WSL2 中的 NVIDIA 容器工具包(以前是 NVIDIA -docker2 )的支持。數(shù)據(jù)科學(xué)家準(zhǔn)備在 Linux 本地硬件下運行或在云端執(zhí)行的容器化 GPU 工作負(fù)載現(xiàn)在可以在 Windows PC 上的 WSL2 中運行。

WSL 不需要特定的包。 NVIDIA 運行時庫( libNVIDIA -container )可以動態(tài)檢測 libdxcore ,并在具有 GPU 加速的 WSL2 環(huán)境中運行時使用它。在安裝了 Docker 和 NVIDIA 容器工具包包之后,這會自動發(fā)生,就像在 Linux 上一樣,允許 GPU – 加速容器開箱即用。

我們建議您使用 Docker tools 的最新版本( 19 . 03 或更高版本),以利用對 --gpus 選項的附加支持。要啟用 WSL2 支持,請按照針對 Linux 發(fā)行版的 GitHub repo 上的 自述文件 步驟,安裝可用的最新版本。

那么它是如何工作的呢?所有 wsl2 特定的工作都由 libNVIDIA – 容器 庫處理。這個庫現(xiàn)在可以在運行時檢測 libdxcore . so 并使用它來檢測所有暴露在這個接口上的 GPUs 。

如果需要在容器中使用這些 GPUs ,則可以使用查詢驅(qū)動程序存儲的位置,該文件夾包含 Windows 主機(jī)和 WSL2 的所有驅(qū)動程序庫 libdxcore . so . NVIDIA 支持的核心庫進(jìn)行設(shè)置,如圖 4 所示。

圖 4 。 libNVIDIA 使用的發(fā)現(xiàn)和映射方案 – 集裝箱. so 在 WSL 2 上。

而且,這與 WSL 之外使用的邏輯不同。這是由 libNVIDIA 完全抽象出來的 – 集裝箱. so 并且應(yīng)該對最終用戶盡可能透明。這個早期版本的一個限制是在 multi-GPU 環(huán)境中缺少 GPU 選擇:所有的 GPUs 在容器中總是可見的。

以下是您可以在 WSL 容器中運行的內(nèi)容:您當(dāng)前熟悉的任何 NVIDIA Linux 容器。 NVIDIA 支持專業(yè)人士使用的大多數(shù)現(xiàn)有 Linux 工具和工作流。從 NVIDIA NGC 下載一個最喜歡的容器工作負(fù)載并嘗試一下。

在下一節(jié)中,我們將描述如何在 WSL2 中運行 TensorFlow 和 n -body 容器,工作負(fù)載由 NVIDIA GPUs 加速。

運行 N-body 容器

使用 Docker 安裝腳本安裝 Docker :

user@PCName:/mnt/c$ curl https://get.docker.com | sh

安裝 NVIDIA 容器工具包。 WSL2 支持從 NVIDIA -docker2v2 . 3 和底層運行庫 libNVIDIA -container 1 . 2 . 0-rc . 1 開始提供。

設(shè)置stable和experimental存儲庫和 GPG 密鑰。支持 wsl2 的運行時更改可以在實驗存儲庫中找到。

user@PCName:/mnt/c$ distribution=$(. /etc/os-release;echo $ID$VERSION_ID) user@PCName:/mnt/c$ curl -s -L https://nvidia.github.io/nvidia-docker/gpgkey | sudo apt-key add - user@PCName:/mnt/c$ curl -s -L https://nvidia.github.io/nvidia-docker/$distribution/nvidia-docker.list | sudo tee /etc/apt/sources.list.d/nvidia-docker.list user@PCName:/mnt/c$ curl -s -L https://nvidia.github.io/libnvidia-container/experimental/$distribution/libnvidia-container-experimental.list | sudo tee /etc/apt/sources.list.d/libnvidia-container-experimental.list

安裝 NVIDIA 運行時軟件包及其依賴項:

user@PCName:/mnt/c$ sudo apt-get update

user@PCName:/mnt/c$ sudo apt-get install -y nvidia-docker2

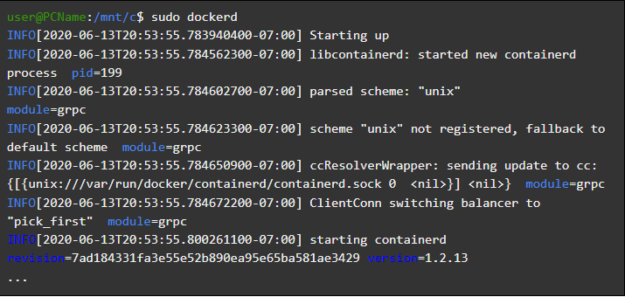

打開 WSL 容器并在那里啟動 Docker 守護(hù)進(jìn)程。您應(yīng)該可以看到 dockerd 服務(wù)的輸出。

user@PCName:/mnt/c$ sudo dockerd

在另一個 WSL 容器窗口中,下載并啟動N-body simulation 容器。確保用戶有足夠的權(quán)限下載容器。您可能需要在 sudo 中運行以下命令。 GPU 在輸出中突出顯示。

user@PCName:/mnt/c$ docker run --gpus all nvcr.io/nvidia/k8s/cuda-sample:nbody nbody -gpu -benchmark

運行 TensorFlow 容器

在 WSL2 的 Docker 中嘗試另一個流行的容器: TensorFlow 。

下載 TensorFlow Docker 映像。為了避免 Docker 連接問題,命令在 sudo 中運行。

user@PCName:/mnt/c$ docker pull tensorflow/tensorflow:latest-gpu-py3

將 TensorFlow 教程中稍微修改過的第 15 課 – 使用 GPU?版本保存在主機(jī)的驅(qū)動器 C 上,默認(rèn)情況下,該版本在 WSL2 容器中映射為/ mnt / C 。

user@PCName:/mnt/c$ vi ./matmul.py

import sys

import numpy as np

import tensorflow as tf

from datetime import datetime device_name = sys.argv[1] # Choose device from cmd line. Options: gpu or cpu

shape = (int(sys.argv[2]), int(sys.argv[2]))

if device_name == "gpu": device_name = "/gpu:0"

else: device_name = "/cpu:0" tf.compat.v1.disable_eager_execution()

with tf.device(device_name): random_matrix = tf.random.uniform(shape=shape, minval=0, maxval=1) dot_operation = tf.matmul(random_matrix, tf.transpose(random_matrix)) sum_operation = tf.reduce_sum(dot_operation) startTime = datetime.now()

with tf.compat.v1.Session(config=tf.compat.v1.ConfigProto(log_device_placement=True)) as session: result = session.run(sum_operation) print(result) # Print the results

print("Shape:", shape, "Device:", device_name)

print("Time taken:", datetime.now() - startTime)

在一個 GPU 和一個 CPU 上運行這個從掛載驅(qū)動器 C 啟動的腳本的結(jié)果如下所示。為了簡單起見,減少了輸出。

user@PCName:/mnt/c$ docker run --runtime=nvidia --rm -ti -v "${PWD}:/mnt/c" tensorflow/tensorflow:latest-gpu-jupyter python /mnt/c/matmul.py gpu 20000

對于早期的計算場景,當(dāng)在 WSL2 容器中使用 GPU 時,有一個顯著的加速。

下面是另一個演示,可以看到由 GPU 加速的工作: Jupyter 筆記本教程。當(dāng)容器啟動時,您應(yīng)該會看到打印到筆記本服務(wù)器的鏈接。

user@PCName:/mnt/c$ docker run -it --gpus all -p 8888:8888 tensorflow/tensorflow:latest-gpu-py3-jupyter

現(xiàn)在您應(yīng)該能夠在 Jupyter 筆記本上運行演示示例了。連接到筆記本時,請注意使用 Microsoft Edge browser 中的 localhost ,而不是 127 . 0 . 0 . 1 。

導(dǎo)航到 TensorFlow – 教程并運行分類. ipynb 筆記本電腦。

要查看 Windows PC 的 GPU 加速的工作,請導(dǎo)航到細(xì)胞菜單,選擇全部運行,然后檢查 Jupyter 筆記本的 wsl2 容器中的日志。

這個演示和這個容器中的一些其他演示突出了虛擬化層在小型提交上的當(dāng)前開銷問題,前面也提到過。與這些玩具模型相關(guān)聯(lián)的提交導(dǎo)致 GPU 運行時比同步開銷本身要短。在 WSL2 上的這些極小模型中, CPU 時間 MIG ht 比 GPU 時間要好。目前正在對其進(jìn)行優(yōu)化,應(yīng)將其限制在較小的非流水線工作負(fù)載中。

WSL 概述

為了理解 GPU 是如何添加到 wsl2 中的,我們現(xiàn)在討論什么是 Windows 上的 Linux ,以及如何將硬件暴露到容器中。

微軟在 2016 年的 建造 大會上介紹了 WSL 。它很快獲得了發(fā)展勢頭,并成為希望在 Linux 開發(fā)工具和目標(biāo)工作負(fù)載的同時運行 Office 等 Windows 應(yīng)用程序的 Linux 開發(fā)人員的流行工具。

WSL1 允許運行未修改的 Linux 二進(jìn)制文件。但是,它仍然使用 Linux 內(nèi)核仿真層,它是作為 NT 內(nèi)核中的一個子系統(tǒng)實現(xiàn)的。這個子系統(tǒng)通過將調(diào)用轉(zhuǎn)發(fā)到相應(yīng)的 windows10 功能來處理來自 Linux 應(yīng)用程序的調(diào)用。

WSL1 是一個有用的工具,但它并不兼容所有的 Linux 應(yīng)用程序,因為它可能需要模擬每個 Linux 系統(tǒng)調(diào)用。一般來說,文件系統(tǒng)的訪問速度也很慢,這導(dǎo)致了一些實際應(yīng)用程序無法接受的性能。

考慮到這一點,微軟決定另辟蹊徑,推出了 WSL 的新版本 WSL2 。 WSL2 容器在虛擬化環(huán)境中運行完整的 Linux 發(fā)行版,同時仍然充分利用 windows10newcontainer 系統(tǒng)的全部優(yōu)點。

雖然 wsl2 使用 windows10 的 Hyper-V 服務(wù),但它仍然不是傳統(tǒng)的 VM ,而是一個輕量級的實用 VM 。該實用程序管理虛擬地址備份內(nèi)存,允許 wsl2 容器從主機(jī) Windows 系統(tǒng)動態(tài)分配內(nèi)存。

WSL2 的一些主要目標(biāo)是提高文件系統(tǒng)性能和支持完全的系統(tǒng)調(diào)用兼容性。它還具有更好的整體 Windows 主機(jī)系統(tǒng)集成。它允許從 Windows shell 到運行在容器內(nèi)的 Linux 系統(tǒng)的快捷方式,以及對主機(jī)文件系統(tǒng)的訪問,這些文件系統(tǒng)自動安裝到容器文件系統(tǒng)的選定目錄中。

WSL2 已作為 Windows Insider 程序的預(yù)覽功能啟用,并作為最近的 Windows 10 更新( 2004 版)發(fā)布。

在最新的 Windows 版本中, wsl2 容器有更多的改進(jìn),從網(wǎng)絡(luò)堆棧到底層存儲 VHD 。描述所有細(xì)節(jié)將超出本文的范圍。有關(guān) WSL2 容器的一些有趣和令人興奮的新特性的更多信息,請參見 比較 wsl2 和 WSL1 。

WSL 2 Linux 內(nèi)核

WSL2 中的 Linux 內(nèi)核是由 Microsoft 從最新的穩(wěn)定分支構(gòu)建的,它基于內(nèi)核。 org 。 這個內(nèi)核專門針對 wsl2 進(jìn)行了調(diào)優(yōu),針對大小和性能進(jìn)行了優(yōu)化,以提供 Windows 上的 Linux 體驗。內(nèi)核由 windowsupdate 提供服務(wù),這意味著您無需自己管理就可以獲得最新的安全修復(fù)和內(nèi)核改進(jìn)。

微軟在 WSL 中支持一些 Linux 發(fā)行版。遵循開放源碼社區(qū)的規(guī)則, wsl2 內(nèi)核源代碼是公共的,可以在 WSL2 Linux 內(nèi)核 GitHub repo 上獲得,并進(jìn)行必要的修改以允許系統(tǒng)與 windows10 主機(jī)集成。

GPU in WSL

微軟開發(fā)人員通過 GPU -PV 技術(shù)將真正的 GPU 硬件支持引入到 wsl2 容器中,操作系統(tǒng)圖形內(nèi)核( dxgkrnl )將運行在來賓虛擬機(jī)中的用戶模式組件的調(diào)用封送到主機(jī)上的內(nèi)核模式驅(qū)動程序。

微軟在獨立硬件供應(yīng)商( ihv )的幫助下,開發(fā)了這項技術(shù),作為其 WDDM 圖形驅(qū)動程序模型的一個特性。 NVIDIA 圖形驅(qū)動程序從 Windows 操作系統(tǒng)的 Windows Insider 程序的早期功能預(yù)覽開始就支持 GPU -PV 。所有當(dāng)前支持的 NVIDIA GPUs 都可以暴露在運行在 Hyper-vvm 客戶機(jī)中的 Windows 操作系統(tǒng)中。

對于 WSL 2 能夠利用 GPU -PV 的能力,微軟必須在 Linux 客戶機(jī)中實現(xiàn)他們的圖形框架的基礎(chǔ):使用 GPU -PV 協(xié)議的 WDM 模型。新的微軟驅(qū)動程序支持 Linux 上的 WDDM 模型,稱為 dxgkrnl 。它也可以作為源代碼項目在 WSL2 Linux 內(nèi)核 GitHub repo 中提供。

dxgkrnl 驅(qū)動程序有望為 wddm2 。 9 版本的 wsl2 容器提供 GPU 加速支持。微軟解釋說, dxgkrnl 是一個基于 GPU -PV 協(xié)議的 LinuxGPU 驅(qū)動程序,它與同名的 Windows 驅(qū)動程序沒有任何共同之處。

目前,您可以下載 NVIDIA WDDM 2 。 9 驅(qū)動程序預(yù)覽版 。在接下來的幾個月里, NVIDIA WDDM 2 。 9 驅(qū)動程序?qū)?Windows 更新的 WIP 版本發(fā)布,這使得不必手動下載和安裝驅(qū)動程序。

GPU – 簡而言之, PV

dxgkrnl 驅(qū)動程序在 linuxguest 中將新的 / dev / dxg 設(shè)備公開給用戶模式。作為 dxcore 庫的一部分, D3DKMT 內(nèi)核服務(wù)層也被移植到 Linux 上。它使用一組私有 IOCTL 調(diào)用與 dxgkrnl 通信。

dxgkrnl 的客戶 Linux 版本使用多個 VM 總線通道連接到 Windows 主機(jī)上的 dxg 內(nèi)核。主機(jī)上的 dxg 內(nèi)核處理 Linux 進(jìn)程提交的方式與從運行在 WDDM 模型中的本機(jī) Windows 應(yīng)用程序的進(jìn)程提交相同。它將它們發(fā)送到 KMD (一個 IHV 特定的內(nèi)核模式驅(qū)動程序), KMD 準(zhǔn)備好它們并將它們提交給硬件 GPU 。圖 10 顯示了這種通信信道的簡化圖。

圖 10 。 一個簡化的圖表,顯示了在 linuxguest 中支持新圖形 dxg 設(shè)備的 Windows 主機(jī)組件。

NVIDIA 驅(qū)動程序在許多版本中都支持 Windows 10GPU -PV 和 Windows 來賓。 NVIDIA GPUs 可用于在所有使用 Microsoft 虛擬化層并使用 GPU -PV 功能添加 vGPU 的最終用戶 Windows 10 應(yīng)用程序中加速計算和圖形:

Windows 沙盒

Microsoft Defender 應(yīng)用程序保護(hù)

Microsoft HoloLens 2 模擬器

圖 11 顯示了在 NVIDIA GeForce GTX 1070 GPU 上運行 Windows 沙盒容器中的一個示例 DirectX 應(yīng)用程序。

圖 11 。 Windows 沙盒容器在 NVIDIA GeForce GTX 1070GPU 上獲得 GPU 加速度。

用戶模式支持

為了在 WSL 中啟用圖形, Windows 圖形團(tuán)隊還將一個用戶模式組件移植到 Linux : dxcore 。

dxcore 庫提供了一個 API 函數(shù)來枚舉系統(tǒng)中與 WDDM 兼容的圖形適配器。它旨在成為 Windows 和 Linux 中 DXGI 適配器枚舉的跨平臺、低級別替代品。它還抽象了對 dxgkrnl 服務(wù)( Linux 上的 IOCTLs 和 Windows 上的 GDI 調(diào)用)的訪問, D3DKMT 層 API 由 CUDA 和其他依賴 WSL 中 WDDM 模型支持的用戶模式組件使用。

根據(jù)微軟的說法, dxcore ( libdxcore 。 so )庫將在 Windows 和 Linux 上提供。 NVIDIA 計劃在驅(qū)動程序中添加對 directx12 和 CUDA api 的支持,目標(biāo)是 wddm2 。 9 模型的新 WSL 特性。兩個 API 庫都將鏈接到 dxcore ,以便它們可以指示 dxg 內(nèi)核將它們的請求封送到主機(jī)上的 KMD 。

今天就試試吧

如果您想使用您的 Windows PC 從舒適的 Linux 環(huán)境中進(jìn)行真正的 ML 和 AI 開發(fā), WSL 中對 CUDA 的支持將給您帶來一個令人興奮的機(jī)會。 WSL 是 DockerCUDA 容器被證明是數(shù)據(jù)科學(xué)家中最流行的計算環(huán)境之一。

關(guān)于作者

Raphael Boissel 領(lǐng)導(dǎo) Windows 平臺的 CUDA 工程。他擁有法國工程學(xué)院 EPITA 計算機(jī)科學(xué)碩士學(xué)位。Konstantin Morozov 是 NVIDIA 內(nèi)核模式驅(qū)動程序開發(fā)團(tuán)隊的主要開發(fā)人員,負(fù)責(zé)系統(tǒng)軟件設(shè)計、體系結(jié)構(gòu)和實現(xiàn)。他在內(nèi)核和用戶模式驅(qū)動程序以及應(yīng)用程序開發(fā)方面擁有廣泛的專業(yè)知識,對 Windows 和 Linux 平臺上的操作系統(tǒng)有很深的了解。在 NVIDIA 之前,康斯坦丁曾在 Advanced Micro Devices 和 BSquare 工作。他在莫斯科電力工程學(xué)院獲得碩士學(xué)位。

審核編輯:郭婷

-

NVIDIA

+關(guān)注

關(guān)注

14文章

5026瀏覽量

103293 -

Linux

+關(guān)注

關(guān)注

87文章

11322瀏覽量

209892 -

WINDOWS

+關(guān)注

關(guān)注

4文章

3551瀏覽量

88939

發(fā)布評論請先 登錄

相關(guān)推薦

對WSL 2的公共預(yù)覽中的CUDA的期望

對WSL 2的公共預(yù)覽中的CUDA的期望

評論