我們很高興地介紹由 DeepSpeed 和 Megatron 驅動的 Megatron 圖靈自然語言生成模型( MT-NLG ),這是迄今為止訓練過的最大和最強大的單片 transformer 語言模型,具有 5300 億個參數。這是微軟和 NVIDIA 共同努力的結果,旨在推動人工智能自然語言生成的最新發展。

作為圖靈 NLG 17B和Megatron-LM的繼承者, MT-NLG 的參數數量是該類型現有最大模型的 3 倍,并且在廣泛的自然語言任務中表現出無與倫比的準確性,例如:

完井預測

閱讀理解

常識推理

自然語言推理

詞義消歧

基于 105 層 transformer 的 MT-NLG 在零拍、一拍和少拍設置方面改進了現有的最先進模型,并為大規模語言模型在模型規模和質量方面設置了新標準。

大規模語言模型

近年來,自然語言處理( NLP )中基于 transformer 的語言模型在大規模計算、大型數據集以及用于訓練這些模型的高級算法和軟件的推動下,取得了快速的進步。

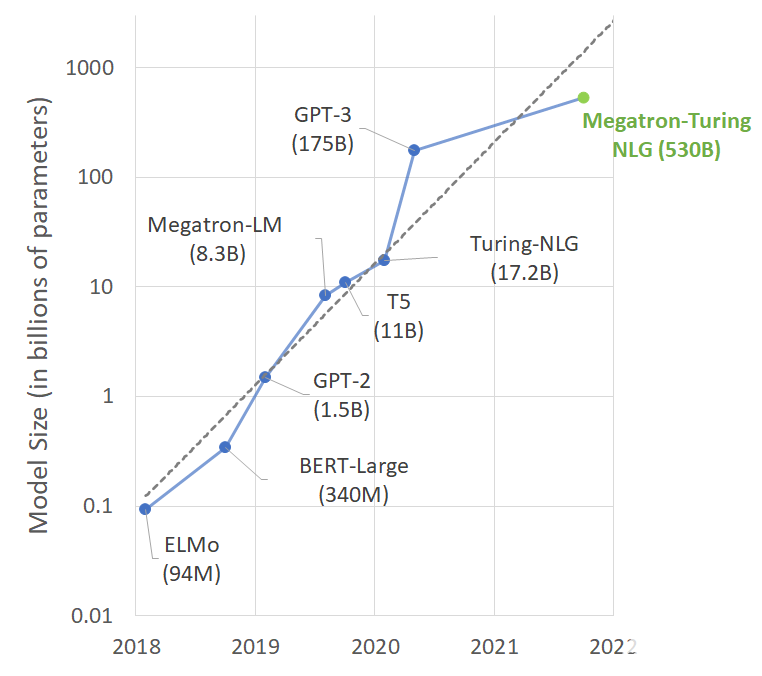

具有大量參數、更多數據和更多訓練時間的語言模型可以獲得更豐富、更細致的語言理解。因此,他們能夠很好地概括有效的零分或少分學習者,在許多 NLP 任務和數據集上具有較高的準確性。令人興奮的下游應用包括摘要、自動對話生成、翻譯、語義搜索和代碼自動完成。最先進的 NLP 模型中的參數數量以指數速度增長并不奇怪(圖 1 )。

圖 1 。最新 NLP 模型的尺寸隨時間的趨勢

然而,培訓此類模型具有挑戰性,主要原因有兩個:

即使是最大的 GPU 內存中也無法擬合這些模型的參數。

如果不特別注意優化算法、軟件和硬件堆棧,那么所需的大量計算操作可能會導致訓練時間過長。

通過沿所有 AI 軸的眾多創新和突破,訓練 MT-NLG 變得可行。例如, NVIDIA 與微軟緊密合作,通過將最先進的 GPU 加速培訓基礎設施與尖端的分布式學習軟件堆棧融合,實現了前所未有的培訓效率。我們用數千億的代幣構建了高質量的自然語言培訓語料庫,并共同開發了培訓配方,以提高優化效率和穩定性。

在這篇文章中,我們詳細闡述了培訓的各個方面,并描述了我們的方法和結果。

大規模培訓基礎設施

由 NVIDIA A100 Tensor Core GPU s 和 HDR InfiniBand 網絡提供支持,最先進的超級計算集群,如 NVIDIA Selene和 Microsoft Azure NDv4具有足夠的計算能力,可以在合理的時間范圍內訓練具有數萬億參數的模型。然而,要充分發揮這些超級計算機的潛力,就需要跨越數千 GPU 的并行性,在內存和計算上都要高效且可擴展。

孤立地說,現有的并行策略(如數據、管道或張量切片)在內存和計算效率方面存在權衡,不能用于以這種規模訓練模型。

數據并行實現了良好的計算效率,但它復制了模型狀態,無法利用聚合分布式內存。

張量切片需要 GPU 之間的大量通信,這將計算效率限制在無法使用高帶寬 NVLink 的單個節點之外。

管道并行可以跨節點高效擴展。然而,為了提高計算效率,它需要大批量、粗粒度并行和完美的負載平衡,而這在規模上是不可能的。

軟件設計

通過 NVIDIA Megatron-LM和 Microsoft DeepSpeed之間的合作,我們創建了一個高效、可擴展的 3D 并行系統,能夠將基于數據、管道和張量切片的并行性結合在一起,以應對這些挑戰。

通過結合張量切片和管道并行,我們可以在最有效的區域內操作它們。更具體地說,該系統使用 Megatron LM 的張量切片在節點內縮放模型,并使用 DeepSpeed 的管道并行性跨節點縮放模型。

例如,對于 5300 億個模型,每個模型副本跨越 280 NVIDIA A100 GPU s ,在節點內進行 8 路張量切片,在節點間進行 35 路管道并行。然后,我們使用 DeepSpeed 的數據并行性進一步擴展到數千 GPU 秒。

硬件系統

模型訓練是在基于 NVIDIA DGX SuperPOD 的Selene超級計算機上以混合精度進行的,該超級計算機由 560 臺 DGX A100 服務器供電,這些服務器與 HDR InfiniBand 以全脂樹配置聯網。每個 DGX A100 有八個 NVIDIA A100 80GB 張量核 GPU s ,通過NVLink 和 NVSwitch相互完全連接。 Microsoft 在 Azure NDv4 云超級計算機上使用了類似的參考體系結構。

系統吞吐量

我們在 Selene 上的 280 、 350 和 420 臺 DGX A100 服務器上考慮了 5300 億參數模型(批量大小為 1920 )的系統端到端吞吐量。我們觀察到迭代時間分別為 60 。 1 、 50 。 2 和 44 。 4 秒。它們分別對應于每 GPU 126 、 121 和 113 萬億次/秒。

訓練數據集和模型配置

我們使用了 transformer 解碼器的體系結構,這是一個從左到右生成的 transformer 語言模型,包含 5300 億個參數。層、隱藏維度和注意頭的數量分別為 105 、 20480 和 128 。

我們使用了 8 路張量和 35 路流水線并行。序列長度為 2048 ,全局批量大小為 1920 。在最初的 120 億個培訓代幣中,我們逐漸將批量大小增加了 32 ,從 32 開始,直到最終的批量大小達到 1920 。在我們的培訓中,我們使用了 10 億代幣來提高學習率 w ARM 。

我們在先前工作那堆的基礎上構建了我們的訓練數據集。首先,我們從一堆數據中選擇了相對質量最高的數據集子集(圖 2 中的前 11 行)。然后,按照與生成Pile-CC類似的方法,我們下載并過濾了兩個最近的通用爬網( CC )快照。

我們對 CC 數據采取的步驟包括從原始 HTML 文件中提取文本,使用經過高質量數據訓練的分類器對提取的文檔進行評分,以及根據其評分對文檔進行過濾。為了使培訓多樣化,我們還收集了RealNews和CC-Stories數據集。

在構建培訓數據集時,文檔重復數據消除是必要的,因為相同的內容可以出現在不同數據集的多個文檔中。我們在文檔級別使用模糊重復數據消除過程,使用最小哈希 LSH 計算稀疏文檔圖,并在其中連接組件以識別重復文檔。

然后,在從每個連接組件中的重復文檔中選擇代表性文檔時,我們使用基于數據集質量的優先級順序。最后,我們使用基于n -gram 的過濾從訓練數據集中刪除下游任務數據,以避免污染。

最后,我們得到了一組 15 個數據集,共包含 3390 億個令牌。在培訓期間,我們選擇根據圖 2 中給出的可變采樣權重將數據集混合到異構批次中,重點是更高質量的數據集。我們在 2700 億代幣上訓練模型。

表 1 。用于訓練 MT-NLG 模型的數據集。前 11 行來自 Pile 數據集,后面是兩個通用爬網( CC )快照、 RealNews 和 CC Stories 數據集

成果和成就

最近在語言模型( LM )方面的研究表明,一個強的預訓練模型通常可以在廣泛的 NLP 任務中進行競爭,而無需微調。

為了了解擴大 LMs 如何增強其零炮或少炮學習能力,我們評估了 MT-NLG ,并證明它在多個 NLP 任務類別中建立了新的頂級結果。為了確保評估的全面性,我們選擇了八項任務,涵蓋五個不同領域:

在文本預測任務 LAMBADA 中,模型預測給定段落的最后一個單詞。

在閱讀理解任務 RACE-h 和 BoolQ 中,該模型根據給定的段落生成問題的答案。

在常識推理任務 PiQA 、 HellaSwag 和 Winogrande 中,每個任務都需要一定程度的常識知識,而不僅僅是語言的統計模式。

對于自然語言推理,兩個硬基準 ANLI-R2 和 HANS 針對過去模型的典型故障案例。

詞義消歧任務 WiC 從上下文評估對一詞多義的理解。

為了鼓勵再現性,我們以開源項目lm-evaluation-harness為基礎進行評估設置,并根據需要進行特定于任務的更改,以使我們的設置與之前的工作更緊密地結合起來。我們在零次、一次和少量放炮設置下評估 MT-NLG ,而不搜索最佳放炮數。

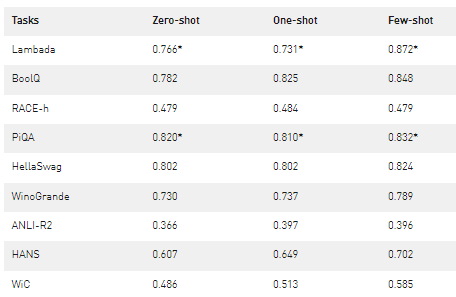

表 2 顯示了精度度量的結果。如果測試集是公開的,我們就對它進行評估;否則,我們會在開發集上報告數字。這導致在測試集上報告 LAMBADA 、 RACE-h 和 ANLI-R2 ,并在開發集上報告其他任務。

表 2 。使用 MT-NLG 進行零次、一次和少量放炮評估的準確度結果。 MT-NLG 在所有三種設置(用*表示)中建立了 PiQA-dev 集和 LAMBADA 測試集的最新結果,并在其他類別的類似單片模型中優于結果。

以少鏡頭表演為例。與之前發表的工作相比,我們發現了令人鼓舞的改進。這對于涉及比較或發現兩個句子之間關系的任務(例如, WiC 和 ANLI )尤其如此,對于以前的模型來說,這是一個具有挑戰性的任務類別。我們觀察到大多數任務在零次和一次評估中也有類似的改進。我們還應該注意到,與以前的模型相比,此模型在更少的令牌上進行訓練,這表明較大模型的學習速度更快。

對于 HANS 數據集,我們沒有發現任何報告數據集范圍度量的基線。根據漢斯紙的分析,MNLI上訓練的 BERT 基線在其一半子類別上表現接近完美,而在另一半子類別上表現接近零。這表明它們強烈地依賴于本文所確定的虛假句法啟發法。

雖然我們的模型仍在掙扎,但它預測,在零次射擊中,一半以上的情況是正確的,而當我們僅給出一次和四次射擊時,情況會進一步改善。最后,在零拍、一拍和少拍設置下,我們的模型在 PiQA 開發集和 LAMBADA 測試集上建立了最佳結果。

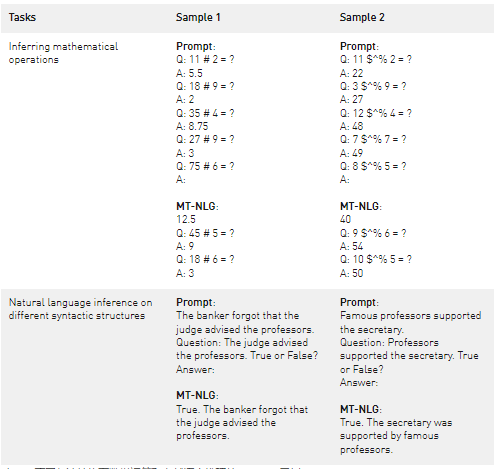

除了報告基準任務的聚合指標外,我們還定性分析了模型輸出,并得出了有趣的發現(圖 4 )。我們觀察到,該模型可以從上下文(示例 1 )推斷出基本的數學運算,即使在符號嚴重混淆的情況下(示例 2 )。雖然該模型并沒有宣稱自己是算術,但它似乎超出了算術記憶的范疇。

我們還展示了來自 HANS 任務的示例(圖 4 中的最后一行),其中我們將包含簡單語法結構的任務作為問題提出,并提示模型給出答案。盡管結構簡單,但現有的自然語言推理( NLI )模型通常很難處理此類輸入。微調模型經常從 NLI 數據集中的系統偏差中發現某些句法結構和蘊涵關系之間的虛假關聯。在這種情況下, MT-NLG 在沒有微調的情況下具有競爭力。

表 3 。不同句法結構下數學運算和自然語言推理的 MT-NLG 示例

語言模型中的偏見

盡管巨型語言模型正在推動語言生成技術的發展,但它們也面臨著偏見和毒性等問題。人工智能社區正在積極研究如何理解和消除語言模型中的這些問題,包括微軟和 NVIDIA 。

我們對 MT-NLG 的觀察是,該模型從訓練數據中提取刻板印象和偏見。微軟和 NVIDIA 致力于解決這個問題。我們鼓勵繼續研究,以幫助量化模型的偏差。

此外,在生產場景中使用 MT-NLG 必須確保采取適當措施,以減輕和減少對用戶的潛在 h ARM 。所有工作都應遵循微軟負責任的人工智能原則中的原則。這些原則強調公平、可靠性和安全性、隱私和安全性、包容性、透明度和問責制被視為開發和使用人工智能的負責任和值得信賴的方法的關鍵基石。

結論

我們生活在一個人工智能進步遠遠超過摩爾定律的時代。我們繼續看到新一代的 GPU 以閃電般的速度互聯,提供了更多的計算能力。與此同時,我們繼續看到人工智能模型的超尺度化帶來了更好的性能,似乎看不到盡頭。

將這兩種趨勢結合在一起的是軟件創新,它推動了優化和效率的界限。 MT-NLG 是超級計算機 NVIDIA Selene 或 Microsoft Azure NDv4 與 Megatron LM 和 DeepSpeed 的軟件突破一起用于訓練大型語言 AI 模型的一個例子。

我們今天所獲得的質量和結果是在開啟人工智能在自然語言中的全部承諾的過程中向前邁出的一大步。 DeepSpeed 和 Megatron LM 的創新將有利于現有和未來的人工智能模型開發,并使大型人工智能模型更便宜、訓練速度更快。

我們期待著 MT-NLG 將如何塑造未來的產品,并激勵社區進一步推動 NLP 的邊界。旅程漫長,遠未完成,但我們對可能發生的事情和未來的事情感到興奮。

關于作者

Paresh Kharya 是 NVIDIA 加速計算的產品管理和營銷高級總監。他專注于 NVIDIA 數據中心產品,包括用于 AI 和 HPC 的服務器 GPU 、 CPU 和 NVIDIA 計算軟件平臺。此前,帕雷什在高科技行業擔任過多種業務角色,包括 Adobe 的產品管理和 tech Mahindra 的業務開發。帕雷什擁有印度管理學院的工商管理碩士學位和印度國家理工學院的計算機科學學士學位。

Ali Alvi 是微軟圖靈團隊的團隊項目經理,該團隊是一個跨公司的深度學習/人工智能項目。他們正在開發和生產跨 Microsoft 產品套件( Outlook 、 Word 、 PowerPoint 、 SharePoint 、 Bing 、 Dynamics 、 Maps 等)的雄心勃勃的深度學習功能。他的重點包括非結構化和半結構化數據的 QA 、搜索相關模型、機器閱讀理解、自然語言表示、自然語言生成、通過向量空間嵌入的文檔和查詢表示、對話和對話 AI 以及多模態 AI 模型。此前,他是微軟推出第一款可穿戴設備微軟樂隊的團隊成員。他領導 Microsoft Band 和 Health 的應用程序、體驗和開發平臺。 Ali 從拉合爾管理科學大學( LUMS )獲得計算機科學學士學位,輔修數學和經濟學。阿里自 2001 年以來一直在微軟工作。

審核編輯:郭婷

-

NVIDIA

+關注

關注

14文章

4986瀏覽量

103067 -

gpu

+關注

關注

28文章

4740瀏覽量

128951 -

人工智能

+關注

關注

1791文章

47279瀏覽量

238513

發布評論請先 登錄

相關推薦

大語言模型開發語言是什么

大語言模型如何開發

如何利用大型語言模型驅動的搜索為公司創造價值

大模型LLM與ChatGPT的技術原理

大語言模型(LLM)快速理解

大語言模型:原理與工程時間+小白初識大語言模型

【大語言模型:原理與工程實踐】大語言模型的應用

【大語言模型:原理與工程實踐】大語言模型的預訓練

【大語言模型:原理與工程實踐】探索《大語言模型原理與工程實踐》2.0

【大語言模型:原理與工程實踐】大語言模型的基礎技術

【大語言模型:原理與工程實踐】揭開大語言模型的面紗

基于NVIDIA Megatron Core的MOE LLM實現和訓練優化

使用DeepSpeed和Megatron驅動MT-NLG語言模型

使用DeepSpeed和Megatron驅動MT-NLG語言模型

評論