筆者最近從Mark Reiten(SST授權部門的副總裁)處了解到該公司的SuperFlash memBrain技術,這是一種革命性的新型模擬技術,用于執行當今人工智能(AL)、機器學習(ML)和深度學習(DL)算法中的矩陣運算。

SuperFlash memBrain是一種神經形態多層次非易失性內存(non-volatile memory,簡稱NVM)解決方案,使用SST的標準SuperFlash存儲單元,為AI、ML和DL應用提供內存計算架構。SuperFlash存儲單元已在多個半導體工廠投入生產。

據維基百科介紹,“神經工程,也被稱為神經計算,是使用包含電子模擬電路的超大規模集成系統來模擬神經系統中存在的神經生物結構。神經計算機/芯片是使用物理人工神經元(由硅制成)進行計算的設備。”

眾所周知,人類大腦是由神經元細胞形成的,神經元通過突觸相互交流。一個典型的閃存單元基于一個浮動柵晶體管,可以用來表示數字0或1;相比之下,一個SuperFlash memBrain記憶體可以用來表示256個不同的值,用于代表人工神經網絡(artificial neural network ,簡稱ANN)中與“突觸”相關的“權重”。

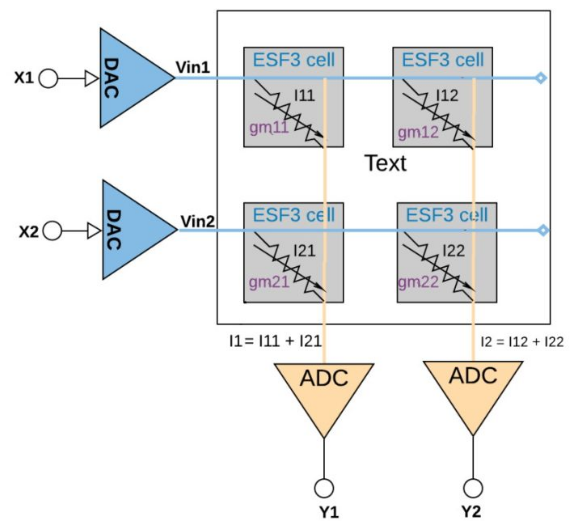

AI / ML / DL應用使用了大量的矩陣乘法運算,這些運算本身使用了乘積(MAC)運算。考慮一個2×2數組的簡單例子,包含四個基本單元:

我們可以把SuperFlash memBrain記憶體想象成一個可編程的電阻。根據歐姆定律,V = IR,所以I(流過電池的電流)= V/R。電阻(R)的倒數是電導(G);即G = 1/R。這意味著I = V * G(乘法運算)。此外,同一列中每個單元的電流是累加的(加法運算)。因此,每個記憶體可以被認為是執行突觸的功能,每一列可以被認為是執行神經元的功能。

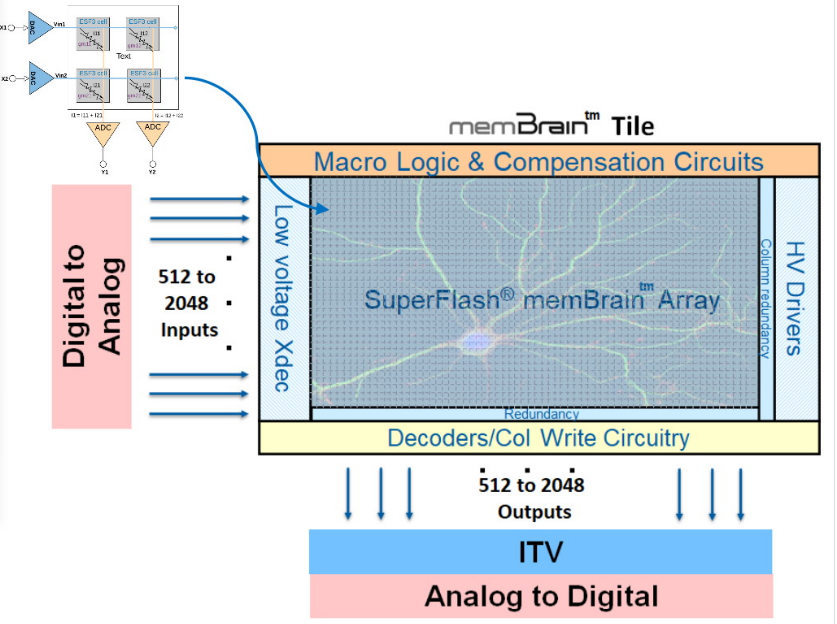

該層次結構再往上一層是memBrain塊,它是包含上述記憶體的一大數組,并對輸入和輸出進行適當信號調節。

與標準的數字嵌入式Flash存儲器相比,該陣列的輸入和輸出范圍要寬得多。權重首先作為電導值存儲在memBrain數組中,當被灌入輸入電壓時,SuperFlash memBrain單元既存儲權重,同時執行乘法操作,產生的電流相累加,數百萬個MAC操作可以同時執行。需要注意的關鍵點是,其性能和功耗比優化的數字解決方案要好幾個數量級。

SST的這一技術令人振奮的原因在于,SoC設備可以在設計中以IP形式使用SuperFlash memBrain。根據Microchip今年早些時候發布的新聞稿,一家名為WITINMEM的公司已經將SuperFlash memBrain技術整合到超低功耗的SoC中,充分利用這種內存計算技術進行神經網絡處理,包括語音識別、聲紋識別、深度語音降噪、場景檢測和健康狀態監測等。

審核編輯 :李倩

-

晶體管

+關注

關注

77文章

9744瀏覽量

138775 -

模擬技術

+關注

關注

17文章

469瀏覽量

39803 -

AI

+關注

關注

87文章

31493瀏覽量

270052

原文標題:用Flash做AI計算有存算一體IP了!

文章出處:【微信號:SSDFans,微信公眾號:SSDFans】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

Profinet轉DeviceNet網關在恒壓供水中的革命性應用

安寶特案例 | AR技術在院外心臟驟停急救中的革命性應用

PC示波器:電子測試與測量的革命性工具

顛覆!硅光“黑馬”打造革命性光學IO技術,可取代芯片內銅線

全新雷達水位流速儀,讓河流管理更智能,革命性水文監測

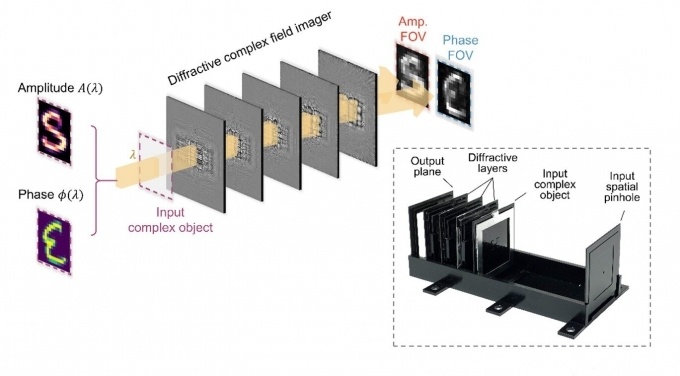

一種新型全光學復合場成像儀

日本推出革命性的人形機器人

蘋果新專利,Apple Pencil將迎來革命性升級

TPM遇上機器人:智能工廠的革命性升級

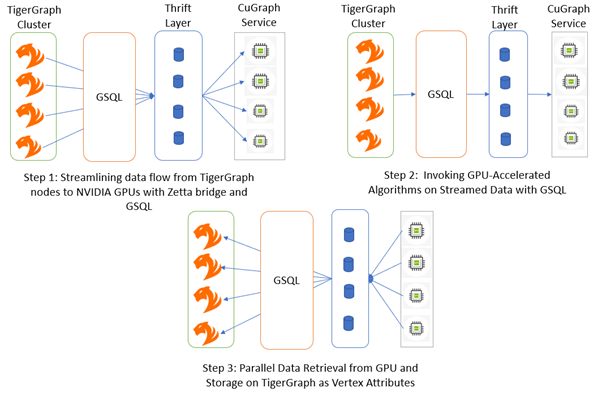

革命性的圖形分析: NVIDIA cuGraph 加速的下一代架構

長電科技推出了一項革命性的高精度熱阻測試與仿真模擬驗證技術

無縫拼接,震撼視聽:大屏拼接器的革命性技術解析

利用太赫茲超構表面開發一款革命性的生物傳感器

一種革命性的新型模擬技術

一種革命性的新型模擬技術

評論