來自羅徹斯特大學和 Adobe Research 的研究者提出了一種新的生成網絡 CM-GAN,很好地合成了整體結構和局部細節,在定量和定性評估方面都顯著優于現有 SOTA 方法,如 CoModGAN 和 LaMa。

圖像修復是指對圖像缺失區域進行補全,是計算機視覺的基本任務之一。該方向有許多實際應用,例如物體移除、圖像重定向、圖像合成等。

早期的修復方法基于圖像塊合成或顏色擴散來填充圖像缺失部分。為了完成更復雜的圖像結構,研究人員開始轉向數據驅動的方案,他們利用深度生成網絡來預測視覺內容和外觀。通過在大量圖像上進行訓練,并借助重建和對抗損失,生成式修復模型已被證明可以在包括自然圖像和人臉在內的各種類型輸入數據上產生更具視覺吸引力的結果。

然而,現有工作只能在完成簡單的圖像結構方面顯示出良好的結果,生成整體結構復雜和細節高保真的圖像內容仍然是一個巨大的挑戰,特別是當圖像空洞(hole)很大的時候。

從本質上講,圖像修復面臨兩個關鍵問題:一個是如何將全局上下文準確地傳播到不完整區域,另一個是合成與全局線索一致的真實局部細節。為了解決全局上下文傳播問題,現有網絡利用編碼器 - 解碼器結構、空洞卷積、上下文注意力或傅里葉卷積來整合長程特征依賴,擴大有效感受野。此外,兩階段方法和迭代空洞填充依靠預測粗略結果來增強全局結構。然而,這些模型缺乏一種機制來捕獲未掩碼區域的高級語義,并有效地將它們傳播到空洞中以合成一個整體的全局結構。

基于此,來自羅徹斯特大學和 Adobe Research 的研究者提出了一種新的生成網絡:CM-GAN(cascaded modulation GAN),該網絡可以更好地合成整體結構和局部細節。CM-GAN 中包括一個帶有傅里葉卷積塊的編碼器,用于從帶有空洞的輸入圖像中提取多尺度特征表征。CM-GAN 中還有一個雙流解碼器,該解碼器在每個尺度層都設置一個新型級聯的全局空間調制塊。

在每個解碼器塊中,研究者首先應用全局調制來執行粗略和語義感知的結構合成,然后進行空間調制來進一步以空間自適應方式調整特征圖。此外,該研究設計了一種物體感知訓練方案,以防止空洞內產生偽影,從而滿足現實場景中物體移除任務的需求。該研究進行了廣泛的實驗表明,CM-GAN 在定量和定性評估方面都顯著優于現有方法。

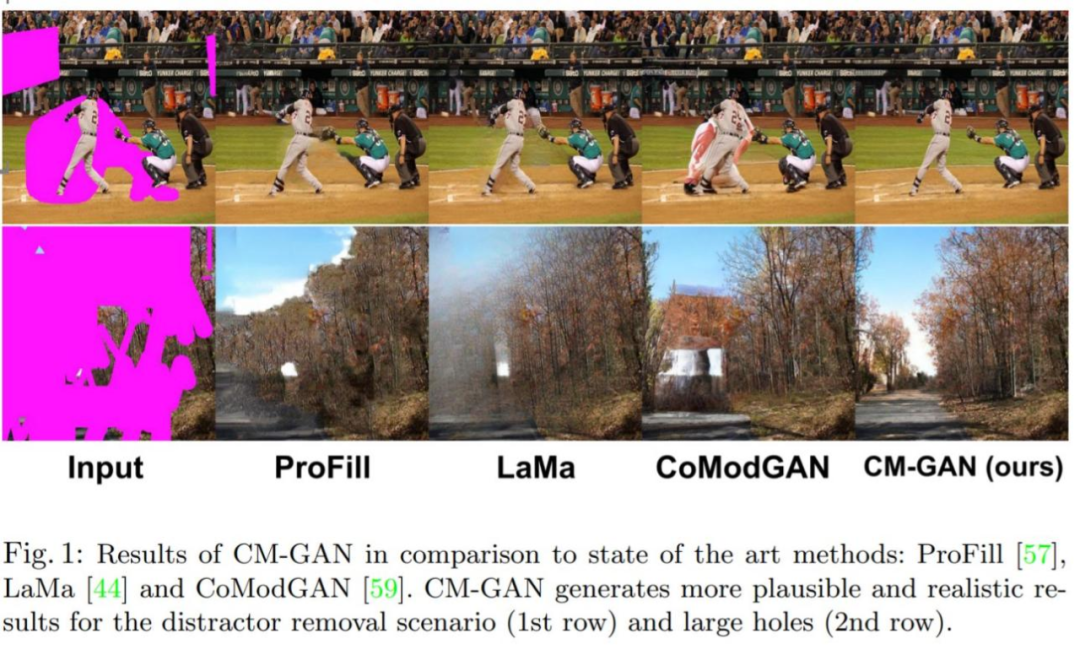

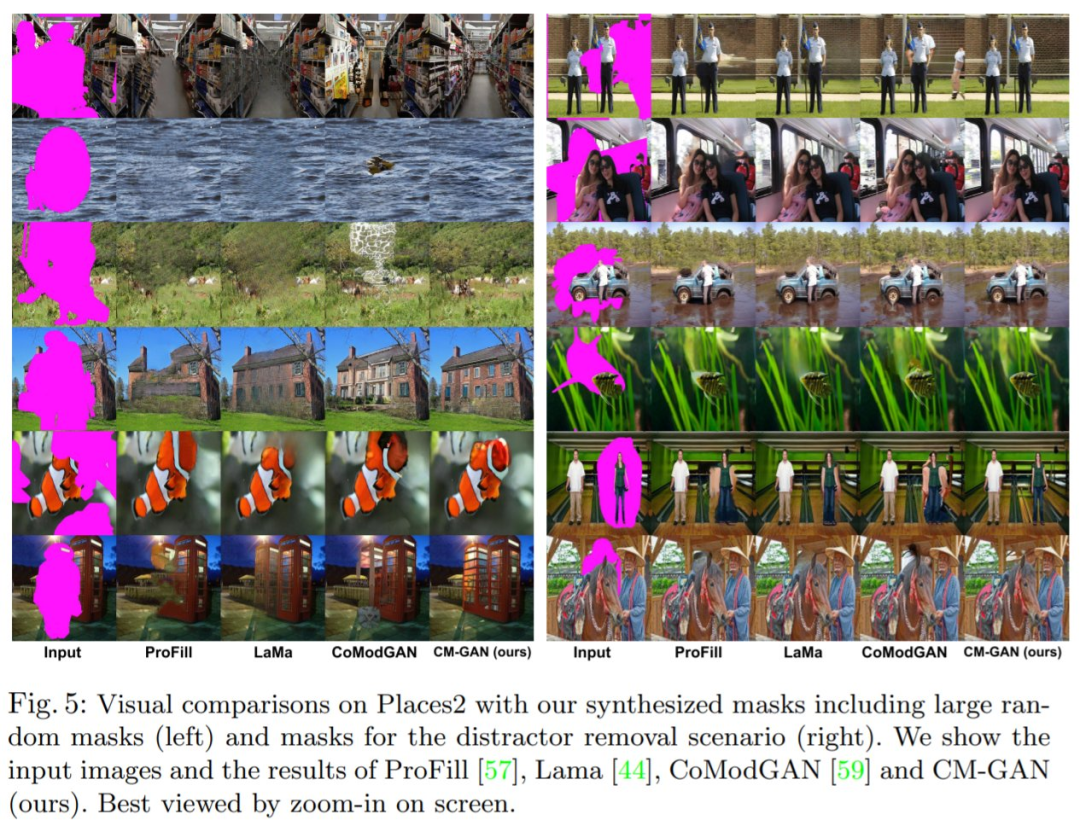

我們先來看下圖像修復效果,與其他方法相比,CM-GAN 可以重建更好的紋理:

CM-GAN 可以合成更好的全局結構:

CM-GAN 具有更好的物體邊界:

下面我們來看下該研究的方法和實驗結果。

方法

級聯調制 GAN

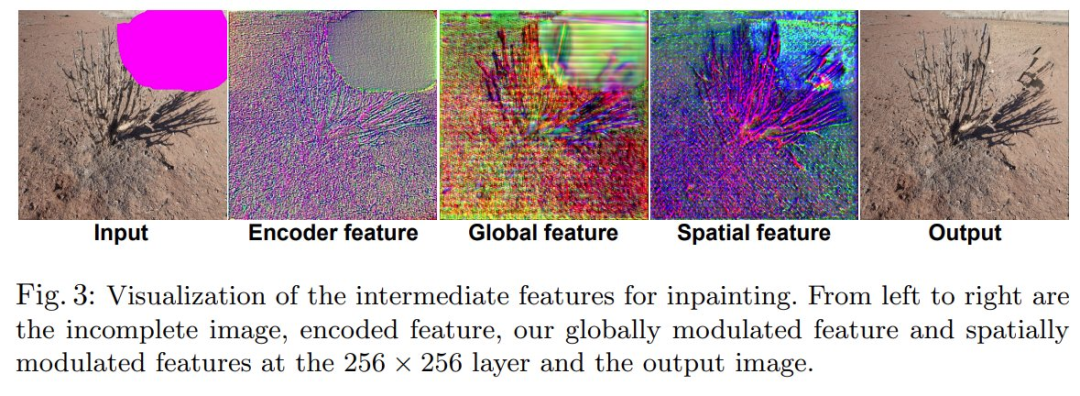

為了更好地建模圖像補全的全局上下文,該研究提出一種將全局碼調制與空間碼調制級聯的新機制。該機制有助于處理部分無效的特征,同時更好地將全局上下文注入空間域內。新架構 CM-GAN 可以很好地綜合整體結構和局部細節,如下圖 1 所示。

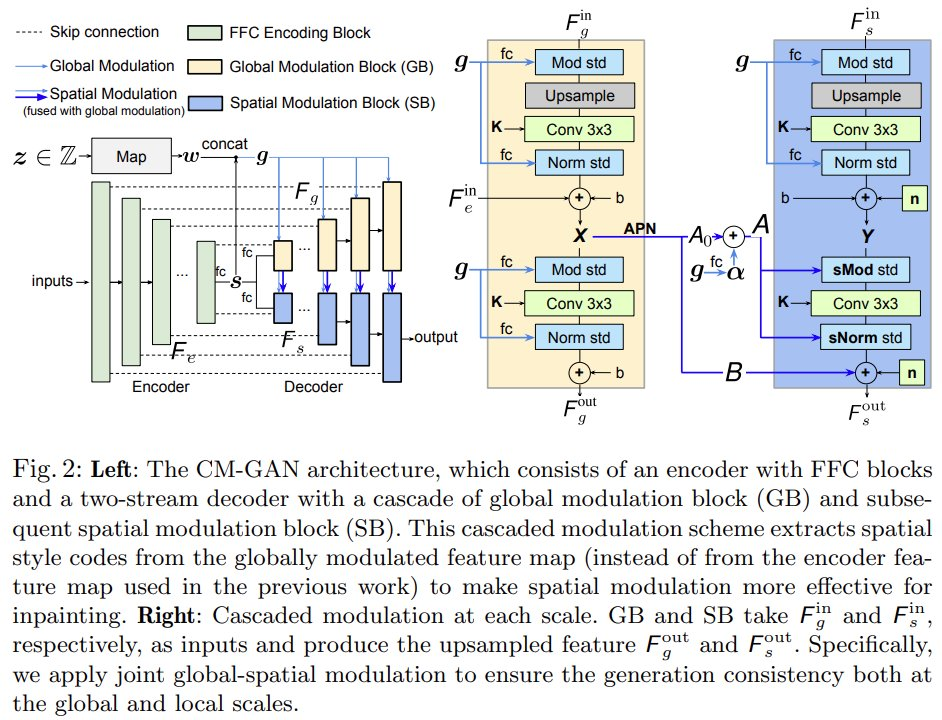

如下圖 2(左) 所示,CM-GAN 基于一個編碼器分支和兩個并行級聯解碼器分支來生成視覺輸出。編碼器以部分圖像和掩碼為輸入,生成多尺度特征圖 。

。

與大多數編碼器 - 解碼器方法不同,為了完成整體結構,該研究從全連接層的最高級別特征 中提取全局樣式代碼 s,然后進行

中提取全局樣式代碼 s,然后進行 歸一化。此外,基于 MLP 的映射網絡從噪聲中生成樣式代碼 w,以模擬圖像生成的隨機性。代碼 w 與 s 結合產生一個全局代碼 g = [s; w],用于之后的解碼步驟。

歸一化。此外,基于 MLP 的映射網絡從噪聲中生成樣式代碼 w,以模擬圖像生成的隨機性。代碼 w 與 s 結合產生一個全局代碼 g = [s; w],用于之后的解碼步驟。

全局空間級聯調制。為了在解碼階段更好地連接全局上下文,該研究提出了全局空間級聯調制 (CM,cascaded modulation)。如圖 2(右)所示,解碼階段基于全局調制塊(GB)和空間調制塊(SB)兩個分支,并行上采樣全局特征 F_g 和局部特征 F_s。

與現有方法不同,CM-GAN 引入了一種將全局上下文注入空洞區域的新方法。在概念層面上,它由每個尺度的特征之間的級聯全局和空間調制組成,并且自然地集成了全局上下文建模的三種補償機制:1)特征上采樣;2) 全局調制;3)空間調制。

物體感知訓練

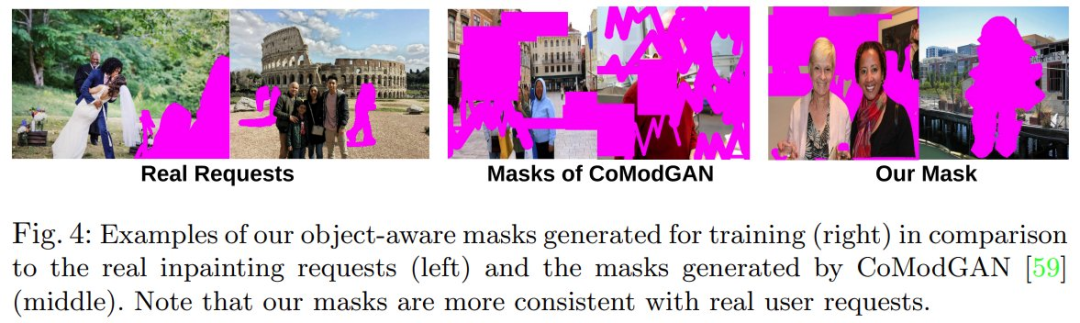

為訓練生成掩碼的算法至關重要。本質上,采樣的掩碼應該類似于在實際用例中繪制的掩碼,并且掩碼應避免覆蓋整個物體或任何新物體的大部分。過度簡化的掩碼方案可能會導致偽影。

為了更好地支持真實的物體移除用例,同時防止模型在空洞內合成新物體,該研究提出了一種物體感知訓練方案,在訓練期間生成了更真實的掩碼,如下圖 4 所示。

具體來說,該研究首先將訓練圖像傳遞給 全景分割網絡 PanopticFCN 以生成高度準確的實例級分割注釋,然后對自由空洞和物體空洞的混合進行采樣作為初始掩碼,最后計算空洞和圖像中每個實例之間的重疊率。如果重疊率大于閾值,該方法將前景實例從空洞中排除;否則,空洞不變并模擬物體完成,其中閾值設為 0.5。該研究隨機擴展和平移物體掩碼以避免過度擬合。此外,該研究還擴大了實例分割邊界上的空洞,以避免將空洞附近的背景像素泄漏到修復區域中。

訓練目標與 Masked-R_1 正則化

該模型結合對抗性損失和基于分割的感知損失進行訓練。實驗表明,該方法在純粹使用對抗性損失時也能取得很好的效果,但加入感知損失可以進一步提高性能。

此外,該研究還提出了一種專門用于穩定修復任務的對抗性訓練的 masked-R_1 正則化,其中利用掩碼 m 來避免計算掩碼外的梯度懲罰。

實驗

該研究在 Places2 數據集上以 512 × 512 分辨率進行了圖像修復實驗,并給出了模型的定量和定性評估結果。

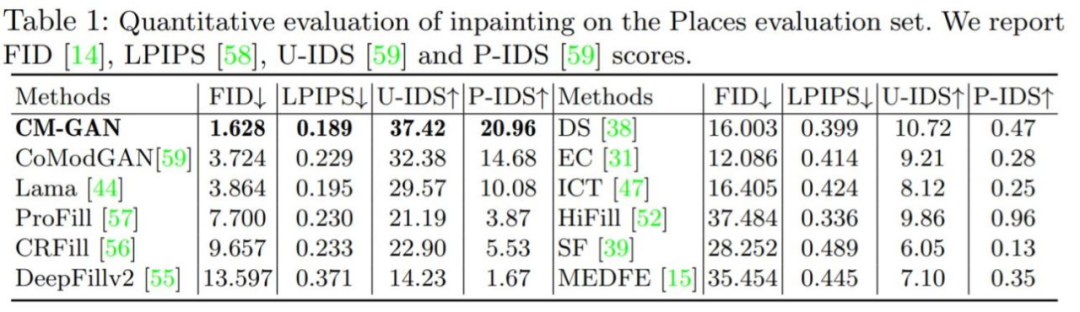

定量評估:下表 1 為 CM-GAN 與其他掩碼方法的比較。結果表明,CM-GAN 在 FID、LPIPS、U-IDS 和 P-IDS 方面明顯優于其他方法。在感知損失的幫助下,LaMa、CM-GAN 比 CoModGAN 和其他方法獲得了明顯更好的 LPIPS 分數,這歸功于預訓練感知模型提供的額外語義指導。與 LaMa/CoModGAN 相比,CM-GAN 將 FID 從 3.864/3.724 降低到 1.628。

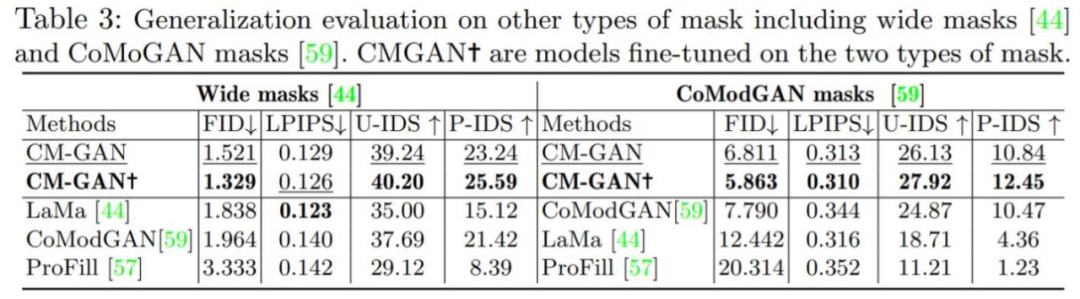

如下表 3 所示,在有無微調的情況下,CM-GAN 在 LaMa 和 CoModGAN 掩碼上都取得了明顯優于 LaMa 和 CoModGAN 的性能增益,表明該模型具有泛化能力。值得注意的是,在 CoModGAN 掩碼,物體感知掩碼上訓練的 CM-GAN 性能依然優于 CoModGAN 掩碼,證實了 CM-GAN 具有更好的生成能力。

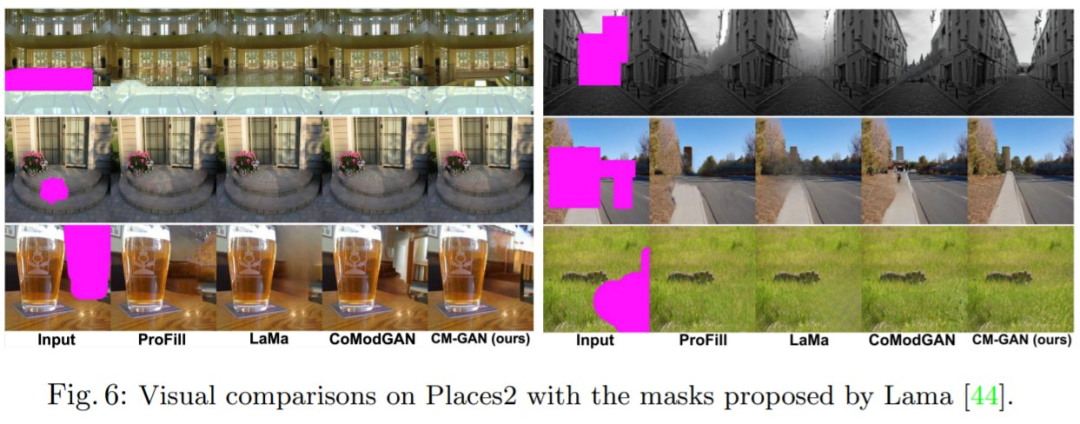

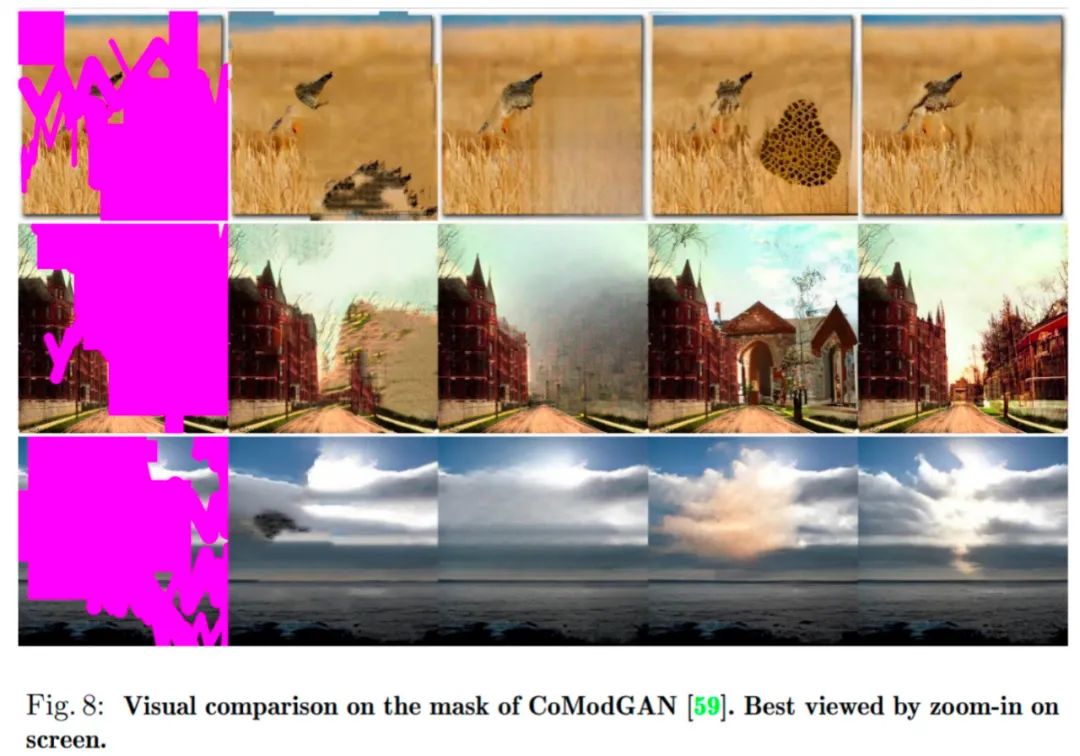

定性評估:圖 5、圖 6、圖 8 展示了 CM-GAN 與 SOTA 方法在合成掩碼方面的可視化比較結果。ProFill 能夠生成不連貫的全局結構,CoModGAN 產生結構偽影和顏色斑點,LaMa 在自然場景上容易產生較大的圖像模糊。相比之下,CM-GAN 方法產生了更連貫的語義結構、紋理更清晰,可適用于不同場景。

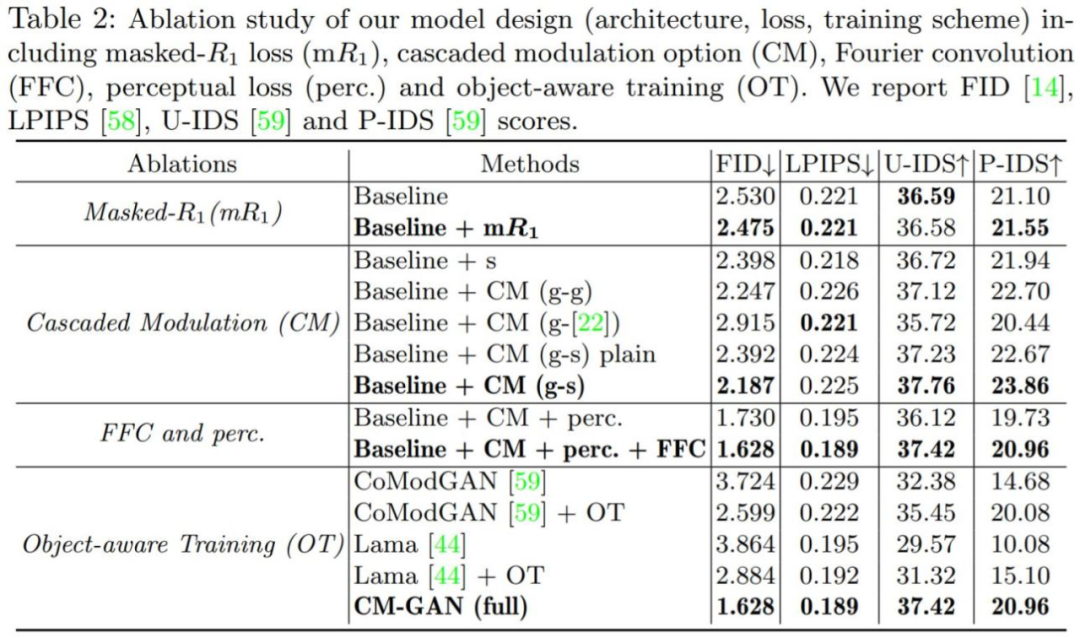

為了驗證模型中每個組件的重要性,該研究進行了一組消融實驗,所有模型都在 Places2 數據集上進行訓練和評估。消融實驗結果如下表 2 和圖 7 所示。

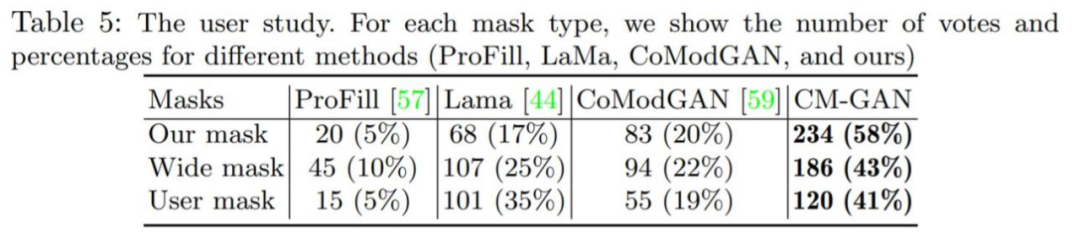

該研究還進行了用戶研究,以更好地評估 CM-GAN 方法的視覺生成質量,結果如下表 5 所示。此外,附錄提供了更多的視覺比較和實驗分析以供讀者參閱。

-

數據驅動

+關注

關注

0文章

128瀏覽量

12364 -

計算機視覺

+關注

關注

8文章

1699瀏覽量

46052 -

圖像修復

+關注

關注

0文章

11瀏覽量

2274

原文標題:圖像大面積缺失,也能逼真修復,新模型CM-GAN兼顧全局結構和紋理細節

文章出處:【微信號:CVSCHOOL,微信公眾號:OpenCV學堂】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

使用TVP7002現在遇到兩個問題求解答

鋰電池品牌廠家影響光伏逆變器效率提升的兩個關鍵因素

圖像修復面臨兩個關鍵問題

圖像修復面臨兩個關鍵問題

評論