摘要:計算成像是融合光學硬件、圖像傳感器、算法軟件于一體的新一代成像技術,它突破了傳統成像技術信息獲取深度(高動態范圍、低照度)、廣度(光譜、光場、三維)的瓶頸。本文以計算成像的新設計方法、新算法和應用場景為主線,通過綜合國內外文獻和相關報道來梳理該領域的主要進展。從端到端光學算法聯合設計、高動態范圍成像、光場成像、光譜成像、無透鏡成像、低照度成像、三維成像、計算攝影等研究方向,重點論述計算成像領域的發展現狀、前沿動態、熱點問題和趨勢。端到端光學算法聯合設計包括了可微的衍射光學模型,折射光學模型以及基于可微光線追蹤的復雜透鏡的模型。高動態范圍光學成像從原理到光學調制,多次曝光,多傳感器融合以及算法等層面闡述不同方法的優點與缺點以及產業應用。光場成像闡述了基于光場的三維重建技術在超分辨、深度估計和三維尺寸測量等方面國內外的研究進展和產業應用,以及光場在粒子測速及三維火焰重構領域的研究進展。光譜成像闡述了當前多通道濾光片,基于深度學習和波長響應曲線求逆問題,以及衍射光柵,多路復用,超表面等優化實現高光譜的獲取。無透鏡成像包括平面光學元件的設計和優化,以及圖像的高質量重建算法。低照度成像包括低照度情況下基于單幀、多幀、閃光燈、新型傳感器的圖像噪聲去除等。三維成像主要包括針對基于主動方法的深度獲取的困難的最新的解決方案,這些困難包括強的環境光干擾(比如太陽光),強的非直接光干擾(比如凹面的互反射,霧天的散射)等。計算攝影學是計算成像的一個分支學科,它從傳統攝影學發展而來,更側重于使用數字計算的方式進行圖像拍攝。在光學鏡片的物理尺寸、圖像質量受限的情況下,如何使用合理的計算資源,繪制出用戶最滿意的圖像是其主要研究和應用方向。

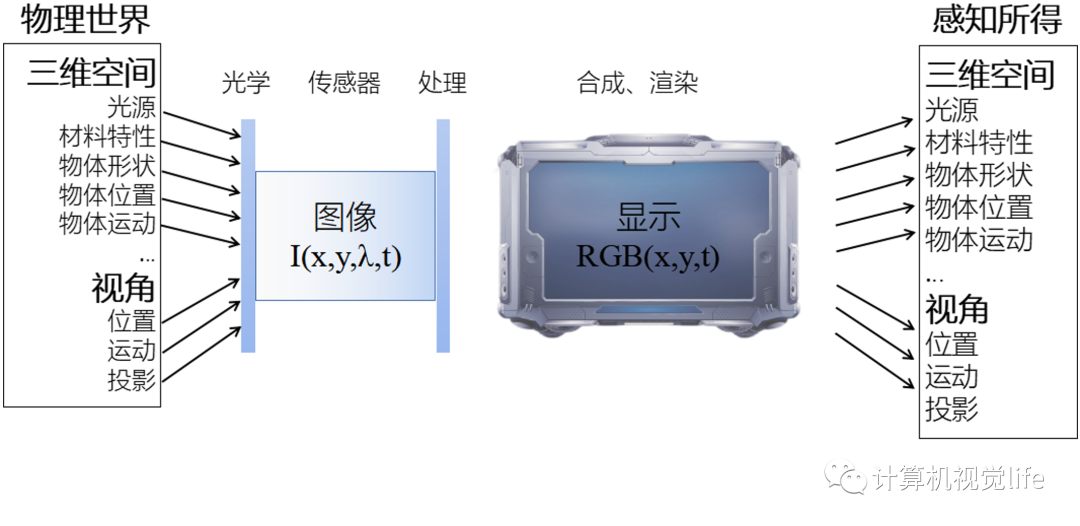

物理空間中,有著多種維度的信息,例如光源光譜,反射光譜、偏振態、三維形態、光線角度,材料性質等。而成像系統所最終成得的像最終決定于,光源光譜,光源位置,物體表面材料光學性質如雙向投射/散射/反射分布函數,物體三維形態等。然而,傳統的光學成像依賴于以經驗驅動的光學設計,旨在優化點擴散函數(Point Spread Function, PSF),調制傳遞函數(MTF)等指標,目的是使得在探測器上獲得更清晰的圖像,更真實的色彩。通常“所見即所得”,多維信息感知能力不足。隨著光學、新型光電器件、算法和計算資源的發展,可將它們融為一體的計算成像技術逐步解放了人們對物理空間中多維度信息感知的能力,與此同時,隨著顯示技術的發展,特別是3D甚至6D電影,虛擬現實/增強現實(VR/AR)技術的發展,給多維度信息也提供了展示平臺。以目前對物理尺度限制嚴格的手機為例,使用從目前的趨勢看,手機廠商正跟學術界緊密結合。算法層面如高動態范圍成像、低照度增強、色彩優化、去馬賽克、噪聲去除甚至是重打光逐步應用于手機中,除去傳統的圖像處理流程,神經網絡邊緣計算在手機中日益成熟。光學層面如通過非球面乃至自由曲面透鏡優化像差,通過優化拜爾(Bayer)濾光片平衡進光量和色彩。

本文圍繞端到端光學算法聯合設計、高動態范圍成像、光場成像、光譜成像、無透鏡成像、偏振成像、低照度成像、主動三維成像、計算攝影等具體實例全面闡述當前計算成像發展現狀、前沿動態,熱點問題、發展趨勢和應用指導。任務框架如圖1所示。

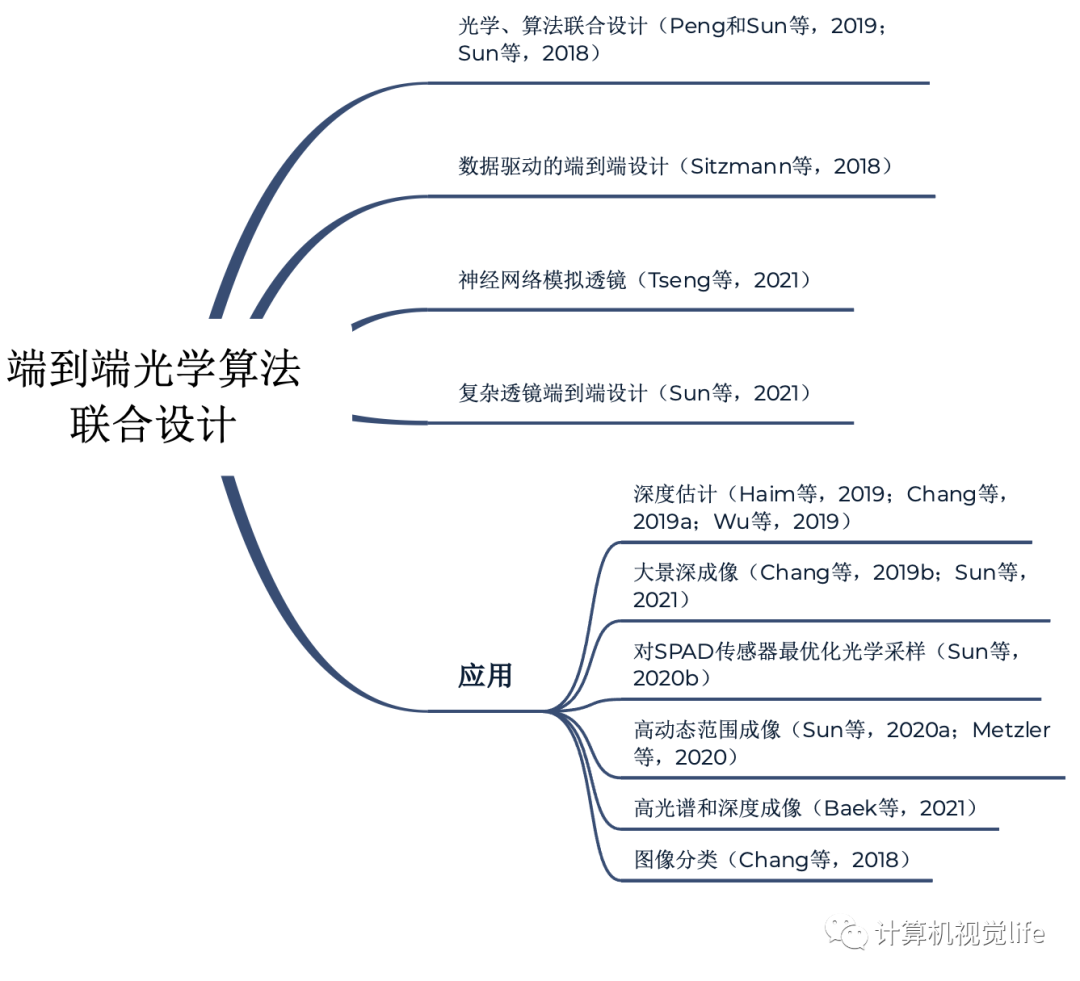

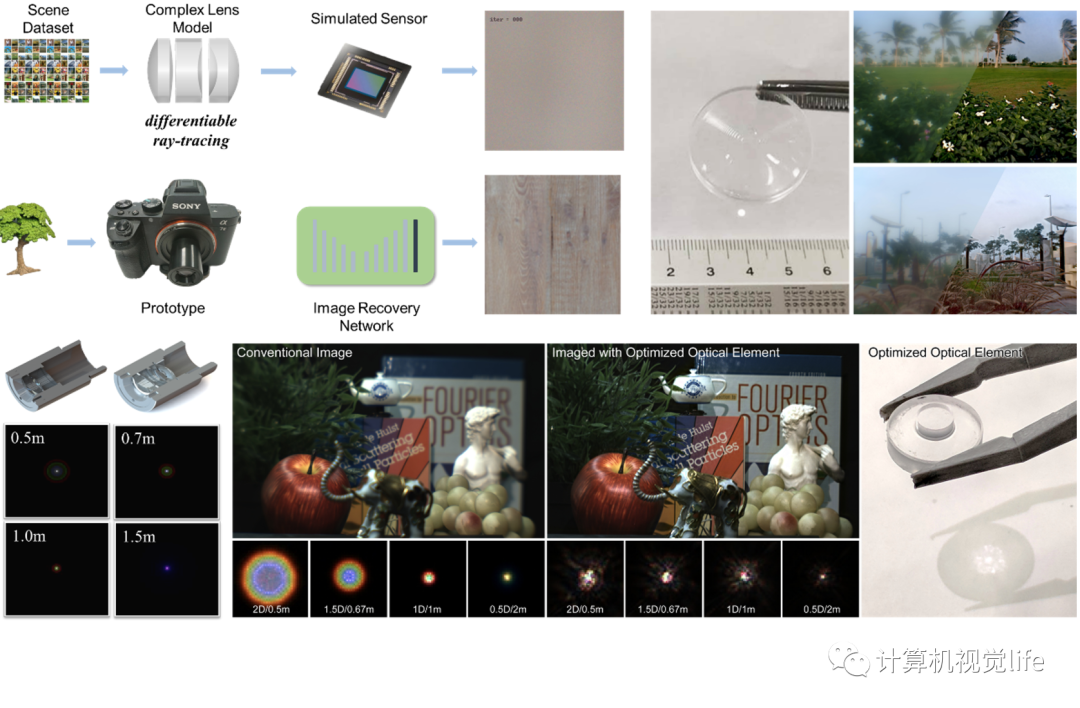

端到端光學算法聯合設計(end-to-end camera design)是近年來新興起的熱點分支,對一個成像系統而言,通過突破光學設計和圖像后處理之間的壁壘,找到光學和算法部分在硬件成本、加工可行性、體積重量、成像質量、算法復雜度以及特殊功能間的最佳折中,從而實現在設計要求下的最優方案。端到端光學算法聯合設計的突破為手機廠商、工業、車載、空天探測、國防等領域提供了簡單化的全新解決方案,在降低光學設計對人員經驗依賴的同時,將圖像后處理同時自動優化,為相機的設計提供了更多的自由度,也將輕量化、特殊功能等計算攝影問題提供了全新的解決思路。其技術路線如圖2所示。

圖2端到端光學算法聯合設計技術路線

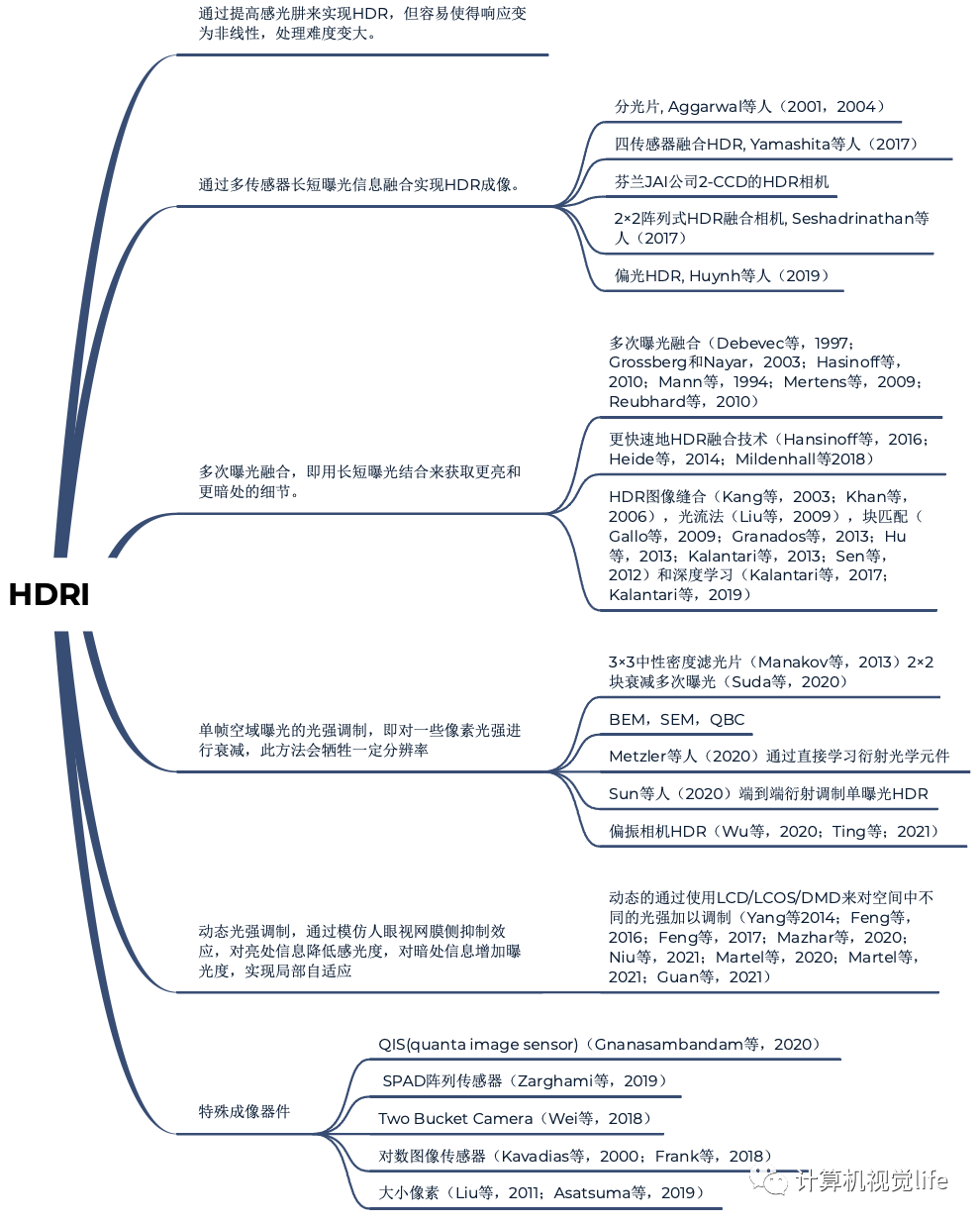

高動態范圍成像(high dynamic range imaging,HDR)在計算圖形學與攝影中,是用來實現比普通數位圖像技術更大曝光動態范圍(最亮和最暗細節的比率)的技術。攝影中,通常用曝光值(Exposure Value,EV)的差來描述動態范圍,1EV對應于兩倍的曝光比例并通常被稱為一檔(1 stops)。自然場景最大動態范圍約22檔,城市夜景可達約40檔,人眼可以捕捉約10~14檔的動態范圍。高動態范圍成像一般指動態范圍大于13檔或8000:1(78dB),主要包括獲取、處理、存儲、顯示等環節。高動態范圍成像旨在獲取更亮和更暗處細節,從而帶來更豐富的信息,更震撼的視覺沖擊力。高動態范圍成像不僅是目前手機相機核心競爭力之一,也是工業、車載相機的基本要求。其技術路線如圖3所示。

圖3高動態范圍成像技術路線

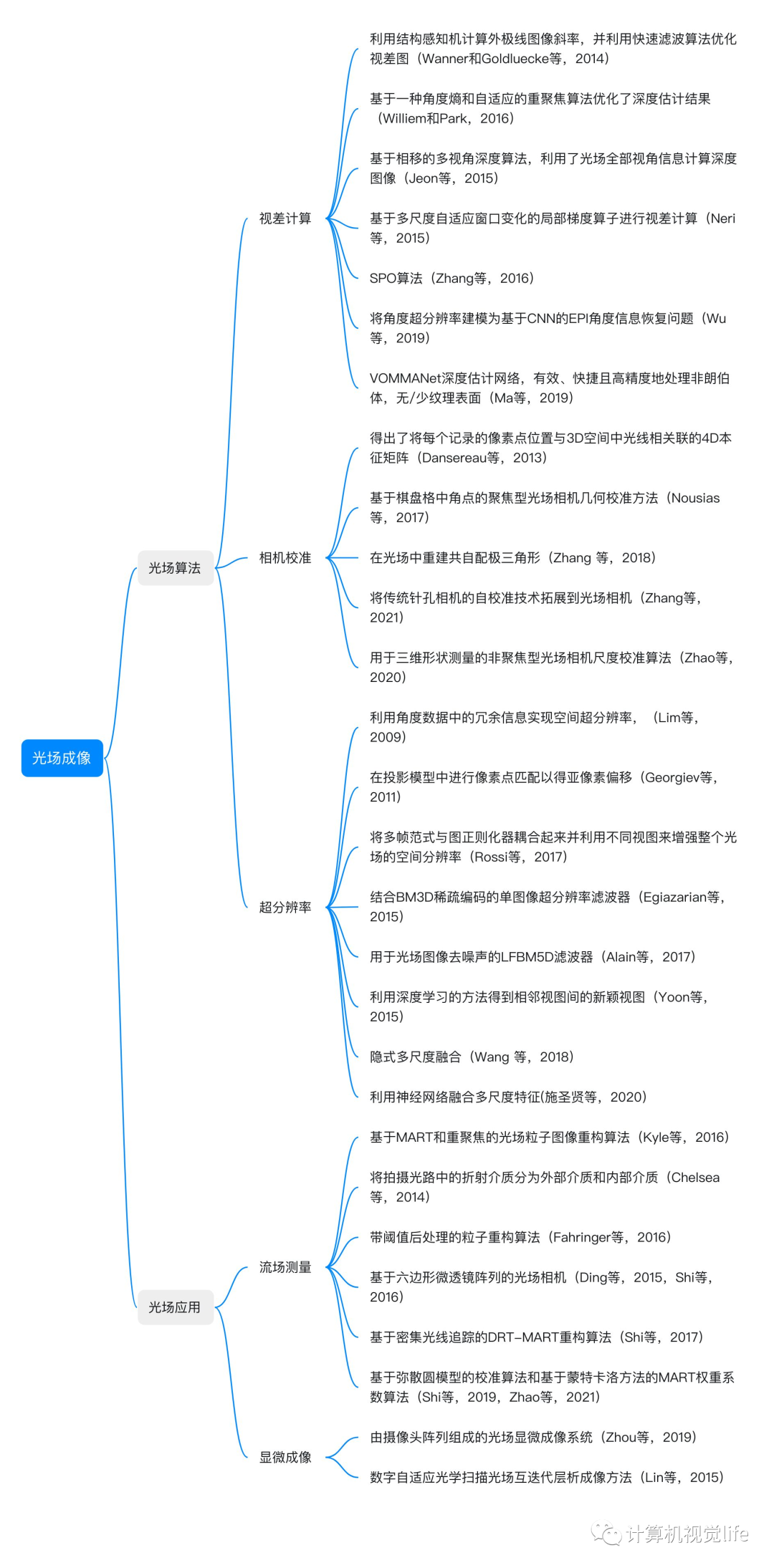

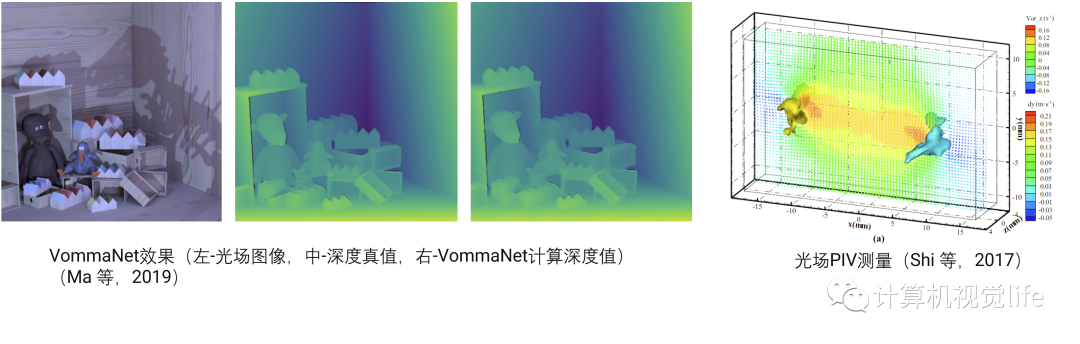

光場成像(light field imaging,LFI)能夠同時記錄光線的空間位置和角度信息,是三維測量的一種新方法。經過近些年的發展,逐漸成為一種新興的非接觸式測量技術,自從攝影被發明以來,圖像捕捉就涉及在場景的二維投影中獲取信息。然而,光場不僅提供二維投影,還增加了另一個維度,即到達該投影的光線的角度。光場擁有關于光陣列方向和場景二維投影的信息,并且可以實現不同的功能。例如,可以將投影移動到不同的焦距,這使用戶能夠在采集后自由地重新聚焦圖像。此外,還可以更改捕獲場景的視角。目前已逐漸應用于工業、虛擬現實、生命科學和三維流動測試等領域,幫助快速獲得真實的光場信息和復雜三維空間信息。其技術路線如圖4所示。

圖4光場成像技術路線

圖中所列參考文獻(向上滑動即可查看全部)

·光場算法[1]Levoy M, Zhang Z, McDowall I.Recording and controlling the 4D light field in a microscope using microlens arrays[J].//Journal of microscopy, 2009, 235(2): 144-162.[2]Cheng Z, Xiong Z, Chen C, et al. Light Field Super-Resolution: A Benchmark[C] //Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition Workshops. 2019.[3]Lim J G, Ok H W, Park B K, et al. Improving the spatail resolution based on 4D light field data[C]//2009 16th IEEE International Conference on Image Processing (ICIP). IEEE, 2009: 1173-1176.[4]Georgiev T, Chunev G, Lumsdaine A.Superresolution with the focused plenoptic camera[C] //Computational Imaging IX.International Society for Optics and Photonics, 2011, 7873: 78730X.[5]Alain M, Smolic A.Light field super-resolution via LFBM5D sparse coding[C]//2018 25th IEEE international conference on image processing (ICIP).IEEE, 2018: 2501-2505.[6]Rossi M, Frossard P.Graph-based light field super-resolution[C]//2017 IEEE 19th International Workshop on Multimedia Signal Processing (MMSP).IEEE, 2017: 1-6.[7]Yoon Y, Jeon H G, Yoo D, et al. Learning a deep convolutional network for light-field image super-resolution[C]//Proceedings of the IEEE international conference on computer vision workshops. 2015: 24-32.[8]Goldluecke B.Globally consistent depth labeling of 4D light fields[C]// Computer Vision and Pattern Recognition.IEEE, 2012:41-48.[9]Wanner S, Goldluecke B.Variational Light Field Analysis for Disparity Estimation and Super-Resolution[J].//IEEE Transactions on Pattern Analysis & Machine Intelligence, 2014, 36(3):606-619.[10]Tao M W, Hadap S, Malik J, et al. Depth from Combining Defocus and Correspondence Using Light-Field Cameras[C] // IEEE International Conference on Computer Vision. IEEE, 2013:673-680.[11]Jeon H G, Park J, Choe G, et al. Accurate depth map estimation from a lenslet light field camera[C] // Computer Vision and Pattern Recognition. IEEE, 2015:1547-1555.[12]Neri A, Carli M, Battisti F.A multi-resolution approach to depth field estimation in dense image arrays[C] //IEEE International Conference on Image Processing.IEEE, 2015:3358-3362.[13]Strecke M, Alperovich A, Goldluecke B. Accurate Depth and Normal Maps from Occlusion-Aware Focal Stack Symmetry[C] //Computer Vision and Pattern Recognition. IEEE, 2017:2529-2537.[14]Dansereau D G, Pizarro O, Williams S B. Decoding, calibration and rectification for lenselet-based plenoptic cameras[C] //Proceedings of the IEEE conference on computer vision and pattern recognition. 2013: 1027-1034.[15]Nousias S, Chadebecq F, Pichat J, et al. Corner-based geometric calibration of multi-focus plenoptic cameras[C] //Proceedings of the IEEE International Conference on Computer Vision. 2017: 957-965.[16]Zhu H, Wang Q.Accurate disparity estimation in light field using ground control points[J].//Computational Visual Media, 2016, 2(2):1-9.[17]Zhang, S., Sheng, H., Li, C., Zhang, J.and Xiong, Z., 2016.Robust depth estimation for light field via spinning parallelogram operator.//Computer Vision and Image Understanding, 145, pp.148-159.[18]Zhang Y, Lv H, Liu Y, Wang H, Wang X, Huang Q, Xiang X, Dai Q.Light-field depth estimation via epipolar plane image analysis and locally linear embedding.IEEE Transactions on Circuits and Systems for Video Technology[J].2016, 27(4):739-47.[19]Ma H , Qian Z , Mu T , et al.Fast and Accurate 3D Measurement Based on Light-Field Camera and Deep Learning[J].//Sensors, 2019, 19(20):4399.·光場應用[1]Lin X, Wu J, Zheng G, Dai Q. 2015. Camera array based light field microscopy. Biomedical Optics Express, 6(9): 3179-89[2]Shi, S., Ding, J., New, T.H.and Soria, J., 2017.Light-field camera-based 3D volumetric particle image velocimetry with dense ray tracing reconstruction technique.//Experiments in Fluids, 58(7), pp.1-16.[3]Shi, S., Wang, J., Ding, J., Zhao, Z.and New, T.H., 2016.Parametric study on light field volumetric particle image velocimetry.Flow Measurement and Instrumentation, 49, pp.70-88.[4]Shi, S., Ding, J., Atkinson, C., Soria, J.and New, T.H., 2018.A detailed comparison of single-camera light-field PIV and tomographic PIV.Experiments in Fluids, 59(3), pp.1-13.[5]Shi, S., Ding, J., New, T.H., Liu, Y.and Zhang, H., 2019.Volumetric calibration enhancements for single-camera light-field PIV.Experiments in Fluids, 60(1), p.21.光譜成像(spectrum imaging)由傳統彩色成像技術發展而來,能夠獲取目標物體的光譜信息。每個物體都有自己獨特的光譜特征,就像每個人擁有不同的指紋一樣,光譜也因此被視為目標識別的“指紋”信息。通過獲取目標物體在連續窄波段內的光譜圖像,組成空間維度和光譜維度的數據立方體信息,可以極大地增強目標識別和分析能力。光譜成像可作為科學研究、工程應用的強有力工具,已經廣泛應用于軍事、工業、民用等諸多領域,對促進社會經濟發展和保障國家安全具有重要作用。例如,光譜成像對河流、沙土、植被、巖礦等地物都具有很好的識別效果,因此在精準農業、環境監控、資源勘查、食品安全等諸多方面都具有重要應用。特別地,光譜成像還有望用于手機、自動駕駛汽車等終端。當前,光譜成像已成為計算機視覺和圖形學研究的熱點方向之一。

無透鏡成像(lensless imaging)技術為進一步壓縮成像系統的尺寸提供了一種全新的思路(Boominathan等,2022)。傳統的成像系統依賴點對點的成像模式,其系統極限尺寸仍受限于透鏡的焦距、孔徑、視場等核心指標。無透鏡成像摒棄了傳統透鏡中點對點的映射模式,而是將物空間的點投影為像空間的特定圖案,不同物點在像面疊加編碼,形成了一種人眼無法識別,但計算算法可以通過解碼復原圖像信息。其在緊湊性方面具有極強的競爭力,而且隨著解碼算法的發展,其成像分辨率也得到大大提升。因此,在可穿戴相機、便攜式顯微鏡、內窺鏡、物聯網等應用領域極具發展潛力。另外,其獨特的光學加密功能,能夠對目標中敏感的生物識別特征進行有效保護,在隱私保護的人工智能成像方面也具有重要意義。

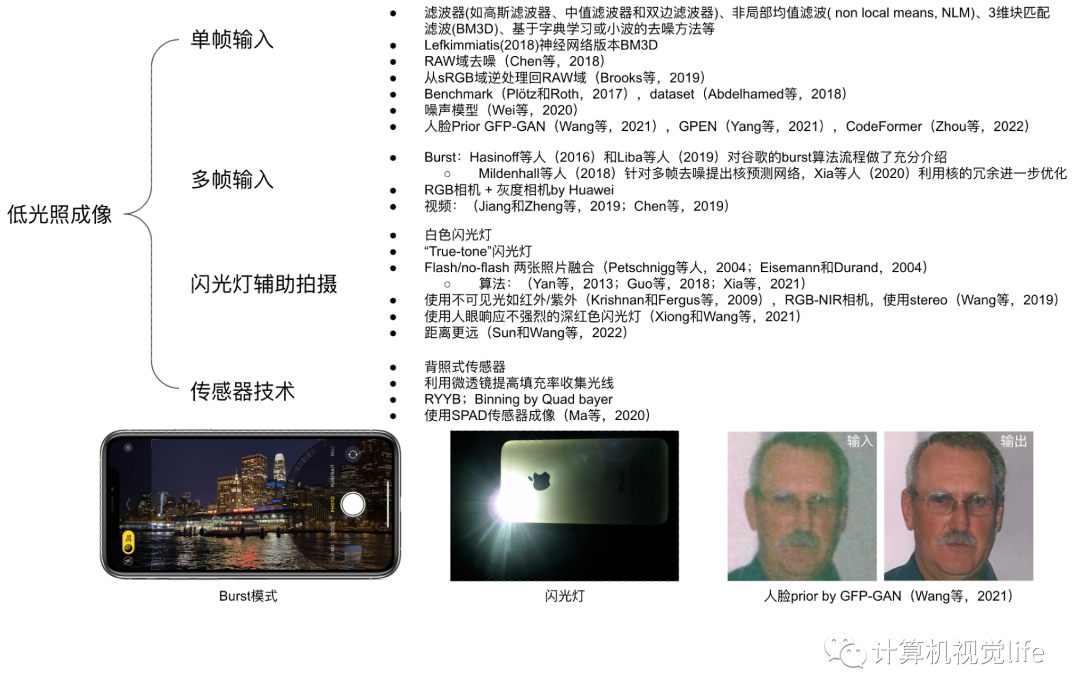

低光照成像(low light imaging)也是計算攝影里的研究熱點一。手機攝影已經成為了人們用來記錄生活的最常用的方式之一,手機的攝像功能也是每次發布會的看點,夜景模式也成了各大手機廠商爭奪的技術制高點。不同手機的相機在白天的強光環境下拍照差異并不明顯,然而在夜晚弱光情況下則差距明顯。其原因是,成像依賴于鏡頭收集物體發出的光子,且傳感器由光電轉換、增益、模數轉換一系列過程會有不可避免的噪聲;白天光線充足,信號的信噪比高,成像質量很高;晚上光線微弱,信號的信噪比下降數個數量級,成像質量低;部分手機搭載使用計算攝影算法的夜景模式,比如基于單幀、多幀、RYYB陣列等的去噪,有效地提高了照片的質量。但目前依舊有很大的提升空間。低光照成像按照輸入分類可以分為單幀輸入、多幀輸入( burst imaging)、 閃光燈輔助拍攝和傳感器技術,技術路線如圖2所示。技術路線如圖5所示。

圖5低光照成像技術路線

圖中所列參考文獻(向上滑動即可查看全部)·單幀輸入

[1]Lefkimmiatis, S., 2018. Universal denoising networks: a novel CNN architecture for image denoising. In Proceedings of the IEEE conference on computer vision and pattern recognition (pp. 3204-3213).

[2]Chen, C., Chen, Q., Xu, J. and Koltun, V., 2018. Learning to see in the dark. In Proceedings of the IEEE conference on computer vision and pattern recognition (pp. 3291-3300)

[3]Brooks, T., Mildenhall, B., Xue, T., Chen, J., Sharlet, D. and Barron, J.T., 2019. Unprocessing images for learned raw denoising. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 11036-11045).

[4]Plotz, T. and Roth, S., 2017. Benchmarking denoising algorithms with real photographs. In Proceedings of the IEEE conference on computer vision and pattern recognition (pp. 1586-1595).

[5]Abdelhamed, A., Lin, S. and Brown, M.S., 2018. A high-quality denoising dataset for smartphone cameras. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (pp. 1692-1700).

[6]Wei, K., Fu, Y., Yang, J. and Huang, H., 2020. A physics-based noise formation model for extreme low-light raw denoising. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 2758-2767).

[7]Wang, X., Li, Y., Zhang, H. and Shan, Y., 2021. Towards real-world blind face restoration with generative facial prior. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 9168-9178).

[8]Yang, T., Ren, P., Xie, X. and Zhang, L., 2021. Gan prior embedded network for blind face restoration in the wild. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 672-681).

[9]Zhou, S., Chan, K.C., Li, C. and Loy, C.C., 2022. Towards Robust Blind Face Restoration with Codebook Lookup Transformer. arXiv preprint arXiv:2206.11253.

·多幀輸入

[1]Hasinoff, S.W., Sharlet, D., Geiss, R., Adams, A., Barron, J.T., Kainz, F., Chen, J. and Levoy, M., 2016. Burst photography for high dynamic range and low-light imaging on mobile cameras. ACM Transactions on Graphics (ToG), 35(6), pp.1-12.

[2]Liba, O., Murthy, K., Tsai, Y.T., Brooks, T., Xue, T., Karnad, N., He, Q., Barron, J.T., Sharlet, D., Geiss, R. and Hasinoff, S.W., 2019. Handheld mobile photography in very low light. ACM Trans. Graph., 38(6), pp.164-1.

[3]Mildenhall, B., Barron, J.T., Chen, J., Sharlet, D., Ng, R. and Carroll, R., 2018. Burst denoising with kernel prediction networks. In Proceedings of the IEEE conference on computer vision and pattern recognition (pp. 2502-2510).

[4]Xia, Z., Perazzi, F., Gharbi, M., Sunkavalli, K. and Chakrabarti, A., 2020. Basis prediction networks for effective burst denoising with large kernels. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 11844-11853).

[5]Jiang, H. and Zheng, Y., 2019. Learning to see moving objects in the dark. In Proceedings of the IEEE/CVF International Conference on Computer Vision (pp. 7324-7333).

[6]Chen, C., Chen, Q., Do, M.N. and Koltun, V., 2019. Seeing motion in the dark. In Proceedings of the IEEE/CVF International Conference on Computer Vision (pp. 3185-3194).

·閃光燈

[1]Eisemann, E. and Durand, F., 2004. Flash photography enhancement via intrinsic relighting. ACM transactions on graphics (TOG), 23(3), pp.673-678.

[2]Petschnigg, G., Szeliski, R., Agrawala, M., Cohen, M., Hoppe, H. and Toyama, K., 2004. Digital photography with flash and no-flash image pairs. ACM transactions on graphics (TOG), 23(3), pp.664-672.

[3]Yan, Q., Shen, X., Xu, L., Zhuo, S., Zhang, X., Shen, L. and Jia, J., 2013. Cross-field joint image restoration via scale map. In Proceedings of the IEEE International Conference on Computer Vision (pp. 1537-1544).

[4]Guo, X., Li, Y., Ma, J. and Ling, H., 2018. Mutually guided image filtering. IEEE transactions on pattern analysis and machine intelligence, 42(3), pp.694-707.

[5]Xia, Z., Gharbi, M., Perazzi, F., Sunkavalli, K. and Chakrabarti, A., 2021. Deep Denoising of Flash and No-Flash Pairs for Photography in Low-Light Environments. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 2063-2072).

[6]Krishnan, D. and Fergus, R., 2009. Dark flash photography. ACM Trans. Graph., 28(3), p.96.

[7]Wang, J., Xue, T., Barron, J.T. and Chen, J., 2019, May. Stereoscopic dark flash for low-light photography. In 2019 IEEE International Conference on Computational Photography (ICCP) (pp. 1-10). IEEE.

[8]Xiong, J., Wang, J., Heidrich, W. and Nayar, S., 2021. Seeing in extra darkness using a deep-red flash. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 10000-10009).

[9]Sun, Z., Wang, J., Wu, Y. and Nayar, S., 2022. Seeing Far in the Dark with Patterned Flash, In European Conference on Computer Vision. Springer

·傳感器

[1]Ma, S., Gupta, S., Ulku, A.C., Bruschini, C., Charbon, E. and Gupta, M., 2020. Quanta burst photography. ACM Transactions on Graphics (TOG), 39(4), pp.79-1.

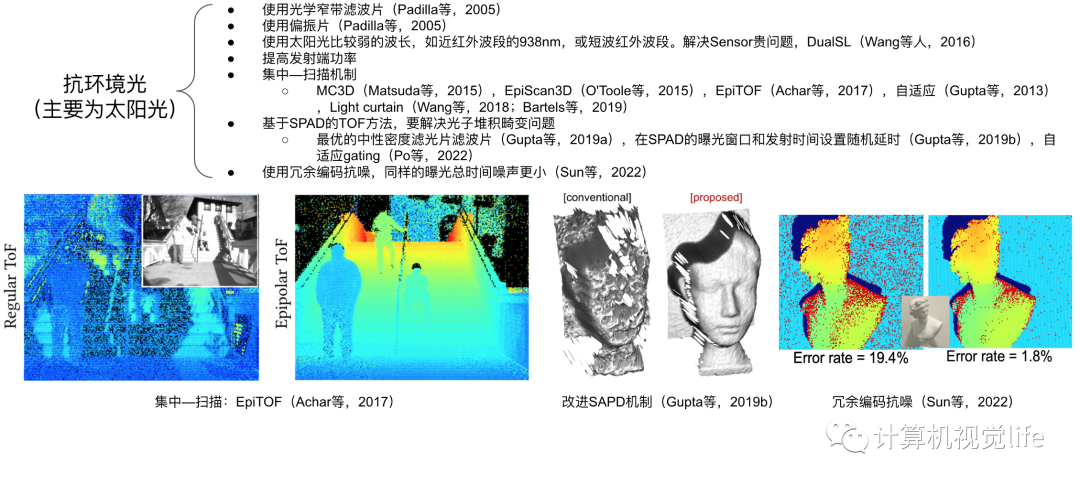

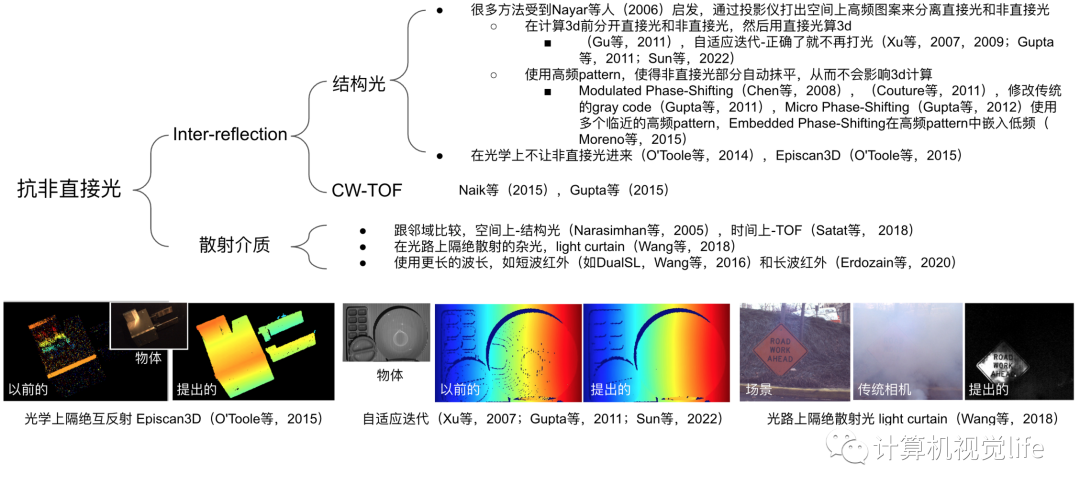

主動三維成像(active 3D imaging)以獲取物體或場景的點云為目的,被動方法以雙目立體匹配為代表,但難以解決無紋理區域和有重復紋理區域的深度。主動光方法一般更為魯棒,能夠在暗處工作,且能夠得到稠密的、精確的點云。主動光方法根據使用的光的性質可分為基于光的直線傳播如結構光,基于光速如Time-of-fligt(TOF),包括連續波TOF(iTOF)和直接TOF(dTOF),和基于光的波的性質如干涉儀,其中前兩種方法的主動三維成像已廣泛使用在人們的日常生活中。雖然主動方法通過打光的方式提高了準確性,但也存在由于環境光(主要是太陽光)、多路徑干擾(又稱做非直接光干擾)引起的問題,這些都在近些年的研究過程中有了很大的進展,如圖6和圖7所示。

圖6抗環境光技術路線

圖中所列參考文獻(向上滑動即可查看全部)[1]Padilla, D.D. and Davidson, P., 2005. Advancements in sensing and perception using structured lighting techniques: An ldrd final report.

[2]Wang, J., Sankaranarayanan, A.C., Gupta, M. and Narasimhan, S.G., 2016, October. Dual structured light 3d using a 1d sensor. In European Conference on Computer Vision (pp. 383-398). Springer

[3]Matsuda, N., Cossairt, O. and Gupta, M., 2015, April. Mc3d: Motion contrast 3d scanning. In 2015 IEEE International Conference on Computational Photography (ICCP) (pp. 1-10). IEEE.

[4]O'Toole, M., Achar, S., Narasimhan, S.G. and Kutulakos, K.N., 2015. Homogeneous codes for energy-efficient illumination and imaging. ACM Transactions on Graphics (ToG), 34(4), pp.1-13.

[5]Supreeth Achar, Joseph R. Bartels, William L. ‘Red’ Whittaker, Kiriakos N. Kutulakos, Srinivasa G. Narasimhan. 2017, "Epipolar Time-of-Flight Imaging", ACM SIGGRAPH

[6]Gupta, M., Yin, Q. and Nayar, S.K., 2013. Structured light in sunlight. In Proceedings of the IEEE International Conference on Computer Vision (pp. 545-552).

[7]Wang, J., Bartels, J., Whittaker, W., Sankaranarayanan, A.C. and Narasimhan, S.G., 2018. Programmable triangulation light curtains. In Proceedings of the European Conference on Computer Vision (ECCV) (pp. 19-34).

[8]Bartels, J.R., Wang, J., Whittaker, W. and Narasimhan, S.G., 2019. Agile depth sensing using triangulation light curtains. In Proceedings of the IEEE/CVF International Conference on Computer Vision (pp. 7900-7908).

[9]Gupta, A., Ingle, A., Velten, A. and Gupta, M., 2019. Photon-flooded single-photon 3D cameras. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 6770-6779).

[10]Gupta, A., Ingle, A. and Gupta, M., 2019. Asynchronous single-photon 3D imaging. In Proceedings of the IEEE/CVF International Conference on Computer Vision (pp. 7909-7918).

[11]Po, R., Pediredla, A. and Gkioulekas, I., 2022. Adaptive Gating for Single-Photon 3D Imaging. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 16354-16363).

[12]Sun, Z., Zhang, Y., Wu, Y., Huo, D., Qian, Y. and Wang, J., 2022. Structured Light with Redundancy Codes. arXiv preprint arXiv:2206.09243.

圖7抗非直接光技術路線

圖中所列參考文獻(向上滑動即可查看全部)[1]Nayar, S.K., Krishnan, G., Grossberg, M.D. and Raskar, R., 2006. Fast separation of direct and global components of a scene using high frequency illumination. In ACM SIGGRAPH 2006 Papers (pp. 935-944).

[2]Gu, J., Kobayashi, T., Gupta, M. and Nayar, S.K., 2011, November. Multiplexed illumination for scene recovery in the presence of global illumination. In 2011 International Conference on Computer Vision (pp. 691-698). IEEE.

[3]Xu, Y. and Aliaga, D.G., 2007, May. Robust pixel classification for 3d modeling with structured light. In Proceedings of Graphics Interface 2007 (pp. 233-240).

[4]Xu, Y. and Aliaga, D.G., 2009. An adaptive correspondence algorithm for modeling scenes with strong interreflections. IEEE Transactions on Visualization and Computer Graphics, 15(3), pp.465-480.

[5]Gupta, M., Agrawal, A., Veeraraghavan, A. and Narasimhan, S.G., 2011, June. Structured light 3D scanning in the presence of global illumination. In CVPR 2011 (pp. 713-720). IEEE.

[6]Sun, Z., Zhang, Y., Wu, Y., Huo, D., Qian, Y. and Wang, J., 2022. Structured Light with Redundancy Codes. arXiv preprint arXiv:2206.09243.

[7]Chen, T., Seidel, H.P. and Lensch, H.P., 2008, June. Modulated phase-shifting for 3D scanning. In 2008 IEEE Conference on Computer Vision and Pattern Recognition (pp. 1-8). IEEE.

[8]Couture, V., Martin, N. and Roy, S., 2011, November. Unstructured light scanning to overcome interreflections. In 2011 International Conference on Computer Vision (pp. 1895-1902). IEEE.

[9]Gupta, M. and Nayar, S.K., 2012, June. Micro phase shifting. In 2012 IEEE Conference on Computer Vision and Pattern Recognition (pp. 813-820). IEEE.

[10]Moreno, D., Son, K. and Taubin, G., 2015. Embedded phase shifting: Robust phase shifting with embedded signals. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (pp. 2301-2309).

[11]O'Toole, M., Mather, J. and Kutulakos, K.N., 2014. 3d shape and indirect appearance by structured light transport. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (pp. 3246-3253).

[12]O'Toole, M., Achar, S., Narasimhan, S.G. and Kutulakos, K.N., 2015. Homogeneous codes for energy-efficient illumination and imaging. ACM Transactions on Graphics (ToG), 34(4), pp.1-13.

[13]Wang, J., Bartels, J., Whittaker, W., Sankaranarayanan, A.C. and Narasimhan, S.G., 2018. Programmable triangulation light curtains. In Proceedings of the European Conference on Computer Vision (ECCV) (pp. 19-34).

[14]Naik, N., Kadambi, A., Rhemann, C., Izadi, S., Raskar, R. and Bing Kang, S., 2015. A light transport model for mitigating multipath interference in time-of-flight sensors. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (pp. 73-81).

[15]Gupta, M., Nayar, S.K., Hullin, M.B. and Martin, J., 2015. Phasor imaging: A generalization of correlation-based time-of-flight imaging. ACM Transactions on Graphics (ToG), 34(5), pp.1-18.

[16]Narasimhan, S.G., Nayar, S.K., Sun, B. and Koppal, S.J., 2005, October. Structured light in scattering media. In Tenth IEEE International Conference on Computer Vision (ICCV'05) Volume 1 (Vol. 1, pp. 420-427). IEEE.

[17]Satat, G., Tancik, M. and Raskar, R., 2018, May. Towards photography through realistic fog. In 2018 IEEE International Conference on Computational Photography (ICCP) (pp. 1-10). IEEE.

[18]Wang, J., Sankaranarayanan, A.C., Gupta, M. and Narasimhan, S.G., 2016, October. Dual structured light 3d using a 1d sensor. In European Conference on Computer Vision (pp. 383-398). Springer.

[19]Erdozain, J., Ichimaru, K., Maeda, T., Kawasaki, H., Raskar, R. and Kadambi, A., 2020, October. 3d Imaging For Thermal Cameras Using Structured Light. In 2020 IEEE International Conference on Image Processing (ICIP) (pp. 2795-2799). IEEE.

計算攝影學(computational photography)是計算成像的一個分支學科,它從傳統攝影學發展而來。傳統攝影學主要著眼于使用光學器件更好地進行成像,如佳能、索尼等相機廠商對于鏡頭的研究;與之相比,計算攝影學則更側重于使用數字計算的方式進行圖像拍攝。在過去10年中,隨著移動端設備計算能力的迅速發展,手機攝影逐漸成為了計算攝影學研究的主要方向:在光學鏡片的物理尺寸、成像質量受限的情況下,如何使用合理的計算資源,繪制出用戶最滿意的圖像。計算攝影學在近年來得到了長足的發展,其研究問題的范圍也所有擴展,如:夜空攝影、人臉重光照、照片自動美化等。受圖像的算法,其中重點介紹:自動白平衡、自動對焦、人工景深模擬以及連拍攝影。篇幅所限,本報告中僅介紹目標為還原拍攝真實場景的真實信息的相關研究。

審核編輯 :李倩

-

算法

+關注

關注

23文章

4625瀏覽量

93143 -

光學

+關注

關注

3文章

755瀏覽量

36335 -

成像系統

+關注

關注

2文章

197瀏覽量

13955

發布評論請先 登錄

相關推薦

智能駕駛傳感器發展現狀及發展趨勢

淺談生物傳感技術的定義、發展現狀與未來

FWA產業的發展現狀和演進方向

醫療機器人發展現狀與趨勢

工控機廠家發展現狀及未來趨勢

國產光電耦合器:2024年的發展現狀與未來前景

《RISC-V產業年鑒2023》發布,洞察產業發展現狀與趨勢

反無人機系統發展現狀:應對無人機入侵威脅的利器|特信電子

當前全光網的發展現狀與應用情況

萬兆電口模塊的產業發展現狀與前景展望

工程振弦采集儀監測技術的發展現狀與展望

全面闡述當前計算成像發展現狀

全面闡述當前計算成像發展現狀

評論