電子發燒友網報道(文/李彎彎)近日,英偉達高端GPU對中國供應受到限制的消息,引起熱議。8月31日,英偉達發布公告稱,美國通知公司向中國出口A100和H100芯片將需要新的許可證要求,同時DGX或任何其他包含A100或H100芯片的產品,以及未來性能高于A100的芯片都將受到新規管制。

9月1日,英偉達方面又表示已經獲得出口許可。盡管如此,美國這番操作必然引起國內相關企業的警惕,接下來中國的互聯網、云服務廠商可能會積極自研芯片,或者更多采用國內企業提供的算力芯片,然而目前國內的算力芯片能力如何呢?

A100和H100出口限制,對中國有何影響

英偉達是全球GPU領域的絕對龍頭,A100是其2020年推出的數據中心級云端加速芯片,擁有540億晶體管,采用臺積電7nm工藝制程,支持FP16、FP32和FP64浮點運算,為人工智能、數據分析和HPC數據中心等提供算力。

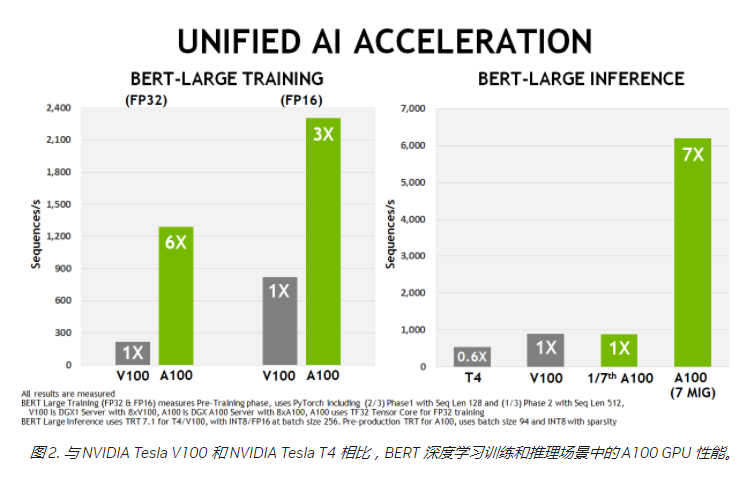

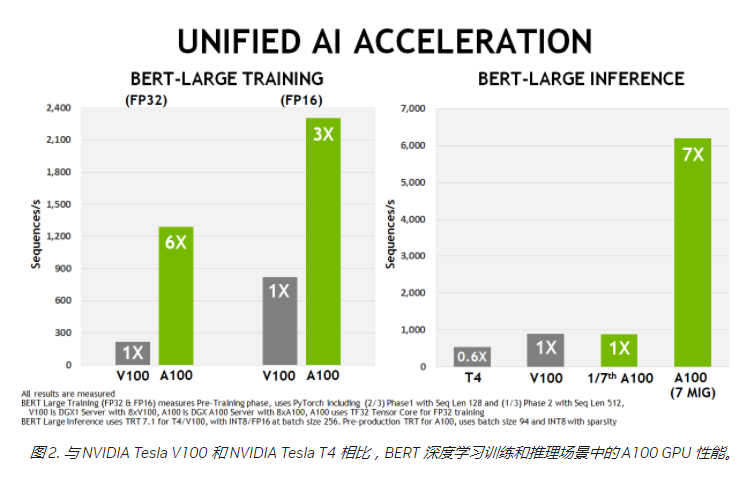

相比于上一代V100,A100在AI訓練和推理、HPC上性能都有很大的改進。據英偉達在今年8月透露,特斯拉采用了7000塊A100芯片升級了其用來訓練自動駕駛系統的超算中心。

?

?

H100是英偉達今年3月發布的最新一代數據中心GPU,集成800億晶體管,采用臺積電定制的4nm工藝,預計在今年下半年正式發貨,英偉達CEO黃仁勛此前表示,這款GPU具有超強的計算能力,20個H100 GPU便可承托相當于全球互聯網的流量。相比于A100,H100在FP16、FP32和FP64計算上比A100快三倍,非常適用于當下流行且訓練難度高的大模型。

如果A100和H100芯片出口受到限制,對中國有何影響?目前國內高端場景基本采用英偉達的A100,包括OEM廠商浪潮、聯想等,云服務公司阿里、騰訊、百度等,對于即將量產的H100,國內主流廠商也已經預定,如阿里云、百度云和騰訊云等,而且目前國內沒有能夠與其相對標的硬件產品,如果限制,這些廠商在一些高端的應用上將無法買到可替代產品。

不過有行業分析師表示,如果出口限制,確實只是對一些高端廠商的應用有影響,而在更普遍的應用場景中,英偉達的產品并不在限制的范圍,而且國內也有可替代的產品。

國產算力芯片如何突圍

從長遠來看,加速算力芯片的發展是必然的,那么國內算力芯片的能力怎樣,如何突圍呢?目前服務器加速,主要采用的是GPU芯片,占比接近90%,另外則是ASIC、FPGA等。

GPGPU芯片廣泛用于商業計算和大數據處理,如天氣預報、工業設計、基因工程、藥物發現、金融工程等,在人工智能領域,使用GPGPU在云端運行模型訓練算法,可以顯著縮短海量訓練數據的訓練時長,減少能源消耗,從而進一步降低人工智能的應用成本。

不同應用領域,對芯片計算能力及運算精度要求也有所不同,比如用于商業計算和大數據處理(CAE仿真、物理化學、石油勘探、生命科學、氣象環境等),需要雙精度浮點、單精度浮點、32位整型運算;人工智能(模型訓練、應用推理),要求混合精度浮點、半精度浮點、16位整型、8位整型運算。

近幾年國內不少企業在這方面取得進展,包括海光信息、壁仞科技、燧原科技、摩爾線程等。

海光信息成立于2014年,不久前在科創板上市,海光信息的產品包括通用處理器(CPU)和協處理器(DCU),海光DCU屬于GPGPU的一種。

海光DCU 8000系列,典型功耗260-350W,支持INT4、INT8、FP16、FP32、FP64運算精度,支持4個HBM2內存通道,最高內存帶寬為1TB/s、最大內存容量為32GB。海光DCU協處理器全面兼容ROCm GPU計算生態,由于ROCm和CUDA在生態、編程環境等方面具有高度的相似性,CUDA用戶可以以較低代價快速遷移至ROCm平臺。

可以看到,海光DCU是國內唯一支持FP64雙精度浮點運算的產品,英偉達的A100、H100都支持FP64,從這一點來看,海光DCU在這方面是比較領先的。

壁仞科技今年8月發布的首款通用GPU BR100,集成770億晶體管,支持FP16半精度浮點運算,在這方面相比英偉達、海光DCU較弱,不過據該公司介紹,BR100的16位浮點算力能達到1000T以上,8位定點算力達到2000T以上,超過英偉達的A100。

另外燧原科技此前發布的第二代人工智能訓練產品邃思2.0,支持從FP32、TF32、FP16、BF16 到INT8運算,單精度FP32峰值算力40 TFLOPS,單精度張量TF32峰值算力160 TFLOPS。

天數智芯的BI芯片,集成240億晶體管,采用7納米先進制程,支持FP32、FP16、BF16、INT8等多精度數據混合訓練,單芯算力每秒147T@FP16。

另外值得關注的還有,寒武紀2021年11月發布的第三代云端AI芯片思元370,相比于上一代芯片,思元370全面加強了FP16、BF16以及FP32的浮點算力,在全新MLUarch03架構和7nm先進工藝加持下,8位定點算力最高為256TOPS。

對比來看,目前國內廠商的芯片水平,相比于英偉達的A100和H100是存在差距的。不過在國內市場需求和美國出口限制的背景下,這些芯片廠商具有足夠的技術和經驗積累,去實現進一步的突破。

那么國內的芯片廠商需要如何突圍呢?難度肯定是大的,燧原科技創始人趙立東在日前世界人工智能大會的論壇上談到,國際巨頭用幾代人、數十年的時間投入積攢下的技術實力,我們想靠兩代和幾十名工程師就超越,是不可能的。

要縮短差距,除了資金、人力等的高密集投入外,也需要有更快的更迭,還有就是架構創新,趙立東認為,唯有架構實現原始創新,才能真正擁抱開放生態,使產業得到健康發展。

另外與國外芯片執著于先進的制程,國內不少廠商開始通過更先進的封裝工藝、異構芯片等來尋求突破。比如寒武紀思元370采用chiplet技術,在一顆芯片中封裝2顆AI計算芯粒(MLU-Die),每一個 MLU-Die 具備獨立的AI計算單元、內存、IO以及 MLU-Fabric控制和接口,通過MLU-Fabric保證兩個MLU-Die間的高速通訊,可以通過不同MLU-Die組合規格多樣化的產品,為用戶提供適用不同場景的高性價比AI芯片,壁仞科技今年8月發布的GPU BR100GPU芯片也采用了Chiplet技術。

小結

整體而言,美國限制英偉達高端GPU芯片A100和H100的出口,短期來看對中國的影響不是很大,反而對于國內算力芯片的發展或許具有促進作用。

從目前國內芯片廠商的產品來看,與英偉達A100和H100存在差距,不過也有海光信息、壁仞科技等在某些方面已經取得突破的企業,未來想要超越仍然存在困難,然而卻讓人相信一點點取得突破是有可能的。

9月1日,英偉達方面又表示已經獲得出口許可。盡管如此,美國這番操作必然引起國內相關企業的警惕,接下來中國的互聯網、云服務廠商可能會積極自研芯片,或者更多采用國內企業提供的算力芯片,然而目前國內的算力芯片能力如何呢?

A100和H100出口限制,對中國有何影響

英偉達是全球GPU領域的絕對龍頭,A100是其2020年推出的數據中心級云端加速芯片,擁有540億晶體管,采用臺積電7nm工藝制程,支持FP16、FP32和FP64浮點運算,為人工智能、數據分析和HPC數據中心等提供算力。

相比于上一代V100,A100在AI訓練和推理、HPC上性能都有很大的改進。據英偉達在今年8月透露,特斯拉采用了7000塊A100芯片升級了其用來訓練自動駕駛系統的超算中心。

?

?H100是英偉達今年3月發布的最新一代數據中心GPU,集成800億晶體管,采用臺積電定制的4nm工藝,預計在今年下半年正式發貨,英偉達CEO黃仁勛此前表示,這款GPU具有超強的計算能力,20個H100 GPU便可承托相當于全球互聯網的流量。相比于A100,H100在FP16、FP32和FP64計算上比A100快三倍,非常適用于當下流行且訓練難度高的大模型。

如果A100和H100芯片出口受到限制,對中國有何影響?目前國內高端場景基本采用英偉達的A100,包括OEM廠商浪潮、聯想等,云服務公司阿里、騰訊、百度等,對于即將量產的H100,國內主流廠商也已經預定,如阿里云、百度云和騰訊云等,而且目前國內沒有能夠與其相對標的硬件產品,如果限制,這些廠商在一些高端的應用上將無法買到可替代產品。

不過有行業分析師表示,如果出口限制,確實只是對一些高端廠商的應用有影響,而在更普遍的應用場景中,英偉達的產品并不在限制的范圍,而且國內也有可替代的產品。

國產算力芯片如何突圍

從長遠來看,加速算力芯片的發展是必然的,那么國內算力芯片的能力怎樣,如何突圍呢?目前服務器加速,主要采用的是GPU芯片,占比接近90%,另外則是ASIC、FPGA等。

GPGPU芯片廣泛用于商業計算和大數據處理,如天氣預報、工業設計、基因工程、藥物發現、金融工程等,在人工智能領域,使用GPGPU在云端運行模型訓練算法,可以顯著縮短海量訓練數據的訓練時長,減少能源消耗,從而進一步降低人工智能的應用成本。

不同應用領域,對芯片計算能力及運算精度要求也有所不同,比如用于商業計算和大數據處理(CAE仿真、物理化學、石油勘探、生命科學、氣象環境等),需要雙精度浮點、單精度浮點、32位整型運算;人工智能(模型訓練、應用推理),要求混合精度浮點、半精度浮點、16位整型、8位整型運算。

近幾年國內不少企業在這方面取得進展,包括海光信息、壁仞科技、燧原科技、摩爾線程等。

海光信息成立于2014年,不久前在科創板上市,海光信息的產品包括通用處理器(CPU)和協處理器(DCU),海光DCU屬于GPGPU的一種。

海光DCU 8000系列,典型功耗260-350W,支持INT4、INT8、FP16、FP32、FP64運算精度,支持4個HBM2內存通道,最高內存帶寬為1TB/s、最大內存容量為32GB。海光DCU協處理器全面兼容ROCm GPU計算生態,由于ROCm和CUDA在生態、編程環境等方面具有高度的相似性,CUDA用戶可以以較低代價快速遷移至ROCm平臺。

可以看到,海光DCU是國內唯一支持FP64雙精度浮點運算的產品,英偉達的A100、H100都支持FP64,從這一點來看,海光DCU在這方面是比較領先的。

壁仞科技今年8月發布的首款通用GPU BR100,集成770億晶體管,支持FP16半精度浮點運算,在這方面相比英偉達、海光DCU較弱,不過據該公司介紹,BR100的16位浮點算力能達到1000T以上,8位定點算力達到2000T以上,超過英偉達的A100。

另外燧原科技此前發布的第二代人工智能訓練產品邃思2.0,支持從FP32、TF32、FP16、BF16 到INT8運算,單精度FP32峰值算力40 TFLOPS,單精度張量TF32峰值算力160 TFLOPS。

天數智芯的BI芯片,集成240億晶體管,采用7納米先進制程,支持FP32、FP16、BF16、INT8等多精度數據混合訓練,單芯算力每秒147T@FP16。

另外值得關注的還有,寒武紀2021年11月發布的第三代云端AI芯片思元370,相比于上一代芯片,思元370全面加強了FP16、BF16以及FP32的浮點算力,在全新MLUarch03架構和7nm先進工藝加持下,8位定點算力最高為256TOPS。

對比來看,目前國內廠商的芯片水平,相比于英偉達的A100和H100是存在差距的。不過在國內市場需求和美國出口限制的背景下,這些芯片廠商具有足夠的技術和經驗積累,去實現進一步的突破。

那么國內的芯片廠商需要如何突圍呢?難度肯定是大的,燧原科技創始人趙立東在日前世界人工智能大會的論壇上談到,國際巨頭用幾代人、數十年的時間投入積攢下的技術實力,我們想靠兩代和幾十名工程師就超越,是不可能的。

要縮短差距,除了資金、人力等的高密集投入外,也需要有更快的更迭,還有就是架構創新,趙立東認為,唯有架構實現原始創新,才能真正擁抱開放生態,使產業得到健康發展。

另外與國外芯片執著于先進的制程,國內不少廠商開始通過更先進的封裝工藝、異構芯片等來尋求突破。比如寒武紀思元370采用chiplet技術,在一顆芯片中封裝2顆AI計算芯粒(MLU-Die),每一個 MLU-Die 具備獨立的AI計算單元、內存、IO以及 MLU-Fabric控制和接口,通過MLU-Fabric保證兩個MLU-Die間的高速通訊,可以通過不同MLU-Die組合規格多樣化的產品,為用戶提供適用不同場景的高性價比AI芯片,壁仞科技今年8月發布的GPU BR100GPU芯片也采用了Chiplet技術。

小結

整體而言,美國限制英偉達高端GPU芯片A100和H100的出口,短期來看對中國的影響不是很大,反而對于國內算力芯片的發展或許具有促進作用。

從目前國內芯片廠商的產品來看,與英偉達A100和H100存在差距,不過也有海光信息、壁仞科技等在某些方面已經取得突破的企業,未來想要超越仍然存在困難,然而卻讓人相信一點點取得突破是有可能的。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

芯片

+關注

關注

456文章

50965瀏覽量

424810 -

gpu

+關注

關注

28文章

4754瀏覽量

129069

發布評論請先 登錄

相關推薦

《算力芯片 高性能 CPUGPUNPU 微架構分析》第3篇閱讀心得:GPU革命:從圖形引擎到AI加速器的蛻變

在數據挖掘工作中,我經常需要處理海量數據的深度學習任務,這讓我對GPU架構和張量運算充滿好奇。閱讀《算力芯片》第7-9章,讓我對這些關鍵技術有了全新認識。

發表于 11-24 17:12

【「算力芯片 | 高性能 CPU/GPU/NPU 微架構分析」閱讀體驗】--了解算力芯片GPU

著色器(Pixel shader)是圖形流水線中算力相當強大的功能單元,因為它可以為每個片段執行復雜的計算,從而為最終渲染的圖像添加細節和視覺效果。

DirectX API推動 GPU 演進

發表于 11-03 12:55

存算一體架構創新助力國產大算力AI芯片騰飛

在灣芯展SEMiBAY2024《AI芯片與高性能計算(HPC)應用論壇》上,億鑄科技高級副總裁徐芳發表了題為《存算一體架構創新助力國產大算力

GPU算力租用平臺是什么

GPU算力租用平臺是一種基于云計算的服務模式,它允許用戶通過互聯網按需租用高性能GPU資源,而無需自行購買、部署和維護這些硬件。

【「算力芯片 | 高性能 CPU/GPU/NPU 微架構分析」閱讀體驗】--全書概覽

、GPU、NPU,給我們剖析了算力芯片的微架構。書中有對芯片方案商處理器的講解,理論聯系實際,使讀者能更好理解

發表于 10-15 22:08

名單公布!【書籍評測活動NO.43】 算力芯片 | 高性能 CPU/GPU/NPU 微架構分析

這個想法被否決了,因為投入較大、難以落地,且客戶對算力的認同遠不及今天這種高度。

這幾年間其實我們聯系甚少,但是作者一直沒有脫離對芯片的應用和關注。特別是目睹GPU從消費電子轉向

發表于 09-02 10:09

算力服務器為什么選擇GPU

隨著人工智能技術的快速普及,算力需求日益增長。智算中心的服務器作為支撐大規模數據處理和計算的核心設備,其性能優化顯得尤為關鍵。而GPU服務器也進入了大眾的視野,成為高性能計算的首選。那

青云科技聯手摩爾線程,構建國產算力繁榮生態

隨著大數據模型與各行業深度整合,以GPU為代表的智能算力需求持續攀升。同時,政府出臺多項扶持政策,積極推行“人工智能+”戰略,激勵AI芯片行業創新發展,以更好地賦能各行各業。

Sora算力需求引發業界對集結國內AI企業算力的探討

據周鴻祎觀察,Sora視頻分析所需算力恐遠超千億規模模型。因而,考慮到如今國內芯片供應受限,算力問題至關重要。事實上,Meta已有約50萬臺

高端GPU芯片拉警報,國產算力芯片能力如何?

高端GPU芯片拉警報,國產算力芯片能力如何?

評論