近年來,使用機器學習技術進行特征提取的基于調制解調器特征的SLAM越來越受到關注,并有望在幾乎所有機器人工作環(huán)境中超越傳統(tǒng)方法。這種方法利用經過訓練的網絡來學習關鍵點,從而增強可視化SLAM數據關聯(lián)的魯棒性。現(xiàn)代基于特征的SLAM也有望為實時映射生成可靠的感知圖,因為基于學習的特征點更具可重復性和均勻分布性。此外,這些局部特征可以用作神經對應網絡的輸入,以消除異常值,從而使姿態(tài)估計變得更加準確。另一方面,由于資源有限,無人機上的SLAM經常對計算構成限制。在這種情況下,基于特征的SLAM更相關,因為提取的興趣點可以稍后用于與分割和對象檢測相關的任務。

因此,提取特征點的方法在SLAM中起著關鍵作用。我們引入了一種名為SupSLAM的視覺慣性SLAM方法,該方法基于一種稱為超級點的新特征點的使用。這些特征點通過深度神經網絡從SLAM前端的輸入圖像中提取的。我們的SLAM前端只需要一個帶有IMU作為輸入的立體攝像頭。姿態(tài)估計由多狀態(tài)約束卡爾曼濾波器(MSCKF)進行,而軌跡可靠性則由后端運行的圖形優(yōu)化過程維護。

系統(tǒng)架構

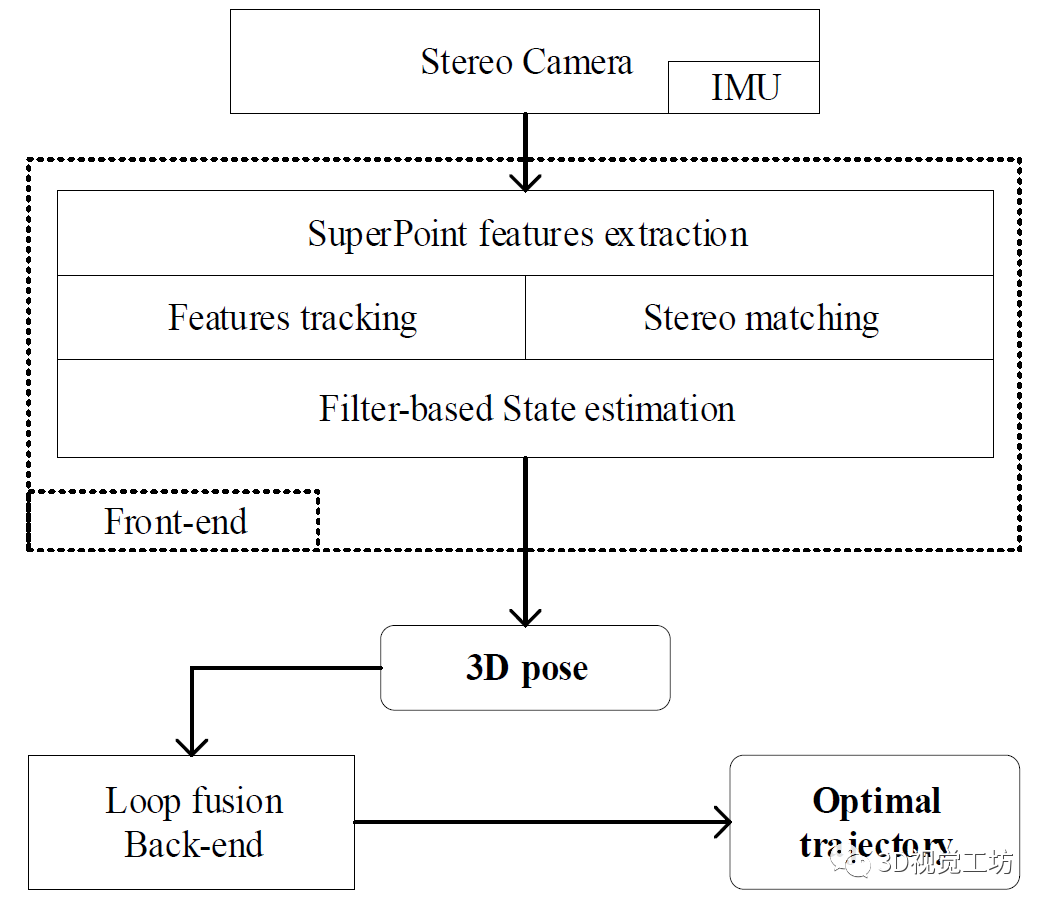

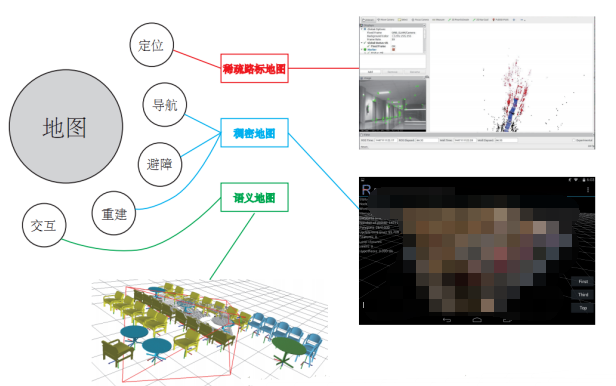

圖1 中顯示了表示我們的SLAM系統(tǒng)的圖表。該系統(tǒng)使用立體攝像頭作為輸入來提取環(huán)境特征。該相機配有IMU,用于測量線性加速度和角速度。然后通過前端和后端模塊處理來自輸入設備的數據。

圖1系統(tǒng)概述

前端從輸入數據中提取特征點,然后在左右攝像頭之間匹配它們以獲取深度信息。然后將這些信息提供給多態(tài)約束MSCKF,以估計無人機的3D姿態(tài)。另一方面,后端跟蹤關鍵幀中的要素,以執(zhí)行映射一致性和軌跡估計的循環(huán)閉包過程。因此,前端表現(xiàn)為視覺慣性里程計(VIO),以提供無人機姿勢的實時估計,而后端則跟蹤并隨時間調整姿勢。

SLAM 中數據關聯(lián)的超級點

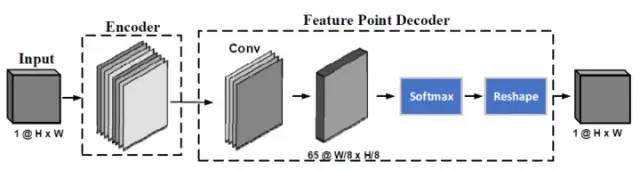

SuperPoint是一個完全卷積的神經網絡,它在單個正向傳遞和運行中計算2D特征點位置和描述符。在我們的工作中,我們只考慮特征點,以降低計算成本并保持匹配結果的一致性。所用超級點的體系結構如圖 2所示。

圖2超級點的模型架構

實驗設置

實驗數據是從框架尺寸為40cm x40cm的四軸飛行器中收集的。IMU更新速率為200 Hz。立體相機的基線為7厘米,分辨率為752x480,速度為每秒20幀。SLAM系統(tǒng)在C++中使用OpenVINS框架實現(xiàn)。OpenCV和庫用于圖像處理。為了實時性能,要跟蹤的視覺特征數限制為400個,當活動點數降至300以下時,將添加新的特征點。預訓練的深度神經網絡用于以752x480的分辨率從輸入圖像中提取特征。MSCKF中的時間窗口設置為3秒。在后端,每隔1.2米向姿勢圖添加新的關鍵幀。

數據準備

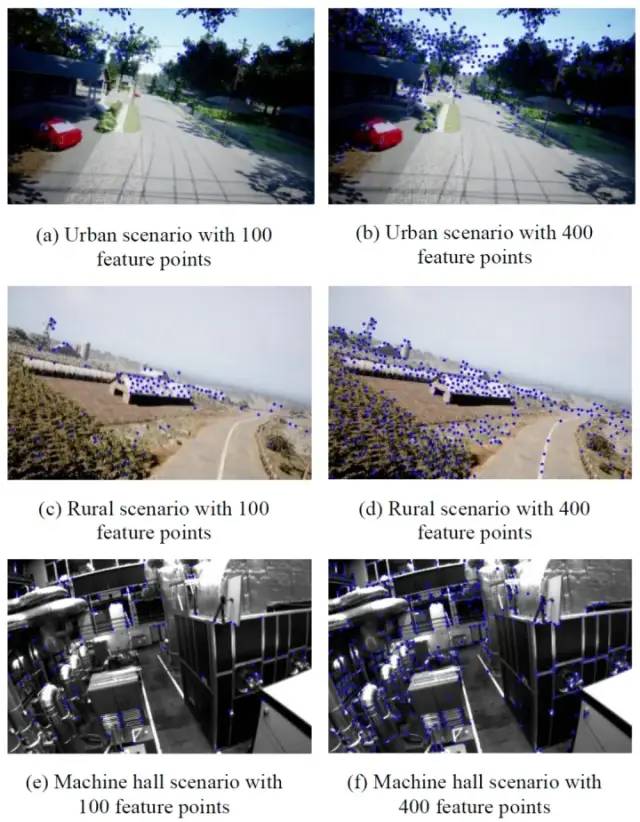

真實數據和合成數據都用于實驗。真實數據包括EuRoC數據集中名為MH3,MH4和MH5的三個最復雜的序列,其中無人機沿著機房飛行。合成數據包括兩個場景,分別代表一個農村農場和一個城市地區(qū),這些場景是由我們從AirSim開發(fā)的工具集生成的,如圖3所示。

圖3用于實驗的農村農場和城市地區(qū)的綜合場景

評價指標

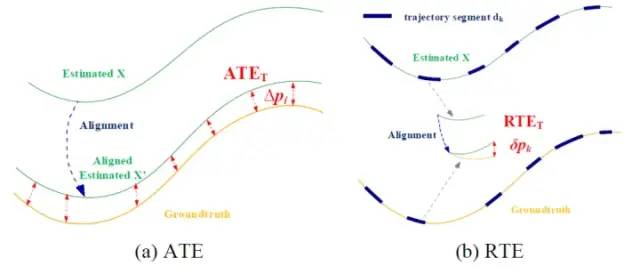

我們使用兩個指標進行性能評估,包括絕對軌跡誤差(ATE)和相對軌跡誤差(RTE)。計算ATE的方法是首先將估計的軌跡與地面實況對齊,然后測量它們之間的差異,如圖4a所示。RTE的計算方法是將估計的軌跡劃分為段dk然后將每個線段與地面實況軌跡對齊,以計算誤差,如圖4b所示。

圖4評估指標的圖示(a) 絕對軌跡誤差和(b) 相對軌跡誤差

SLAM結果

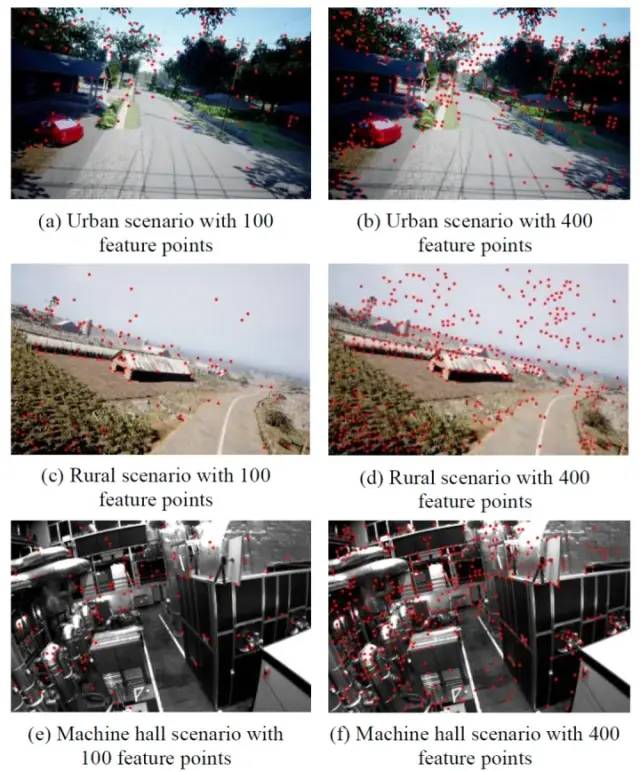

圖5 顯示了SuperPoint在三個場景中檢測到的特征點,包括城市地區(qū)、農村農場和機房,具有兩種不同的設置,即100個和400個特征點。可以看出,角落,邊緣,顏色變化等特征被很好地檢測到。此外,檢測到的特征分布在圖像中,因此算法對某些對象的依賴性較小。

圖5超級點檢測到的特征點

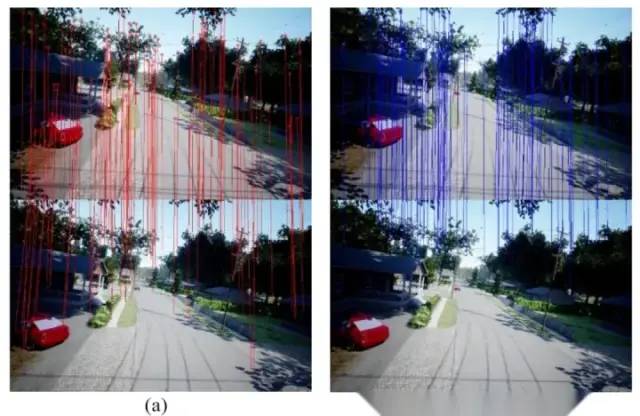

圖6顯示了檢測到的特征點在左右圖像之間的對應關系。可以看出,大多數特征點都正確匹配,這意味著提取的深度信息是可靠的。

圖6超級點檢測到的特征點在不同時間捕獲的兩個圖像幀之間的特征點的跟蹤Δt=0.3s如圖7a 所示。由于檢測到的特征點分布在圖像中,因此幀之間的共同特征點的數量得到了很好的維護,這對于穩(wěn)定的SLAM非常重要。

圖7使用時差捕獲(a) FAST和(b)兩幀中的超級點的跟蹤結果Δt=0.3s

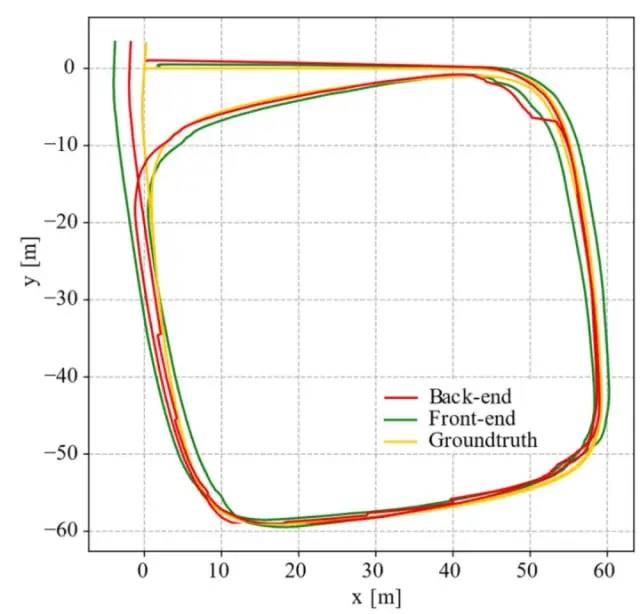

圖 8 顯示了LoopF數據集的SLAM結果,其中無人機在農村農場上空飛行兩輪。可以看出,最終估計的軌跡(紅線)即使在近500米的長距離上也能很好地跟蹤地面實況軌跡(黃線)。

圖8LoopF數據集的無人機軌跡包括地面實況軌跡(黃線)、前端估計(綠線)和后端估計(紅線)

結果比較

為了進一步評估我們方法的性能,我們與OpenVINS 進行了比較,OpenVINS是一種最先進的SLAM系統(tǒng),使用FAST進行特征提取。圖9顯示了FAST檢測到的特征點。與SuperPoint不同,這些特征點集中在某些對象(如植物、房屋或機器)周圍。因此,當物體移出場景時,不同時間拍攝的圖像幀之間的共同特征點數量顯著減少,如圖7b所示。這個問題反過來又會影響SLAM的結果。

圖9FAST檢測到的特征點為了評估SupSLAM的性能,我們進行了許多實驗,并與真實和合成數據集進行了比較。結果驗證了我們提出的無人機系統(tǒng)的有效性和有效性。

-

機器人

+關注

關注

211文章

28420瀏覽量

207111 -

神經網絡

+關注

關注

42文章

4771瀏覽量

100773 -

數據

+關注

關注

8文章

7033瀏覽量

89040 -

SLAM

+關注

關注

23文章

424瀏覽量

31834

原文標題:一種強大的視覺慣性SLAM系統(tǒng)SupSLAM

文章出處:【微信號:3D視覺工坊,微信公眾號:3D視覺工坊】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

相關推薦

什么是SLAM?視覺SLAM怎么實現(xiàn)?

激光SLAM與視覺SLAM有什么區(qū)別?

基于視覺的slam自動駕駛

單目視覺SLAM仿真系統(tǒng)的設計與實現(xiàn)

視覺SLAM實現(xiàn)的關鍵方法有哪些詳細資料總結

視覺SLAM深度解讀

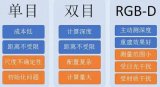

科普|視覺SLAM是什么——三種視覺SLAM方案

基于SupSLAM視覺慣性SLAM方法在無人機中的應用研究

基于深度學習的視覺SLAM綜述

視覺SLAM開源方案匯總 視覺SLAM設備選型

視覺SLAM是什么?視覺SLAM的工作原理 視覺SLAM框架解讀

基于SupSLAM的視覺慣性SLAM方法

基于SupSLAM的視覺慣性SLAM方法

評論