嵌入式 AI

AI 簡報 20221028 期

1. vivo公布自研芯片黑科技 AI-ISP讓算力捅破天

原文:

https://app.myzaker.com/news/article.php?pk=63476be18e9f0903ac797c80

在討論一款手機的實力時,影像是其中最重要的評判維度之一。隨著手機攝影的發(fā)展,許多之前困擾手機的拍照難題,都迎來了行之有效的解決方案。其中,自研影像芯片成為移動影像迭代的一個核心方向,讓手機能夠在暗光和運動場景等一些高挑戰(zhàn)性場景中拍出好照片。

如今,一聊到自研芯片,很多熟悉數碼圈的朋友第 一時間想到的可能就是藍廠了。2021 年,vivo X70 系列攜vivo自研芯片V1 發(fā)布,實現更好的夜景成像效果,加之vivo對影像技術的大力投入,使得X系列獲得了很高的市場與消費者口碑。從X70 系列之后,手機行業(yè)也正式掀起了自研影像芯片的潮流。

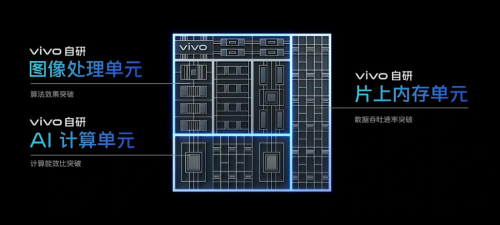

在剛剛結束的影像戰(zhàn)略發(fā)布會上,vivo展示了其完善的影像技術矩陣。作為影像算法升級的最有力保障,vivo宣布將在下一代自研芯片設計中升級全新的架構——從傳統ISP架構升級為AI ISP架構,進一步提升影像效果體驗。

那么問題來了,AI-ISP是什么?

傳統ISP架構雖然能以極低延時處理大量的數據流水,但只能解決已知的、特定的問題,面對復雜、隨機問題時則會面臨巨大的困難。而AI擅長處理復雜的、未知的問題。因此,將傳統 ISP 低延時、高能效的特點進一步帶入到 AI 實時處理運算架構中,AI-ISP應運而生。AI-ISP架構結合兩者的優(yōu)勢,相當于給傳統ISP芯片加一個新的AI大腦。

據vivo介紹,在AI-ISP上集成vivo自研的AI計算單元,讓數據吞吐速率、能效比都有了大幅提升,更適合海量的信息處理,因此能實現發(fā)散式的信息處理及存儲,使得處理與存儲的效率大大提高。在此基礎上AI-NR降噪、HDR影調融合、MEMC插幀等算法效果可以得到極大的優(yōu)化。

2. 車載抬頭顯示HUD從“黑科技”走向標配,AR-HUD處于爆發(fā)前夜

原文:

https://mp.weixin.qq.com/s/TMhMjFZbw96n4CUkVQ_z1w

在高端乘用車完成試點以及認知普及之后,車載HUD(抬頭顯示系統)終于在2020年開始了規(guī)模商用,很多人將這一年定義為車載HUD的產業(yè)化元年。在智能駕駛汽車的推動下,HUD有望在乘用車搭載方面更進一步,成為系統標配,產業(yè)將迎來爆發(fā)期。

根據QYResearch的《2022-2028中國車載HUD系統市場現狀研究分析與發(fā)展前景預測報告》市場調研報道,2022年全球車載HUD市場規(guī)模有望達到22億美元,滲透率達到9.5%;到2025年,車載HUD滲透率有望達到45%,2019年-2025年的年復合增長率高達71%。

從C-HUD到AR-HUD

HUD的英文全稱是Head Up Display,所以中文譯作抬頭顯示系統,最早應用于軍用飛機上,幫助駕駛員減輕認知負荷。發(fā)展至今,車載HUD已經演化出三種形式,也完成了從C-HUD到AR-HUD的蛻變,另外一種是W-HUD。

C-HUD是指Combiner HUD,組合式抬頭顯示系統。C-HUD是將信息投放在儀表盤上方的樹脂板上,這是一個半透明的板子,能夠反射出投射信息的虛像。由于C-HUD需要樹脂板作為投放介質,因此往往會以后裝的方式安裝,這就導致C-HUD存在一些“先天性”的弊病,比如投射范圍小,距離近,且容易引發(fā)車禍時的二次傷害。

W-HUD是指Windshield HUD,屬于C-HUD的升級版,不再需要樹脂板這樣的輔助器材,如其名稱所顯露的,W-HUD直接將信息投放在汽車前擋風玻璃上。由于沒有介質板的限制,W-HUD的投射范圍更大、更遠。不過,由于汽車擋風玻璃的形狀是弧形、斜向的,增加了光學信息的投射難度,產品光學結構相對復雜,成本相對較高。

比W-HUD更進一步的便是AR-HUD,全稱為Augmented Reality HUD。顧名思義,AR-HUD便是AR技術在汽車領域的一次成功的應用嘗試。AR-HUD的投放介質同樣是汽車擋風玻璃,相較于W-HUD投放信息和道路實況是脫離的,AR-HUD通過數字微鏡原件生成圖像元素,經過反射鏡投射出去的圖片具有層次感,分為近投影和遠投影。其中近投影所包含的速度和油表信息與W-HUD差別不大,不過遠投影能夠實現虛擬圖像和現實路況的融合,增加駕駛員對道路信息的認知,使得駕駛更方便安全。

根據德州儀器的介紹和演示,如果要實現AR-HUD,VID>7米,并且FOV>10°。在遠投影方面,將融入跟車提醒、行人預警、車道偏離指引、變道指引等信息。

目前,在車載HUD市場上,W-HUD是市場主流,AR-HUD則是未來的趨勢,已經進入量產和推廣階段。不過,AR-HUD比W-HUD的光學系統更復雜,成本也就更高,因此最先搭載AR-HUD的車型大都價格不菲,以中高端車型為主。

產業(yè)上下游積極布局

無論是現階段的W-HUD,還是未來的AR-HUD,都受到了車廠的推崇,是汽車智能座艙重要的組成部分,也是汽車核心賣點之一。

從產業(yè)鏈分布來看,車載HUD的上游主要是原材料供應廠商和軟件方案公司,中游是各大車載HUD品牌商,下游則是整車廠。車載HUD所用到的原材料除了擋風玻璃和曲面鏡以外,最重要的還是顯示源,也就是光學系統。

車載HUD顯示源用到的主要芯片包括控制芯片、ISP芯片、DLP、LCD芯片、LCOS芯片等。供應商包括德州儀器、京東方、愛普生、非寶電子、索尼等企業(yè)。目前,W-HUD用到的主要激光顯示技術包括四種:DLP、LCD、LCOS以及MEMS激光投影。

在DLP方面,和全球數字放映機市場類似,TI在車載DLP芯片方面具有絕對的領先優(yōu)勢。該公司自2015年發(fā)布首款應用車載HUD的DLP芯片組之后,此后一直深耕于此,目前基于TI的DLP芯片組已經能夠實現AR-HUD方案。

LCD液晶投影技術具有圖像色彩飽和度好,層次豐富,色彩分離好等優(yōu)點,主要的核心技術掌握在索尼和愛普生手中,不過國內的京東方、天馬、信利等也在布局這一塊;LCOS是硅基液晶技術,索尼同樣是重要的技術提供商,此外還有JVC和晶典等。

MEMS激光投影是將RGB三基色激光模組與微機電系統結合的投影顯示技術,優(yōu)點是高亮度、體積小、色域廣,不過成本也相對較高。相較于其他顯示方案的核心技術握在國際廠商手里,MEMS激光投影被認為是自主品牌在車載HUD核心芯片突圍的好機會。目前,車規(guī)級MEMS激光投影芯片主要供應商是Microvision、豐寶電子等。

在品牌方面,目前W-HUD的主要市場份額主要掌握在外資品牌手中,包括電裝、日本精機、偉世通、德國大陸等,這些公司占據著國內外大部分的市場份額,并擁有成熟的前裝供應鏈體系,也具備前裝優(yōu)勢。當然,國內的汽車零部件生產商澤景電子、華陽集團、均勝電子等也在布局車載HUD。隨著AR-HUD進入量產階段,目前華為、歐菲光等科技企業(yè)以及未來黑科技、點石創(chuàng)新等初創(chuàng)企業(yè)迎來市場機遇。

據統計,2021年以來AR-HUD密集上車,長城摩卡、吉利星越L、大眾ID系列、廣汽傳祺GS8、北汽魔方、飛凡R7等車型均選擇搭載了AR-HUD,在2021年上半年,AR-HUD在國內的裝配量達到3.5萬輛,并且已經在2021年8月份超過了C-HUD。

對于國產廠商而言,想要突圍目前來看還是任重道遠。截止到2020年的統計數據顯示,國內車載HUD市場的前三大廠商均為國際廠商,分別是精機、大陸集團和電裝,市占比分別為33.3%、27%和20%。

寫在最后

目前,車載HUD正處在W-HUD向AR-HUD過渡的時代,國際Tier 1級汽車零部件供應商的話語權在降低,國產品牌迎來了機會,在核心器件和品牌方面都已經打入到市場中心區(qū)域。不過,汽車供應鏈一直以來都較為穩(wěn)定,國產品牌想要更進一步,還需在技術和產品性能上領先于人。

3. AI傳感器成為趨勢!功耗更低、效率更高

原文:

https://mp.weixin.qq.com/s/ElDo7m_fsbbp6rRUW99pYw

近日消息,劍橋初創(chuàng)公司InferSens表示,將其低功耗傳感器與復雜深度學習技術相結合,研究了用于智能建筑的低功耗邊緣AI傳感器。

InferSens使用具有本地AI模型和創(chuàng)新機械和系統工程的第三方處理器來為建筑環(huán)境創(chuàng)建智能傳感器。該公司傳感器技術的第一個版本計劃于2023年第一季度推出。這是一種低成本、電池供電的水流量和溫度傳感器,用于監(jiān)測和檢測水系統中的軍團菌風險。

意法半導體、索尼等傳統芯片廠商都推出AI傳感器

不久前,意法半導體也推出了內置智能傳感器處理單元 (ISPU) 的慣性傳感器ISM330ISN。ISM330ISN內置的智能技術賦能智能設備在傳感器中執(zhí)行高級運動檢測功能,而無需與外部微控制器 (MCU)交互,從而降低了系統級功耗。

意法半導體的方法是直接在傳感器芯片上集成為機器學習應用優(yōu)化的專用處理器 ISPU。意法半導體的 ISPU基于數字信號處理 (DSP) 架構,極其緊湊和節(jié)能,具有 40KB 的 RAM內存。ISPU 執(zhí)行單精度浮點運算,是設計機器學習應用和二元神經網絡的理想選擇。

這個智能內核占用的芯片面積非常小,因此,ISM330ISN模塊的封裝面積比典型的在封裝內整合MCU的傳感器解決方案小50%,功耗低 50%。

意法半導體模擬 MEMS 和傳感器產品部營銷總經理 Simone Ferri 表示,智能從前是部署在網絡邊緣的應用處理器上,而現在正在轉向深度邊緣的傳感器內部。ISM330ISN IMU 預示著新一類智能傳感器的來臨,即開始利用嵌入式 AI 處理復雜任務,比如模式識別和異常檢測,可以大大提高系統能效和性能。

其實早在2020年,索尼就宣布推出了兩款AI圖像傳感器——IMX500和IMX501。AI圖像傳感器兼具運算能力和內存,能夠在沒有額外硬件輔助的情況下執(zhí)行機器學習驅動的計算機視覺任務,可以使很多依賴機器學習算法的圖像處理技術能夠在本地運行,更簡單、高效、安全。

索尼推出的AI圖像傳感器,首批目標是零售商和工業(yè)客戶。索尼業(yè)務與創(chuàng)新副總裁馬克·漢森認為,相比將數據發(fā)送到云端的解決方案,AI圖像傳感器的應用潛力巨大,成本效益更高,尤其是在邊緣計算領域。

商湯、曠視等新興AI技術公司也在探索AI傳感器

除了傳統的傳感器廠商之外,商湯、曠視等AI公司也在探索AI傳感器。今年7月,商湯智能產業(yè)研究院發(fā)布《AI傳感器:智能手機影像新核心》白皮書。該白皮書提到,在智能手機市場緩慢步入瓶頸期的趨勢下,影像功能成為產業(yè)破局焦點,而AI軟件與CMOS圖像傳感器硬件的融合,將是智能手機影像能力持續(xù)提升的破題之道。

過去幾年,AI算法讓手機的影像能力得到了不小的提升。但在這種方案中,圖像傳感和AI算法的運行,在不同的硬件上完成,圖像傳感器提供圖像信號,處理器或者AI加速芯片執(zhí)行AI算法。這會造成能耗資源的浪費,并且難以處理一些需要及時響應的場景。

白皮書指出,融入了AI技術的CMOS圖像傳感器,可以最大化地發(fā)揮原始光信號的價值。

在設備獲取視覺信號的伊始,AI傳感器就可以進行優(yōu)化和處理,增強真實世界感知、提高圖像和視頻的質量、豐富內容細節(jié),同時最大限度地降低了設備功耗,并增強了數據安全性。

據介紹,早在2019年,商湯就與全球領先的圖像傳感器廠商開展緊密合作,將AI算法和傳感器硬件直接融合。目前,商湯AI傳感器已完成多款產品,并成功落地多款高端旗艦手機。

商湯認為,面向未來,AI傳感器的價值不僅在于提升智能手機的影像能力,它更將成為機器認知世界的基礎設施,為更多物聯網終端賦予智能感知與內容增強的能力。比如,在智能汽車領域,AI傳感器將成為車輛感知世界的核心部件;在智慧城市領域,AI傳感器更將為挖掘視頻信息的價值發(fā)揮重要作用。

曠視研究員范浩強今年7月也在某個論壇上談到,隨著AI、視覺算法等領域的發(fā)展,傳感器將不再單獨的、直接地提供應用價值,傳感器和應用之間需要算法來作為承上啟下的橋梁。從技術角度講,這兩者最顯著的結合點就是計算攝影。

曠視也已經深度參與手機影像的能力提升中,目前曠視的4K級別的硬件方案已經實現了量產,并積極推動8K AI畫質硬件方案的研發(fā)與產品化。

小結

從傳統芯片廠商及AI公司的表現來看,AI傳感器似乎成為一種新的趨勢。在傳感器內部增加智能的部分,有諸多好處,之前傳感器和AI算法的運行實在不同的硬件上完成,耗費資源,而增加了智能的AI傳感器,可以使得整個系統更簡單、更高效、更安全。

4. 掀起一股中國風,最強中文AI作畫大模型文心ERNIE-ViLG 2.0來了

原文:

https://mp.weixin.qq.com/s/x3dnkBF7BKDMEU_rt8QmDg

據了解,ERNIE-ViLG 2.0 在文本生成圖像公開權威評測集 MS-COCO 和人工盲評上均超越了 Stable Diffusion、DALL-E 2 等模型,取得了當前該領域的世界最好效果,在語義可控性、圖像清晰度、中國文化理解等方面均展現出了顯著優(yōu)勢。

論文鏈接:

https://arxiv.org/pdf/2210.15257.pdf

體驗鏈接:

https://wenxin.baidu.com/ernie-vilg

AIGC (AI-Generated Content) 是繼 UGC、PGC 之后,利用 AI 技術自動生成內容的新型生產方式。AI 作畫作為 AIGC 重要方向之一,蘊含了極大的產業(yè)應用價值。相比于人類創(chuàng)作者,AI 作畫展現出了創(chuàng)作成本低、速度快且易于批量化生產的巨大優(yōu)勢。

近一年來,該領域迅猛發(fā)展,國際科技巨頭和初創(chuàng)企業(yè)爭相涌入,國內也出現了眾多 AI 作畫產品,這些產品背后主要使用基于擴散生成算法的 DALL-E 2 和 Stable Diffusion 等國外模型。目前,這類基礎模型在國內尚處空白,ERNIE-ViLG 2.0 是國內首個在該方向取得突破的工作。

當前 AI 作畫技術在圖像細節(jié)紋理的流暢度、清晰度、語義的可控性等方面還存在諸多問題。基于此,百度提出了基于知識增強的混合降噪專家(Mixture-of-Denoising-Experts,MoDE)建模的跨模態(tài)大模型 ERNIE-ViLG 2.0,在訓練過程中,通過引入視覺知識和語言知識,提升模型跨模態(tài)語義理解能力與可控生成能力;在擴散降噪過程中,通過混合專家網絡建模,增強模型建模能力,提升圖像的生成質量。

我們先來欣賞下 ERNIE-ViLG 2.0 根據文本描述生成圖像的一些示例:

ERNIE-ViLG 2.0 可應用于工業(yè)設計、動漫設計、游戲制作、攝影藝術等場景,激發(fā)設計者創(chuàng)作靈感,提升內容生產的效率。通過簡單的描述,模型便可以在短短幾十秒內生成設計圖,極大地提升了設計效率、降低商業(yè)出圖的門檻。

5. DeepMind新作:無需權重更新、提示和微調,transformer在試錯中自主改進

原文:

https://mp.weixin.qq.com/s/zKQIlXJ1jRKCyGQn_dqjDw

論文地址:

https://arxiv.org/pdf/2210.14215.pdf

目前,Transformers 已經成為序列建模的強大神經網絡架構。預訓練 transformer 的一個顯著特性是它們有能力通過提示 conditioning 或上下文學習來適應下游任務。經過大型離線數據集上的預訓練之后,大規(guī)模 transformers 已被證明可以高效地泛化到文本補全、語言理解和圖像生成方面的下游任務。

最近的工作表明,transformers 還可以通過將離線強化學習(RL)視作順序預測問題,進而從離線數據中學習策略。Chen et al. (2021)的工作表明,transformers 可以通過模仿學習從離線 RL 數據中學習單任務策略,隨后的工作表明 transformers 可以在同領域和跨領域設置中提取多任務策略。這些工作都展示了提取通用多任務策略的范式,即首先收集大規(guī)模和多樣化的環(huán)境交互數據集,然后通過順序建模從數據中提取策略。這類通過模仿學習從離線 RL 數據中學習策略的方法被稱為離線策略蒸餾(Offline Policy Distillation)或策略蒸餾(Policy Distillation, PD)。

PD 具有簡單性和可擴展性,但它的一大缺點是生成的策略不會在與環(huán)境的額外交互中逐步改進。舉例而言,谷歌的通才智能體 Multi-Game Decision Transformers 學習了一個可以玩很多 Atari 游戲的返回條件式(return-conditioned)策略,而 DeepMind 的通才智能體 Gato 通過上下文任務推理來學習一個解決多樣化環(huán)境中任務的策略。遺憾的是,這兩個智能體都不能通過試錯來提升上下文中的策略。因此 PD 方法學習的是策略而不是強化學習算法。

在近日 DeepMind 的一篇論文中,研究者假設 PD 沒能通過試錯得到改進的原因是它訓練用的數據無法顯示學習進度。當前方法要么從不含學習的數據中學習策略(例如通過蒸餾固定專家策略),要么從包含學習的數據中學習策略(例如 RL 智能體的重放緩沖區(qū)),但后者的上下文大小(太小)無法捕獲策略改進。

研究者的主要觀察結果是,RL 算法訓練中學習的順序性在原則上可以將強化學習本身建模為一個因果序列預測問題。具體地,如果一個 transformer 的上下文足夠長,包含了由學習更新帶來的策略改進,那么它不僅應該可以表示一個固定策略,而且能夠通過關注之前 episodes 的狀態(tài)、動作和獎勵來表示一個策略改進算子。這樣開啟了一種可能性,即任何 RL 算法都可以通過模仿學習蒸餾成足夠強大的序列模型如 transformer,并將這些模型轉換為上下文 RL 算法。

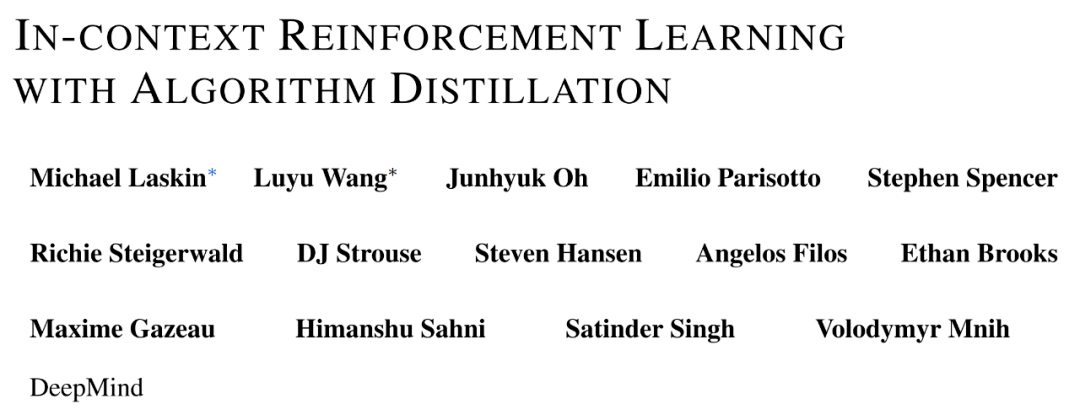

研究者提出了算法蒸餾(Algorithm Distillation, AD),這是一種通過優(yōu)化 RL 算法學習歷史中因果序列預測損失來學習上下文策略改進算子的方法。如下圖 1 所示,AD 由兩部分組成。首先通過保存 RL 算法在大量單獨任務上的訓練歷史來生成大型多任務數據集,然后 transformer 模型通過將前面的學習歷史用作其上下文來對動作進行因果建模。由于策略在源 RL 算法的訓練過程中持續(xù)改進,因此 AD 不得不學習改進算子以便準確地建模訓練歷史中任何給定點的動作。至關重要的一點是,transformer 上下文必須足夠大(即 across-episodic)才能捕獲訓練數據的改進。

研究者表示,通過使用足夠大上下文的因果 transformer 來模仿基于梯度的 RL 算法,AD 完全可以在上下文中強化新任務學習。研究者在很多需要探索的部分可觀察環(huán)境中評估了 AD,包括來自 DMLab 的基于像素的 Watermaze,結果表明 AD 能夠進行上下文探索、時序信度分配和泛化。此外,AD 學習到的算法比生成 transformer 訓練源數據的算法更加高效。

6. AI繪畫逆著玩火了,敢不敢發(fā)自拍看AI如何用文字形容你?

原文:

https://mp.weixin.qq.com/s/TlzktHflCHHmuXDRy4uPgg

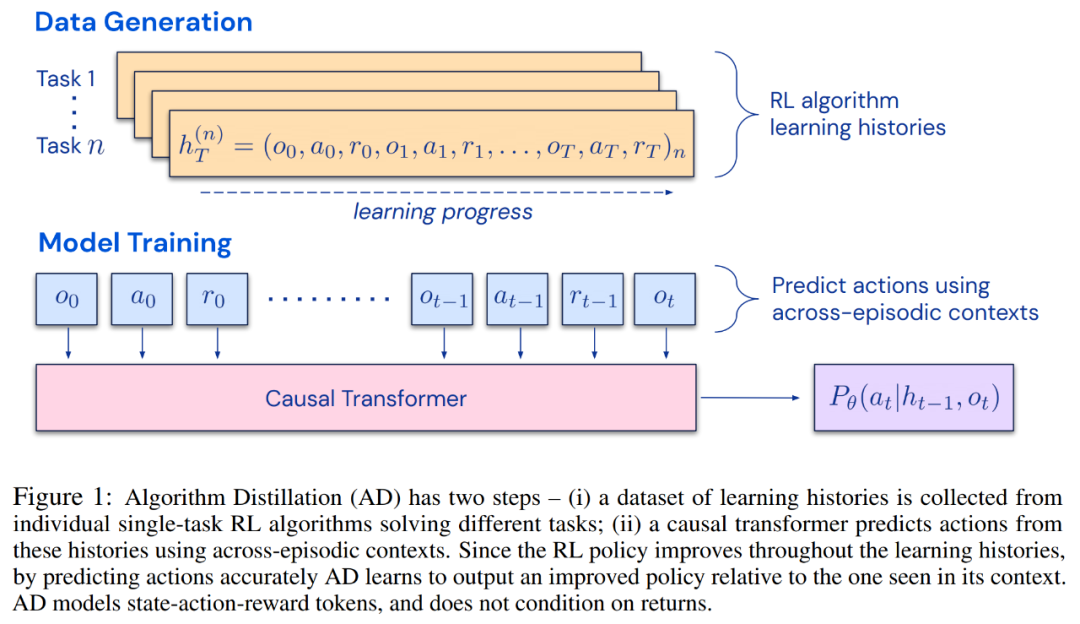

笑不活了家人們,最近突然流行起一個新玩法:給AI發(fā)自拍,看AI如何描述你。

比如這位勇敢曬出自拍的紐約大學助理教授,他的笑容在AI看來居然是“獸人式微笑”。

AI還吐槽他胡子沒有打理,但他表示拍照那天胡子要比平常整齊多了。

在評論區(qū)里還有一位也被評價為獸人微笑的網友現身。兩位“部落勇士”就這樣賽博認了個親。

上面這個玩法,相當于把最近火爆的AI繪畫逆過來玩,輸入圖片輸出文字描述。

負責文字描述的正是大名鼎鼎的CLIP,也就是DALL·E、Stable Diffusion等AI繪畫模型中負責理解語言的那部分。

目前這個CLIP Interrogator(CLIP審問官),在HuggingFace上已有現成的Demo可玩。

7. 《YOLOv5全面解析教程》一,網絡結構逐行代碼解析

原文:

https://mp.weixin.qq.com/s/qR2ODIMidsNR_Eznxry5pg

YOLOv5 網絡結構解析

引言

YOLOv5針對不同大小(n, s, m, l, x)的網絡整體架構都是一樣的,只不過會在每個子模塊中采用不同的深度和寬度,

分別應對yaml文件中的depth_multiple和width_multiple參數。

還需要注意一點,官方除了n, s, m, l, x版本外還有n6, s6, m6, l6, x6,區(qū)別在于后者是針對更大分辨率的圖片比如1280x1280,

當然結構上也有些差異,前者只會下采樣到32倍且采用3個預測特征層 , 而后者會下采樣64倍,采用4個預測特征層。

本章將以 yolov5s為例 ,從配置文件 models/yolov5s.yaml(https://github.com/Oneflow-Inc/one-yolov5/blob/main/models/yolov5s.yaml) 到 models/yolo.py(https://github.com/Oneflow-Inc/one-yolov5/blob/main/models/yolo.py) 源碼進行解讀。

yolov5s.yaml文件內容:

1nc:80#numberofclasses數據集中的類別數

2depth_multiple:0.33#modeldepthmultiple模型層數因子(用來調整網絡的深度)

3width_multiple:0.50#layerchannelmultiple模型通道數因子(用來調整網絡的寬度)

4#如何理解這個depth_multiple和width_multiple呢?它決定的是整個模型中的深度(層數)和寬度(通道數),具體怎么調整的結合后面的backbone代碼解釋。

5

6anchors:#表示作用于當前特征圖的Anchor大小為xxx

7#9個anchor,其中P表示特征圖的層級,P3/8該層特征圖縮放為1/8,是第3層特征

8-[10,13,16,30,33,23]#P3/8,表示[10,13],[16,30],[33,23]3個anchor

9-[30,61,62,45,59,119]#P4/16

10-[116,90,156,198,373,326]#P5/32

11

12

13#YOLOv5sv6.0backbone

14backbone:

15#[from,number,module,args]

16[[-1,1,Conv,[64,6,2,2]],#0-P1/2

17[-1,1,Conv,[128,3,2]],#1-P2/4

18[-1,3,C3,[128]],

19[-1,1,Conv,[256,3,2]],#3-P3/8

20[-1,6,C3,[256]],

21[-1,1,Conv,[512,3,2]],#5-P4/16

22[-1,9,C3,[512]],

23[-1,1,Conv,[1024,3,2]],#7-P5/32

24[-1,3,C3,[1024]],

25[-1,1,SPPF,[1024,5]],#9

26]

27

28#YOLOv5sv6.0head

29head:

30[[-1,1,Conv,[512,1,1]],

31[-1,1,nn.Upsample,[None,2,'nearest']],

32[[-1,6],1,Concat,[1]],#catbackboneP4

33[-1,3,C3,[512,False]],#13

34

35[-1,1,Conv,[256,1,1]],

36[-1,1,nn.Upsample,[None,2,'nearest']],

37[[-1,4],1,Concat,[1]],#catbackboneP3

38[-1,3,C3,[256,False]],#17(P3/8-small)

39

40[-1,1,Conv,[256,3,2]],

41[[-1,14],1,Concat,[1]],#catheadP4

42[-1,3,C3,[512,False]],#20(P4/16-medium)

43

44[-1,1,Conv,[512,3,2]],

45[[-1,10],1,Concat,[1]],#catheadP5

46[-1,3,C3,[1024,False]],#23(P5/32-large)

47

48[[17,20,23],1,Detect,[nc,anchors]],#Detect(P3,P4,P5)

49]

anchors 解讀

yolov5 初始化了 9 個 anchors,分別在三個特征圖 (feature map)中使用,每個 feature map 的每個 grid cell 都有三個 anchor 進行預測。分配規(guī)則:

-

尺度越大的 feature map 越靠前,相對原圖的下采樣率越小,感受野越小, 所以相對可以預測一些尺度比較小的物體(小目標),分配到的 anchors 越小。

-

尺度越小的 feature map 越靠后,相對原圖的下采樣率越大,感受野越大, 所以可以預測一些尺度比較大的物體(大目標),所以分配到的 anchors 越大。

-

即在小特征圖(feature map)上檢測大目標,中等大小的特征圖上檢測中等目標, 在大特征圖上檢測小目標。

backbone & head解讀

[from, number, module, args] 參數

四個參數的意義分別是:

1、第一個參數 from :從哪一層獲得輸入,-1表示從上一層獲得,[-1, 6]表示從上層和第6層兩層獲得。

2、第二個參數 number:表示有幾個相同的模塊,如果為9則表示有9個相同的模塊。

3、第三個參數 module:模塊的名稱,這些模塊寫在common.py中。

4、第四個參數 args:類的初始化參數,用于解析作為 moudle 的傳入參數。

下面以第一個模塊Conv 為例介紹下common.py中的模塊

更多的內容請點擊原文查看.

8. LeCun轉推,PyTorch GPU內存分配有了火焰圖可視化工具

原文:

https://mp.weixin.qq.com/s/_ChQM04s0900BDWhSBtwvg

近日,PyTorch 核心開發(fā)者和 FAIR 研究者 Zachary DeVito 創(chuàng)建了一個新工具(添加實驗性 API),通過生成和可視化內存快照(memory snapshot)來可視化 GPU 內存的分配狀態(tài)。這些內存快照記錄了內存分配的堆棧跟蹤以及內存在緩存分配器狀態(tài)中的位置。

接下來,通過將這些內存快照可視化為火焰圖(flamegraphs),內存的使用位置也就能一目了然地看到了。

圖靈獎得主 Yann Lecun 也轉推了這個工具。

下面我們來看這個工具的實現原理(以第一人稱「我們」描述)。

可視化快照

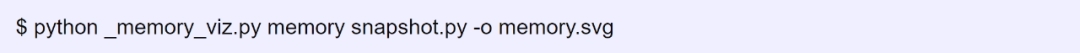

_memory_viz.py 工具也可以生成內存的可視化火焰圖。

可視化圖將分配器中所有的字節(jié)(byte)按不同的類來分割成段,如下圖所示(原文為可交互視圖)。

火焰圖可視化是一種將資源(如內存)使用劃分為不同類的方法,然后可以進一步細分為更細粒度的類別。

memory 視圖很好地展現了內存的使用方式。但對于具體地調試分配器問題,首先將內存分類為不同的 Segment 對象是有用的,而這些對象是分配軌跡的單個 cudaMalloc 段。

更多的使用方法,請參考原文!

END

-

RT-Thread

+關注

關注

31文章

1301瀏覽量

40265

原文標題:【AI簡報20221028】 vivo公布自研芯片、AR-HUD處于爆發(fā)前夜

文章出處:【微信號:RTThread,微信公眾號:RTThread物聯網操作系統】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

相關推薦

華為加持,汽車AR-HUD跑出“加速度”!哪些供應商值得關注?

華陽景深式3D AR-HUD首發(fā)CES 2025

AR-HUD再突破!蔚來ET9首發(fā)搭載“共軸光場”AR-HUD

德賽西威HUD技術日活動圓滿落幕

比亞迪最快于11月實現自研算法量產,推進智駕芯片自研進程

設計仿真 基于VTD的AR-HUD仿真測試解決方案

經緯恒潤AR HUD市占率躋身前五!

水晶光電榮獲HUD領域“卓越應用獎”

蘋果將通過自研芯片在云端推出AI功能

AR-HUD的主要優(yōu)勢有哪些?

微軟正在研發(fā)新型網卡,旨在提升自研AI芯片性能

英偉達缺貨?OpenAI選擇自研芯片

水晶光電車載前裝AR-HUD綜合實力位列前二

【AI簡報20221028】 vivo公布自研芯片、AR-HUD處于爆發(fā)前夜

【AI簡報20221028】 vivo公布自研芯片、AR-HUD處于爆發(fā)前夜

評論