Deeplabv3

Torchvision框架中在語(yǔ)義分割上支持的是Deeplabv3語(yǔ)義分割模型,而且支持不同的backbone替換,這些backbone替換包括MobileNetv3、ResNet50、ResNet101。其中MobileNetv3版本訓(xùn)練數(shù)據(jù)集是COCO子集,類別跟Pascal VOC的20個(gè)類別保持一致。這里以它為例,演示一下從模型導(dǎo)出ONNX到推理的全過(guò)程。ONNX格式導(dǎo)出

首先需要把pytorch的模型導(dǎo)出為onnx格式版本,用下面的腳本就好啦:

model=tv.models.segmentation.deeplabv3_mobilenet_v3_large(pretrained=True)

dummy_input=torch.randn(1,3,320,320)

model.eval()

model(dummy_input)

im=torch.zeros(1,3,320,320).to("cpu")

torch.onnx.export(model,im,

"deeplabv3_mobilenet.onnx",

verbose=False,

opset_version=11,

training=torch.onnx.TrainingMode.EVAL,

do_constant_folding=True,

input_names=['input'],

output_names=['out','aux'],

dynamic_axes={'input':{0:'batch',2:'height',3:'width'}}

)

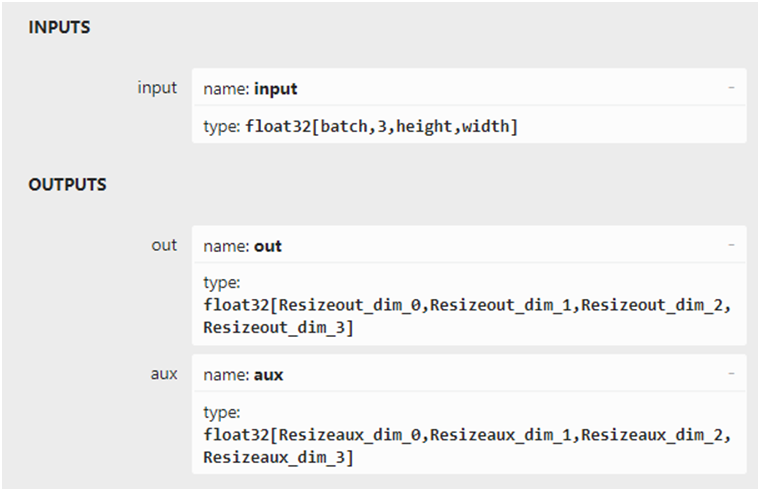

模型的輸入與輸出結(jié)構(gòu)如下:

推理測(cè)試

模型推理對(duì)圖像有個(gè)預(yù)處理,要求如下:

transform = torchvision.transforms.Compose([

torchvision.transforms.ToTensor(),

torchvision.transforms.Normalize(mean=[0.485, 0.456, 0.406],

std=[0.229, 0.224, 0.225])

])

意思是轉(zhuǎn)換為0~1之間的浮點(diǎn)數(shù),然后減去均值除以方差。

剩下部分的代碼就比較簡(jiǎn)單,初始化onnx推理實(shí)例,然后完成推理,對(duì)結(jié)果完成解析,輸出推理結(jié)果,完整的代碼如下:

transform=torchvision.transforms.Compose([

torchvision.transforms.ToTensor(),

torchvision.transforms.Normalize(mean=[0.485,0.456,0.406],

std=[0.229,0.224,0.225])

])

sess_options=ort.SessionOptions()

#Belowisforoptimizingperformance

sess_options.intra_op_num_threads=24

#sess_options.execution_mode=ort.ExecutionMode.ORT_PARALLEL

sess_options.graph_optimization_level=ort.GraphOptimizationLevel.ORT_ENABLE_ALL

ort_session=ort.InferenceSession("deeplabv3_mobilenet.onnx",providers=['CUDAExecutionProvider'],sess_options=sess_options)

#src=cv.imread("D:/images/messi_player.jpg")

src=cv.imread("D:/images/master.jpg")

image=cv.cvtColor(src,cv.COLOR_BGR2RGB)

blob=transform(image)

c,h,w=blob.shape

input_x=blob.view(1,c,h,w)

defto_numpy(tensor):

returntensor.detach().cpu().numpy()iftensor.requires_gradelsetensor.cpu().numpy()

#computeONNXRuntimeoutputprediction

ort_inputs={ort_session.get_inputs()[0].name:to_numpy(input_x)}

ort_outs=ort_session.run(None,ort_inputs)

t1=ort_outs[0]

t2=ort_outs[1]

labels=np.argmax(np.squeeze(t1,0),axis=0)

print(labels.dtype,labels.shape)

red_map=np.zeros_like(labels).astype(np.uint8)

green_map=np.zeros_like(labels).astype(np.uint8)

blue_map=np.zeros_like(labels).astype(np.uint8)

forlabel_numinrange(0,len(label_color_map)):

index=labels==label_num

red_map[index]=np.array(label_color_map)[label_num,0]

green_map[index]=np.array(label_color_map)[label_num,1]

blue_map[index]=np.array(label_color_map)[label_num,2]

segmentation_map=np.stack([blue_map,green_map,red_map],axis=2)

cv.addWeighted(src,0.8,segmentation_map,0.2,0,src)

cv.imshow("deeplabv3",src)

cv.waitKey(0)

cv.destroyAllWindows()

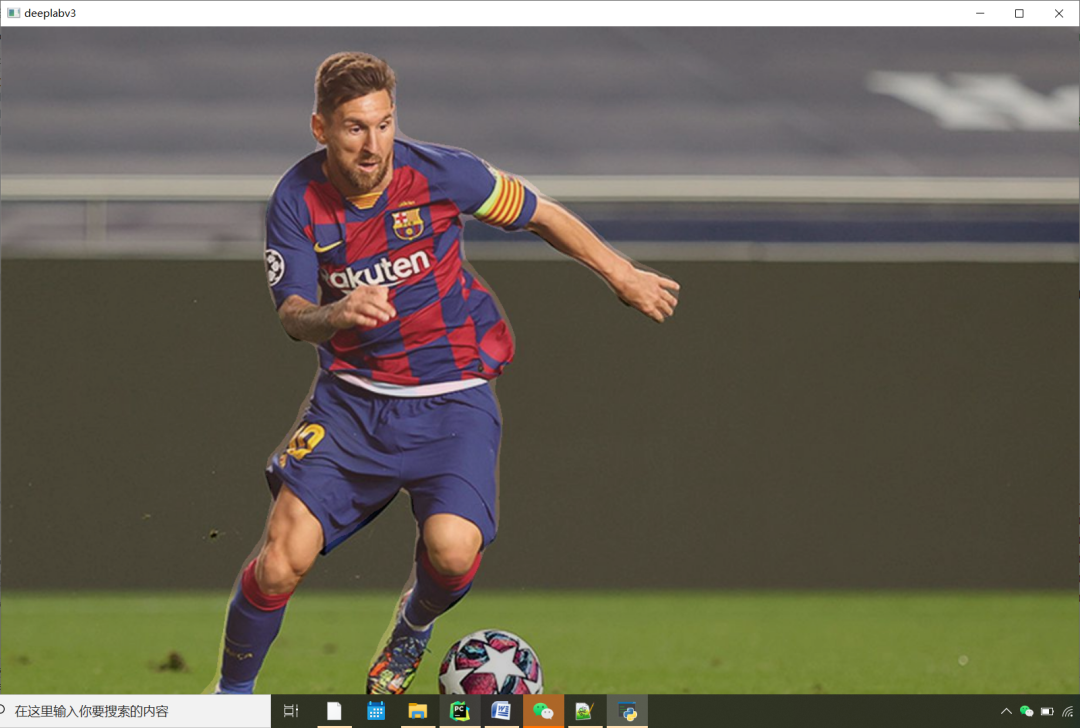

運(yùn)行結(jié)果如下:

審核編輯 :李倩

聲明:本文內(nèi)容及配圖由入駐作者撰寫或者入駐合作網(wǎng)站授權(quán)轉(zhuǎn)載。文章觀點(diǎn)僅代表作者本人,不代表電子發(fā)燒友網(wǎng)立場(chǎng)。文章及其配圖僅供工程師學(xué)習(xí)之用,如有內(nèi)容侵權(quán)或者其他違規(guī)問(wèn)題,請(qǐng)聯(lián)系本站處理。

舉報(bào)投訴

-

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1208瀏覽量

24737 -

pytorch

+關(guān)注

關(guān)注

2文章

808瀏覽量

13249

原文標(biāo)題:輕松學(xué)Pytorch之Deeplabv3推理

文章出處:【微信號(hào):CVSCHOOL,微信公眾號(hào):OpenCV學(xué)堂】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

利用Arm Kleidi技術(shù)實(shí)現(xiàn)PyTorch優(yōu)化

PyTorch 是一個(gè)廣泛應(yīng)用的開源機(jī)器學(xué)習(xí) (ML) 庫(kù)。近年來(lái),Arm 與合作伙伴通力協(xié)作,持續(xù)改進(jìn) PyTorch 的推理性能。本文將詳細(xì)介紹如何利用 Arm Kleidi 技術(shù)提升 Arm

vLLM項(xiàng)目加入PyTorch生態(tài)系統(tǒng),引領(lǐng)LLM推理新紀(jì)元

近日,vLLM項(xiàng)目宣布正式成為PyTorch生態(tài)系統(tǒng)的一部分,標(biāo)志著該項(xiàng)目與PyTorch的合作進(jìn)入了一個(gè)全新的階段。本文將從以下幾個(gè)方面進(jìn)行介紹,特別提醒:安裝方案在第四個(gè)部分,可選擇性閱讀

Arm KleidiAI助力提升PyTorch上LLM推理性能

生成式人工智能 (AI) 正在科技領(lǐng)域發(fā)揮關(guān)鍵作用,許多企業(yè)已經(jīng)開始將大語(yǔ)言模型 (LLM) 集成到云端和邊緣側(cè)的應(yīng)用中。生成式 AI 的引入也使得許多框架和庫(kù)得以發(fā)展。其中,PyTorch 作為

手冊(cè)上新 |迅為RK3568開發(fā)板NPU例程測(cè)試

測(cè)試

6.1 deeplabv3語(yǔ)義分割

6.2 lite_transformer

6.3 LPRNet車牌識(shí)別

6.4 mobilenet圖像分類

6.5 PPOCR-Rec文字識(shí)別

6.6

發(fā)表于 10-23 14:06

手冊(cè)上新 |迅為RK3568開發(fā)板NPU例程測(cè)試

測(cè)試

6.1 deeplabv3語(yǔ)義分割

6.2 lite_transformer

6.3 LPRNet車牌識(shí)別

6.4 mobilenet圖像分類

6.5 PPOCR-Rec文字識(shí)別

6.6

發(fā)表于 08-12 11:03

pytorch怎么在pycharm中運(yùn)行

第一部分:PyTorch和PyCharm的安裝 1.1 安裝PyTorch PyTorch是一個(gè)開源的機(jī)器學(xué)習(xí)庫(kù),用于構(gòu)建和訓(xùn)練神經(jīng)網(wǎng)絡(luò)。要在PyCharm中使用PyTorch,首先需

pycharm如何調(diào)用pytorch

引言 PyTorch是一個(gè)開源的機(jī)器學(xué)習(xí)庫(kù),廣泛用于計(jì)算機(jī)視覺、自然語(yǔ)言處理等領(lǐng)域。PyCharm是一個(gè)流行的Python集成開發(fā)環(huán)境(IDE),提供了代碼編輯、調(diào)試、測(cè)試等功能。將PyTorch

迅為RK3568手冊(cè)上新 | RK3568開發(fā)板NPU例程測(cè)試

deeplabv3語(yǔ)義分割

6.2 lite_transformer

6.3 LPRNet車牌識(shí)別

6.4 mobilenet圖像分類

6.5 PPOCR-Rec文字識(shí)別

6.6 PPOCR-Det語(yǔ)義分割

發(fā)表于 07-12 14:44

pytorch如何訓(xùn)練自己的數(shù)據(jù)

本文將詳細(xì)介紹如何使用PyTorch框架來(lái)訓(xùn)練自己的數(shù)據(jù)。我們將從數(shù)據(jù)準(zhǔn)備、模型構(gòu)建、訓(xùn)練過(guò)程、評(píng)估和測(cè)試等方面進(jìn)行講解。 環(huán)境搭建 首先,我們需要安裝PyTorch。可以通過(guò)訪問(wèn)PyTorch官網(wǎng)

PyTorch的介紹與使用案例

PyTorch是一個(gè)基于Python的開源機(jī)器學(xué)習(xí)庫(kù),它主要面向深度學(xué)習(xí)和科學(xué)計(jì)算領(lǐng)域。PyTorch由Meta Platforms(原Facebook)的人工智能研究團(tuán)隊(duì)開發(fā),并逐漸發(fā)展成為深度

tensorflow和pytorch哪個(gè)更簡(jiǎn)單?

PyTorch更簡(jiǎn)單。選擇TensorFlow還是PyTorch取決于您的具體需求和偏好。如果您需要一個(gè)易于使用、靈活且具有強(qiáng)大社區(qū)支持的框架,PyTorch可能是一個(gè)更好的選擇。如果您需要一個(gè)在

如何使用PyTorch建立網(wǎng)絡(luò)模型

PyTorch是一個(gè)基于Python的開源機(jī)器學(xué)習(xí)庫(kù),因其易用性、靈活性和強(qiáng)大的動(dòng)態(tài)圖特性,在深度學(xué)習(xí)領(lǐng)域得到了廣泛應(yīng)用。本文將從PyTorch的基本概念、網(wǎng)絡(luò)模型構(gòu)建、優(yōu)化方法、實(shí)際應(yīng)用等多個(gè)方面,深入探討使用PyTorch建

請(qǐng)問(wèn)電腦端Pytorch訓(xùn)練的模型如何轉(zhuǎn)化為能在ESP32S3平臺(tái)運(yùn)行的模型?

由題目,

電腦端Pytorch訓(xùn)練的模型如何轉(zhuǎn)化為能在ESP32S3平臺(tái)運(yùn)行的模型?

如何把這個(gè)Pytorch模型燒錄到ESP32S3上去?

發(fā)表于 06-27 06:06

大模型推理顯卡選購(gòu)指南:4090顯卡為何成為不二之選

開發(fā)者非常關(guān)注的話題。 現(xiàn)在市面上加速卡型號(hào)多如牛毛,但說(shuō)到適用大模型推理的顯卡,那4090顯卡絕對(duì)是現(xiàn)階段“推理王卡”般的存在。論性能不如H100,論價(jià)格不如3090,看似平平無(wú)奇的4090顯卡為何能在眾多競(jìng)爭(zhēng)者中脫穎而出,成為大模型

輕松學(xué)Pytorch之Deeplabv3推理

輕松學(xué)Pytorch之Deeplabv3推理

評(píng)論