大型語言模型能力驚人,但在部署過程中往往由于規(guī)模而消耗巨大的成本。華盛頓大學(xué)聯(lián)合谷歌云計算人工智能研究院、谷歌研究院針對該問題進(jìn)行了進(jìn)一步解決,提出了逐步蒸餾(Distilling Step-by-Step)范式幫助模型訓(xùn)練。該方法在訓(xùn)練用于特定任務(wù)的小型模型方面優(yōu)于 LLM,訓(xùn)練數(shù)據(jù)遠(yuǎn)少于傳統(tǒng)的微調(diào)和蒸餾。他們的 770M T5 模型在一個基準(zhǔn)任務(wù)上表現(xiàn)優(yōu)于 540B PaLM 模型。令人印象深刻的是,他們的模型只使用了可用數(shù)據(jù)的 80%。

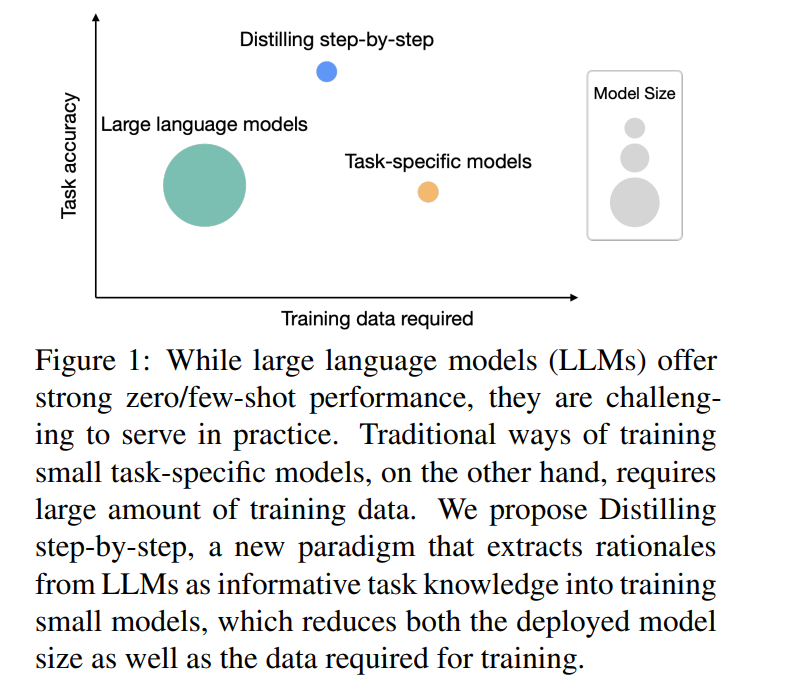

雖然大型語言模型(LLMs)展現(xiàn)了令人印象深刻的少樣本學(xué)習(xí)能力,但將這樣大規(guī)模的模型部署在現(xiàn)實應(yīng)用中是很難的。為 1750 億參數(shù)規(guī)模的 LLM 提供服務(wù)的專門基礎(chǔ)設(shè)施,至少需要 350GB 的 GPU 內(nèi)存。更甚者,現(xiàn)今最先進(jìn)的 LLM 是由超過 5000 億的參數(shù)組成的,這意味著它需要更多的內(nèi)存和計算資源。這樣的計算要求對于大多數(shù)生產(chǎn)商來說都是難以企及的,更何況是要求低延遲的應(yīng)用了。

為了解決大型模型的這個問題,部署者往往采用小一些的特定模型來替代。這些小一點(diǎn)的模型用常見范式 —— 微調(diào)或是蒸餾來進(jìn)行訓(xùn)練。微調(diào)使用下游的人類注釋數(shù)據(jù)升級一個預(yù)訓(xùn)練過的小模型。蒸餾用較大的 LLM 產(chǎn)生的標(biāo)簽訓(xùn)練同樣較小的模型。但是很遺憾,這些范式在縮小模型規(guī)模的同時也付出了代價:為了達(dá)到與 LLM 相當(dāng)?shù)男阅埽⒄{(diào)需要昂貴的人類標(biāo)簽,而蒸餾需要大量很難獲得的無標(biāo)簽數(shù)據(jù)。

在一篇題為「Distilling Step-by-Step! Outperforming Larger Language Models with Less Training Data and Smaller Model Sizes」的論文中,來自華盛頓大學(xué)、谷歌的研究者引入了一種新的簡單機(jī)制 —— 逐步蒸餾(Distilling step-bystep),用于使用更少的訓(xùn)練數(shù)據(jù)來訓(xùn)練更小的模型。這種機(jī)制減少了微調(diào)和蒸餾 LLM 所需的訓(xùn)練數(shù)據(jù)量,使之有更小的模型規(guī)模。

論文鏈接:https://arxiv.org/pdf/2305.02301v1.pdf

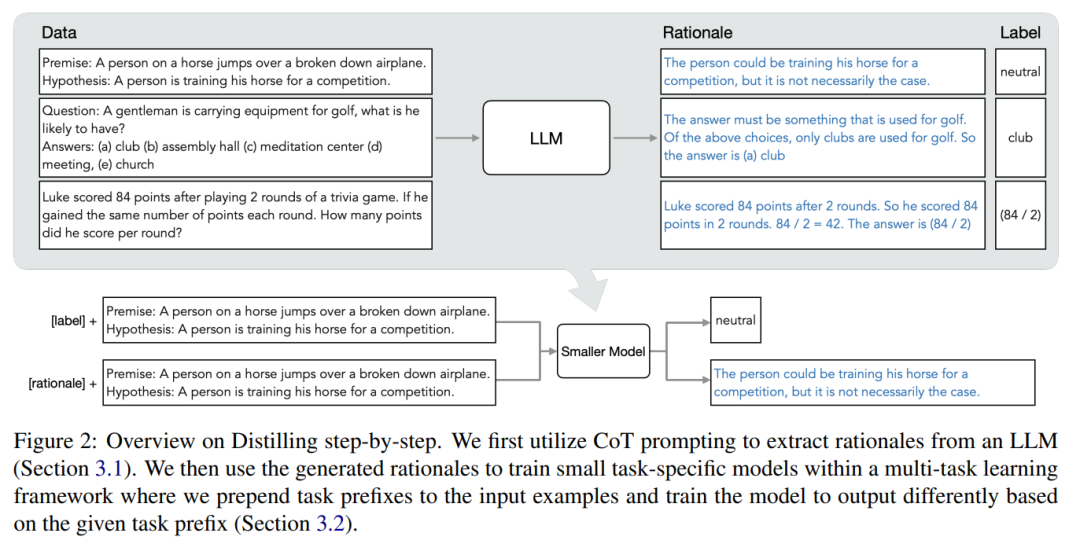

該機(jī)制的核心是換一種角度,將 LLM 看作是可以推理的 agent,而不是噪聲標(biāo)簽的來源。LLM 可以產(chǎn)生自然語言的理由(rationale),這些理由可以用來解釋和支持模型所預(yù)測的標(biāo)簽。例如,當(dāng)被問及「一位先生攜帶著打高爾夫球的設(shè)備,他可能有什么?(a) 球桿,(b) 禮堂,(c) 冥想中心,(d) 會議,(e) 教堂」,LLM 可以通過思維鏈(CoT)推理回答出「(a)球桿」,并通過說明「答案一定是用來打高爾夫球的東西」來合理化這個標(biāo)簽。在上述選擇中,只有球桿是用來打高爾夫的。研究者使用這些理由作為額外更豐富的信息在多任務(wù)訓(xùn)練設(shè)置中訓(xùn)練較小的模型,并進(jìn)行標(biāo)簽預(yù)測和理由預(yù)測。

如圖 1 所示,逐步蒸餾可以學(xué)習(xí)特定任務(wù)的小模型,這些模型的參數(shù)量還不到 LLM 的 1/500。與傳統(tǒng)的微調(diào)或蒸餾相比,逐步蒸餾使用的訓(xùn)練示例要也少得多。

實驗結(jié)果顯示,在 4 個 NLP 基準(zhǔn)中,有三個有希望的實驗結(jié)論。

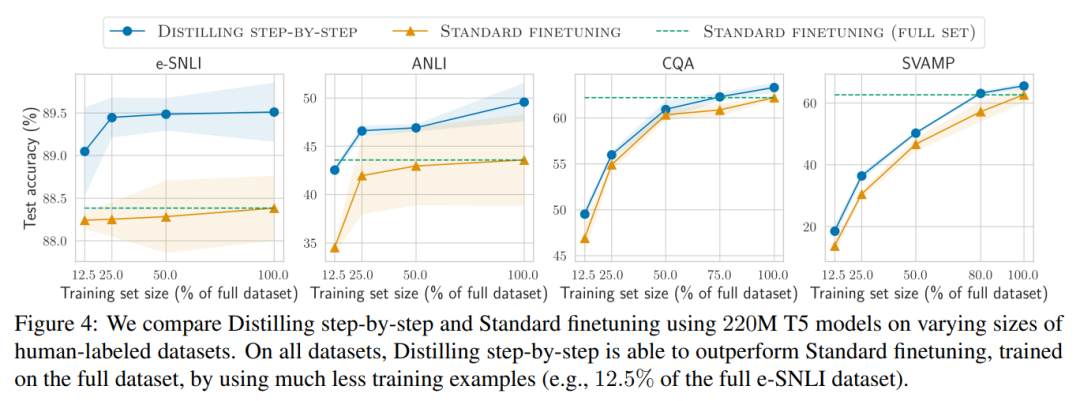

第一,相對于微調(diào)和蒸餾,逐步蒸餾模型在各數(shù)據(jù)集上實現(xiàn)了更好的性能,平均減少了 50% 以上的訓(xùn)練實例(最多可減少 85% 以上)。

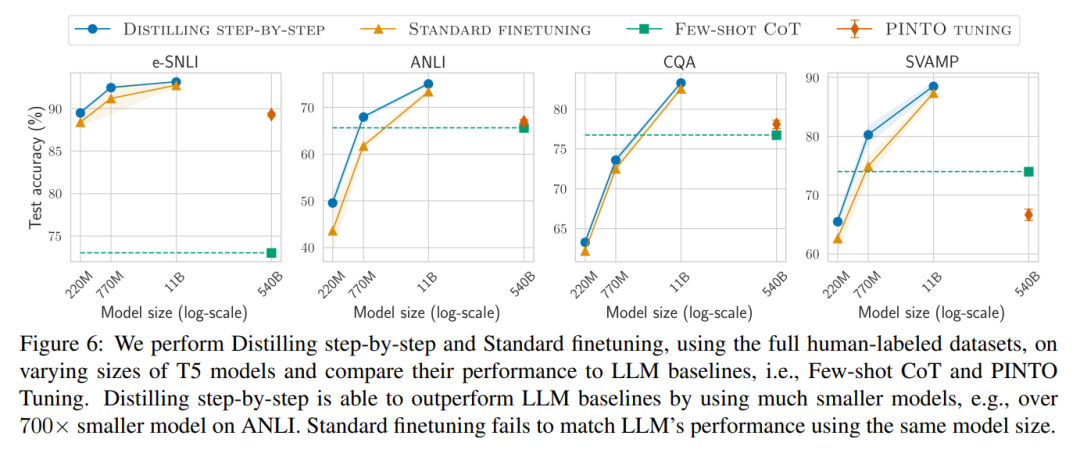

第二,我們的模型在模型尺寸更小的情況下表現(xiàn)優(yōu)于 LLM(最多可以小到 2000 倍),極大地降低了模型部署所需的計算成本。

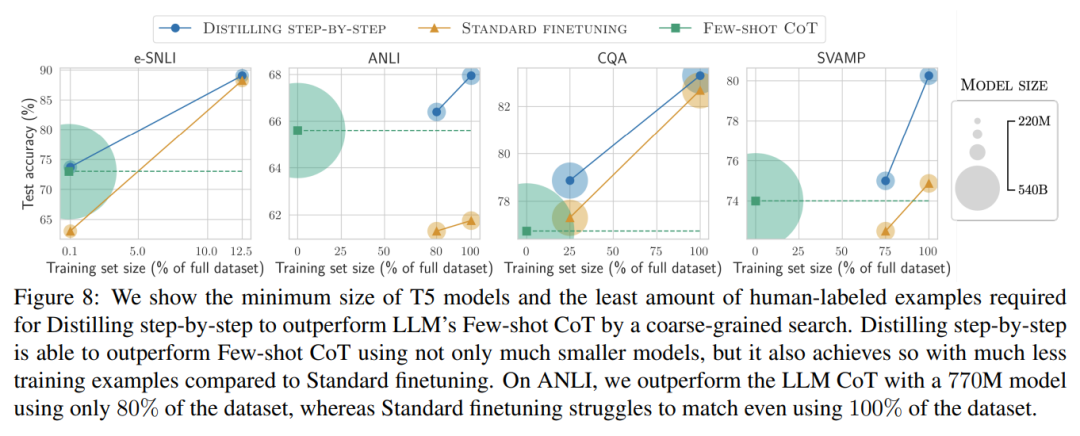

第三,該研究在縮減模型尺寸的同時,也減少了超越 LLM 所需要的數(shù)據(jù)量。研究者使用一個 770M 的 T5 模型超越了 540B 參數(shù)的 LLM 的性能。這個較小的模型只使用了現(xiàn)有微調(diào)方法 80% 的標(biāo)記數(shù)據(jù)集。

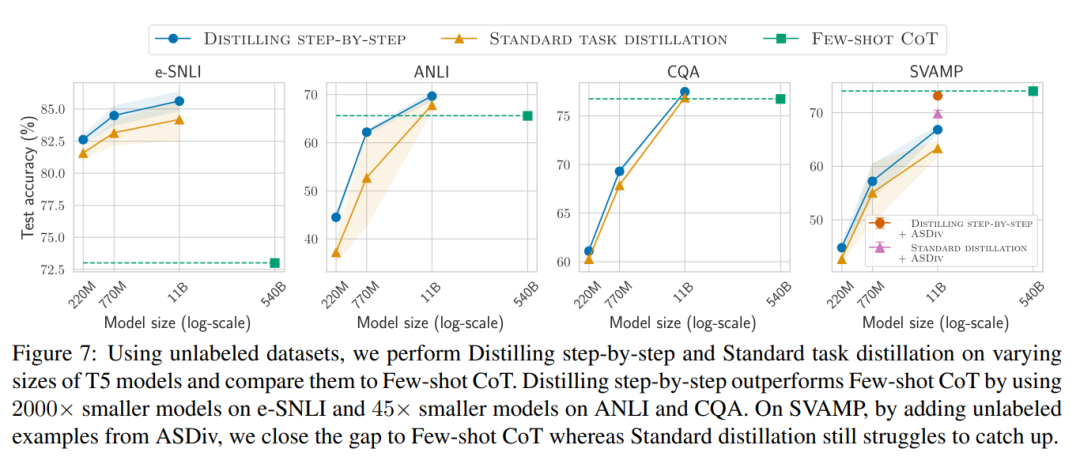

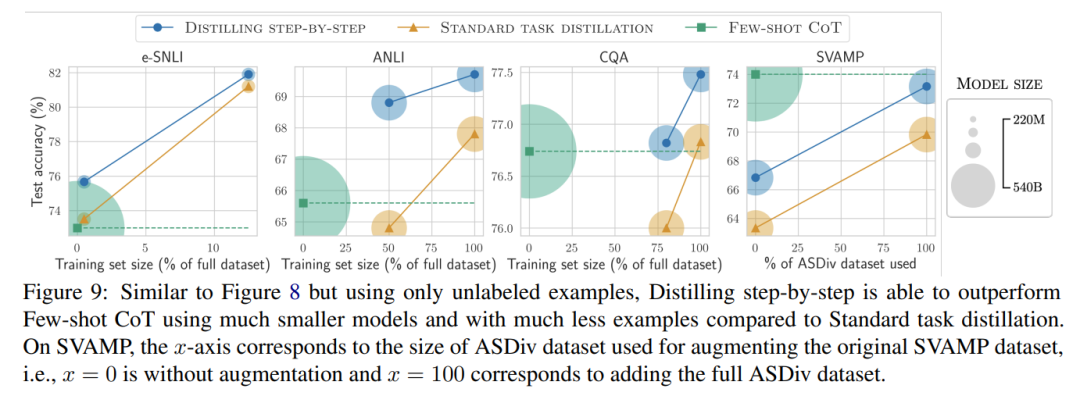

當(dāng)只有未標(biāo)記的數(shù)據(jù)時,小模型的表現(xiàn)相比 LLM 而言仍然有過之而無不及 —— 只用一個 11B 的 T5 模型就超過了 540B 的 PaLM 的性能。

該研究進(jìn)一步表明,當(dāng)一個較小的模型表現(xiàn)比 LLM 差時,與標(biāo)準(zhǔn)的蒸餾方法相比,逐步蒸餾可以更有效地利用額外的無標(biāo)簽數(shù)據(jù)來使較小的模型媲美 LLM 的性能。

逐步蒸餾

研究者提出了逐步蒸餾這個新范式,是利用 LLM 對其預(yù)測的推理能力,以數(shù)據(jù)高效率的方式訓(xùn)練更小的模型。整體框架如圖 2 所示。

該范式有兩個簡單的步驟:首先,給定一個 LLM 和一個無標(biāo)簽的數(shù)據(jù)集,提示 LLM 生成輸出標(biāo)簽以及證明該標(biāo)簽成立的理由。理由用自然語言解釋,為模型預(yù)測的標(biāo)簽提供支持(見圖 2)。理由是當(dāng)前自監(jiān)督 LLM 的一個涌現(xiàn)的行為屬性。

然后,除了任務(wù)標(biāo)簽之外,利用這些理由來訓(xùn)練更小的下游模型。說白了,理由能提供了更豐富、更詳細(xì)的信息,來說明一個輸入為什么被映射到一個特定的輸出標(biāo)簽。

實驗結(jié)果

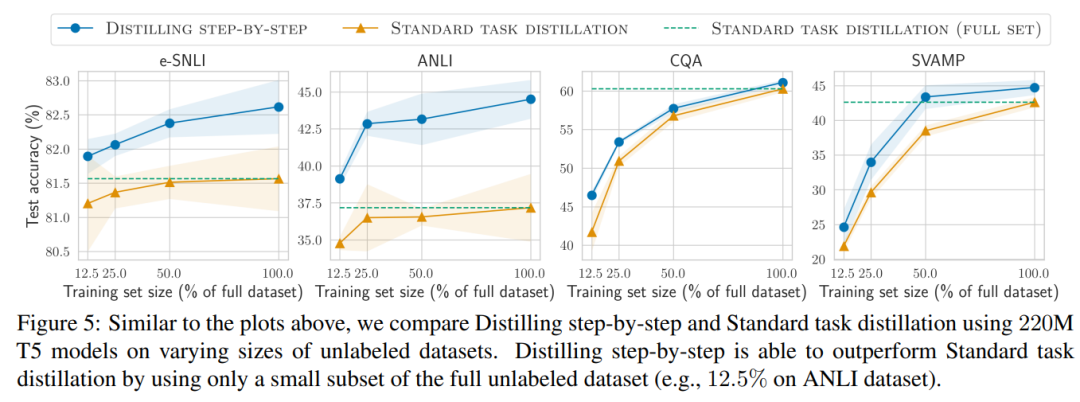

研究者在實驗中驗證了逐步蒸餾的有效性。首先,與標(biāo)準(zhǔn)的微調(diào)和任務(wù)蒸餾方法相比,逐步蒸餾有助于實現(xiàn)更好的性能,訓(xùn)練實例的數(shù)量少得多,大幅提高了學(xué)習(xí)小型特定任務(wù)模型的數(shù)據(jù)效率。

其次,研究表明,逐步蒸餾方法以更小的模型大小超越了 LLM 的性能,與 llm 相比,大大降低了部署成本。

最后,研究者調(diào)查了逐步蒸餾方法在超過 LLM 的性能方面所需的最低資源,包括訓(xùn)練示例數(shù)量和模型大小。他們展示了逐步蒸餾方法通過使用更少的數(shù)據(jù)和更小的模型,同時提高了數(shù)據(jù)效率和部署效率。

審核編輯 :李倩

-

人工智能

+關(guān)注

關(guān)注

1791文章

47279瀏覽量

238513 -

語言模型

+關(guān)注

關(guān)注

0文章

524瀏覽量

10277 -

自然語言

+關(guān)注

關(guān)注

1文章

288瀏覽量

13350

原文標(biāo)題:蒸餾也能Step-by-Step:新方法讓小模型也能媲美2000倍體量大模型

文章出處:【微信號:tyutcsplab,微信公眾號:智能感知與物聯(lián)網(wǎng)技術(shù)研究所】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

Altium19 3D STEP模型的導(dǎo)出

Kicad6.0導(dǎo)出step模型遇到無法導(dǎo)出元件的問題

STEP與WRL 3D模型的區(qū)別

keras順序模型與函數(shù)式模型

如何使用STEP-BY-STEP在KEIL5中建立TM4C1294項目

STM32 Step-by-Step如何加快開發(fā)速度

Altium Designer導(dǎo)出3D STEP模型的方法

南開/南理工/曠視提出CTKD:動態(tài)溫度超參蒸餾新方法

基于一步步蒸餾(Distilling step-by-step)機(jī)制

大模型應(yīng)用Step-By-Step

蒸餾也能Step-by-Step:新方法讓小模型也能媲美2000倍體量大模型

蒸餾也能Step-by-Step:新方法讓小模型也能媲美2000倍體量大模型

評論