自動測試分數達到ChatGPT的99.3%,人類難以分辨兩者的回答……

這是開源大模型最新成果,來自羊駝家族的又一重磅成員——華盛頓大學原駝(Guanaco)。

更關鍵的是,與原駝一起提出的新方法QLoRA把微調大模型的顯存需求從>780GB降低到<48GB。

開源社區直接開始狂歡,相關論文成為24小時內關注度最高的AI論文。

以Meta的美洲駝LLaMA為基礎,得到原駝650億參數版只需要48GB顯存單卡微調24小時,330億參數版只需要24GB顯存單卡微調12小時。

24GB顯存,也就是一塊消費級RTX3090或RTX4090顯卡足以。

不少網友在測試后也表示,更喜歡它而不是ChatGPT。

英偉達科學家Jim Fan博士對此評價為:大模型小型化的又一里程碑。

先擴大規模再縮小,將成為開源AI社區的節奏。

而新的高效微調方法QLoRA迅速被開源社區接受,HuggingFace也在第一時間整合上線了相關代碼。

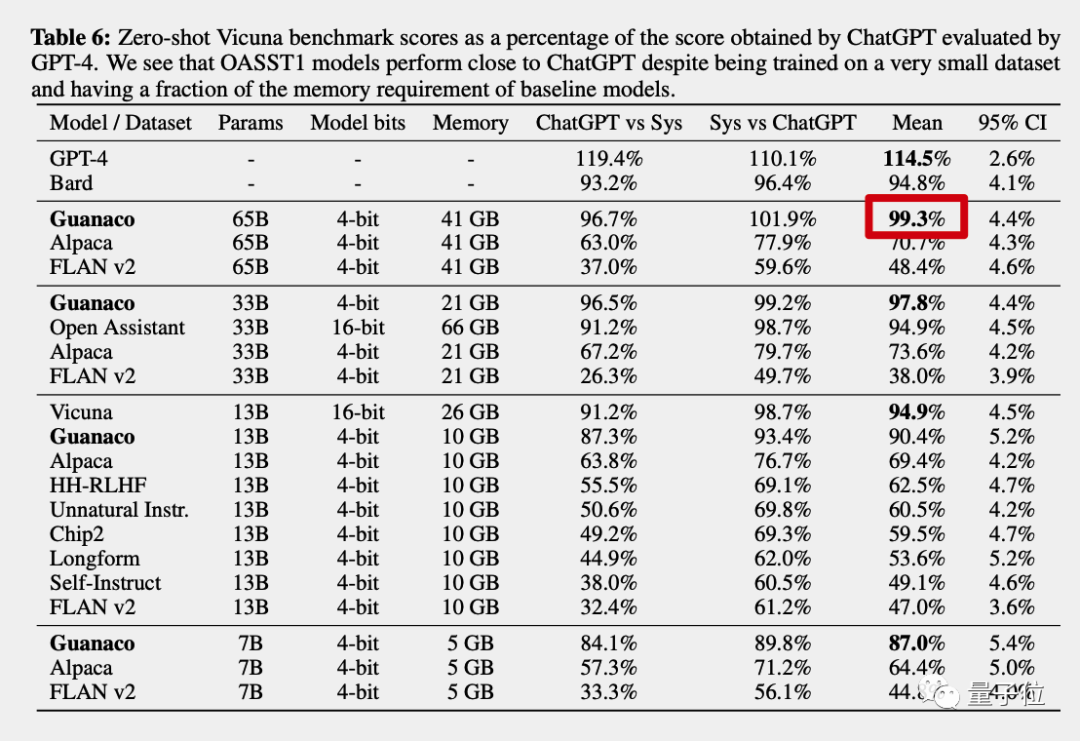

GPT-4做裁判,原駝得分達到ChatGPT的99.3%

論文中,團隊對原駝總共做了三項測試,自動評估、隨機匹配和人類評估。

測試數據來自小羊駝Vicuna和Open Assistant。

自動評估由大模型天花板GPT-4當裁判,對不同模型的回答進行打分,以ChatGPT(GPT3.5)的成績作為100%。

最終原駝650億版得分達到ChatGPT的99.3%,而GPT-4自己的得分是114.5%,谷歌Bard是94.8%。

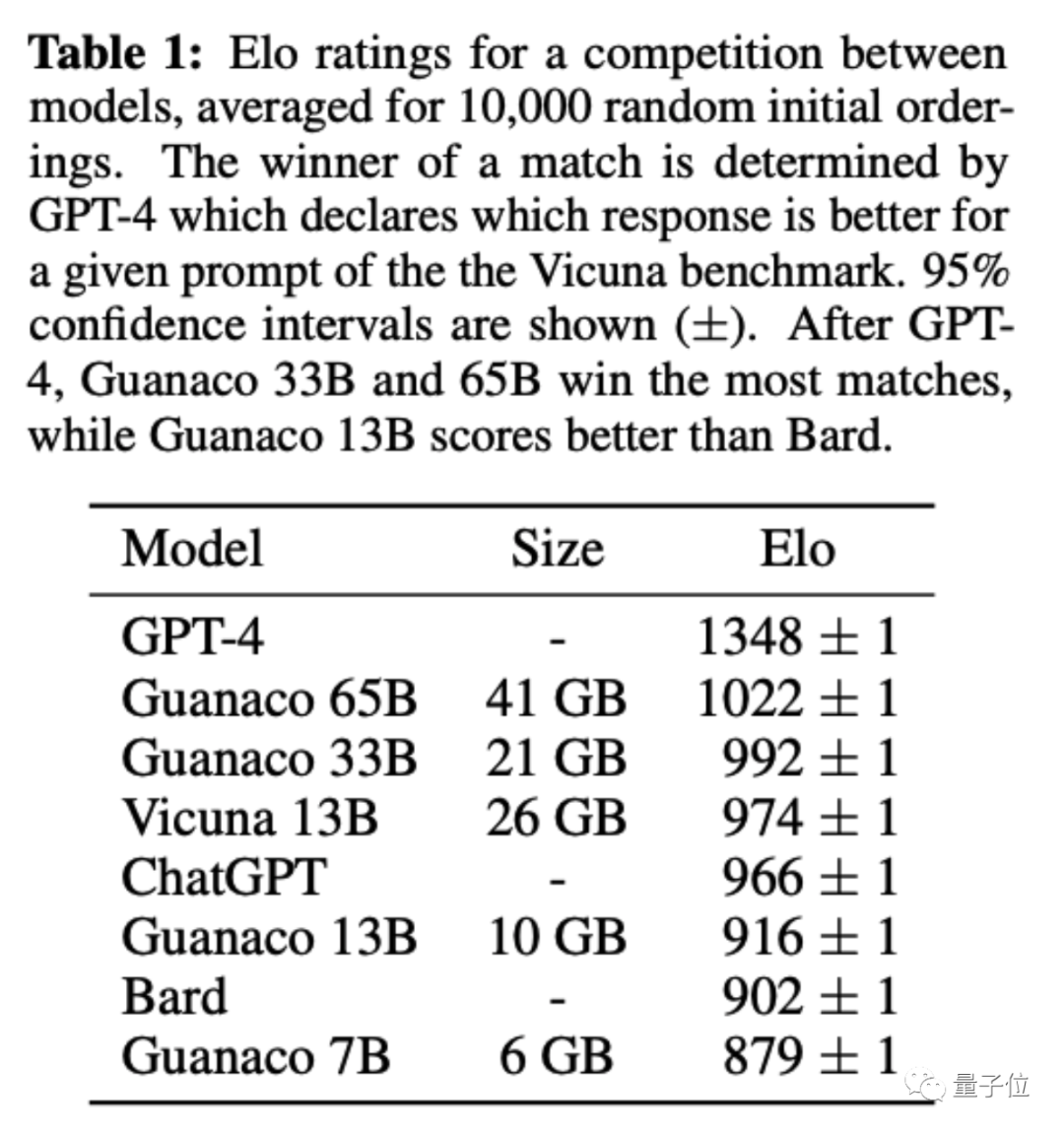

隨機匹配,采用棋類專業比賽和電子競技同款的Elo記分機制,由GPT-4和人類共同做裁判。

原駝650億和330億版最終得分超過ChatGPT(GPT3.5)。

人類評估,則是把原駝650億版的回答和ChatGPT的回答匿名亂序放在一起,人類來盲選哪個最好。

論文共同一作表示,研究團隊里的人都很難分辨出來,并把測試做成了一個小游戲放在Colab上,開放給大家挑戰。

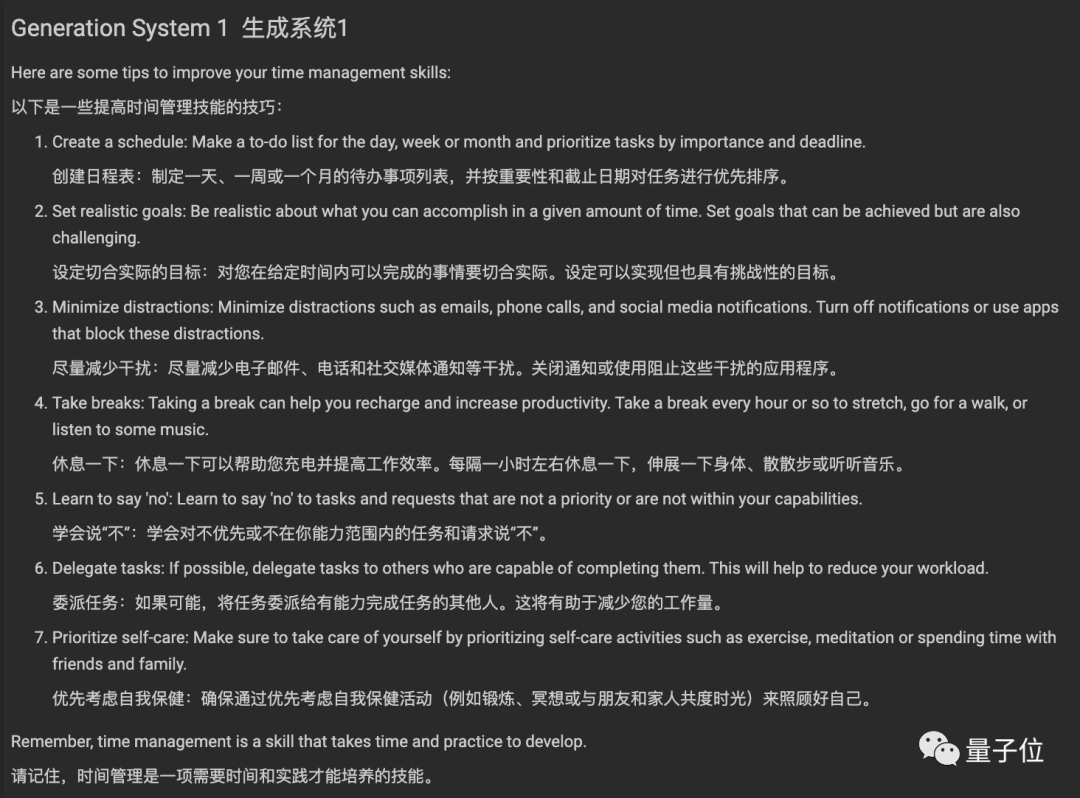

這里節選其中一個問題(附中文翻譯),你能分辨出哪個是ChatGPT回答的嗎?

問題:How can I improve my time management skills?(如何提高時間管理技能?)

總的來說,原駝的優勢在于不容易被問題中的錯誤信息誤導,比如能指出地球從來沒有被科學界認為是平的。

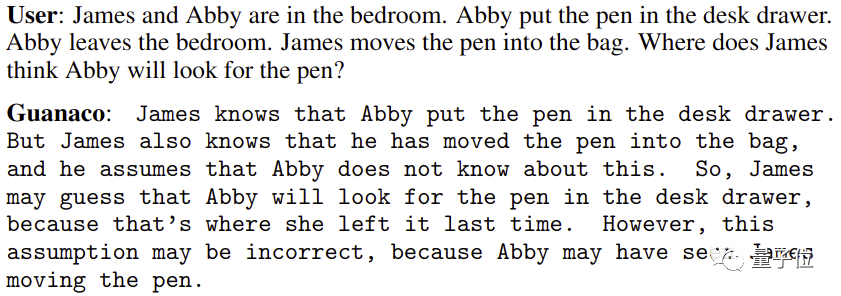

以及擅長心智理論(Theory of Mind),也就是能推測理解他人的心理狀態。

但原駝也并非沒有弱點,團隊發發現它不太擅長數學,以及容易用提示注入攻擊把要求保密的信息從它嘴里套出來。

也有網友表示,雖然一個模型能在某個數據集上無限接近ChatGPT,但像ChatGPT那樣通用還是很難的。

全新方法QLoRA,iPhone都能微調大模型了

原駝論文的核心貢獻是提出新的微調方法QLoRA。

其中Q代表量化(Quantization),用低精度數據類型去逼近神經網絡中的高精度浮點數,以提高運算效率。

LoRA是微軟團隊在2021年提出的低秩適應(Low-Rank Adaptation)高效微調方法,LoRA后來被移植到AI繪畫領域更被大眾熟知,但最早其實就是用于大語言模型的。

通常來說,LoRA微調與全量微調相比效果會更差,但團隊將LoRA添加到所有的線性層解決了這個問題。

具體來說,QLoRA結合了4-bit量化和LoRA,以及團隊新創的三個技巧:新數據類型4-bit NormalFloat、分頁優化器(Paged Optimizers)和雙重量化(Double Quantization)。

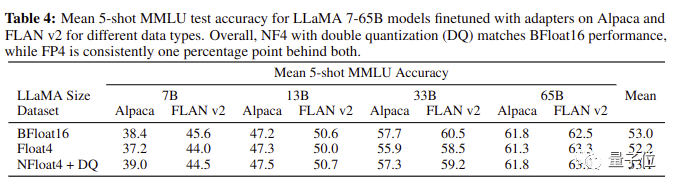

最終QLoRA讓4-bit的原駝在所有場景和規模的測試中匹配16-bit的性能。

QLoRA的高效率,讓團隊在華盛頓大學的小型GPU集群上每天可以微調LLaMA 100多次……

最終使用Open Assistant數據集微調的版本性能勝出,成為原駝大模型。

Open Assistant數據集來自非盈利研究組織LAION(訓練Stable Diffusion的數據集也來自這里),雖然只有9000個樣本但質量很高,經過開源社區的人工仔細驗證。

這9000條樣本用于微調大模型,比100萬條指令微調(Instruction Finetune)樣本的谷歌FLAN v2效果還好。

研究團隊也據此提出兩個關鍵結論:

指令微調有利于推理,但不利于聊天

最后,QLoRA的高效率,還意味著可以用在手機上,論文共同一作Tim Dettmers估計以iPhone 12 Plus的算力每個晚上能微調300萬個單詞的數據量。

這意味著,很快手機上的每個App都能用上專用大模型。

責任編輯:彭菁

-

iPhone

+關注

關注

28文章

13470瀏覽量

201865 -

顯存

+關注

關注

0文章

110瀏覽量

13673 -

模型

+關注

關注

1文章

3254瀏覽量

48881

原文標題:開源「原駝」爆火,iPhone都能微調大模型了,得分逼近ChatGPT!

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

iPhone X Plus和iPhone 9的最新消息模型機和保護殼的體驗

蘋果新款iPhone X Plus和LCD iPhone的機器模型泄露

文本分類任務的Bert微調trick大全

使用NVIDIA TAO工具包和Appen實現AI模型微調

有哪些省內存的大語言模型訓練/微調/推理方法?

調教LLaMA類模型沒那么難,LoRA將模型微調縮減到幾小時

中軟國際參加首期百度智能云文心千帆大模型SFT微調能力實訓營

OpenAI開放大模型微調功能 GPT-3.5可以打造專屬ChatGPT

OpenAI開放大模型微調功能!

盤古大模型3.0是什么?

一種新穎的大型語言模型知識更新微調范式

基于雙級優化(BLO)的消除過擬合的微調方法

iPhone都能微調大模型了嘛

iPhone都能微調大模型了嘛

評論