電子發燒友網報道(文/李彎彎)在剛過去的2023世界人工智能大會上,大模型可以說是其中的大亮點之一,華為盤古、商湯日日新、網易伏羲等30多款國產AI大模型集中亮相。與此同時,各類人工智能芯片公司、算力提供商也針對大模型展示了相應的方案。

大模型時代,國產AI芯片進展如何?

在這次大會上,瀚博半導體、燧原科技、登臨科技、天數智芯等紛紛展示了針對大模型的產品方案,呈現出國產AI芯片在大模型領域的進展情況。

瀚博半導體成立于2018年12月,是一家自研GPU芯片及解決方案提供商。在此次大會上,瀚博發布了第二代GPU SG100,并推出南禺系列GPU加速卡VG1600、VG1800、VG14,以及LLM大模型AI加速卡VA1L、AIGC大模型一體機、VA12高性能生成式AI加速卡等6款新品。

據介紹,瀚博SG100芯片采用7nm先進制程,具備業界領先的渲染性能,同時兼具低延時高吞吐的AI算力和強大的視頻處理能力。

值得關注的,針對大模型時代算力需求,瀚博本次首發了LLM大模型AI加速卡VA1L,具備200 TOPS INT8/72 TFLOPS FP16算力,并支持ChatGPT、LLaMA、Stable Diffusion等主流AIGC網絡模型。

與此同時,瀚博此次還推出了AIGC大模型一體機,共使用8張LLM大模型AI加速卡VA1L,支持512GB顯存,進而支持1750億參數的大模型。

另外,作為瀚博VA1和VA10的升級版,VA12是一塊通用AI加速卡,支持檢測、分類、分割、視頻增強、語義理解、BERT、Transfomer和視頻編解碼等應用。

燧原科技在此次大會上發布了燧原曜圖文生圖MaaS平臺服務產品。該產品以燧原科技“邃思”系列芯片為算力支撐,由首都在線提供計算服務,燧原曜圖MaaS平臺服務產品為用戶提供面向AIGC時代的高效易用、安全可靠、企業級的文生圖服務。

燧原科技表示,它具備開箱即用可用、所想即所見、創意無限的文本生成圖像能力,通過軟硬一體方案降低大規模AIGC應用的工程難度與算力成本,開啟AIGC應用規模化落地時代。

燧原科技創始人兼CEO趙立東在某論壇上提到,目前燧原已經為大型科研機構部署了千卡規模的AI訓練算力集群,并成功落地;而且與騰訊合作,在OCR文字識別、智能交互、智能會議等方面,性能達到了業界同類產品兩倍以上,性價比上具有很高優勢。此外,在智慧城市方面,燧原完成2022年成都高新區國產化AI視頻基礎設施平臺項目建設。

此次大會上,登臨科技展示了最新一代創新通用GPU產品Goldwasser II系列以及基于開源大語言模型可交互界面。據了解,Goldwasser II針對基于Transformer和生成式AI 大模型進行專門優化,在性能有大幅提升,已于2022年流片,目前已開始規模化量產和商業客戶驗證。據現有客戶測試結果,二代產品針對基于transformer類型的模型提供3-5倍的性能提升,大幅降低類ChatGPT及生成式AI應用的硬件成本。

天數智芯在此次會上也展示了在大模型訓練、推理所取得的顯著進展,包括圖片識別/以圖搜圖、3D建模、大模型推理等。在大模型領域,天數智芯今年上半年,搭建了40P算力320張天垓100加速卡算力集群,完成智源研究院70億參數大模型全量訓練,

天垓100是天數智芯2018年研發的通用AI訓練芯片,據天數智芯董事長蓋魯江介紹,目前天垓100這款產品還已經成功跑通了清華智譜 AI 大模型ChatGLM,Meta研發的LLaMA模型。此外,天數智芯正在幫智源研究院跑650億參數的模型,預計10月份可以跑完。

針對于A800芯片在無許可證的情況下將被禁售的話題,蓋魯江談到,事實上,不管英偉達的產品能不能賣給中國,我們的產品已經能夠用起來了。

算力集群化是發展趨勢

伴隨大模型帶來的生成式AI突破,人工智能正在進入一個新的時代。算力是人工智能產業創新的基礎,大模型的持續創新,驅動算力需求的爆炸式增長。可以說,大模型訓練的效率或者是創新的速度,根本上取決于算力的大小。

然而,中國的算力已經成為一個越來越稀缺的資源。華為輪值董事長胡厚崑在某論壇上談到,大模型的研發高度依賴高端AI芯片、集群及生態。高計算性能、高通信帶寬和大顯存成為大模型訓練必不可少的算力底座,單AI芯片進步速度還未跟上大模型對大算力的需求,算力集群化成為不可逆轉的發展趨勢。

在2023世界人工智能大會上,華為宣布昇騰AI集群全面升級,集群規模從最初的4000卡集群擴展至16000卡,擁有更快的訓練速度和30天以上的穩定訓練周期。

胡厚崑表示,華為在各個單點創新的基礎上,充分發揮云、計算、存儲、網絡以及能源的綜合優勢,進行架構創新,推出了昇騰AI集群,相當于把AI算力中心當成一臺超級計算機來設計,使得昇騰AI集群性能更高,并且可靠性更高。

據他介紹,昇騰AI集群目前已經可以達到10%以上的大模型訓練效率的提升,可以提供10倍以上的系統穩定的提高,支持長期穩定訓練。

華為昇騰計算業務總裁張迪煊表示,基于昇騰AI,原生孵化和適配了30多個大模型,到目前為止,中國有一半左右的大模型創新,都是由昇騰AI來支持的。

除了華為,阿里、騰訊等也打造了較大的算力集群,不過主要還是依靠英偉達的GPU芯片。阿里云表示,其擁有國內最強的智能算力儲備,智算集群可支持最大十萬卡GPU規模,承載多個萬億參數大模型同時在線訓練。

騰訊云此前大量采購了英偉達A100/H800芯片,發布新一代HCC高性能計算集群,用于大模型訓練、自動駕駛、科學計算等領域。基于新一代集群,騰訊團隊在同等數據集下,將萬億參數的AI大模型混元NLP訓練由50天縮短到4天。

小結

無論是大模型的訓練,還是后期的推理部署,對算力的需求都相當大。雖然,當前國產AI芯片與國際領先GPU產品在大模型的訓練上有差距,不過可以看到,已經有不少產品,在較大模型的訓練上已經取得成績,后續必然還會有更大的進展。同時,為了滿足大模型對大算力的需求,算力集群化將會是未來趨勢。

-

AI

+關注

關注

87文章

31028瀏覽量

269381

發布評論請先 登錄

相關推薦

FF將發布FX品牌最新進展

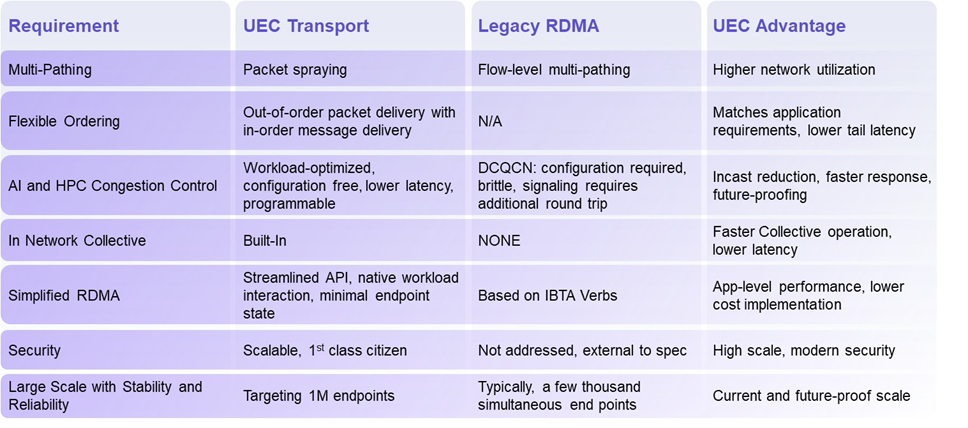

揭秘超以太網聯盟(UEC)1.0 規范最新進展(2024Q4)

Qorvo在射頻和電源管理領域的最新進展

小鵬汽車圖靈芯片及L4自動駕駛新進展

芯片和封裝級互連技術的最新進展

【「大模型時代的基礎架構」閱讀體驗】+ 未知領域的感受

開啟全新AI時代 智能嵌入式系統快速發展——“第六屆國產嵌入式操作系統技術與產業發展論壇”圓滿結束

名單公布!【書籍評測活動NO.41】大模型時代的基礎架構:大模型算力中心建設指南

摩爾線程張建中:以國產算力助力數智世界,滿足大模型算力需求

百度首席技術官王海峰解讀文心大模型的關鍵技術和最新進展

大模型時代,國產AI芯片最新進展!算力集群化是必然趨勢

大模型時代,國產AI芯片最新進展!算力集群化是必然趨勢

評論