M2芯片|ARM| A800 | H100

關鍵詞:M2芯片;Ultra;M1芯片;UltraFusion;ULTRAMAN;RTX4090、A800;A100;H100;LLAMA、LM、AIGC、CHATGLM、LLVM、LLM、LLMs、GLM、NLP、ChatGPT、AGI、HPC、GPU、CPU、CPU+GPU、英偉達、Nvidia、英特爾、AMD、高性能計算、高性能服務器、藍海大腦、多元異構算力、高性能計算、大模型訓練、大型語言模型、通用人工智能、GPU服務器、GPU集群、大模型訓練GPU集群、大語言模型

摘要:訓練和微調大型語言模型對于硬件資源的要求非常高。目前,主流的大模型訓練硬件通常采用英特爾的CPU和英偉達的GPU。然而,最近蘋果的M2 Ultra芯片和AMD的顯卡進展給我們帶來了一些新的希望。

蘋果的M2 Ultra芯片是一項重要的技術創新,它為蘋果設備提供了卓越的性能和能效。與此同時,基于AMD軟硬件系統的大模型訓練體系也在不斷發展,為用戶提供了更多選擇。盡管英偉達沒有推出與蘋果相媲美的200G顯卡,但他們在顯卡領域的競爭仍然激烈。對比蘋果芯片與英偉達、英特爾、AMD的最新硬件和生態建設,我們可以看到不同廠商在性價比方面帶來了全新的選擇。

藍海大腦為生成式AI應用提供了極具吸引力的算力平臺,與英特爾緊密協作,為客戶提供強大的大模型訓練和推理能力,加速AIGC創新步伐、賦力生成式AI產業創新。

基于英特爾CPU+英偉達GPU大模型訓練基礎架構

一、深度學習架構大模型的主要優勢

當前主流大模型架構都是基于深度學習transformer的架構模型,使用GPU訓練深度學習架構的大模型主要有以下優勢:

1、高性能計算

深度學習中的大部分計算都是浮點計算,包括矩陣乘法和激活函數的計算。GPU在浮點計算方面表現出色,具有高性能計算能力。

2、并行計算能力

GPU具有高度并行的計算架構,能夠同時執行多個計算任務。深度學習模型通常需要執行大量的矩陣乘法和向量運算,這些操作可以高度并行的方式進行,從而提高深度學習模型訓練效率。

3、高內存帶寬

GPU提供高達幾百GB/s的內存帶寬,滿足深度學習模型對數據大容量訪問需求。這種高內存帶寬能夠加快數據傳輸速度,提高模型訓練的效率。

二、當前大多數大模型采用英特爾的CPU加英偉達的GPU作為計算基礎設施的原因

盡管GPU在訓練大模型時發揮著重要作用,但單靠GPU遠遠不夠。除GPU負責并行計算和深度學習模型訓練外,CPU在訓練過程中也扮演著重要角色,其主要負責數據的預處理、后處理以及管理整個訓練過程的任務。通過GPU和CPU之間的協同工作,可以實現高效的大規模模型訓練。

1、強大的性能

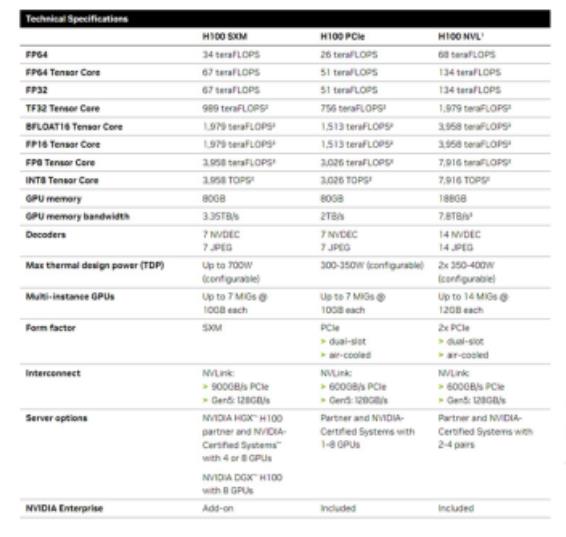

英特爾最新CPU采用Alder Lake架構,具備出色的通用計算能力。而英偉達最新GPU H100擁有3.35TB/s的顯存帶寬、80GB的顯存大小和900GB/s的顯卡間通信速度,對大數據吞吐和并行計算提供友好的支持。

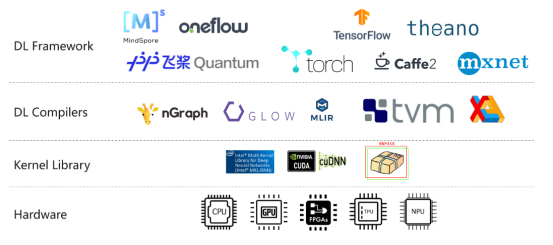

2、廣泛的支持和生態系統

基于英特爾CPU提供的AVX2指令集和基于英偉達GPU提供的CUDA并行計算平臺和編程模型,構建優秀的底層加速庫如PyTorch等上層應用。

3、良好的兼容性和互操作性

在硬件和軟件設計上考慮彼此配合使用的需求,能夠有效地協同工作。這種兼容性和互操作性使得英特爾的CPU和英偉達的GPU成為流行的組合選擇,在大規模模型訓練中得到廣泛應用。

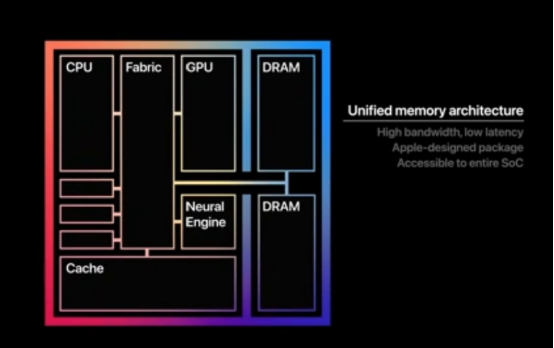

蘋果的M2 Ultra統一內存架構

在WWDC2023開發者大會上蘋果推出M2 Ultra芯片,以及搭載該芯片的新款Mac Studio和Mac Pro。這款芯片采用了第二代5nm制程工藝技術,是蘋果迄今為止最大且最強大的芯片。

去年3月,蘋果展示了一種將兩塊M1芯片“粘”在一起的設計,發布集成1140億顆晶體管、20核CPU、最高64核GPU、32核神經網絡引擎、2.5TB/s數據傳輸速率、800GB/s內存帶寬、128GB統一內存的“至尊版”芯片M1 Ultra。延續M1 Ultra的設計思路,M2 Ultra芯片通過采用突破性的UltraFusion架構,將兩塊M2 Max芯片拼接到一起,擁有1340億個晶體管,比上一代M1 Ultra多出200億個。

UltraFusion是蘋果在定制封裝技術方面的領先技術,其使用硅中介層(interposer)將芯片與超過10000個信號連接起來,從而提供超過2.5TB/s的低延遲處理器間帶寬。基于這一技術,M2 Ultra芯片在內存方面比M1 Ultra高出了50%,達到192GB的統一內存,并且擁有比M2 Max芯片高兩倍的800GB/s內存帶寬。以往由于內存不足,即使是最強大的獨立GPU也無法處理大型模型。然而,蘋果通過將超大內存帶寬集成到單個SoC中,實現單臺設備可以運行龐大的機器學習工作負載,如大型Transformer模型等。

AMD的大模型訓練生態

除蘋果的M2 Ultra在大模型訓練方面取得了顯著進展之外,AMD的生態系統也在加速追趕。

據7月3日消息,NVIDIA以其顯著的優勢在顯卡領域獲得了公認的地位,無論是在游戲還是計算方面都有著顯著的優勢,而在AI領域更是幾乎壟斷。然而,有好消息傳來,AMD已經開始發力,其MI250顯卡性能已經達到了NVIDIA A100顯卡的80%。 AMD在AI領域的落后主要是因為其軟件生態無法跟上硬件發展的步伐。盡管AMD的顯卡硬件規格很高,但其運算環境與NVIDIA的CUDA相比仍然存在巨大的差距。最近,AMD升級了MI250顯卡,使其更好地支持PyTorch框架。

MosaicML的研究結果顯示,MI250顯卡在優化后的性能提升顯著,大語言模型訓練速度已達到A100顯卡的80%。AMD指出,他們并未為MosaicML進行這項研究提供資助,但表示將繼續與初創公司合作,以優化軟件支持。 但需要注意的是,NVIDIA A100顯卡是在2020年3月發布的,已經是上一代產品,而NVIDIA目前最新的AI加速卡是H100,其AI性能有數倍至數十倍的提升。AMD的MI250顯卡也不是最新產品,其在2021年底發布,采用CDNA2架構,6nm工藝,擁有208個計算單元和13312個流處理器核心,各項性能指標比MI250X下降約5.5%,其他規格均未變動。

AMD體系的特點如下:

一、LLM訓練非常穩定

使用AMD MI250和NVIDIA A100在MPT-1B LLM模型上進行訓練時,從相同的檢查點開始,損失曲線幾乎完全相同。

二、性能與現有的A100系統相媲美

MosaicML對MPT模型的1B到13B參數進行了性能分析發現MI250每個GPU的訓練吞吐量在80%的范圍內與A100-40GB相當,并且與A100-80GB相比在73%的范圍內。隨著AMD軟件的改進,預計這一差距將會縮小。

三、基本無需代碼修改

得益于PyTorch對ROCm的良好支持,基本上不需要修改現有代碼。

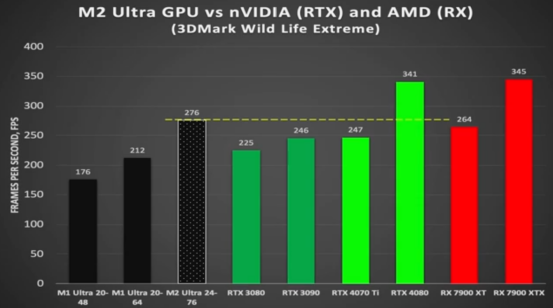

英偉達顯卡與蘋果M2 Ultra 相比性能如何

一、英偉達顯卡與M2 Ultra相比性能如何

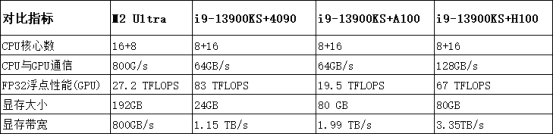

在傳統英特爾+英偉達獨立顯卡架構下,CPU與GPU之間的通信通常通過PCIe進行。最強大的H100支持PCIe Gen5,傳輸速度為128GB/s,而A100和4090則支持PCIe 4,傳輸速度為64GB/s。

另一個重要的參數是GPU的顯存帶寬,即GPU芯片與顯存之間的讀寫速度。顯存帶寬是影響訓練速度的關鍵因素。例如,英偉達4090顯卡的顯存帶寬為1.15TB/s,而A100和H100的顯存帶寬分別為1.99TB/s和3.35TB/s。

最后一個重要的參數是顯存大小,它指的是顯卡上的存儲容量。目前,4090是消費級顯卡的頂級選擇,顯存大小為24GB,而A100和H100單張顯卡的顯存大小均為80GB。這個參數對于存儲大規模模型和數據集時非常重要。

M2 Ultra的芯片參數和4090以及A100的對比(CPU采用英特爾最新的i9-13900KS)

從這些參數來看,蘋果的M2 Ultra相對于英偉達的4090來說性能稍低,與專業級顯卡相比則較為遜色。然而,M2 Ultra最重要的優勢在于統一內存,即CPU讀寫的內存可以直接被顯卡用作顯存。因此,擁有192GB的顯存幾乎相當于8個4090或者2.5個A100/H100的顯存。這意味著單個M2 Ultra芯片可以容納非常大的模型。例如,當前開源的LLaMA 65B模型需要120GB的顯存才能進行推理。這意味著蘋果的M2 Ultra可以直接適用于LLaMA 65B,而目前沒有其他芯片能夠單獨承載如此龐大的模型,甚至包括最新的H100。

從上述參數對比來看,M2 Ultra在其他指標接近4090的情況下,顯存大小成為其最大的優勢。盡管M2 Ultra并非專為大模型訓練而設計,但其架構非常適合進行大模型訓練。

在上層生態方面,進展也非常良好。2022年5月18日,PyTorch宣布支持蘋果芯片,并開始適配M1 Ultra,利用蘋果提供的芯片加速庫MPS進行加速Ultra上使用PyTorch進行訓練。以文本生成圖片為例,它能夠一次性生成更多且更高精度的圖片。

二、NVIDIA為什么不推出一款200GB顯存以上的GPU?

主要原因可以分為以下幾點:

1、大語言模型火起來還沒多久;

2、顯存容量和算力是要匹配的,空有192GB顯存,但是算力不足并無意義;

3、蘋果大內存,適合在本地進行推理,有希望引爆在端側部署AI的下一輪熱潮。

從2022年11月ChatGPT火起來到現在,時間也不過才半年時間。從項目立項,到確定具體的規格,再到設計產品,并且進行各種測試,最終上市的全流程研發時間至少在一年以上。客觀上講,大語言模型形成全球范圍的熱潮,一定會帶動對于顯存容量的需求。英偉達未來顯存容量的升級速度一定會提速。

過去之所以消費級顯卡的顯存容量升級較慢,根本原因是沒有應用場景。8GB的消費級顯卡用來打游戲足矣,加速一些視頻剪輯也綽綽有余。更高的顯存容量,只能服務于少量科研人員,而且大多都去買了專業卡專門應用。現在有了大語言模型,可以在本地部署一個開源的模型。有了對于顯存的明確需求,未來一定會快速提升顯存容量的。

其次,蘋果有192GB的統一內存可以用于大語言模型的“訓練”。這個認知是完全錯誤的。AI模型可以分為訓練(train)、微調(fine-tune)和推理(inference)。簡單來說,訓練就是研發人員研發AI模型的過程,推理就是用戶部署在設備上來用。從算力消耗上來說,是訓練>微調>推理,訓練要比推理的算力消耗高至少3個數量級以上。

訓練也不純粹看一個顯存容量大小,而是和芯片的算力高度相關的。因為實際訓練的過程當中,將海量的數據切塊成不同的batch size,然后送入顯卡進行訓練。顯存大,意味著一次可以送進更大的數據塊。但是芯片算力如果不足,單個數據塊就需要更長的等待時間。

顯存和算力,必須要相輔相成。在有限的產品成本內,兩者應當是恰好在一個平衡點上。現階段英偉達的H100能夠廣泛用于各大廠商的真實模型訓練,而不是只存在于幾個自媒體玩具級別的視頻里面,說明H100能夠滿足廠商的使用需要。

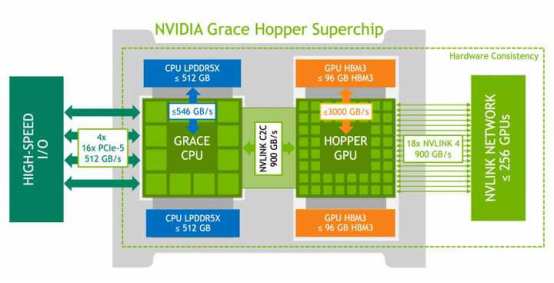

要按蘋果的顯存算法,一塊Grace Hopper就超過了啊。一塊Grace Hopper的統一內存高達512GB,外加Hopper還有96GB的獨立顯存,早就超了。

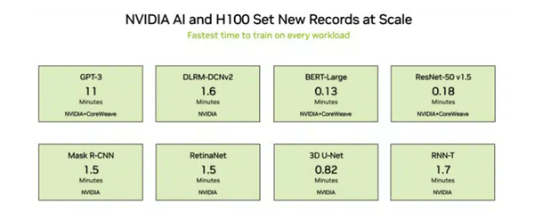

使用NVIDIA H100訓練ChatGPT大模型僅用11分鐘

AI技術的蓬勃發展使得NVIDIA的顯卡成為市場上備受矚目的熱門產品。尤其是高端的H100加速卡,其售價超過25萬元,然而市場供不應求。該加速卡的性能也非常驚人,最新的AI測試結果顯示,基于GPT-3的大語言模型訓練任務刷新了記錄,完成時間僅為11分鐘。

據了解,機器學習及人工智能領域的開放產業聯盟MLCommons發布了最新的MLPerf基準評測。包括8個負載測試,其中就包含基于GPT-3開源模型的LLM大語言模型測試,這對于評估平臺的AI性能提出了很高的要求。

參與測試的NVIDIA平臺由896個Intel至強8462Y+處理器和3584個H100加速卡組成,是所有參與平臺中唯一能夠完成所有測試的。并且,NVIDIA平臺刷新了記錄。在關鍵的基于GPT-3的大語言模型訓練任務中,H100平臺僅用了10.94分鐘,與之相比,采用96個至強8380處理器和96個Habana Gaudi2 AI芯片構建的Intel平臺完成同樣測試所需的時間為311.94分鐘。

H100平臺的性能幾乎是Intel平臺的30倍,當然,兩套平臺的規模存在很大差異。但即便只使用768個H100加速卡進行訓練,所需時間仍然只有45.6分鐘,遠遠超過采用Intel平臺的AI芯片。

H100加速卡采用GH100 GPU核心,定制版臺積電4nm工藝制造,擁有800億個晶體管。它集成了18432個CUDA核心、576個張量核心和60MB的二級緩存,支持6144-bit HBM高帶寬內存以及PCIe 5.0接口。

H100計算卡提供SXM和PCIe 5.0兩種樣式。SXM版本擁有15872個CUDA核心和528個Tensor核心,而PCIe 5.0版本則擁有14952個CUDA核心和456個Tensor核心。該卡的功耗最高可達700W。

就性能而言,H100加速卡在FP64/FP32計算方面能夠達到每秒60萬億次的計算能力,而在FP16計算方面達到每秒2000萬億次的計算能力。此外,它還支持TF32計算,每秒可達到1000萬億次,是A100的三倍。而在FP8計算方面,H100加速卡的性能可達每秒4000萬億次,是A100的六倍。

藍海大腦大模型訓練平臺

藍海大腦大模型訓練平臺提供強大的支持,包括基于開放加速模組高速互聯的AI加速器。配置高速內存且支持全互聯拓撲,滿足大模型訓練中張量并行的通信需求。支持高性能I/O擴展,同時可以擴展至萬卡AI集群,滿足大模型流水線和數據并行的通信需求。強大的液冷系統熱插拔及智能電源管理技術,當BMC收到PSU故障或錯誤警告(如斷電、電涌,過熱),自動強制系統的CPU進入ULFM(超低頻模式,以實現最低功耗)。致力于通過“低碳節能”為客戶提供環保綠色的高性能計算解決方案。主要應用于深度學習、學術教育、生物醫藥、地球勘探、氣象海洋、超算中心、AI及大數據等領域。

一、為什么需要大模型?

1、模型效果更優

大模型在各場景上的效果均優于普通模型

2、創造能力更強

大模型能夠進行內容生成(AIGC),助力內容規模化生產

3、靈活定制場景

通過舉例子的方式,定制大模型海量的應用場景

4、標注數據更少

通過學習少量行業數據,大模型就能夠應對特定業務場景的需求

二、平臺特點

1、異構計算資源調度

一種基于通用服務器和專用硬件的綜合解決方案,用于調度和管理多種異構計算資源,包括CPU、GPU等。通過強大的虛擬化管理功能,能夠輕松部署底層計算資源,并高效運行各種模型。同時充分發揮不同異構資源的硬件加速能力,以加快模型的運行速度和生成速度。

2、穩定可靠的數據存儲

支持多存儲類型協議,包括塊、文件和對象存儲服務。將存儲資源池化實現模型和生成數據的自由流通,提高數據的利用率。同時采用多副本、多級故障域和故障自恢復等數據保護機制,確保模型和數據的安全穩定運行。

3、高性能分布式網絡

提供算力資源的網絡和存儲,并通過分布式網絡機制進行轉發,透傳物理網絡性能,顯著提高模型算力的效率和性能。

4、全方位安全保障

在模型托管方面,采用嚴格的權限管理機制,確保模型倉庫的安全性。在數據存儲方面,提供私有化部署和數據磁盤加密等措施,保證數據的安全可控性。同時,在模型分發和運行過程中,提供全面的賬號認證和日志審計功能,全方位保障模型和數據的安全性。

三、常用配置

目前大模型訓練多常用H100、H800、A800、A100等GPU顯卡,其中H100 配備第四代 Tensor Core 和 Transformer 引擎(FP8 精度),與上一代產品相比,可為多專家 (MoE) 模型提供高 9 倍的訓練速度。通過結合可提供 900 GB/s GPU 間互連的第四代 NVlink、可跨節點加速每個 GPU 通信的 NVLINK Switch 系統、PCIe 5.0 以及 NVIDIA Magnum IO? 軟件,為小型企業到大規模統一 GPU 集群提供高效的可擴展性。

搭載 H100 的加速服務器可以提供相應的計算能力,并利用 NVLink 和 NVSwitch 每個 GPU 3 TB/s 的顯存帶寬和可擴展性,憑借高性能應對數據分析以及通過擴展支持龐大的數據集。通過結合使用 NVIDIA Quantum-2 InfiniBand、Magnum IO 軟件、GPU 加速的 Spark 3.0 和NVIDIA RAPIDS?,NVIDIA 數據中心平臺能夠以出色的性能和效率加速這些大型工作負載。

1、H100工作站常用配置

CPU:英特爾至強Platinum 8468 48C 96T 3.80GHz 105MB 350W *2

內存:動態隨機存取存儲器64GB DDR5 4800兆赫 *24

存儲:固態硬盤3.2TB U.2 PCIe第4代 *4

GPU :Nvidia Vulcan PCIe H100 80GB *8

平臺 :HD210 *1

散熱 :CPU+GPU液冷一體散熱系統 *1

網絡 :英偉達IB 400Gb/s單端口適配器 *8

電源:2000W(2+2)冗余高效電源 *1

2、A800工作站常用配置

CPU:Intel 8358P 2.6G 11.2UFI 48M 32C 240W *2

內存:DDR4 3200 64G *32

數據盤:960G 2.5 SATA 6Gb R SSD *2

硬盤:3.84T 2.5-E4x4R SSD *2

網絡:雙口10G光纖網卡(含模塊)*1

雙口25G SFP28無模塊光纖網卡(MCX512A-ADAT )*1

GPU:HV HGX A800 8-GPU 8OGB *1

電源:3500W電源模塊*4

其他:25G SFP28多模光模塊 *2

單端口200G HDR HCA卡(型號:MCX653105A-HDAT) *4

2GB SAS 12Gb 8口 RAID卡 *1

16A電源線纜國標1.8m *4

托軌 *1

主板預留PCIE4.0x16接口 *4

支持2個M.2 *1

原廠質保3年 *1

3、A100工作站常用配置

CPU:Intel Xeon Platinum 8358P_2.60 GHz_32C 64T_230W *2

RAM:64GB DDR4 RDIMM服務器內存 *16

SSD1:480GB 2.5英寸SATA固態硬盤 *1

SSD2:3.84TB 2.5英寸NVMe固態硬盤 *2

GPU:NVIDIA TESLA A100 80G SXM *8

網卡1:100G 雙口網卡IB 邁絡思 *2

網卡2:25G CX5雙口網卡 *1

4、H800工作站常用配置

CPU:Intel Xeon Platinum 8468 Processor,48C64T,105M Cache 2.1GHz,350W *2

內存 :64GB 3200MHz RECC DDR4 DIMM *32

系統硬盤: intel D7-P5620 3.2T NVMe PCle4.0x4 3DTLCU.2 15mm 3DWPD *4

GPU: NVIDIA Tesla H800 -80GB HBM2 *8

GPU網絡: NVIDIA 900-9x766-003-SQO PCle 1-Port IB 400 OSFP Gen5 *8

存儲網絡 :雙端口 200GbE IB *1

網卡 :25G網絡接口卡 雙端口 *1

審核編輯 黃宇

-

英特爾

+關注

關注

61文章

9978瀏覽量

171922 -

蘋果

+關注

關注

61文章

24421瀏覽量

199079 -

AI

+關注

關注

87文章

31028瀏覽量

269381 -

英偉達

+關注

關注

22文章

3783瀏覽量

91247 -

算力

+關注

關注

1文章

987瀏覽量

14854 -

大模型

+關注

關注

2文章

2477瀏覽量

2834 -

H100

+關注

關注

0文章

31瀏覽量

294

發布評論請先 登錄

相關推薦

英偉達 H100 vs 蘋果M2 大模型訓練,哪款性價比更高?

英偉達 H100 vs 蘋果M2 大模型訓練,哪款性價比更高?

評論