北京2023年8月31日/美通社/ -- 與狹義的人工智能相比,通用人工智能通過跨領(lǐng)域、跨學(xué)科、跨任務(wù)和跨模態(tài)的大模型,能夠滿足更廣泛的場景需求、實現(xiàn)更高程度的邏輯理解能力與使用工具能力。2023年,隨著 LLM 大規(guī)模語言模型技術(shù)的不斷突破,大模型為探索更高階的通用人工智能帶來了新的曙光。通用人工智能進(jìn)入了快速發(fā)展期,在中國,大模型已經(jīng)呈現(xiàn)出百花齊放的態(tài)勢,各種大模型層出不窮。

要想在"百模爭秀"的時代占得先機(jī),AI開發(fā)團(tuán)隊需要著力化解算力、算法、數(shù)據(jù)層面的巨大挑戰(zhàn),而開發(fā)效率和訓(xùn)練速度是保障大模型市場競爭力的核心關(guān)鍵因素,也是未來的核心發(fā)力點(diǎn)。近日,浪潮信息人工智能與高性能應(yīng)用軟件部 AI 架構(gòu)師Owen ZHU參與首屆由CSDN、《新程序員》聯(lián)合主辦的NPCon大會,發(fā)表重要技術(shù)演講,分享面向新一輪AIGC產(chǎn)業(yè)革命,AI大模型的算力系統(tǒng)解決之道,并強(qiáng)調(diào)算力、算法、數(shù)據(jù)和系統(tǒng)架構(gòu)等多個方面的綜合優(yōu)化對大模型訓(xùn)練到了至關(guān)重要的作用。

以下為Owen ZHU在NPCon大會的演講實錄整理:

"百模爭秀"時代的算力瓶頸

大模型研發(fā)的核心技術(shù)是由預(yù)訓(xùn)練與Alignment組成的,第一部分就是預(yù)訓(xùn)練,需要用大量的數(shù)據(jù)使模型收斂速度更快、性能更好。第二部分則是Alignment,Alignment不完全等于強(qiáng)化學(xué)習(xí),其通過使用多種方式/策略優(yōu)化模型輸出,讓AI在和人的交流反饋中學(xué)會如何溝通表達(dá),這兩部分是提升大模型質(zhì)量的核心要素。

目前來看,模型基礎(chǔ)能力取決于數(shù)據(jù)、模型參數(shù)量和算力。模型參數(shù)量越大、投入的訓(xùn)練數(shù)據(jù)越大,模型泛化能力越強(qiáng)。由于資源限制,在兩者不可兼得的時候,應(yīng)該如何進(jìn)行取舍呢?OpenAI的研究結(jié)論認(rèn)為,與增加數(shù)據(jù)量相比,先增大模型參數(shù)量受益則會更好,用一千億的模型訓(xùn)練兩千億的Token和兩千億模型訓(xùn)練一千億的Token,后者的模型性能會更高。

由此可見,參數(shù)量是衡量模型能力的一個重要指標(biāo),當(dāng)模型參數(shù)量增長超過一定閾值時,模型能力表現(xiàn)出躍遷式的提升,表現(xiàn)出來語言理解能力、生成能力、邏輯推理能力等能力的顯著提升,這也就是我們所說的模型的涌現(xiàn)能力。

模型規(guī)模多大能產(chǎn)生涌現(xiàn)能力呢?現(xiàn)在來看,百億參數(shù)是模型具備涌現(xiàn)能力的門檻,千億參數(shù)的模型具備較好的涌現(xiàn)能力。但這并不意味著模型規(guī)模就要上升到萬億規(guī)模級別的競爭,因為現(xiàn)有大模型并沒有得到充分訓(xùn)練,如GPT-3的每個參數(shù)基本上只訓(xùn)練了1-2個Token,DeepMind的研究表明,如果把一個大模型訓(xùn)練充分,需要把每個參數(shù)量訓(xùn)練20個Token。所以,當(dāng)前的很多千億規(guī)模的大模型還需要用多10倍的數(shù)據(jù)進(jìn)行訓(xùn)練,模型性能才能達(dá)到比較好的水平。

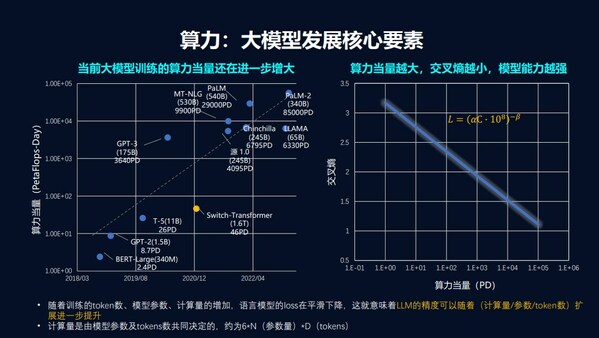

無論是提高模型參數(shù)量還是提升數(shù)據(jù)規(guī)模,算力依舊是大模型能力提升的核心驅(qū)動力:需要用"足夠大"的算力,去支撐起"足夠精準(zhǔn)"模型泛化能力。當(dāng)前大模型訓(xùn)練的算力當(dāng)量還在進(jìn)一步增大,從GPT-3到GPT-4算力當(dāng)量增長了68倍。算力當(dāng)量越大,交叉熵越小,模型能力越強(qiáng)。隨著訓(xùn)練的token數(shù)、模型參數(shù)、計算量的增加,語言模型的loss在平滑下降,這就意味著大語言模型的精度可以隨著計算量、參數(shù)規(guī)模、token數(shù)擴(kuò)展進(jìn)一步提升。

欲煉大模型,先利其器

大模型能力來源于大量工程實踐經(jīng)驗,預(yù)訓(xùn)練的工程挑戰(zhàn)巨大,這表現(xiàn)在如下幾個方面:首先,AI大模型的演化對于集群的并行運(yùn)算效率、片上存儲、帶寬、低延時的訪存等也都提出了較高的需求,萬卡AI平臺的規(guī)劃建設(shè)、性能調(diào)優(yōu)、算力調(diào)度都是很難解決的難題;其次,大規(guī)模訓(xùn)練普遍存在硬件故障、梯度爆炸等小規(guī)模訓(xùn)練不會遇到的問題;再次,工程實踐方面的缺乏導(dǎo)致企業(yè)難以在模型質(zhì)量上實現(xiàn)快速提升。

作為最早布局大模型的企業(yè)之一,浪潮信息在業(yè)界率先推出了中文AI巨量模型"源1.0",參數(shù)規(guī)模高達(dá)2457億。千億參數(shù)規(guī)模的大模型創(chuàng)新實踐,使得浪潮信息在大模型領(lǐng)域積累了實戰(zhàn)技術(shù)經(jīng)驗并擁有專業(yè)的研發(fā)團(tuán)隊,為業(yè)界提供AI算力系統(tǒng)參考設(shè)計。在算力效率層面,針對大模型訓(xùn)練中存在計算模式復(fù)雜,算力集群性能較低的情況,源1.0在大規(guī)模分布式訓(xùn)練中采用了張量并行、流水線并行和數(shù)據(jù)并行的三維并行策略,訓(xùn)練耗時約15天,共計訓(xùn)練了180 billion token,并將模型最后的loss值收斂至1.73,顯著低于GPT-3等業(yè)界其他語言模型。首次提出面向效率和精度優(yōu)化的大模型結(jié)構(gòu)協(xié)同設(shè)計方法,圍繞深度學(xué)習(xí)框架、訓(xùn)練集群IO、通信開展了深入優(yōu)化,在僅采用2x200G互聯(lián)的情況下,源1.0的算力效率達(dá)到45%,算力效率世界領(lǐng)先。在集群高速互聯(lián)層面,基于原生RDMA實現(xiàn)整個集群的全線速組網(wǎng),并對網(wǎng)絡(luò)拓?fù)溥M(jìn)行優(yōu)化,可以有效消除混合計算的計算瓶頸,確保集群在大模型訓(xùn)練時始終處于最佳狀態(tài)。

為大模型良好生態(tài)發(fā)展尋找最優(yōu)解

當(dāng)前,中國和業(yè)界先進(jìn)水平大模型的算力差距依然較大,從算力當(dāng)量來看,GPT-4的算力當(dāng)量已經(jīng)達(dá)到了248,842PD,而國內(nèi)大多數(shù)主流的大模型算力大量僅為數(shù)千PD,差距高達(dá)近百倍。

同時,中國和業(yè)界先進(jìn)水平大模型在算法、數(shù)據(jù)方面也存在巨大差距。在算法方面,雖然開源為國內(nèi)大模型發(fā)展帶來了彎道超車的良機(jī),但LLaMA等開源大模型相比GPT4等頂級水平自研模型的性能,開源模型的能力存在"天花板"。

在數(shù)據(jù)方面,中文數(shù)據(jù)集和英文數(shù)據(jù)集相比較,在規(guī)模、質(zhì)量上均存在顯著差距,相較于動輒數(shù)千億單詞量級的英文數(shù)據(jù),中文大模型的數(shù)據(jù)量級僅為百億左右,而且開源程度較低,封閉程度較高。

開發(fā)大模型、發(fā)展通用人工智能是一項非常復(fù)雜的系統(tǒng)工程,我們亟需從系統(tǒng)層面為未來大模型的良好生態(tài)發(fā)展尋找最優(yōu)解。從實戰(zhàn)中走來,通過構(gòu)建高效穩(wěn)定的智算系統(tǒng),加速模型開發(fā)效率提升。

日前,浪潮信息大模型智算軟件棧OGAI(Open GenAI Infra)——"元腦生智"已正式發(fā)布。浪潮信息正通過"工具化、系統(tǒng)化、全鏈條"的全棧賦能能力,讓煉大模型省時、省力,讓大模型更快、更穩(wěn)、更智能,助力百模真正實現(xiàn)"競速AIGC"。

審核編輯 黃宇

-

AI

+關(guān)注

關(guān)注

87文章

30896瀏覽量

269110 -

人工智能

+關(guān)注

關(guān)注

1791文章

47279瀏覽量

238513 -

大模型

+關(guān)注

關(guān)注

2文章

2451瀏覽量

2714

發(fā)布評論請先 登錄

相關(guān)推薦

浪潮信息與智源研究院達(dá)成戰(zhàn)略合作協(xié)議

浪潮信息源2.0大模型與百度PaddleNLP全面適配

浪潮信息:元腦企智EPAI助力金融大模型快速落地

商湯科技發(fā)布《采用AI編程助手,發(fā)展新質(zhì)生產(chǎn)力》白皮書

浪潮信息與能投天府云合作打造42kW智算風(fēng)冷算力倉

浪潮信息攜手天府云數(shù)據(jù)科技推出了42kW智算風(fēng)冷算力倉

浪潮信息攜全棧智算產(chǎn)品和方案亮相WAIC 2024

浪潮信息發(fā)布源2.0-M32開源大模型,模算效率大幅提升

浪潮信息發(fā)布“源2.0-M32”開源大模型

浪潮信息發(fā)布企業(yè)大模型開發(fā)平臺"元腦企智"EPAI,加速AI創(chuàng)新落地

浪潮信息發(fā)布企業(yè)大模型開發(fā)平臺“元腦企智”EPAI

浪潮信息"源2.0"大模型YuanChat支持英特爾最新商用AI PC

浪潮信息與英特爾合作推出一種大模型效率工具“YuanChat”

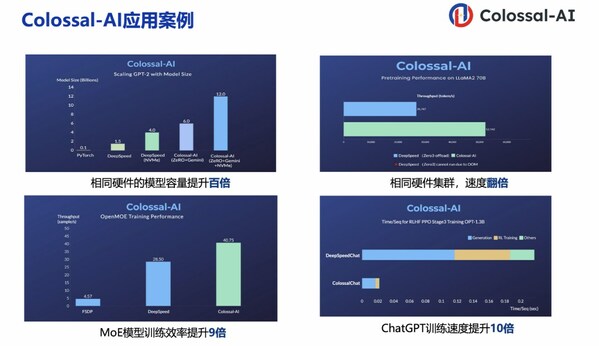

潞晨科技Colossal-AI與浪潮信息AIStation完成兼容性互認(rèn)證

潞晨科技Colossal-AI + 浪潮信息AIStation,大模型開發(fā)效率提升10倍

浪潮信息Owen ZHU:大模型百花齊放,算力效率決定速度

浪潮信息Owen ZHU:大模型百花齊放,算力效率決定速度

評論