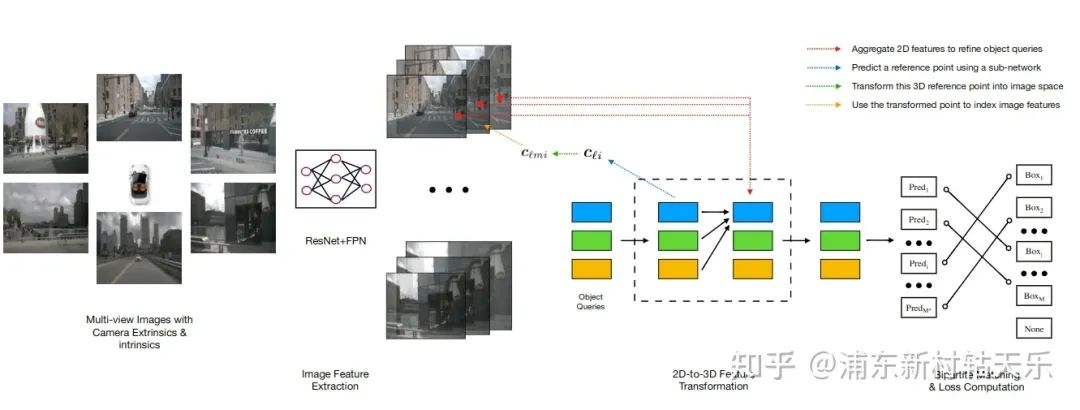

1、Camera only

主要思想:固定900個(gè)query個(gè)數(shù),隨機(jī)初始化query。每個(gè)query對(duì)應(yīng)一個(gè)3D reference point,然后反投影到圖片上sample對(duì)應(yīng)像素的特征。

缺點(diǎn):需要預(yù)訓(xùn)練模型,且因?yàn)槭请S機(jī)初始化,訓(xùn)練收斂較慢

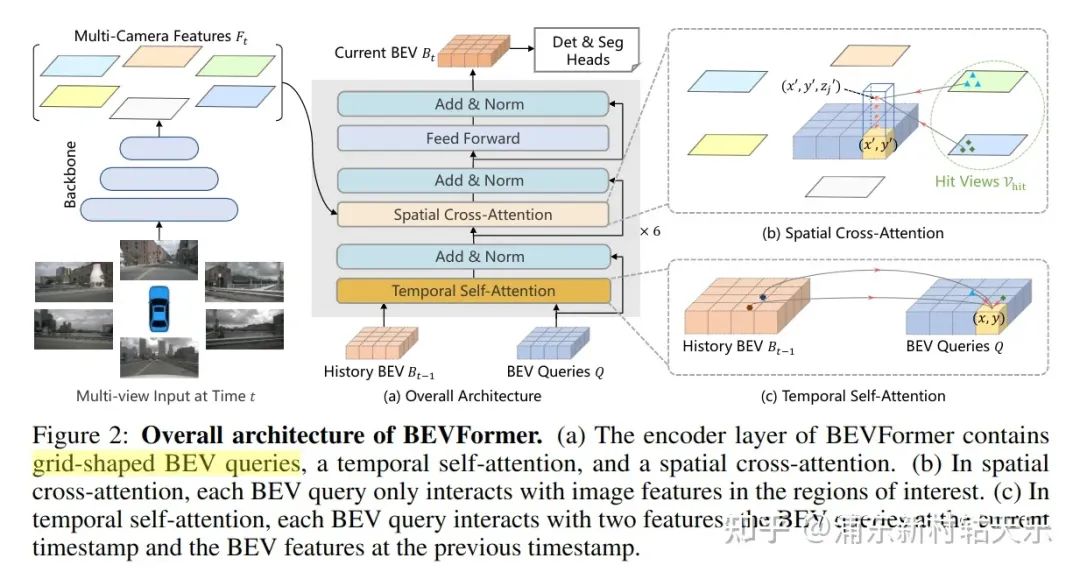

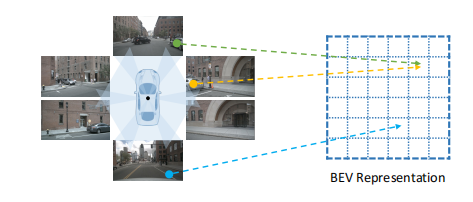

BEV Former

https://arxiv.org/abs/2203.17270

主要思想:將BEV下的每個(gè)grid作為query,在高度上采樣N個(gè)點(diǎn),投影到圖像中sample到對(duì)應(yīng)像素的特征,且利用了空間和時(shí)間的信息。并且最終得到的是BEV featrue,在此featrue上做Det和Seg。

Spatial Cross-Attention:將BEV下的每個(gè)grid作為query,在高度上采樣N個(gè)點(diǎn),投影到圖像中獲取特征。

Temporal Self-Attention: 通過self-attention代替運(yùn)動(dòng)補(bǔ)償,align上一幀的feature到當(dāng)前幀的Q

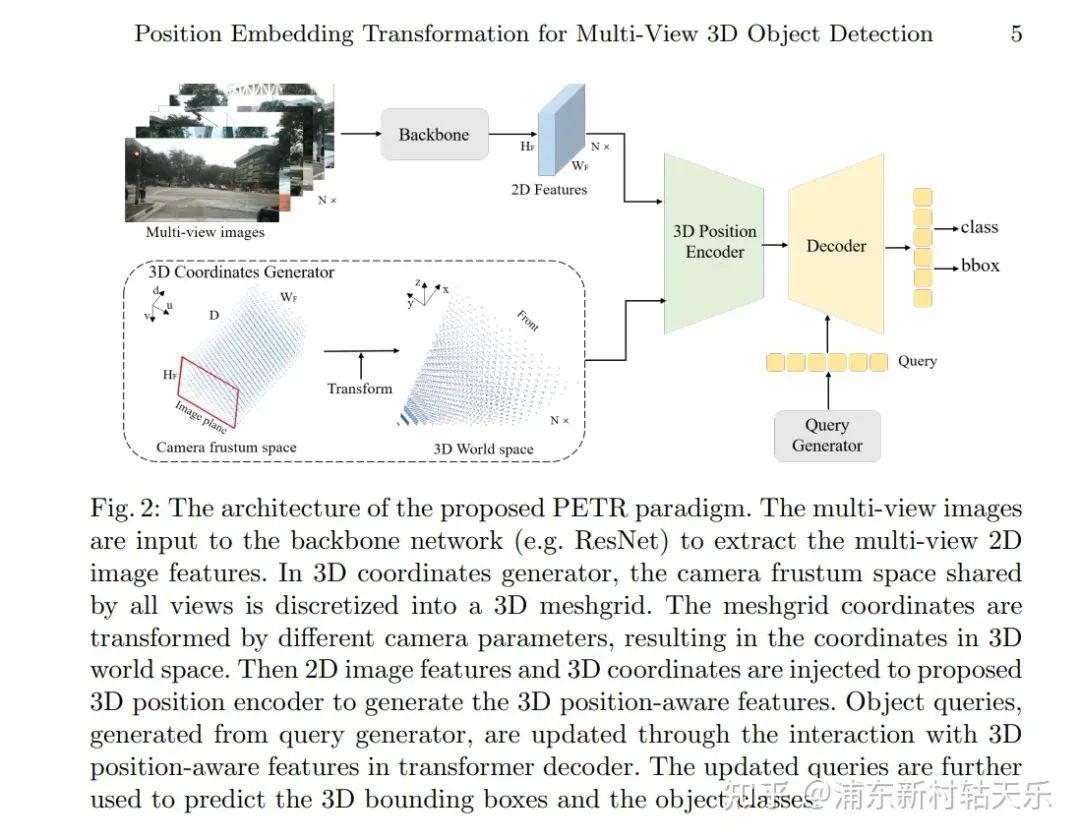

曠視,PETR

https://arxiv.org/pdf/2203.05625.pdf

2、多模態(tài)

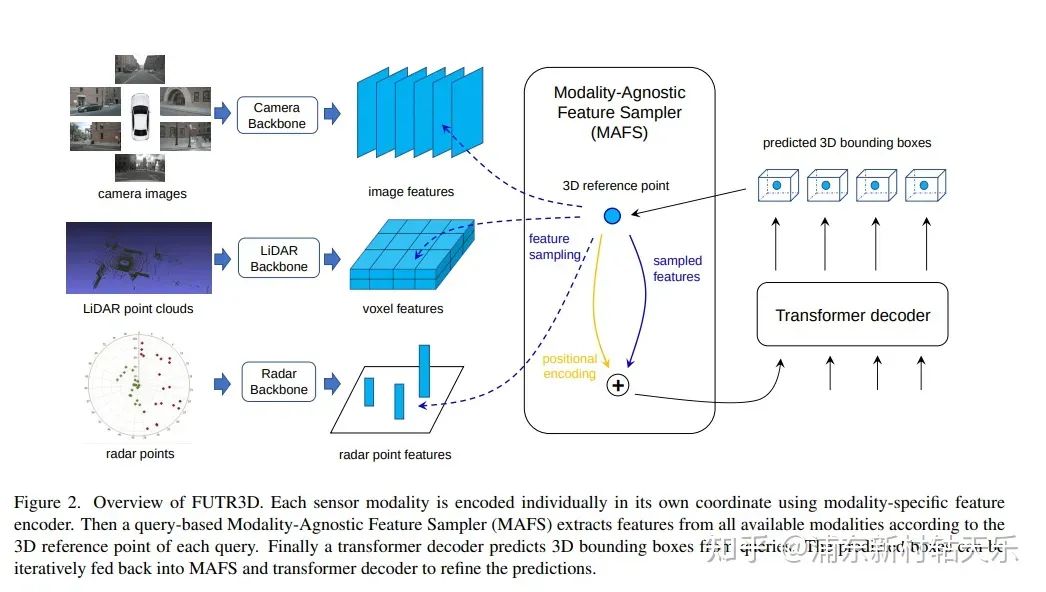

清華,F(xiàn)UTR3D

https://arxiv.org/pdf/2203.10642.pdf

在DETR的基礎(chǔ)上,將3D reference point投影到Lidar voxel特征和radar point 特征上。

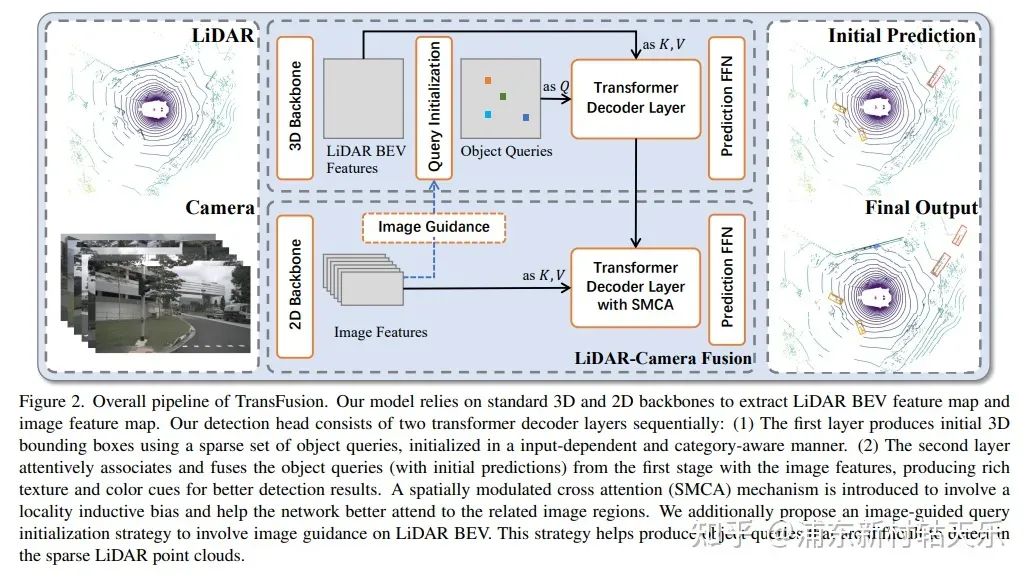

香港科技大學(xué),Transfusion

https://arxiv.org/pdf/2203.11496.pdf

利用CenterPoint在heatmap上獲取Top K個(gè)點(diǎn)作為Query(這K個(gè)點(diǎn)可以看做是通過lidar網(wǎng)絡(luò)初始化了每個(gè)目標(biāo)的位置,這比DETR用隨機(jī)點(diǎn)作為Qurey收斂要快),先經(jīng)過Lidar Transformer得到proposal,把這個(gè)proposal作為Query,再和image feature做cross attention。

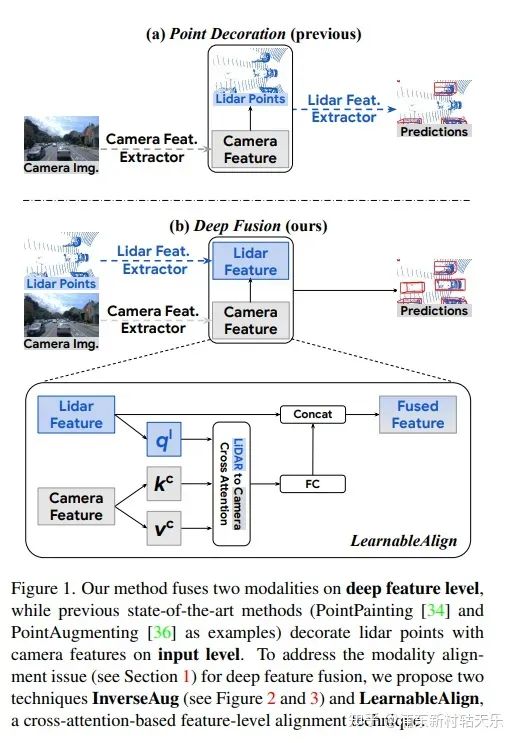

Google,DeepFusion

https://arxiv.org/abs/2203.08195

直接將Lidar feature和Camera feature做cross attention,這個(gè)思路牛逼,我不看到這篇論文是絕對(duì)想不到還能這么搞的。

編輯:黃飛

-

算法

+關(guān)注

關(guān)注

23文章

4622瀏覽量

93077 -

感知

+關(guān)注

關(guān)注

1文章

66瀏覽量

12145 -

Transformer

+關(guān)注

關(guān)注

0文章

144瀏覽量

6026

原文標(biāo)題:BEV感知中的Transformer算法

文章出處:【微信號(hào):3D視覺工坊,微信公眾號(hào):3D視覺工坊】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

基于LSS范式的BEV感知算法優(yōu)化部署詳解

BEV感知算法:下一代自動(dòng)駕駛的核心技術(shù)

未來已來,多傳感器融合感知是自動(dòng)駕駛破局的關(guān)鍵

感知時(shí)間等比縮減的機(jī)會(huì)頻譜接入算法研究

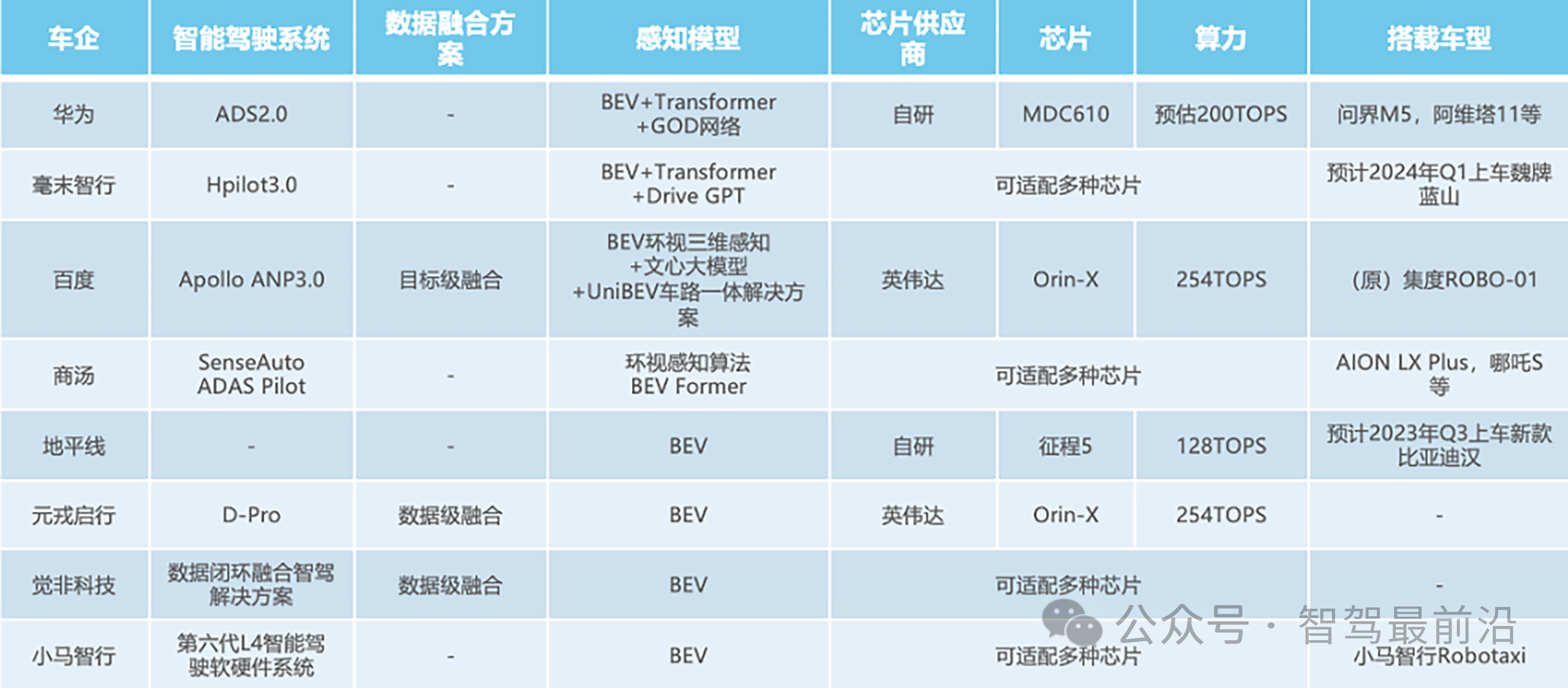

BEV+Transformer對(duì)智能駕駛硬件系統(tǒng)有著什么樣的影響?

黑芝麻智能在BEV感知方面的研發(fā)進(jìn)展

基于幾何變換器的2D-to-BEV視圖轉(zhuǎn)換學(xué)習(xí)

基于Transformer的目標(biāo)檢測(cè)算法

BEV人工智能transformer

CVPR上的新頂流:BEV自動(dòng)駕駛感知新范式

利用Transformer BEV解決自動(dòng)駕駛Corner Case的技術(shù)原理

智能駕駛感知算法梳理 高階自動(dòng)駕駛落地關(guān)鍵分析

黑芝麻智能開發(fā)多重亮點(diǎn)的BEV算法技術(shù) 助力車企高階自動(dòng)駕駛落地

自動(dòng)駕駛中一直說的BEV+Transformer到底是個(gè)啥?

BEV感知中的Transformer算法介紹

BEV感知中的Transformer算法介紹

評(píng)論