AI模型在實(shí)際運(yùn)用中可能出現(xiàn)性能下降而達(dá)不到最初的標(biāo)準(zhǔn),這種情況并不罕見。例如,也許你已經(jīng)注意到你經(jīng)常使用的生成人工智能服務(wù)的響應(yīng)質(zhì)量發(fā)生了變化。這些說法經(jīng)常出現(xiàn)在新聞網(wǎng)站和社交媒體上。

但人工智能模型的性能是否會(huì)隨著時(shí)間的推移而惡化?

事實(shí)上,人工智能模型的有效性可能會(huì)下降,并且容易產(chǎn)生“幻覺”。

用人工智能專家的語言來說,這種現(xiàn)象通常被稱為“模型衰退”或“模型漂移”,這兩種術(shù)語經(jīng)常互換使用。

發(fā)生這種情況的原因多種多樣。

“

為什么它很重要

人工智能越來越多地應(yīng)用于日常生活的各個(gè)方面,包括拯救生命的行動(dòng)和大額投資等。2023年3月,IEEE Spectrum上的一篇文章(https://spectrum.ieee.org/self-driving-cars-2662494269)強(qiáng)調(diào)了一個(gè)顯著的現(xiàn)實(shí)風(fēng)險(xiǎn):自動(dòng)駕駛汽車中的人工智能模型出現(xiàn)故障,導(dǎo)致了嚴(yán)重的車禍。

定期更新和使用當(dāng)前數(shù)據(jù)進(jìn)行重新培訓(xùn)是維持這些模型在不斷變化環(huán)境中有效的關(guān)鍵。

“

什么是AI模型漂移

IEEE會(huì)員Eleanor “Nell” Watson解釋說,人工智能模型的準(zhǔn)確性經(jīng)常會(huì)因?yàn)楝F(xiàn)實(shí)世界中不斷變化的環(huán)境而發(fā)生變化。

“例如,”Watson說,“考慮一個(gè)經(jīng)過訓(xùn)練以預(yù)測(cè)消費(fèi)者購買模式的模型。它是在代表某個(gè)時(shí)間點(diǎn)的消費(fèi)者行為的數(shù)據(jù)集上訓(xùn)練的。部署后,消費(fèi)者偏好和市場(chǎng)動(dòng)態(tài)可能會(huì)因新趨勢(shì)、經(jīng)濟(jì)變化甚至全球事件等各種因素而演變。由于該模型是在舊數(shù)據(jù)上訓(xùn)練的,它可能無法準(zhǔn)確捕捉這些新模式,導(dǎo)致其預(yù)測(cè)的準(zhǔn)確性或相關(guān)性降低。這是模型衰減的表現(xiàn)。”

對(duì)抗數(shù)據(jù)漂移非常重要。為了做到這一點(diǎn),人工智能研究人員傾向于將人工智能漂移進(jìn)一步分類。如果你想了解更多,請(qǐng)查看這篇IEEEXplore的論文:https://ieeexplore.ieee.org/document/9808752。

Watson說:“解決模型衰退問題包括定期監(jiān)測(cè)、調(diào)整和用新數(shù)據(jù)更新模型,完善模型的架構(gòu),甚至在某些情況下從頭開始重新訓(xùn)練。”同時(shí)還指出:“確保模型與當(dāng)前數(shù)據(jù)的狀態(tài)和動(dòng)態(tài)保持一致,以及對(duì)于數(shù)據(jù)的合理使用,對(duì)于維護(hù)AI模型的準(zhǔn)確性至關(guān)重要。”

“

合成數(shù)據(jù):一個(gè)新出現(xiàn)的挑戰(zhàn)

訓(xùn)練人工智能模型需要大量的數(shù)據(jù),有時(shí)這些數(shù)據(jù)是稀缺的。為了彌補(bǔ)這一不足,研究人員轉(zhuǎn)向了合成數(shù)據(jù)。

從本質(zhì)上講,合成數(shù)據(jù)是基于真實(shí)數(shù)據(jù)集生成的人工數(shù)據(jù)(https://standards.ieee.org/industry-connections/synthetic-data/#:~:text=Synthetic%20data%20is%20artificial%20data,e.g.%2C%20for%20AI%20training).)。它是實(shí)際的,同時(shí)也能夠在統(tǒng)計(jì)上代表原來存在的數(shù)據(jù)。

研究人員明白,盡管合成數(shù)據(jù)有其存在的用途,但過度的依賴合成數(shù)據(jù)也可能導(dǎo)致性能下降,IEEE Spectrum發(fā)表的兩篇研究論文探討了這一想法:https://spectrum.ieee.org/ai-collapse。

Watson說,過度依賴合成數(shù)據(jù)“可能會(huì)縮小視角并強(qiáng)化偏見,因?yàn)槟P涂赡軙?huì)根據(jù)類似系統(tǒng)生成的數(shù)據(jù)進(jìn)行訓(xùn)練”。生成人工智能的快速內(nèi)容生產(chǎn)速度往往加劇了這個(gè)問題。

挑戰(zhàn)可能更加嚴(yán)峻。人工智能模型的開發(fā)者經(jīng)常通過人們的幫助來標(biāo)記數(shù)據(jù)。例如,如果你想開發(fā)一個(gè)識(shí)別圖像情感內(nèi)容的人工智能模型,通常需要人們來對(duì)圖像進(jìn)行評(píng)分。或者有時(shí),研究人員需要大量的調(diào)查數(shù)據(jù),這種勞動(dòng)力極其廉價(jià)——時(shí)薪不到1美元。這些被稱為人類智能任務(wù)(https://www.designboom.com/technology/ai-has-generated-150-years-worth-of-photographs-in-less-than-12-months-study-shows-08-21-2023/)。

“一些人為生成的數(shù)據(jù)可能是不真實(shí)的,”Watson說,“外包給人工智能任務(wù)工作者的任務(wù)使用人工智能越來越自動(dòng)化,導(dǎo)致潛在的偏見和不準(zhǔn)確。公司所需要的自然、高質(zhì)量的數(shù)據(jù),可能需要額外的身份驗(yàn)證層來確保人工生成內(nèi)容的真實(shí)性。”

審核編輯:黃飛

-

AI

+關(guān)注

關(guān)注

87文章

31111瀏覽量

269435 -

人工智能

+關(guān)注

關(guān)注

1792文章

47412瀏覽量

238926 -

自動(dòng)駕駛汽車

+關(guān)注

關(guān)注

4文章

376瀏覽量

40843

原文標(biāo)題:AI模型表現(xiàn)下降的原因

文章出處:【微信號(hào):IEEE_China,微信公眾號(hào):IEEE電氣電子工程師】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

企業(yè)AI模型部署攻略

AI模型托管原理分析

AI大模型與深度學(xué)習(xí)的關(guān)系

ai大模型和ai框架的關(guān)系是什么

ai大模型和傳統(tǒng)ai的區(qū)別在哪?

AI大模型與AI框架的關(guān)系

AI大模型與傳統(tǒng)AI的區(qū)別

AI大模型與小模型的優(yōu)缺點(diǎn)

STM CUBE AI錯(cuò)誤導(dǎo)入onnx模型報(bào)錯(cuò)的原因?

為什么Cubeai導(dǎo)入模型的時(shí)候報(bào)錯(cuò)[AI:persondetection] ModuleNotFoundError: No module named \'_socket\'?

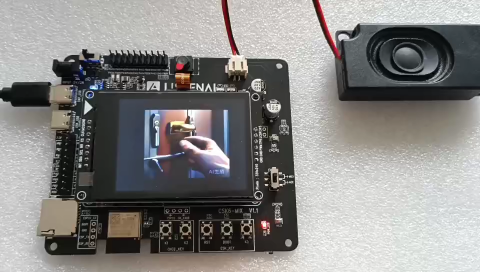

防止AI大模型被黑客病毒入侵控制(原創(chuàng))聆思大模型AI開發(fā)套件評(píng)測(cè)4

什么是AI模型漂移 AI模型表現(xiàn)下降的原因

什么是AI模型漂移 AI模型表現(xiàn)下降的原因

評(píng)論