人工智能(AI)無疑是近幾年最火的技術。從開發到部署AI技術主要可分為兩大步驟,即AI訓練和AI推理。

AI訓練主要是為AI模型提供數據,使其掌握了解將要分析的數據類型所需的一切信息的過程;而AI推理則是通過經過訓練的AI模型運行新的實時數據,從而作出預測并產生可執行結果的過程。

在這兩個過程中,它們對于計算的需求不同,AI訓練的計算周期長,需要大量優質數據,是一次性的投資。AI推理則是短時間的算力需求激增,需要快速、高效能的計算,是一個長期投資。

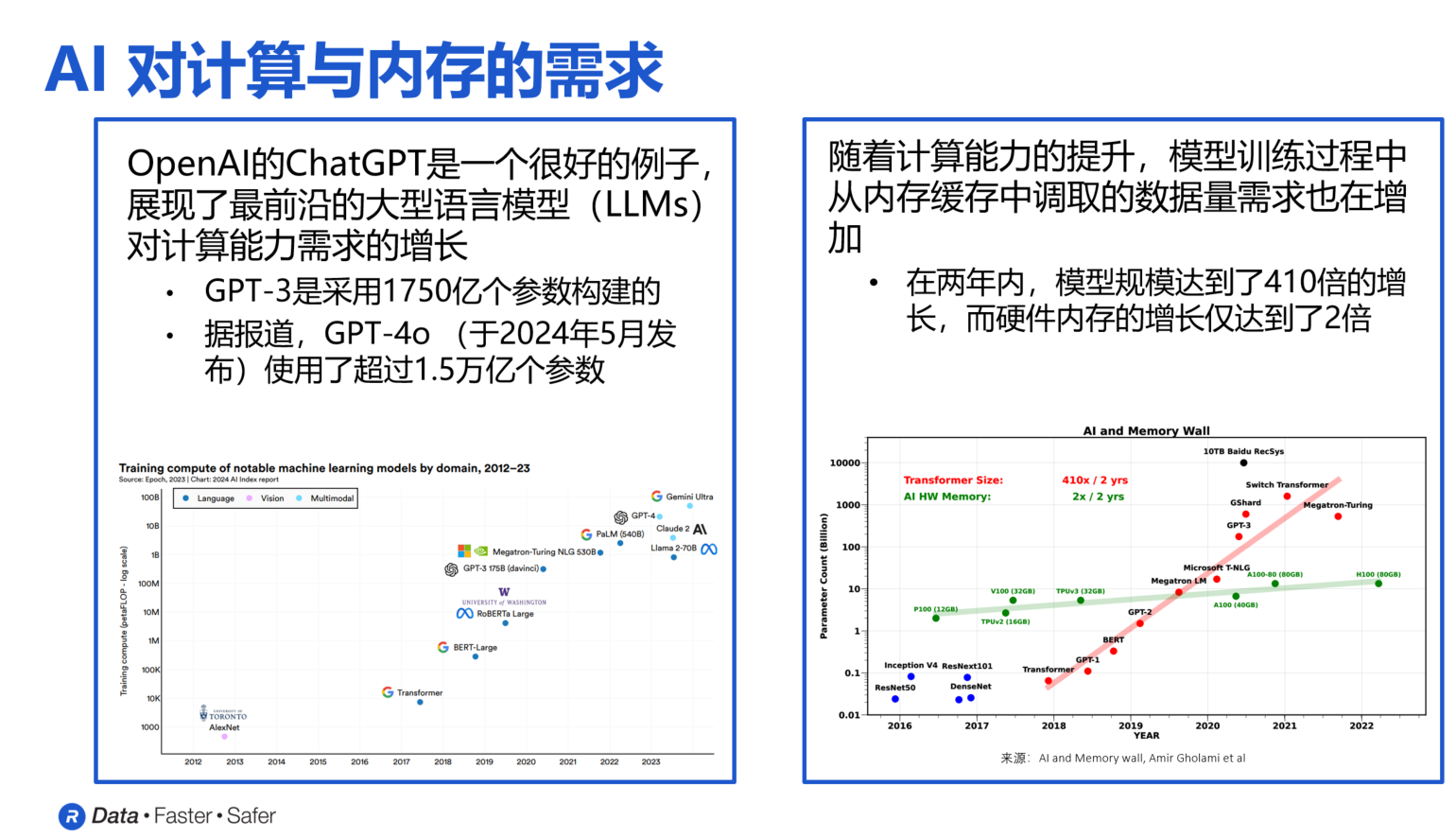

尤其對于AI訓練,隨著AI大模型的復雜度不斷提升,AI訓練所需的數據也在持續增長。根據OpenAI的數據,自2012年以來,最大規模的AI訓練所使用的計算量以每年10倍的速度增長。以OpenAI的ChatGPT為例,2022年11月發布的GPT-3當時使用了1750億個參數構建,而到2023年3月發布的GPT-4時,使用的參數數量已經超過1.5萬億個。這一數據還在持續增長中。

如此大規模的數據總量對于內存提出了較高要求,如高帶寬、高容量、高性能等,傳統的內存產品已經無法滿足AI訓練的需求。而HBM似乎是為AI訓練量身定做的存儲器產品。

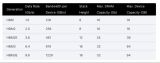

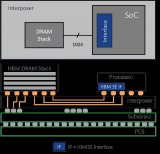

HBM(High Bandwidth Memory,高帶寬存儲器)最先是AMD和SK海力士發起的一種基于3D堆棧工藝的高性能DRAM,它包含了中介層、處理器以及內存堆棧。這意味著HBM可以提供非常高的帶寬,而且還具有非常高的能效及低延遲。目前,HBM內存已經演進了了幾代,最新一代為HBM3E,英偉達即將發布的H200將是首款提供HBM3E的GPU產品。

人工智能技術的發展也帶動了HBM市場的不斷發展,在今年內存市場普遍低迷的情況下,HBM需求井噴,未來幾年的增幅也將擴大。據咨詢機構TrendForce預測,2024年全球HBM的位元供給有望增長105%。到2024年,HBM的市場規模有望達到89億美元,同比增長127%,2025年預計將突破100億美元。

在此情況下,作為內存控制器IP的主要提供商之一,Rambus也積極布局HBM內存市場,近期推出了數據傳輸速率高達9.6Gb/s的HBM3內存控制器IP,可幫助大幅提高AI性能。據Rambus接口IP產品管理和營銷副總裁Joe Salvador先生介紹,Rambus的這一內存控制器IP產品是經過驗證的,可支持所有HBM3產品,也包括最新的HBM3E內存設備。

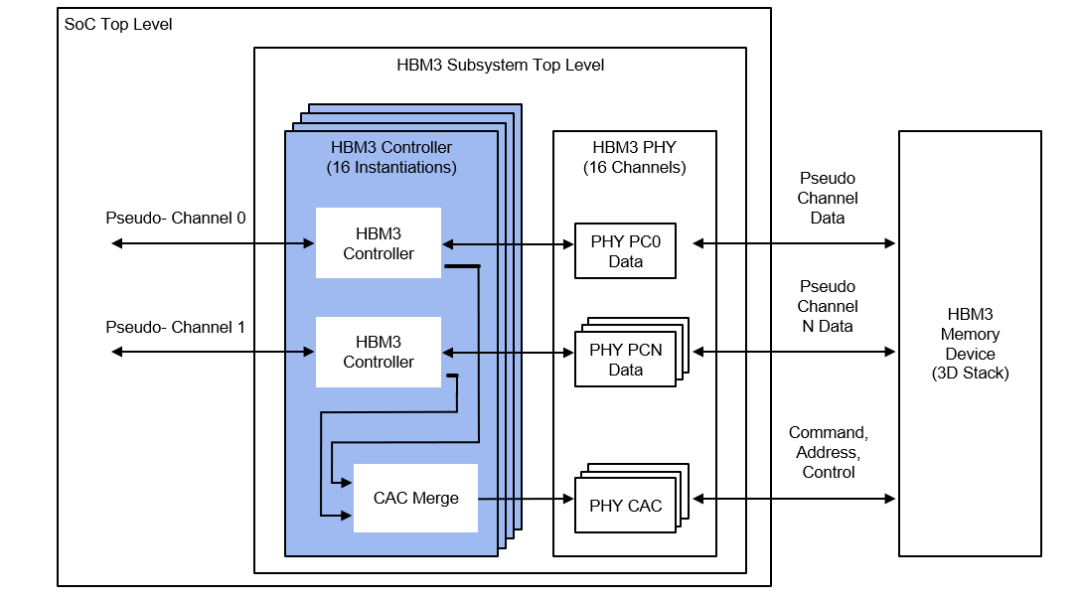

Rambus HBM3控制器模塊圖

Joe Salvador強調:“Rambus HBM3控制器不僅僅是一個獨立產品,我們還能提供一整套完整的經過驗證的解決方案,能夠和市面上目前比較常見的HBM3以及相關的內存模組進行匹配,如SK海力士、美光和三星的產品,我們都已經完成了一整套的測試。另外,我們也經過了第三方來自西門子Avery的驗證IP,也可以完整地支持相應的功能。”

目前,隨著AI技術的不斷發展,對于算力和內存的需求也將不斷增長。Rambus大中華區總經理蘇雷先生表示:“AI技術發展面臨的挑戰將更多集中于存儲墻問題,而算力的演進將不會面臨太多的挑戰。目前的內存和帶寬的發展還是太慢,無法跟上AI技術的發展腳步。作為存儲方面的專家,Rambus可以預見,伴隨著AI的新成長和驅動,我們會在這一輪的科技浪潮中發揮越來越重要的作用,助力AI的發展。”

另外,數據安全也是在AI技術發展中不可忽視的問題。蘇雷表示:“我們也提供安全IP方面的全套方案,讓數據傳輸更快、更安全。”

AI時代的來臨,帶來了很多挑戰和機遇。而對于存儲器市場來說,則是一次很好的發展機會。作為存儲行業的老兵,Rambus未來也大有可為。

審核編輯:劉清

-

控制器

+關注

關注

112文章

16409瀏覽量

178688 -

人工智能

+關注

關注

1792文章

47458瀏覽量

239113 -

ai技術

+關注

關注

1文章

1283瀏覽量

24368 -

HBM3

+關注

關注

0文章

74瀏覽量

162

原文標題:【媒體報道】術業專攻,Rambus推出9.6Gbps HBM3內存控制器IP

文章出處:【微信號:Rambus 藍鉑世科技,微信公眾號:Rambus 藍鉑世科技】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

HBM格局生變!傳三星HBM3量產供貨英偉達,國內廠商積極布局

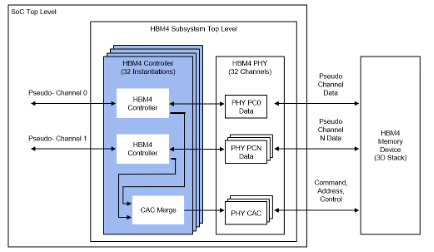

HBM4進一步打破內存墻,Rambus控制器IP先行

Rambus推出業界首款HBM4控制器IP

Rambus宣布推出業界首款HBM4控制器IP,加速下一代AI工作負載

中國AI芯片和HBM市場的未來

Rambus推GDDR7內存控制器IP滿足AI應用需求

三星LPDDR5X DRAM內存創10.7Gbps速率新高

HBM3E起飛,沖鋒戰鼓已然擂響

NVIDIA預定購三星獨家供應的大量12層HBM3E內存

英偉達CEO贊譽三星HBM內存,計劃采購

什么是HBM3E內存?Rambus HBM3E/3內存控制器內核

AMD MI300加速器將支持HBM3E內存

AMD發布HBM3e AI加速器升級版,2025年推新款Instinct MI

Rambus HBM3內存控制器IP速率達到9.6 Gbps

Rambus推出9.6Gbps HBM3內存控制器IP

Rambus推出9.6Gbps HBM3內存控制器IP

評論