Nvidia 表示,H200 Tensor Core GPU 具有更大的內存容量和帶寬,可加快生成 AI 和 HPC 工作負載的速度。

Nvidia H200 是首款提供 HBM3e 的 GPU,HBM3e 是更快、更大的內存,可加速生成式 AI。

H200 芯片定于 2024 年第二季度發布,Nvidia 表示將與“全球系統制造商和云服務提供商”合作以實現廣泛可用性。

JAEALOT

Nvidia

OpenAI推出ChatGPT已經一段時間了 ,全球對AI芯片的需求比以往任何時候都更加難以滿足。如今,大多數大型科技公司都將注意力集中在生成式人工智能上。對于制造數量最多、性能最高的圖形處理單元 (GPU) 的公司 Nvidia 公司來說,現在的情況從未如此好過。在發布了數十款芯片以滿足看似呈指數級增長的人工智能市場之后,這家圖形芯片巨頭展示了迄今為止最強大的 GPU——H200。

NVIDIA H200 Tensor Core GPU 誕生之際,Nvidia 正在努力捍衛其 在 AI 計算領域的主導地位 ,面對 英特爾、AMD以及眾多芯片初創公司和 Amazon Web Services 等試圖搶占市場份額的云服務提供商。在生成人工智能工作負載驅動的芯片需求激增的情況下,市場份額不斷增加。

為了保持在人工智能和高性能計算 (HPC) 硬件領域的領先地位,英偉達上月初公布了加快新 GPU 架構開發的計劃。根據為投資者發布的路線圖 以及 SemiAnalysis的進一步解釋,這個想法是要恢復到一年一次的產品推出節奏 。SemiAnalysis 的報告中寫道:“Nvidia 對 AI GPU 進行年度更新的舉動非常重要,并且會產生許多影響。”

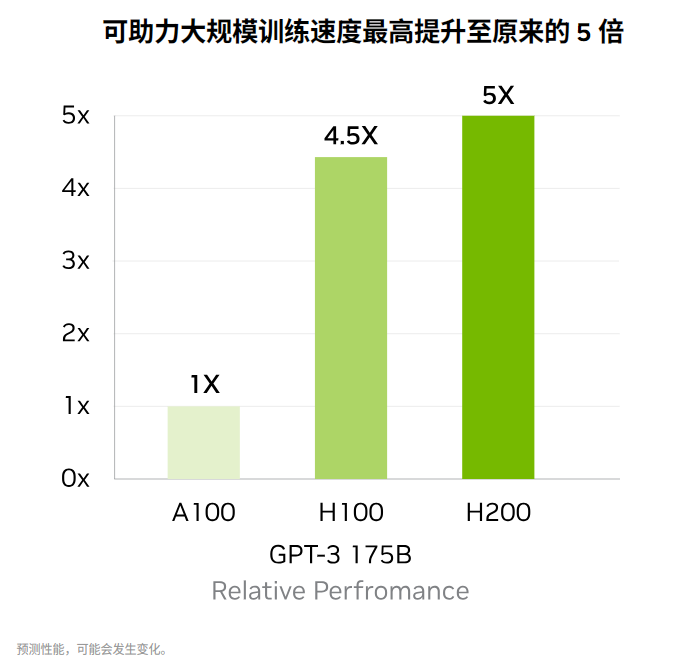

這一切的開始就是 Nvidia 推出的 H200,它利用 Hopper 架構來加速人工智能應用程序。它是去年發布的H100 GPU的后續產品 ,也是此前 Nvidia 最強大的 AI GPU 芯片。簡而言之,H200 現在是 Nvidia 產品組合中最強大的 AI 芯片。

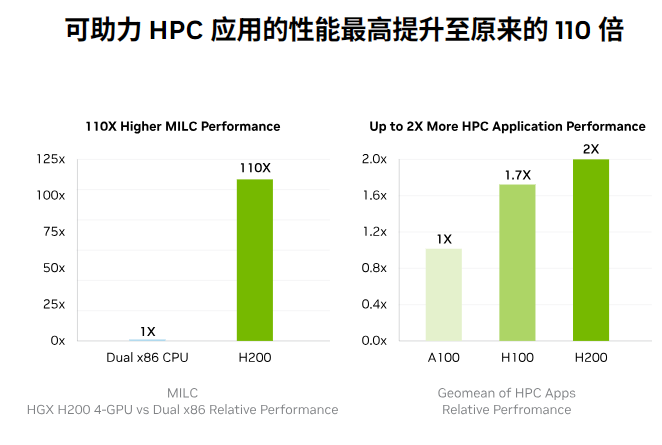

Nvidia 超大規模和 HPC 副總裁 Ian Buck 認為,“借助業界領先的端到端 AI 超級計算平臺 Nvidia H200,可以更快地解決世界上一些最重要的挑戰。” 一般來說,GPU 在人工智能應用中表現出色,因為它們能夠執行大量并行矩陣乘法,這是神經網絡運行的關鍵操作。

它們在構建人工智能模型的訓練階段和隨后的“推理”階段都發揮著至關重要的作用,在“推理”階段,用戶將數據輸入到人工智能模型中,并提供相應的結果。Buck 指出:“要通過生成式 AI 和 HPC 應用程序創建智能,必須使用大容量、快速的 GPU 內存高速有效地處理大量數據。”

因此,引入 H200 將帶來進一步的性能飛躍,包括與 H100 相比,Llama 2(一個 700 億參數的 LLM)的推理速度幾乎翻倍。據 Nvidia 稱,未來的軟件更新預計會帶來 H200 的額外性能領先優勢和改進。

雖然 H200 看起來與 H100 基本相似,但其內存的修改有明顯的增強。新的 GPU 引入了一種創新且更快的內存規范,稱為 HBM3e。這將 GPU 的內存帶寬提升至每秒 4.8 TB,比 H100 的每秒 3.35 TB 明顯增加。它將總內存容量從前代產品的 80GB 擴展至 141GB。

“Nvidia H200 是首款提供 HBM3e 的 GPU,HBM3e 速度更快、內存更大,可加速生成式 AI 和大型語言模型 (LLM),同時推進 HPC 工作負載的科學計算。憑借 HBM3e,NVIDIA H200 以每秒 4.8 TB 的速度提供 141GB 內存,與前身 NVIDIA A100 相比,容量幾乎翻倍,帶寬增加 2.4 倍。”該芯片巨頭 表示。

結合實際情況來看,OpenAI 經常提到面臨 GPU 資源短缺,導致 ChatGPT 性能下降的問題。為了維持任何水平的服務,該公司采取速率限制。理論上,加入H200可以緩解當前運行ChatGPT的AI語言模型的資源限制,使它們能夠有效地迎合更廣泛的客戶群。

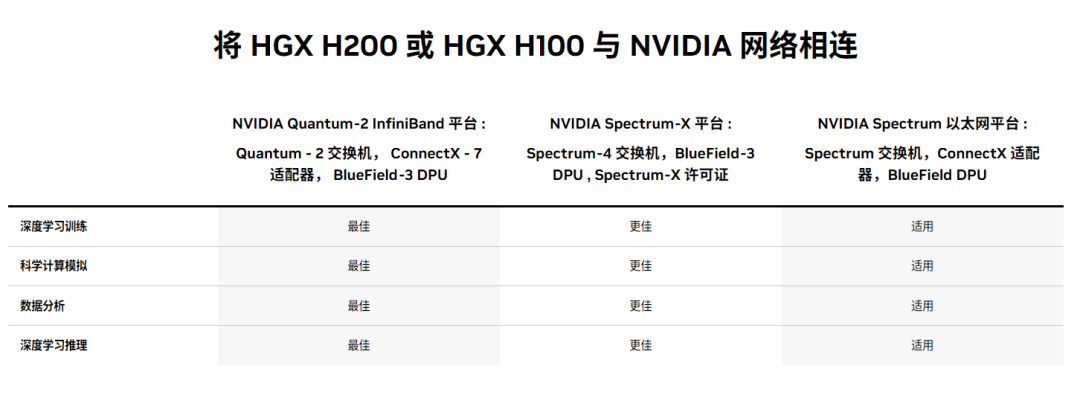

Nvidia 還表示,它將提供多種外形規格的 H200。其中包括四路和八路配置的 Nvidia HGX H200 服務器主板,與 HGX H100 系統的硬件和軟件兼容。它還將在 Nvidia GH200 Grace Hopper Superchip 中提供,它將 CPU 和 GPU 組合到一個封裝中。

“通過這些選項,H200 可以部署在各種類型的數據中心中,包括本地、云、混合云和邊緣。NVIDIA 的 全球合作伙伴服務器制造商生態系統 (包括華擎 Rack、華碩、戴爾科技、Eviden、技嘉、惠普企業、英格拉科技、聯想、QCT、Supermicro、緯創資通和 Wiwynn)可以使用 H200 更新其現有系統。” 。

據美國芯片巨頭亞馬遜網絡服務(AWS)稱,除了CoreWeave、Lambda、和烏爾特爾。目前,英偉達在AI GPU市場處于領先地位。

然而,AWS、谷歌、微軟等主要參與者以及 AMD 等傳統 AI 和 HPC 實體正在積極準備 其下一代處理器用于訓練和推理。為了應對這種競爭格局,Nvidia 加快了基于 B100 和 X100 的產品進度。

-

芯片

+關注

關注

455文章

50817瀏覽量

423680 -

NVIDIA

+關注

關注

14文章

4986瀏覽量

103067 -

人工智能

+關注

關注

1791文章

47279瀏覽量

238513

發布評論請先 登錄

相關推薦

Nvidia 正在利用迄今為止最強大的芯片 H200 推動人工智能革命

Nvidia 正在利用迄今為止最強大的芯片 H200 推動人工智能革命

評論