電子發燒友網報道(文/周凱揚)AI大模型似乎陷入了一個怪圈,盡管對于深度學習、數據優化和爆款應用的研究從來沒有終止,但大多數人開口問的第一句話就是,“你有卡嗎”?從行業對GPU的狂熱追求來看,未來繼續擴展大模型的機會,似乎只會被大公司掌握在手中。

xAI拉攏戴爾和超微打造AI超算,馬斯克繼續買買買

xAI作為2023年3月才成立的一家初創公司,在構建算力基礎設施的投入上卻一點也不含糊,不過這也多虧了背后的金主埃隆馬斯克。近日,戴爾CEO Michael Dell宣布他們正在打造一個由英偉達GPU驅動的AI工廠,為xAI的Grok模型提供動力。不過馬斯克隨即表示,戴爾只是其中一半服務器集群的供應商,另外一半的超算系統則是由超微打造。

由此推測,這一AI工廠應該就是馬斯克在月初提到的10萬塊H100液冷訓練集群了,盡管有兩家供應商同時為xAI打造服務器,但市面上的GPU需求依然維持在高位,還需要幾個月這一集群才會正式上線,用于Grok的下一代大模型迭代。

H100這張2023年發布的GPU可以說是目前全球大模型算力供應的主力,無論是OpenAI還是xAI,其最新模型都是基于該GPU訓練迭代的。H100無論是顯存容量、帶寬和算力性能都實現了一輪新的突破,甚至可以說H100帶動了這一代AI大模型的發展,然而在GTC之后,馬斯克已經開始眼饞最新的B200了。他認為考慮到目前的技術演進速度,實在不值得把1GW的電力供應給H100。

為此xAI也已經開始在規劃下一代系統,據馬斯克透露,該系統將由30萬塊B200 GPU組成,但上線時間需要等到明年夏天了。B200速度高達H100的4倍,更是可以輕松做到單機柜1exaflop的算力表現,更何況在能耗成本上,B200相比H100改善了20多倍,即便是大規模部署,也不會讓廠商面臨供電和碳足跡的雙重困擾。

盡管xAI的AI超算目標已經明確,但對于馬斯克旗下的另一家公司特斯拉而言,其技術路線依舊不算明朗。雖然特斯拉也開啟了新一輪的英偉達GPU采購潮,但其內部也在繼續發展自研的Dojo超算。只不過近年來Dojo的情報越來越少,就連馬斯克自己也將其列入“遠景計劃”之列。

OpenAI與微軟,“鯨級”超算已在全速運轉中

相信不少人都還記得去年11月首度上榜TOP500的微軟超算Eagle,這臺空降第三的AI超算憑借14400個英偉達H100和561PFlop/s的算力,不僅讓Azure系統再次闖進了前十,還拿下了當下云端超算最高的排名。而當時的Azure還未部署完成,雖然最新的排名中Eagle依然維持在第三的位置,但其核心數已經近乎翻倍。

這臺超算為OpenAI的GPT-4訓練和推理提供了極大的助力,但這遠沒有達到微軟的財力極限。早在3月底,就有消息傳出微軟和OpenAI正在打造一個代號名為“星門”的AI超算,耗資高達1000億美元。微軟CTO Kevin Scott稱不少有關其超算計劃的推測簡直錯得可笑,但也指出他們確實會為這一計劃付出不少努力和成本。

在上個月舉辦的Microsoft Build中,Kevin Scott公開透露了他們未來的超算擴展計劃。2020年,微軟為OpenAI打造了第一臺AI超算,正是因為這臺機器才孕育了GPT-3。而他們構建的下一個系統,也就是Eagle,則用于訓練GPT-4。Kevin Scott選擇了用海洋生物來描述這些超算的規模,比如首臺超算可以用鯊魚來描述,Eagle則是虎鯨,而他們的下一臺超算規模則可以比擬藍鯨。

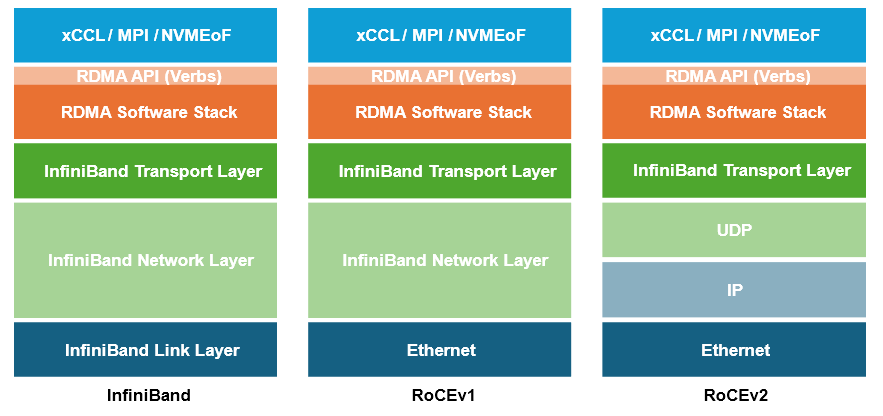

Kevin Scott更是強調,別看現在Eagle可以排到第三名的位置,從現在開始微軟每個月都會部署五臺同樣規模的超算,也就是說每月都有至少搭載72000個H100 GPU或同等規模系統投入應用,每月帶來2.8exaflops的算力增長。同時,他們用來連接GPU的高速和InfiniBand線纜可以繞地球至少五周,也就是說長度在20萬公里以上總線纜長度。

很明顯,作為已經憑借OpenAI獲得成功的微軟來說,接下來需要贏下的就是這場Scaling之戰。

TPU和GPU并用,谷歌的Hypercomputer

盡管不少巨頭都在考慮如何自研芯片來降低購置海量GPU帶來的成本,但真的成功將其用于大模型的訓練中去的,已經迭代至第六代的谷歌TPU,恰好就為谷歌解決了這個問題。TPU作為谷歌和博通聯合設計了幾代的產品,在谷歌自己推出的各種新模型訓練與推理中,重要性已經等同于英偉達的GPU了。

谷歌本身作為在AI算法和大模型上耕耘了諸多時間的巨頭,從設計芯片之初就知道他們需要何種計算資源,正因如此,TPU幾乎將所有的面積都分給了低精度的張量計算單元。這種ASIC方案也讓谷歌大幅降低了打造AI Hypercomputer的成本。

但谷歌作為云服務廠商巨頭還是逃不開通用性的問題,谷歌的TPU更多是為Gemini的模型做了優化,盡管TPU支持PyTorch、Tensorflow等常見AI模型,但在追求極致性能的選擇上,還是難以媲美GPU。正因如此,在谷歌和其他大模型開發者的眼中,TPU固然性能不弱,但更像是一個性價比之選。用于已經成功商業化模型的降本增效屬于不錯的選擇,但如果想要在這個競爭激烈的大模型市場殺出重圍,那就只有谷歌能將TPU物盡其用。

在不少AI芯片廠商的宣傳中,為了抬高自己的專用產品定位,將英偉達的GPU還是定性為圖形處理單元。可在H100這種規模的GPU上,無論是性能和能效,也毫不輸某些專用開發環境下的ASIC,至于未來更復雜的圖形處理,英偉達也推出了L4 GPU這樣的對應方案。

在今年GTC上,谷歌的云服務部門也宣布和英偉達達成深度合作關系,通過英偉達的H100和L4 GPU支持使用其云服務的AI開發者。同時谷歌也將購置GB200 NVL72系統,基于谷歌云的A3實例為開發者提供DGX Cloud的云端LLM托管方案,這也是對現有H100機器的升級。除此之外,就連谷歌自己的JAX框架,也在雙方的合作之下,在英偉達的GPU上得到了支持。可以看出,谷歌還是采取兩手抓的策略,TPU和GPU一并重要。

全力追逐Scaling Laws的大廠們

對于AI大模型而言,模型大小、數據集大小和計算成本之間不僅組成了三元關系,也代表了模型性能。而Scaling Laws這一擴展法則定義了三者之間勢必會存在某種比例擴展,只不過如今看來,其邊際效應已經變得越來越大。以GPT為例,如果GPT-6繼續按照這樣的比例擴展下去,且不說性能提升有限,即便微軟這樣的商業巨頭也很難撐起成本的劇增。

可就是這樣微不可察的差距,甚至對于AI大模型的常見應用聊天機器人來說只是速度和精度上的一些差距,卻決定了他們在之后的十幾年里能否繼續制霸下去。微軟作為已經在操作系統上實現霸權地位的廠商,自然也明白先入為主的重要性。

在邊際效應的影響下,即便后入局的巨頭,也有不少迎頭趕上的機會,比如近期傳出正在秘密研發Metis聊天機器人的亞馬遜。亞馬遜同樣擁有自研服務器芯片的技術積累,但主要優勢還是在CPU上,AI加速器相關的產品(Inferentia和Trainium)依舊有比較大的改進空間,而且與亞馬遜自己的業務還沒有緊密結合起來。如果亞馬遜愿意去打造這樣一個聊天機器人應用,很有可能后續也會加強在GPU上的投入,而不再緊緊作為云托管方案。

-

gpu

+關注

關注

28文章

4742瀏覽量

128980 -

AI

+關注

關注

87文章

30979瀏覽量

269253

發布評論請先 登錄

相關推薦

小米加速布局AI大模型,搭建GPU萬卡集群

《算力芯片 高性能 CPUGPUNPU 微架構分析》第3篇閱讀心得:GPU革命:從圖形引擎到AI加速器的蛻變

【「算力芯片 | 高性能 CPU/GPU/NPU 微架構分析」閱讀體驗】--全書概覽

名單公布!【書籍評測活動NO.43】 算力芯片 | 高性能 CPU/GPU/NPU 微架構分析

算力服務器為什么選擇GPU

摩爾線程與師者AI攜手完成70億參數教育AI大模型訓練測試

萬卡集群解決大模型訓算力需求,建設面臨哪些挑戰

卡都去哪了?AI超算成了GPU的無底黑洞

卡都去哪了?AI超算成了GPU的無底黑洞

評論