卷積神經網絡(Convolutional Neural Network, CNN)是一種深度學習模型,廣泛應用于圖像識別、視頻分析、自然語言處理等領域。本文將詳細介紹卷積神經網絡的計算過程和步驟。

- 卷積層(Convolutional Layer)

卷積層是卷積神經網絡的核心組成部分,它通過卷積操作提取輸入數據的特征。卷積操作是一種數學運算,用于計算輸入數據與卷積核(或濾波器)之間的局部相關性。卷積層的計算過程如下:

1.1 初始化卷積核

在卷積層中,卷積核是一個小的矩陣,用于在輸入數據上滑動以提取特征。卷積核的數量通常與輸出通道的數量相同。每個卷積核負責提取輸入數據的一種特征。

1.2 卷積操作

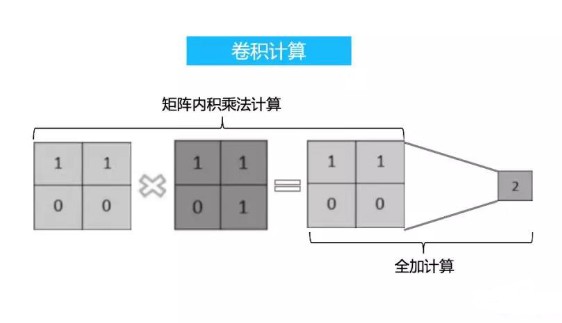

卷積操作包括以下步驟:

a. 將卷積核滑動到輸入數據的第一個位置。

b. 計算卷積核與輸入數據的局部區域之間的點積。

c. 將結果存儲在輸出特征圖的一個位置。

d. 將卷積核向右滑動一個像素,重復步驟b和c,直到覆蓋整個輸入數據的寬度。

e. 將卷積核向下滑動一個像素,重復步驟a至d,直到覆蓋整個輸入數據的高度。

1.3 激活函數

在卷積操作之后,通常會應用一個非線性激活函數,如ReLU(Rectified Linear Unit),以引入非線性特性,增強模型的表達能力。

- 池化層(Pooling Layer)

池化層用于降低特征圖的空間維度,減少參數數量,防止過擬合。常見的池化操作有最大池化(Max Pooling)和平均池化(Average Pooling)。

2.1 最大池化

最大池化操作是選擇輸入特征圖的局部區域內的最大值作為輸出。這有助于保留最重要的特征,同時減少數據量。

2.2 平均池化

平均池化操作是計算輸入特征圖的局部區域內所有值的平均值作為輸出。這有助于平滑特征圖,減少噪聲。

- 全連接層(Fully Connected Layer)

全連接層是卷積神經網絡的最后一層或接近最后一層,用于將特征圖轉換為最終的輸出。在全連接層中,每個輸入神經元都與每個輸出神經元相連。

3.1 權重初始化

在全連接層中,權重矩陣需要進行初始化。常用的初始化方法有隨機初始化、Xavier初始化和He初始化。

3.2 前向傳播

在前向傳播過程中,輸入特征圖通過權重矩陣和偏置向量進行線性變換,然后應用激活函數。

3.3 激活函數

常用的激活函數有Sigmoid、Tanh和ReLU。ReLU因其計算簡單和訓練速度快而被廣泛使用。

- 損失函數(Loss Function)

損失函數用于衡量模型預測值與真實值之間的差異。常見的損失函數有均方誤差(Mean Squared Error, MSE)、交叉熵(Cross-Entropy)等。

4.1 均方誤差

均方誤差是預測值與真實值之差的平方的平均值。它適用于回歸問題。

4.2 交叉熵

交叉熵是預測概率分布與真實概率分布之間的差異度量。它適用于分類問題。

- 反向傳播(Backpropagation)

反向傳播是卷積神經網絡訓練過程中的關鍵步驟,用于計算損失函數關于網絡參數的梯度。反向傳播的過程如下:

5.1 計算梯度

從損失函數開始,逐層向上計算每個參數的梯度。

5.2 應用鏈式法則

在計算梯度時,使用鏈式法則將梯度從下一層傳遞到上一層。

5.3 更新參數

使用梯度下降或更高級的優化算法(如Adam、RMSprop等)更新網絡參數。

- 正則化(Regularization)

正則化是防止模型過擬合的技術。常見的正則化方法有L1正則化、L2正則化和Dropout。

6.1 L1正則化

L1正則化通過在損失函數中添加參數的絕對值之和來懲罰大的參數值。

6.2 L2正則化

L2正則化通過在損失函數中添加參數的平方和來懲罰大的參數值。

6.3 Dropout

Dropout是一種隨機丟棄網絡中一部分神經元的技術,以防止網絡對訓練數據過度擬合。

-

圖像識別

+關注

關注

9文章

520瀏覽量

38273 -

模型

+關注

關注

1文章

3244瀏覽量

48843 -

深度學習

+關注

關注

73文章

5503瀏覽量

121170 -

卷積神經網絡

+關注

關注

4文章

367瀏覽量

11865

發布評論請先 登錄

相關推薦

卷積神經網絡計算過程和步驟

卷積神經網絡計算過程和步驟

評論