本文簡要介紹了經(jīng)典圖神經(jīng)網(wǎng)絡(luò)(GNNs)的基準分析研究,發(fā)表在 NeurIPS 2024。

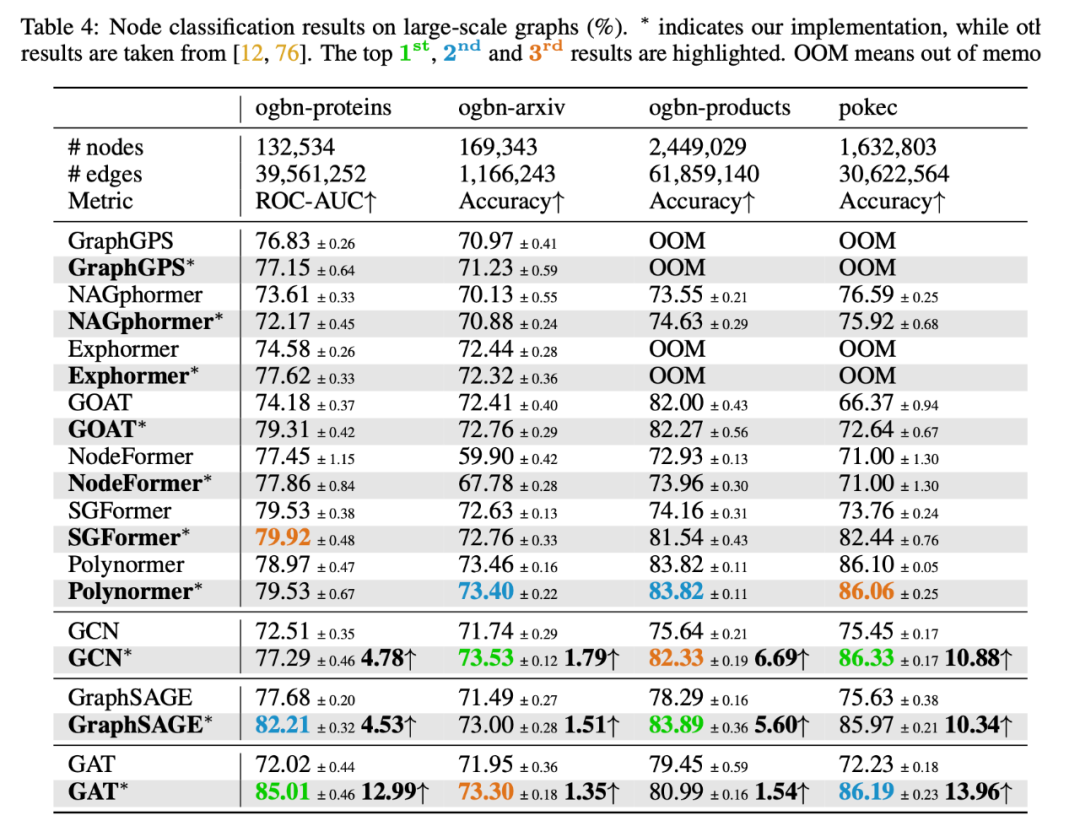

文章回顧了經(jīng)典 GNNs 模型在節(jié)點分類任務上的表現(xiàn),結(jié)果發(fā)現(xiàn)過去 SOTA 圖學習模型報告的性能優(yōu)越性可能是由于經(jīng)典 GNNs 的超參數(shù)配置不佳。通過適當?shù)某瑓?shù)調(diào)整,經(jīng)典 GNNs 模型在 18 個廣泛使用的節(jié)點分類數(shù)據(jù)集中的 17 個上超越了最新的圖學習模型。本研究旨在為 GNNs 的應用和評估帶來新的見解。

論文題目:Classic GNNs are Strong Baselines: Reassessing GNNs for Node Classification

論文鏈接:

https://arxiv.org/abs/2406.08993

代碼鏈接:

https://github.com/LUOyk1999/tunedGNN

引言節(jié)點分類是圖機器學習中的一個基本任務,在社交網(wǎng)絡(luò)分析、生物信息學和推薦系統(tǒng)等多個領(lǐng)域中具有廣泛的高影響力應用。圖神經(jīng)網(wǎng)絡(luò)(GNNs)已成為解決節(jié)點分類任務的強大模型。 GNNs 通過迭代地從節(jié)點的鄰居中聚合信息,這一過程被稱為消息傳遞,利用圖結(jié)構(gòu)和節(jié)點特征來學習有用的節(jié)點表示進行分類。盡管 GNNs 取得了顯著的成功,但研究指出它們存在一些局限性,包括過度平滑、過度壓縮、對異質(zhì)性缺乏敏感性以及捕獲長距離依賴的挑戰(zhàn)。 最近,Graph Transformer(GTs)作為 GNN 的替代模型受到越來越多的關(guān)注。與主要聚合局部鄰域信息的 GNNs 不同,Transformer 架構(gòu)通過自注意力層可以捕獲任意節(jié)點對之間的交互。GTs 在圖級任務(如涉及小規(guī)模圖的分子圖分類)上取得了顯著成功。 這一成功激發(fā)了嘗試將 GTs 應用于節(jié)點分類任務的努力,特別是在大規(guī)模圖上,以應對 GNNs 的上述局限性。盡管最新的 GTs 取得了令人鼓舞的成果,但觀察到許多此類模型在顯性或隱性層面上仍然依賴于消息傳遞來學習局部節(jié)點表示,將其與全局注意力機制結(jié)合以獲得更全面的表示。 這促使我們重新思考:消息傳遞 GNNs 在節(jié)點分類中的潛力是否被低估了?雖然已有研究在一定程度上解決了這一問題,但這些研究在范圍和全面性上仍存在局限性,例如數(shù)據(jù)集數(shù)量和多樣性有限,以及超參數(shù)的考察不完整。 在本研究中,我們?nèi)嬷匦略u估了 GNNs 在節(jié)點分類中的表現(xiàn),使用了三種經(jīng)典的 GNNs 模型—— GCN、GAT和 GraphSAGE ——并在 18 個真實世界的基準數(shù)據(jù)集上進行了測試,包括同質(zhì)性、異質(zhì)性和大規(guī)模圖。 我們考察了 GNNs 訓練中的關(guān)鍵超參數(shù)對其性能的影響,包括 normalization、dropout、residual connections 和 network depth。主要發(fā)現(xiàn)總結(jié)如下:

經(jīng)過適當?shù)某瑓?shù)調(diào)整,經(jīng)典 GNNs 在同質(zhì)性和異質(zhì)性圖中的節(jié)點分類任務中均能取得高度競爭力的性能,甚至在節(jié)點數(shù)量達百萬量級的大規(guī)模圖上也是如此。值得注意的是,經(jīng)典 GNNs 在 18 個數(shù)據(jù)集中有 17 個超越了最先進的圖學習模型,表明 GTs 對比 GNNs 所宣稱的優(yōu)勢可能是由于在 GNNs 評估中超參數(shù)配置不佳

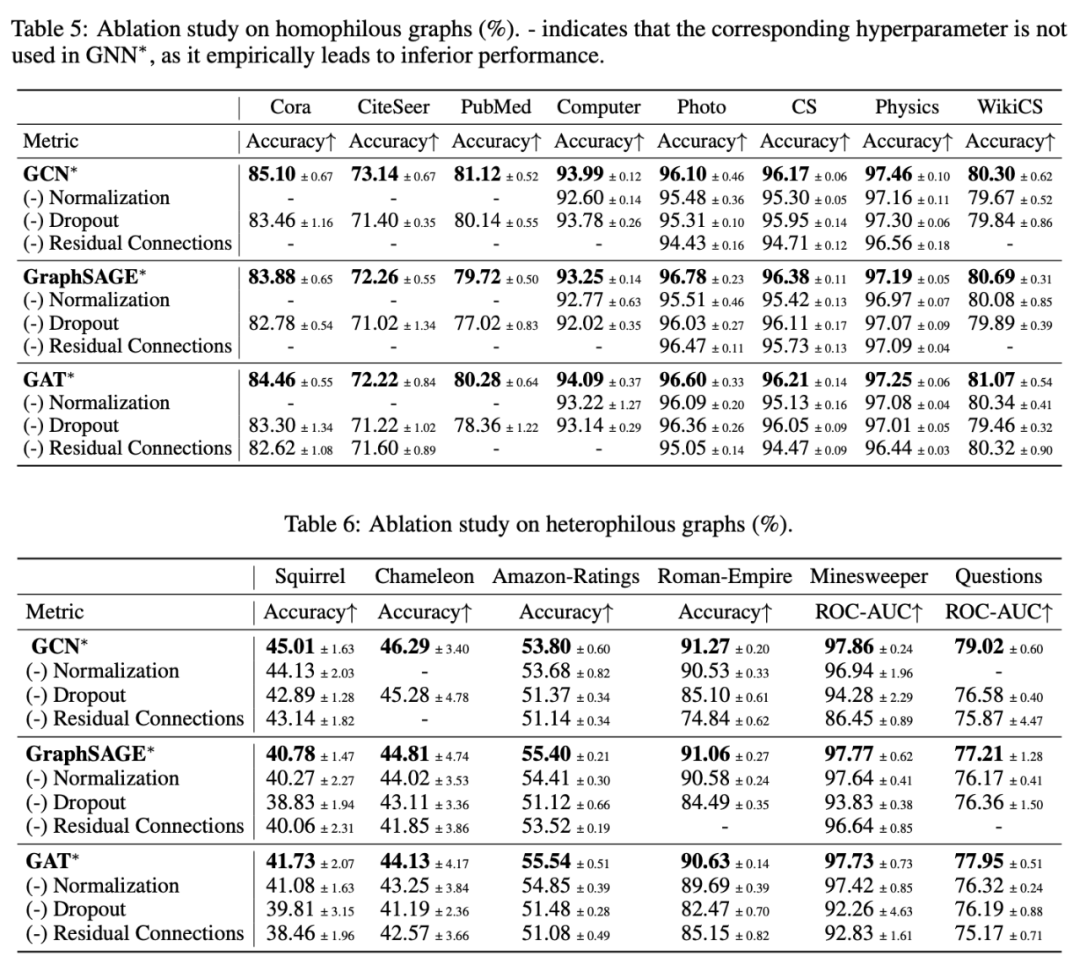

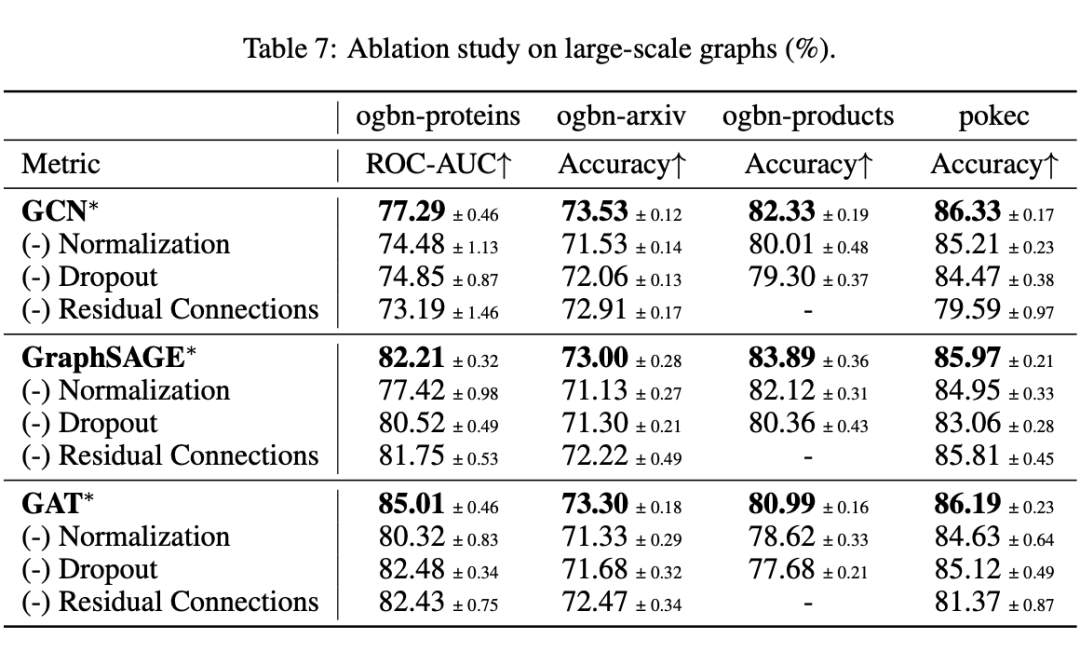

我們的消融研究對 GNNs 節(jié)點分類中的超參數(shù)提供了見解。我們驗證了:

Normalization 對于大規(guī)模圖至關(guān)重要

Dropout 一致地表現(xiàn)出積極影響

Residual connections 在異質(zhì)性圖上可以顯著增強性能

在異質(zhì)性圖上,較深的層數(shù)可能更適合 GNNs

方法介紹

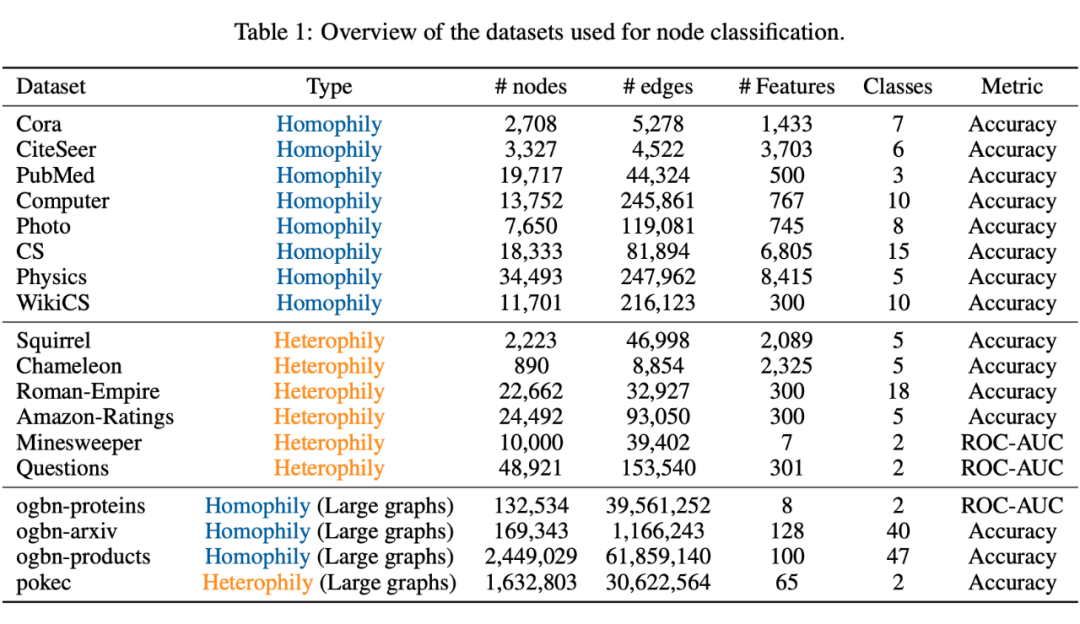

2.1 數(shù)據(jù)集概述

同質(zhì)性圖:Cora、CiteSeer 和 PubMed 是三種常用的引用網(wǎng)絡(luò)[1]。我們遵循傳統(tǒng)的半監(jiān)督設(shè)定[2]來劃分數(shù)據(jù)集。此外,Computer 和 Photo 是公共購買網(wǎng)絡(luò)[3],CS 和 Physics是公共作者網(wǎng)絡(luò)[3],我們采用訓練/驗證/測試劃分為 60%/20%/20% 的標準[4]。我們還使用了 Wiki-CS [5],該數(shù)據(jù)集是由計算機科學論文組成的引用網(wǎng)絡(luò),我們使用[5]的劃分。

異質(zhì)性圖:Squirrel 和 Chameleon 是兩個 Wikipedia 特定主題的頁面網(wǎng)絡(luò)[6]。我們采用異質(zhì)圖基準測試[7]中的新的數(shù)據(jù)集劃分。此外,我們還使用 Roman-Empire、Amazon-Ratings、Minesweeper 和 Questions 四個異質(zhì)性數(shù)據(jù)集[7],這些數(shù)據(jù)集的劃分和評估指標遵循其來源[7]的標準。大規(guī)模圖:我們使用了由 Open Graph Benchmark(OGB)[8]發(fā)布的多個大規(guī)模圖,包括 ogbn-arxiv、ogbn-proteins 和 ogbn-products,節(jié)點數(shù)量從 0.16M 到 2.4M 不等。此外,我們還分析了社交網(wǎng)絡(luò) pokec [9]的性能表現(xiàn)。

2.2 超參數(shù)設(shè)置

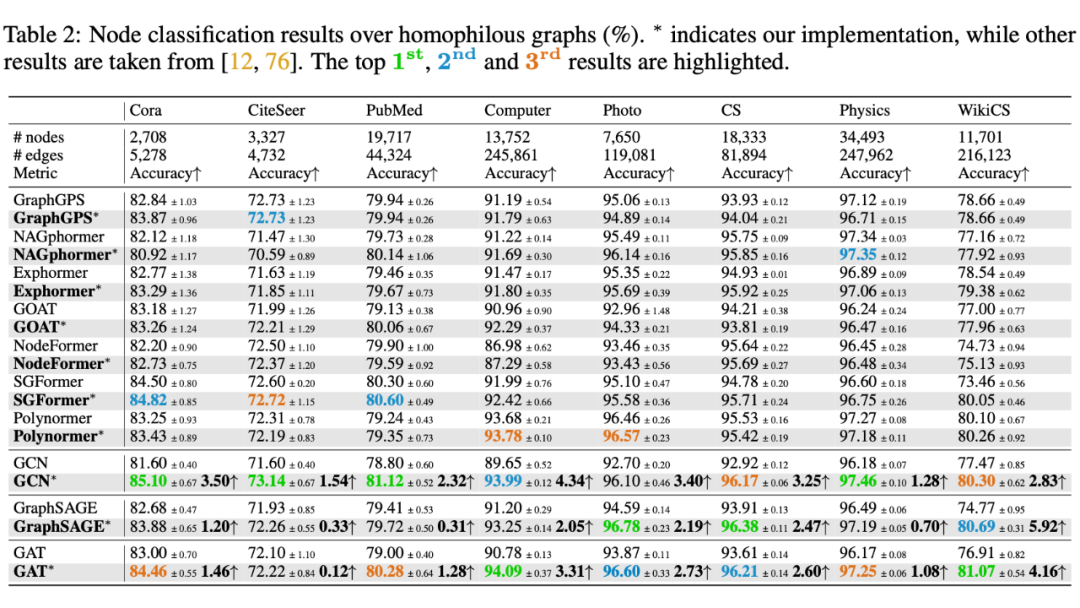

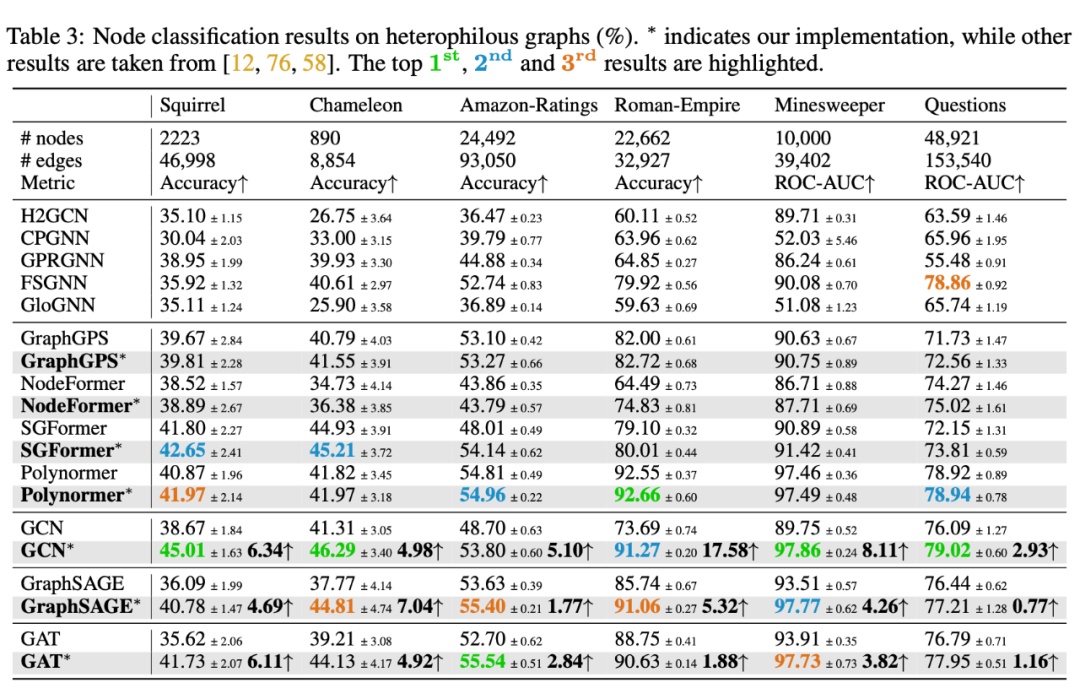

我們的重點在于經(jīng)典 GNNs 模型(GCN、GraphSAGE、GAT)與最先進的圖學習模型的比較。我們對經(jīng)典 GNNs 進行了超參數(shù)調(diào)整,并與 Polynormer [4] 的超參數(shù)搜索空間保持一致。同時,所有基準baselines也在相同的超參數(shù)搜索空間和訓練環(huán)境下重新訓練。

2.3 關(guān)鍵超參數(shù)在本節(jié)中,我們概述了 GNNs 訓練中的關(guān)鍵超參數(shù),包括 normalization、dropout、residual connections 和 network depth。這些超參數(shù)在不同類型的神經(jīng)網(wǎng)絡(luò)中被廣泛應用,以提升模型性能:

Normalization:在每一層激活函數(shù)之前使用 layer normalization(LN)或 batch normalization(BN),可以減少協(xié)變量偏移,穩(wěn)定訓練過程并加速收斂。

Dropout:在激活函數(shù)之后對特征嵌入使用 dropout 來減少隱藏神經(jīng)元間的共適應,有助于降低 GNNs 中消息傳遞的共適應效應。

Residual Connections:通過在層之間引入 residual connections,可以緩解梯度消失問題,增強 GNNs 的表現(xiàn)力。

Network Depth:盡管深層網(wǎng)絡(luò)能夠提取更復雜的特征,但 GNNs 在深度上面臨獨特挑戰(zhàn),如過度平滑等。因此,大多數(shù) GNNs 采用較淺的結(jié)構(gòu),通常包含 2 到 5 層。然而,我們的實驗發(fā)現(xiàn)如果搭配上 residual connections,GNNs 可以拓深至 10 層的網(wǎng)絡(luò)。

實驗結(jié)果

3.1 主要發(fā)現(xiàn)

關(guān)于同質(zhì)性圖的觀察:經(jīng)典 GNNs 在同質(zhì)性圖的節(jié)點分類任務中,僅需對超參數(shù)進行輕微調(diào)整,便能夠具備很強的競爭力,且在很多情況下優(yōu)于最先進的 GTs。

關(guān)于異質(zhì)性圖的觀察:我們的參數(shù)調(diào)整顯著提高了經(jīng)典 GNNs 在異質(zhì)性圖上的先前最佳結(jié)果,超越了為此類圖專門設(shè)計的專用 GNNs 模型,甚至超過了 SOTA GTs 架構(gòu)。這一進展不僅支持了[7]中的發(fā)現(xiàn),還進一步強化了其結(jié)論,即經(jīng)典 GNNs 在異質(zhì)性圖上也是強有力的競爭者,挑戰(zhàn)了它們主要適用于同質(zhì)性圖結(jié)構(gòu)的普遍假設(shè)。

關(guān)于大規(guī)模圖的觀察:我們的參數(shù)調(diào)整顯著提升了經(jīng)典 GNNs 的先前結(jié)果,在某些情況下準確率提升達到了兩位數(shù)。它們在這些大規(guī)模圖數(shù)據(jù)集(無論是同質(zhì)性還是異質(zhì)性)中取得了最佳結(jié)果,甚至超過了最先進的 GTs。這表明消息傳遞在大規(guī)模圖上學習節(jié)點表示仍然非常有效。

3.2 消融分析

消融觀察 1:Normalization 在大規(guī)模圖的節(jié)點分類中非常重要,但在小規(guī)模圖中則不太顯著。

消融觀察 2:Dropout 對于節(jié)點分類始終是必要的。

消融觀察 3:Residual Connections 能夠顯著提升某些數(shù)據(jù)集上的性能,且在異質(zhì)性圖上的效果比同質(zhì)性圖上更為顯著。 消融觀察 4:更深的網(wǎng)絡(luò)通常在異質(zhì)性圖上帶來更大的性能提升,相較于同質(zhì)性圖表現(xiàn)更為明顯。

總結(jié)我們的研究對經(jīng)典 GNNs 模型在節(jié)點分類任務中的有效性進行了全面的重新評估。通過廣泛的實證分析,我們驗證了這些經(jīng)典 GNNs 模型能夠在各種圖數(shù)據(jù)集上達到甚至超越最先進圖學習模型的性能。

此外,我們的全面消融研究提供了關(guān)于不同 GNNs 超參數(shù)如何影響性能的見解。我們希望我們的研究結(jié)果為 GNNs 的應用和評估帶來新的見解。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4771瀏覽量

100766 -

機器學習

+關(guān)注

關(guān)注

66文章

8418瀏覽量

132634

原文標題:NeurIPS 2024 | 全面重新評估!經(jīng)典GNN是強有力的節(jié)點分類基線模型

文章出處:【微信號:tyutcsplab,微信公眾號:智能感知與物聯(lián)網(wǎng)技術(shù)研究所】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

matlab 神經(jīng)網(wǎng)絡(luò) 數(shù)學建模數(shù)值分析

BP神經(jīng)網(wǎng)絡(luò)和人工神經(jīng)網(wǎng)絡(luò)的區(qū)別

人工神經(jīng)網(wǎng)絡(luò)的案例分析

rnn是遞歸神經(jīng)網(wǎng)絡(luò)還是循環(huán)神經(jīng)網(wǎng)絡(luò)

人工神經(jīng)網(wǎng)絡(luò)模型的分類有哪些

遞歸神經(jīng)網(wǎng)絡(luò)是循環(huán)神經(jīng)網(wǎng)絡(luò)嗎

循環(huán)神經(jīng)網(wǎng)絡(luò)和卷積神經(jīng)網(wǎng)絡(luò)的區(qū)別

深度神經(jīng)網(wǎng)絡(luò)與基本神經(jīng)網(wǎng)絡(luò)的區(qū)別

bp神經(jīng)網(wǎng)絡(luò)和反向傳播神經(jīng)網(wǎng)絡(luò)區(qū)別在哪

反向傳播神經(jīng)網(wǎng)絡(luò)和bp神經(jīng)網(wǎng)絡(luò)的區(qū)別

神經(jīng)網(wǎng)絡(luò)擬合的誤差怎么分析

bp神經(jīng)網(wǎng)絡(luò)是深度神經(jīng)網(wǎng)絡(luò)嗎

bp神經(jīng)網(wǎng)絡(luò)和卷積神經(jīng)網(wǎng)絡(luò)區(qū)別是什么

卷積神經(jīng)網(wǎng)絡(luò)和bp神經(jīng)網(wǎng)絡(luò)的區(qū)別

詳解深度學習、神經(jīng)網(wǎng)絡(luò)與卷積神經(jīng)網(wǎng)絡(luò)的應用

經(jīng)典圖神經(jīng)網(wǎng)絡(luò)(GNNs)的基準分析研究

經(jīng)典圖神經(jīng)網(wǎng)絡(luò)(GNNs)的基準分析研究

評論