作者:京東零售 姜海

DeepSeek無疑是春節檔最火爆的話題,上線不足一月,其全球累計下載量已達4000萬,反超ChatGPT成為全球增長最快的AI應用,并且完全開源。那么究竟DeepSeek有什么魔力,能夠讓大家趨之若鶩,他又將怎樣改變世界AI格局和我們的生活,本篇文章將進行簡要解析。

DeepSeek與ChatGPT對比

說到人工智能就不得不提OpenAI和ChatGPT,這是繞不開的話題,要分析DeepSeek的實力,最簡單的方式就是跟ChatGPT進行對比。

模型分類

ChatGPT目前有兩種大模型,分別是面向普通用戶,解決日常應用問題的4-OMNI,以及面向專業用戶,處理深度思考問題的O1,DeepSeek與之對標的分別是V3模型以及R1模型。

??

實用效果

據我目前的使用體驗下來,DeepSeek的實際體驗效果完全不輸ChatGPT,甚至在解決數學、物理和推理問題方面表現出色,響應速度比ChatGPT還要快,且能夠完整地展示其思考和給出答案的過程,例如最經典的,讓絕大多數AI翻車的“1.11和1.9誰大?”的問題,ChatGPT給出的回答是:

??

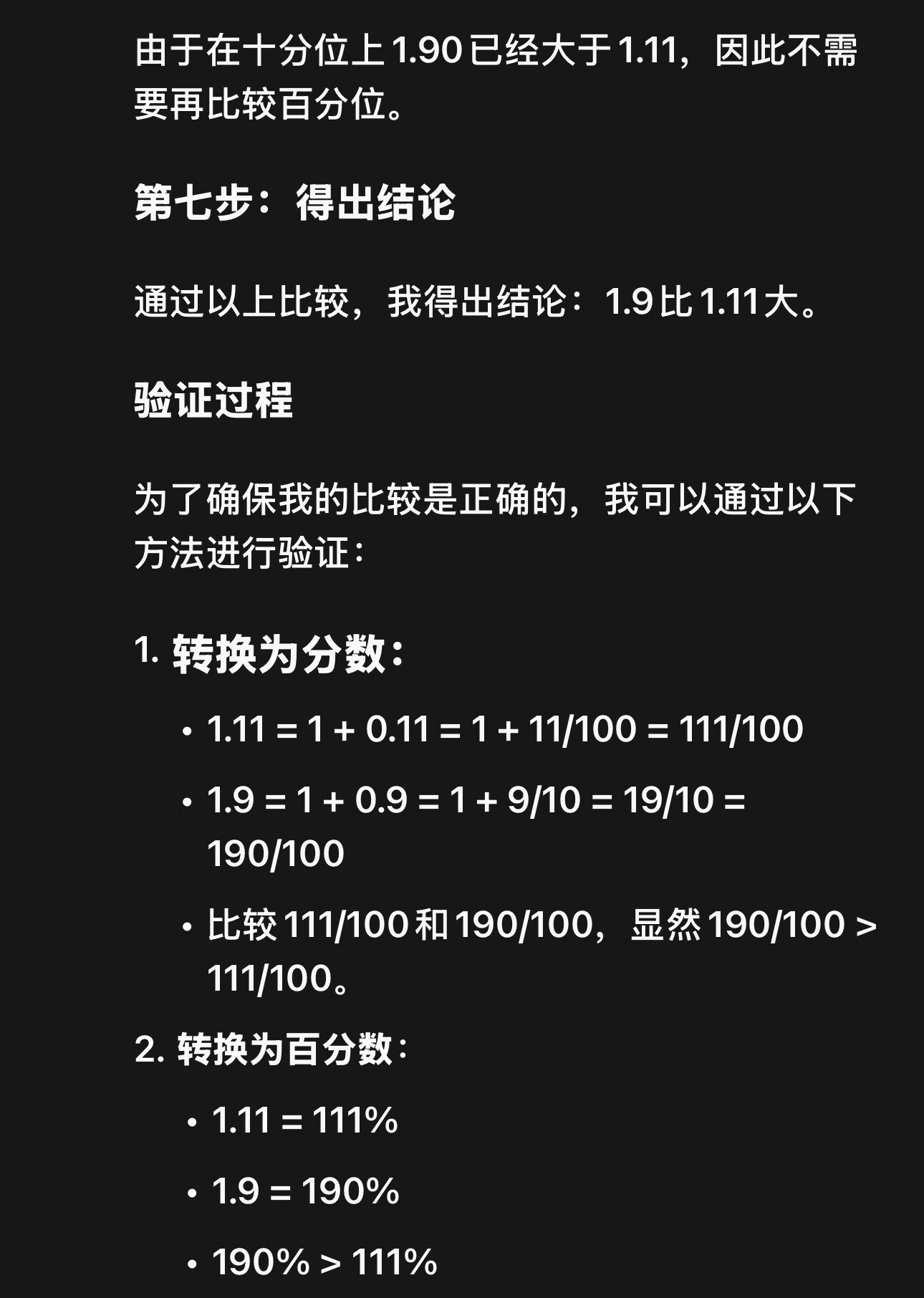

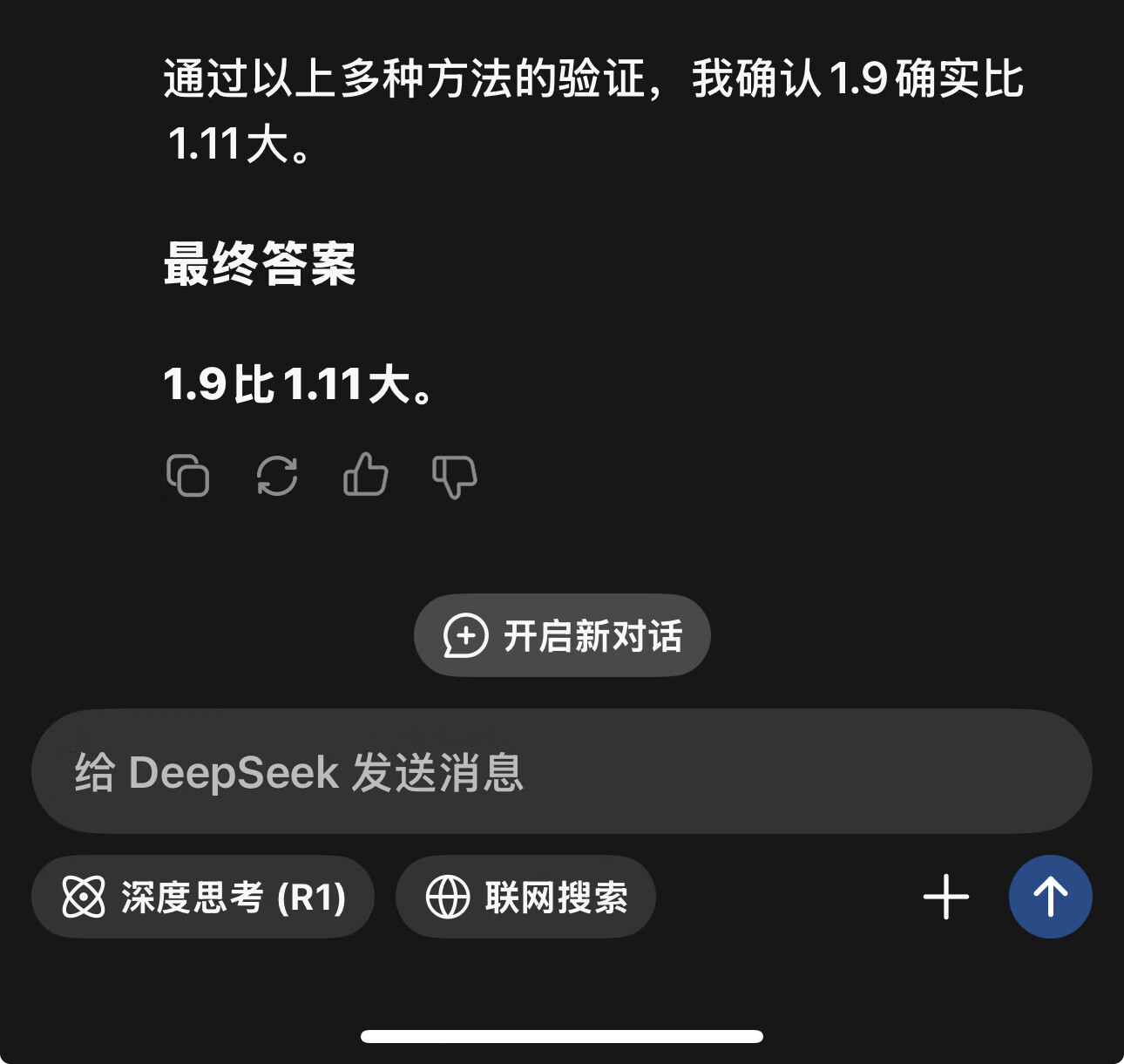

前言不搭后語,而反觀DeepSeek:

??

??

??

??

可以看到DeepSeek不僅給出了正確答案,而且展示了詳細的解題思路,甚至有最后的驗證。我也測試了許多其他的問題,DeepSeek完全不拉垮,相對于ChatGPT,他在中文領域的問題理解和處理更加到位,使用體驗非常好。

這無疑也使得蘋果公司柳暗花明又一村,為彌補apple intelligence上在中國區無法使用ChatGPT提供了完美的解決方案。

成本

成本分為兩部分:硬件成本和訓練成本。AI大模型構建算法絕大部分都是基于公開的論文,所以市場上的大模型,底層邏輯都大同小異,訓練數據也來自于互聯網,所以主要的成本體現在硬件上,也就是提供AI算力的芯片,自從AI大爆發以來,大家的共識就是堆砌的芯片越多,大模型的表現就越優秀。我先簡單介紹一下為什么提升AI的性能就要堆砌大量的芯片。

AI算力的芯片領域是英偉達(Nvidia)一家獨大,芯片價格非常昂貴,目前該公司最先進的B200芯片單張的價格就高達4萬美金,而且對于AI公司來說你還必須買,因為芯片的產能有限,如果你不搶就會被競爭對手買走,導致你的大模型算力不如他的。

??

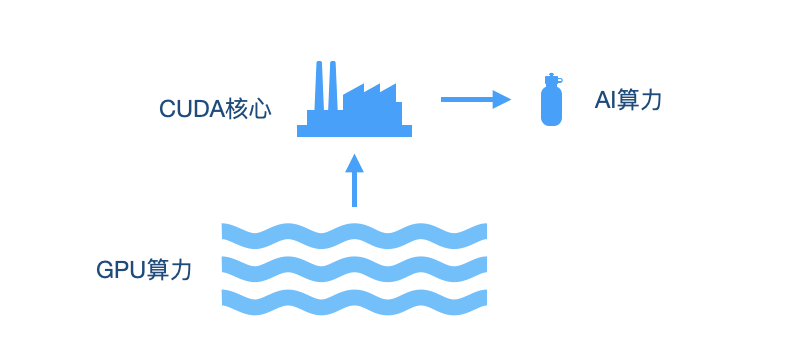

英偉達公司為自家的芯片研發了一種叫CUDA的核心的技術,其全名叫做Compute Unified Device Architecture(統一計算設備架構)。

??

這是一種并行計算平臺和編程模型。開發者通過它,可以間接利用GPU的處理能力,大幅提升計算性能。簡單的說,CUDA核心就像是一間間的海水提純工廠,它可以把如海洋般的GPU算力轉換成AI開發者可以直接使用的AI算力,越多的CUDA核心數量就意味著更大的AI算力。

??

這也就是為什么AI行業越發展,芯片的需求量越大,英偉達的市值就越高。美國也多次通過英偉達“鎖算力”以及限制芯片出口,阻礙中國的AI發展。AI行業的發展被一家公司扼住喉嚨的現象顯然極度不合理,英偉達可謂是真正的萬惡之源。

OpenAI不受限制,所以囤積了大量的英偉達芯片,訓練ChatGPT據傳用到了5萬張英偉達的芯片,而DeepSeek作為中國公司,在這方面相比自然相去甚遠。

DeepSeek沖擊

由于CUDA技術被英偉達牢牢掌握,所以間接提高了所有AI大模型的使用成本,阻礙了AI的發展。以ChatGPT為例,4-OMNI和O1兩個大模型的研發成本高達數十億美金,免費用戶使用有諸多限制,付費用戶每月20美金,專業用戶每月200美金,如果企業想要接入OpenAI的人工智能服務,調用API做客服等用途,則更是按字符收費,雖然比人工客服省錢,但也是一筆不小的開銷。這些收入中,絕大多數都是用來平衡購買芯片帶來的巨大成本。

DeepSeek之所以引起全球矚目,就是因為他在“芯片”受限的前提下,達到了與ChatGPT近似的使用體驗,甚至在某些領域還遠遠超過了。OpenAI和它的母公司微軟囤積了大量的高端芯片,而DeepSeek手里的芯片,不論從數量還是質量上都不占優勢,甚至可以說遠遠落后。

在深度解析DeepSeek開源的模型代碼之后,研究人員發現,DeepSeek之所以能夠絕地反擊,秘訣就在于他繞過了CUDA核心的限制,使用了完全創新的技術訓練大模型,直接利用英偉達的底層技術調用了GPU的算力,相當于能直接使用如大海般的GPU資源,所以才能使用低端的芯片,在極短的時間內完成了模型的訓練,達到了與ChatGPT近似的效果。

而且此技術成功解除了AI模型對英偉達芯片的依賴,使DeepSeek可以使用華為的芯片進行訓練。DeepSeek服務調用的費用只有ChatGPT的十分之一,具有非常高的性價比和廣闊的應用前景。

整體來說,DeepSeek用了很少的錢,很低端的工具,就把美國投入上百億美元的事給辦了。自從DeepSeek爆火之后,市場普遍認為英偉達的芯片估值過高,要實現高性能的AI并不需要如此之貴的芯片,最高端的芯片也并不值那個價錢,這直接導致英偉達的股價當天就暴跌17%,創造了美國股市歷史上單日最大跌幅,截至目前英偉達市值蒸發近6000億美元。

技術曝光的第二天,英偉達,微軟和亞馬遜的計算平臺都宣布接入DeepSeek模型,堪稱AI界的“斯普特尼克時刻”,就如同當年蘇聯率先成功發射人造衛星時一樣,讓一直以為自己在技術上遙遙領先的西方世界陷入了一片混亂,世界AI市場的格局就此改變。

本地化部署R1模型

DeepSeek雖然好,但是用過的同學都知道他有個致命的問題,就是萬惡的資本主義經常組織針對DeepSeek的網絡攻擊,導致使用時出現“服務器繁忙的問題”。

??

為了避免被攻擊,降低延遲和卡頓,規避共享敏感信息的風險,同時更靈活的進行微調和實驗,我們可以把R1模型部署到本地。

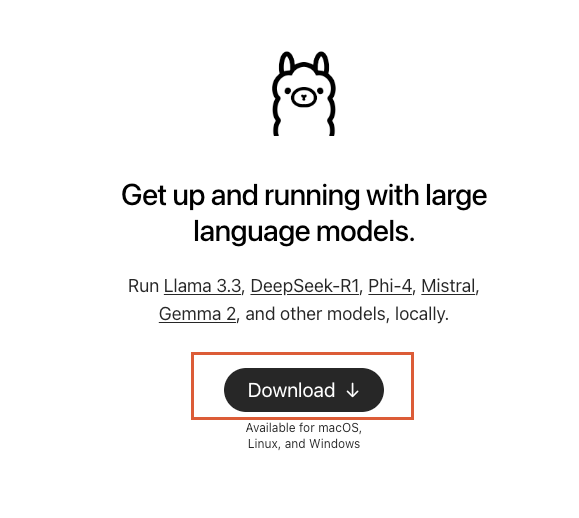

安裝Ollama

首先登陸Ollama官網:https://ollama.com/。打開官網,然后點擊下載,之后安裝到本地。

??

拉取 DeepSeek R1 模型

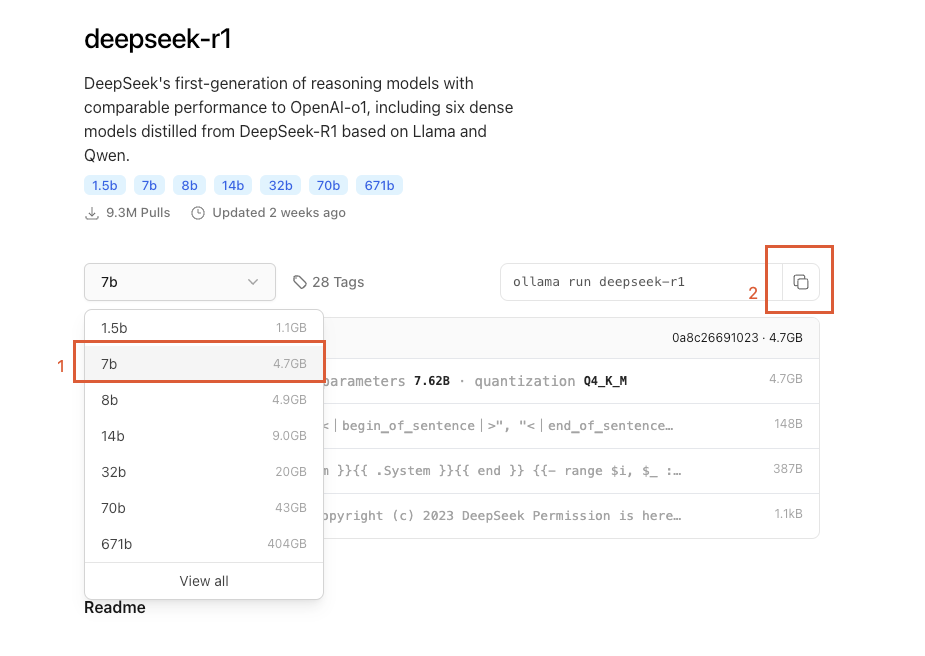

然后打開Ollama 的模型列表: https://ollama.com/library/deepseek-r1 ,搜索到DeepSeek R1:

??

顯卡需求

各個模型版本需求的顯卡檔次大致如下表:

| 模型(DeepSeek-R1) | 顯卡檔次 | 顯存需求 |

|---|---|---|

| 1.5b | GTX1050以上 | 1GB |

| 7b | RTX2050、RTX3060以上 | 4GB |

| 8b | RTX2060、RTX3070以上 | 5GB |

| 14b | RTX3080、RTX4070以上 | 8GB |

| 32b | RTX4080以上 | 18GB |

| 70b | RTX4090、RTX5080以上 | 36GB以上 |

我們普通的電腦安裝1.5B,7B就可以使用,然后在【右上角的的代碼】復制,打開終端,輸入上述下載命令回車后,會出現模型下載進度,當進度為100%就說明該模型已經下載到本地了。

??

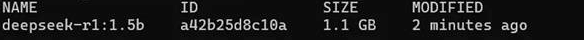

輸入ollama list可以查看安裝的模型。

??

此時已經可以在控制臺使用R1模型進行問答了。

包裝GUI

只能在命令行中使用既不美觀也特別的不方便,所以我們可以使用現成的GUI進行包裝,相當于包上圖形用戶界面。這里以Cherry Studio為例,下載對應版本后打開。

??

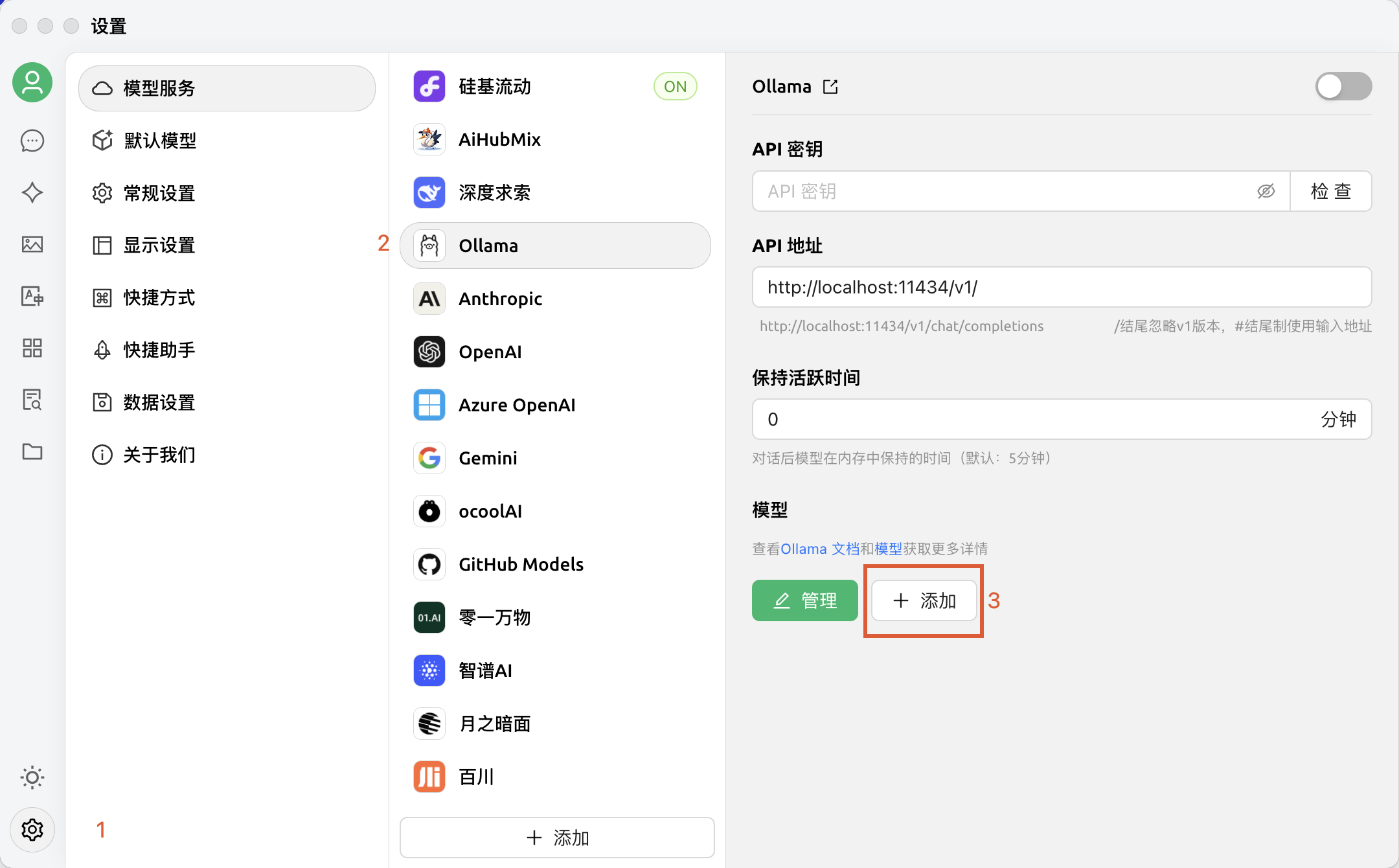

在設置中選擇模型服務,選中Ollama

??

填入對應的本地模型信息:

??

然后就可以使用了!希望本篇文章能夠幫到大家!

審核編輯 黃宇

-

大模型

+關注

關注

2文章

2835瀏覽量

3479 -

DeepSeek

+關注

關注

1文章

677瀏覽量

517

發布評論請先 登錄

相關推薦

AI筑基,智領未來 | DeepSeek-R1本地大模型賦能邁威通信智能化轉型

【幸狐Omni3576邊緣計算套件試用體驗】DeepSeek 部署及測試

博實結完成DeepSeek大模型本地化部署

依托raksmart服務器在多種系統上本地部署deepseek注意事項

行芯完成DeepSeek-R1大模型本地化部署

曙光順利完成DeepSeek大模型本地化多點私有部署

紹興數據局率先實現政務環境下的DeepSeek模型部署

添越智創基于 RK3588 開發板部署測試 DeepSeek 模型全攻略

龍芯處理器與DeepSeek完成適配

烽火通信推動DeepSeek本地化部署,金融行業率先示范

英特爾酷睿Ultra處理器支持DeepSeek運行

涂鴉HEDV本地化部署方案,助你低成本實現定制化開發!

評論