當下,開源大模型DeepSeek憑借其強大的語言理解和生成能力,已成為全民追捧的AI工具。無論是文案創(chuàng)作還是代碼編寫,只需“DeepSeek一下”即可輕松解決。然而,隨著用戶訪問量的激增,服務(wù)器無響應(yīng)、等待時間長等問題也屢見不鮮。一時間,能夠離線運行,且更具隱私性的DeepSeek端側(cè)部署也成為新風向。

本地部署雖具備諸多優(yōu)點,但對電腦的硬件配置卻有一定的要求。大模型包含大量參數(shù),即使是蒸餾過的小模型,模型大小也動輒幾十GB甚至上百GB。電腦除了需要CPU、GPU能夠高效運行之外,一款高性能的SSD也必不可少。 憶聯(lián)AM541搭載新一代Jaguar6020主控,內(nèi)置高容量SRAM及IO加速模塊,順序讀取速度高達7000 MB/s,能夠輕松應(yīng)對DeepSeek大模型加載等高負載場景,為用戶提供流暢的使用體驗,讓用戶真正實現(xiàn)“DeepSeek自由”。

適配度100%,大模型首次加載絲滑流暢

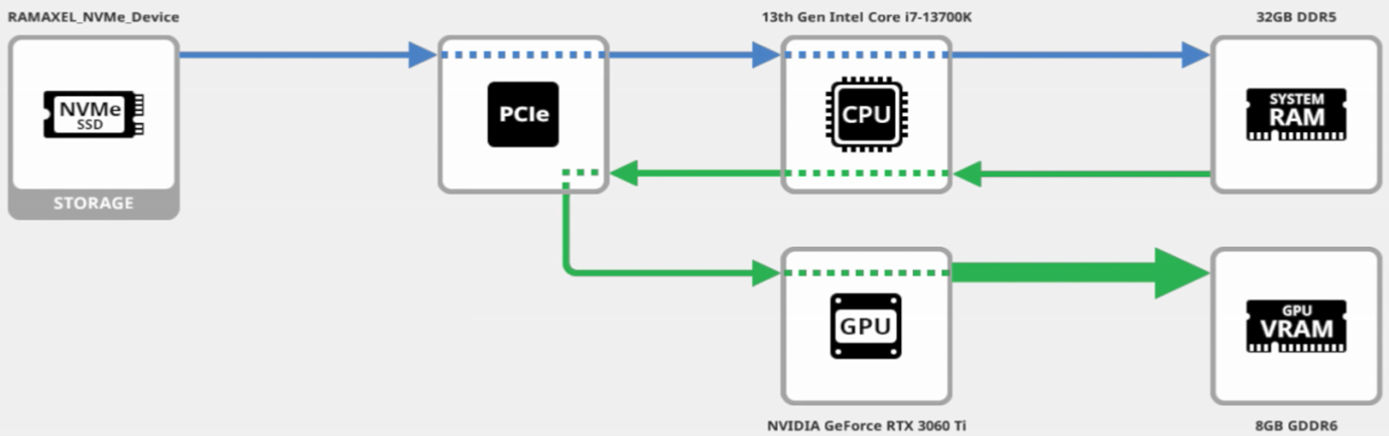

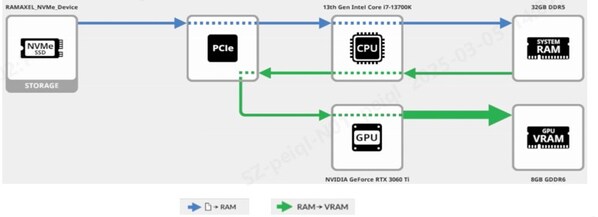

在DeepSeek本地加載運行過程中,SSD是整個數(shù)據(jù)流的第一棒。當DeepSeek完成本地部署后,模型文件即保存在SSD中。當用戶加載模型時,會先將大模型文件從SSD讀取到系統(tǒng)內(nèi)存中,再由內(nèi)存中轉(zhuǎn)傳輸?shù)斤@存,由GPU進行推理運算。因此,SSD的性能越好,就能越快將數(shù)據(jù)傳輸?shù)紾PU進行計算,體現(xiàn)在實際應(yīng)用中就是大模型的加載時間越短。

加載大模型時數(shù)據(jù)流方式

加載大模型時數(shù)據(jù)流方式

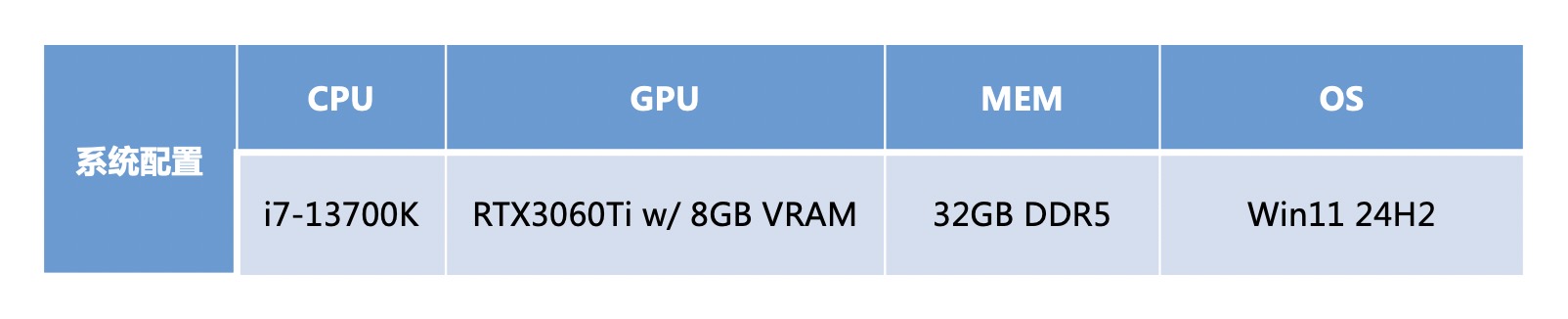

為了驗證憶聯(lián)AM541的性能及場景適配度,我們通過Ollama模型框架在本地部署了Deepseek-R1 8B模型,采用憶聯(lián)AM541 1TB SSD及國內(nèi)友商1TB A產(chǎn)品搭配GeForce RTX 3060 Ti 顯卡,在同等環(huán)境下進行了模型加載測

系統(tǒng)配置

系統(tǒng)配置

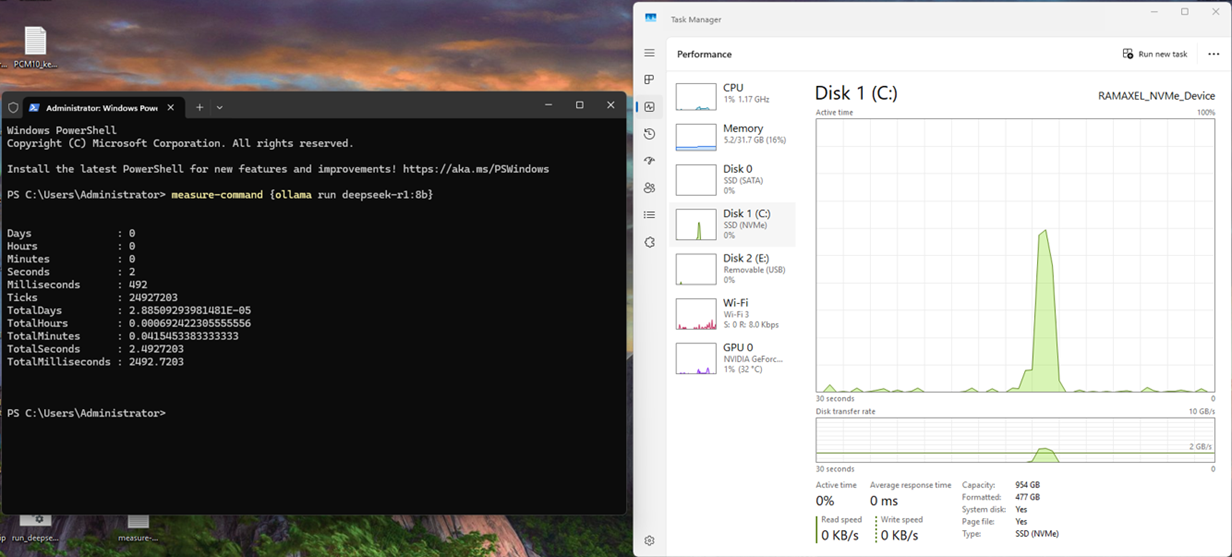

大模型加載時SSD狀態(tài)(見右側(cè)圖)

大模型加載時SSD狀態(tài)(見右側(cè)圖)

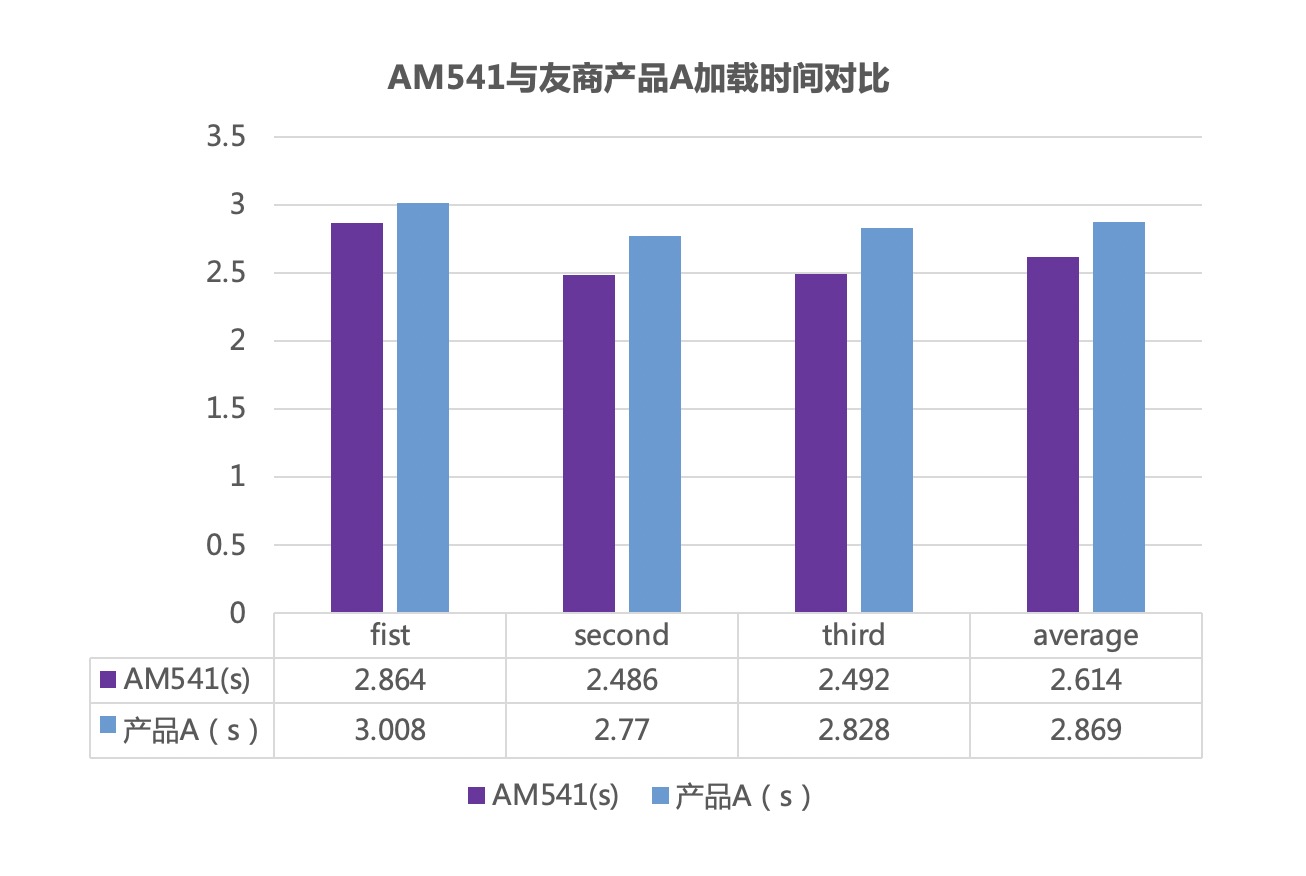

測試結(jié)果顯示,搭載AM541的PC在加載大模型時表現(xiàn)出色,首次加載時間(最快)僅為2.486秒,領(lǐng)先國內(nèi)一線SSD廠商同類產(chǎn)品約9%。這一成績充分體現(xiàn)了AM541對DeepSeek等高負載應(yīng)用100%適配,能夠為用戶帶來更加流暢的使用體驗。

順序讀突破7GB/s,硬核性能助力用戶暢享“DeepSeek自由”

更短加載時間背后,反映的是SSD更高的性能及更加靈活的場景適應(yīng)性。得益于SoC內(nèi)置的加速模塊,AM541的標稱順序讀寫速度達到了7000 MB/s、5600 MB/s ,4KB隨機讀寫速度可達800K IOPS、800K IOPS。從DeepSeek加載時的pattern解析來看,AM541性能波峰接近7GB/s,這與其標稱的性能高度吻合。

AM541緣何更快?測試人員進一步對加載過程進行了trace解析,發(fā)現(xiàn)模型加載過程主要以大size命令的低QD順序讀為主,而AM541自帶的Big SRAM策略及延遲控制機制在處理此類命令時優(yōu)勢明顯,使得大模型加載時間大幅領(lǐng)先友商。

此外,經(jīng)測試發(fā)現(xiàn),當大模型在搭載AM541的電腦上完成首次加載后,模型文件即被DRAM緩存,因此當設(shè)備Idle后再次加載時,模型文件可以直接從DRAM傳輸?shù)?a href="http://www.xsypw.cn/v/tag/3668/" target="_blank">VRAM,加載時間比首次更快,真正將DeepSeek變?yōu)橛脩舻摹八饺斯ぞ摺埃S時暢享“DeepSeek自由”。

擁抱大模型,憶聯(lián)為AI生態(tài)持續(xù)助力

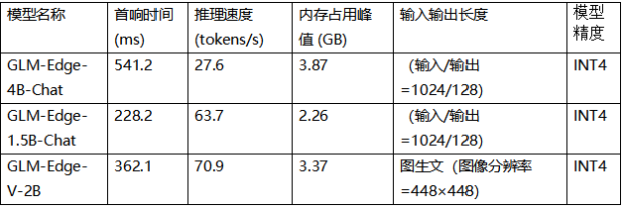

隨著AI本地化趨勢的加速,DeepSeek一體機等終端設(shè)備也逐漸普及。在消費電子領(lǐng)域,已有主流 PC廠商將DeepSeek大模型嵌入AIPC中,多款手機也開始發(fā)力AI大模型。未來,個人電腦、手機等終端設(shè)備極有可能會搭載多種大模型,甚至各種行業(yè)應(yīng)用也會接入大模型。面對不同參數(shù)規(guī)模的AI模型,以及不同模型頻繁切換帶來的高頻讀寫過程,SSD不僅要有足夠大的容量,同時對SSD的全面性能及穩(wěn)定性都是一種考驗。

依托硬件加速及先進的軟件算法,AM541不僅在低QD Latency上具備優(yōu)勢,在多種混合讀寫中均有出色表現(xiàn),可輕松應(yīng)對多應(yīng)用場景。

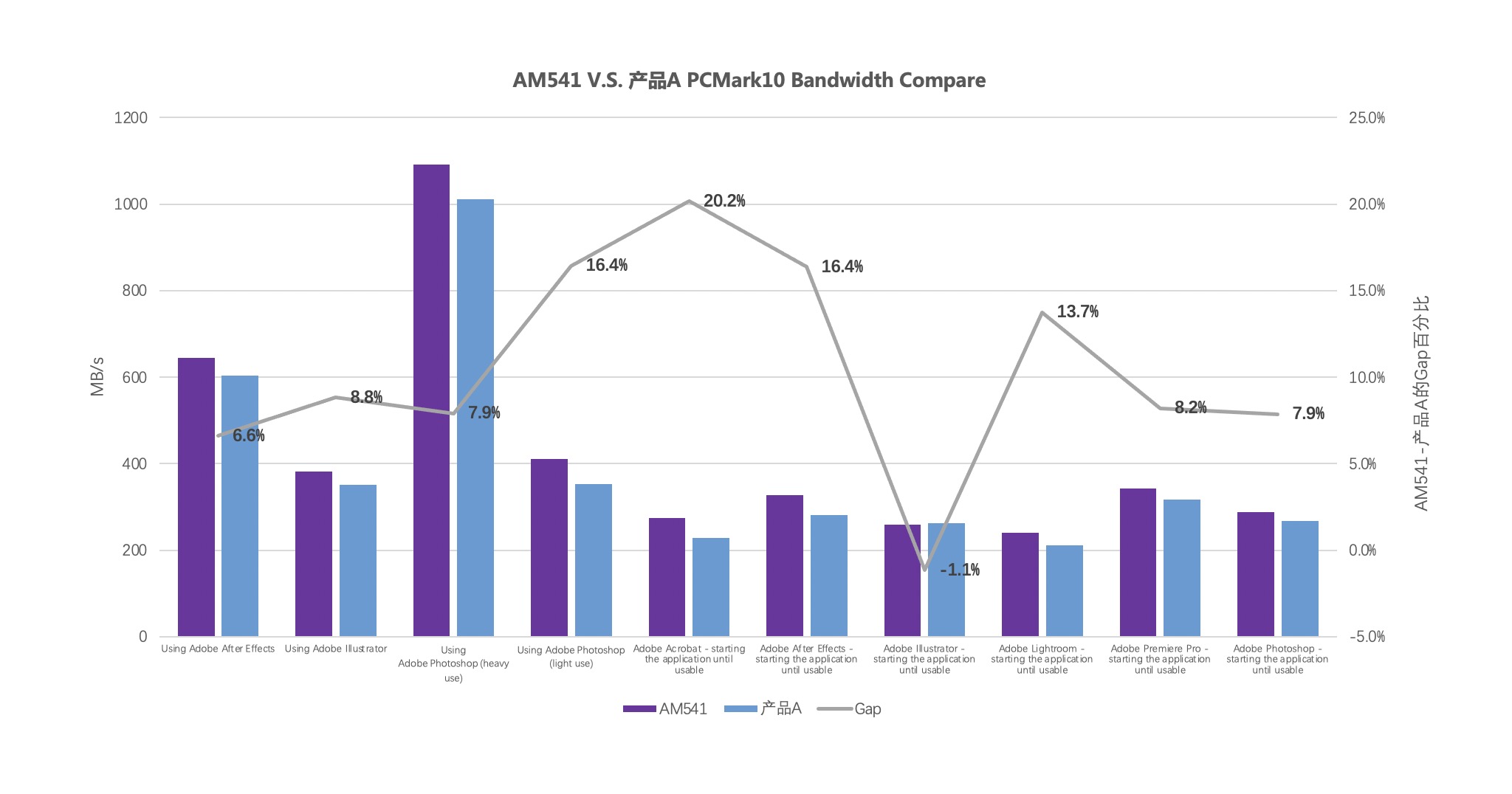

在PCMark10測試中,AM541跑分超過了3700,比友商同類產(chǎn)品A高出約300分,在辦公、游戲、內(nèi)容創(chuàng)作等多個場景中性能領(lǐng)先,其中,在常見的數(shù)字內(nèi)容創(chuàng)作中,AM541平均比友商同類產(chǎn)品快10.5%。

AI浪潮奔涌不停,技術(shù)創(chuàng)新日新月異,作為底層硬件支撐,SSD在AI本地化進程中扮演著關(guān)鍵角色。憶聯(lián)AM541憑借其硬核性能,不僅為DeepSeek大模型的本地化部署提供了高效解決方案,也為用戶帶來了前所未有的使用體驗。未來,憶聯(lián)將緊跟行業(yè)趨勢,聚焦端側(cè)大模型的技術(shù)痛點,推進技術(shù)創(chuàng)新與產(chǎn)品迭代,為AI生態(tài)的繁榮發(fā)展提供持續(xù)動能。

審核編輯 黃宇

-

存儲

+關(guān)注

關(guān)注

13文章

4435瀏覽量

86634 -

CSSD

+關(guān)注

關(guān)注

0文章

7瀏覽量

6599 -

大模型

+關(guān)注

關(guān)注

2文章

2849瀏覽量

3518 -

AI大模型

+關(guān)注

關(guān)注

0文章

348瀏覽量

421 -

DeepSeek

+關(guān)注

關(guān)注

1文章

698瀏覽量

591

發(fā)布評論請先 登錄

相關(guān)推薦

暢享DeepSeek自由,憶聯(lián)高性能CSSD為端側(cè)大模型加速

聆思CSK6大模型語音開發(fā)板接入DeepSeek資料匯總(包含深度求索/火山引擎/硅基流動華為昇騰滿血版)

RK3588開發(fā)板上部署DeepSeek-R1大模型的完整指南

寧暢推出DeepSeek大模型一體機

添越智創(chuàng)基于 RK3588 開發(fā)板部署測試 DeepSeek 模型全攻略

了解DeepSeek-V3 和 DeepSeek-R1兩個大模型的不同定位和應(yīng)用選擇

移遠通信邊緣計算模組成功運行DeepSeek模型,以領(lǐng)先的工程能力加速端側(cè)AI落地

【實測】用全志A733平板搭建一個端側(cè)Deepseek算力平臺

移遠通信邊緣計算模組成功運行DeepSeek模型,以領(lǐng)先的工程能力加速端側(cè)AI落地

DeepSeek模型成功部署,物通博聯(lián)在 AI 賦能工業(yè)上持續(xù)探索、不斷前行

天數(shù)智芯加速DeepSeek全系列模型適配

寧暢AI服務(wù)器全面支持DeepSeek大模型

deepin UOS AI接入DeepSeek-R1模型

智譜推出四個全新端側(cè)模型 攜英特爾按下AI普及加速鍵

評論