本文分析了國內外AI芯片的格局和特點,作者認為,在AI芯片領域,國外芯片巨頭占據了絕大部分市場份額,不論是在人才聚集還是公司合并等方面,都具有絕對的領先優勢。而國內AI初創公司則又呈現百家爭鳴、各自為政的紛亂局面;特別是每個初創企業的AI芯片都具有自己獨特的體系結構和軟件開發套件,既無法融入英偉達和谷歌建立的生態圈,又不具備與之抗衡的實力

如果說 2016 年 3 月份 AlphaGo 與李世石的那場人機大戰只在科技界和圍棋界產生較大影響的話,那么 2017 年 5 月其與排名第一的世界圍棋冠軍柯潔的對戰則將人工智能技術推向了公眾視野。阿爾法狗(AlphaGo)是第一個擊敗人類職業圍棋選手、第一個戰勝圍棋世界冠軍的人工智能程序,由谷歌(Google)旗下 DeepMind 公司戴密斯 · 哈薩比斯領銜的團隊開發,其主要工作原理是 “深度學習”。

國內AI芯片百家爭鳴,何以抗衡全球技術寡頭

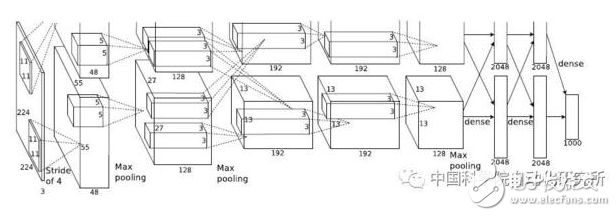

其實早在 2012 年,深度學習技術就已經在學術界引起了廣泛地討論。在這一年的 ImageNet 大規模視覺識別挑戰賽 ILSVRC 中,采用 5 個卷積層和 3 個全連接層的神經網絡結構 AlexNet,取得了 top-5(15.3%)的歷史最佳錯誤率,而第二名的成績僅為 26.2%。從此以后,就出現了層數更多、結構更為復雜的神經網絡結構,如 ResNet、GoogleNet、VGGNet 和 MaskRCNN 等,還有去年比較火的生成式對抗網絡 GAN。

國內AI芯片百家爭鳴,何以抗衡全球技術寡頭

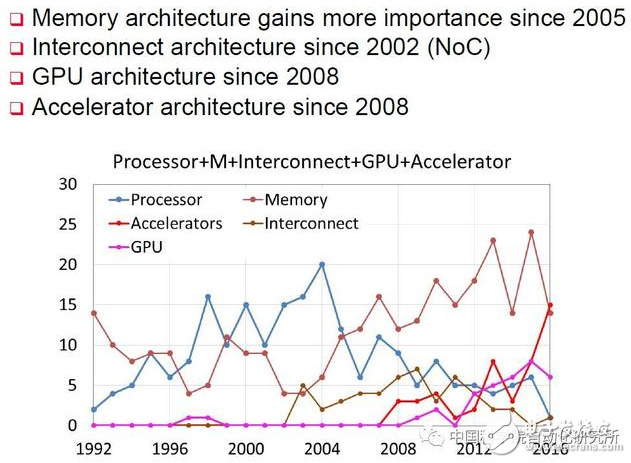

不論是贏得視覺識別挑戰賽的 AlexNet,還是擊敗圍棋冠軍柯潔的 AlphaGo,它們的實現都離不開現代信息技術的核心——處理器,不論這個處理器是傳統的 CPU,還是 GPU,還是新興的專用加速部件 NNPU(NNPU 是 Neural Network Processing Unit 的簡稱)。在計算機體系結構國際頂級會議 ISCA2016 上有個關于體系結構 2030 的小型研討會,名人堂成員 UCSB 的謝源教授就對 1991 年以來在 ISCA 收錄的論文進行了總結,專用加速部件相關的論文收錄是在 2008 年開始,而在 2016 年達到了頂峰,超過了處理器、存儲器以及互聯結構等三大傳統領域。而在這一年,來自中國科學院計算技術研究所的陳云霽、陳天石研究員課題組提交的《一種神經網絡指令集》論文,更是 ISCA2016 最高得分論文。

國內AI芯片百家爭鳴,何以抗衡全球技術寡頭

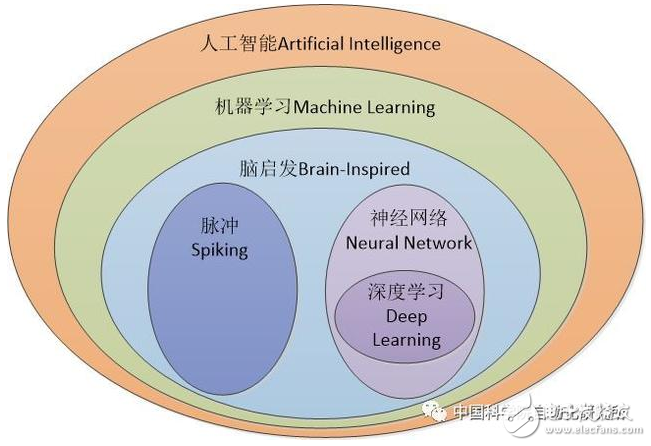

在具體介紹 AI 芯片國內外之前,看到這里有部分讀者或許會產生這樣的疑惑:這不都是在說神經網絡和深度學習嗎?那么我覺得有必要對人工智能和神經網絡的概念進行闡述,特別是 2017 年工信部發布的《促進新一代人工智能產業發展三年行動計劃(2018-2020 年)》中,對發展目標的描述很容易讓人覺得人工智能就是神經網絡,AI 芯片就是神經網絡芯片。

人工智能整體核心基礎能力顯著增強,智能傳感器技術產品實現突破,設計、代工、封測技術達到國際水平,神經網絡芯片實現量產并在重點領域實現規模化應用,開源開發平臺初步具備支撐產業快速發展的能力。

其實則不然。人工智能是一個很老很老的概念,而神經網絡只不過是人工智能范疇的一個子集。早在 1956 年,被譽為 “人工智能之父” 的圖靈獎得主約翰 · 麥卡錫就這樣定義人工智能:創造智能機器的科學與工程。而在 1959 年,Arthur Samuel 給出了人工智能的一個子領域機器學習的定義,即“計算機有能力去學習,而不是通過預先準確實現的代碼”,這也是目前公認的對機器學習最早最準確的定義。而我們日常所熟知的神經網絡、深度學習等都屬于機器學習的范疇,都是受大腦機理啟發而發展得來的。另外一個比較重要的研究領域就是脈沖神經網絡,國內具有代表的單位和企業是清華大學類腦計算研究中心和上海西井科技等。

國內AI芯片百家爭鳴,何以抗衡全球技術寡頭

好了,現在終于可以介紹 AI 芯片國內外的發展現狀了,當然這些都是我個人的一點觀察和愚見,管窺之見權當拋磚引玉。

國外:技術寡頭,優勢明顯

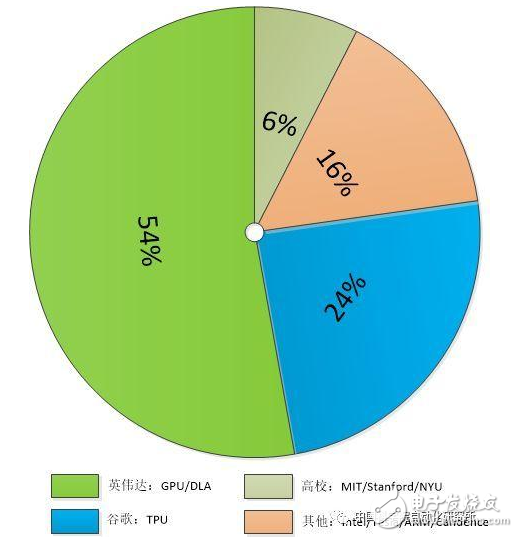

由于具有得天獨厚的技術和應用優勢,英偉達和谷歌幾乎占據了人工智能處理領域 80% 的市場份額,而且在谷歌宣布其 Cloud TPU 開放服務和英偉達推出自動駕駛處理器 Xavier 之后,這一份額占比在 2018 年有望進一步擴大。其他廠商,如英特爾、特斯拉、ARM、IBM 以及 Cadence 等,也在人工智能處理器領域占有一席之地。

國內AI芯片百家爭鳴,何以抗衡全球技術寡頭

當然,上述這些公司的專注領域卻不盡相同。比如英偉達主要專注于 GPU 和無人駕駛領域,而谷歌則主要針對云端市場,英特爾則主要面向計算機視覺,Cadence 則以提供加速神經網絡計算相關 IP 為主。如果說前述這些公司還主要偏向處理器設計等硬件領域,那么ARM 公司則主要偏向軟件,致力于針對機器學習和人工智能提供高效算法庫。

注:上述表格中所給為截止到 2017 年各研制單位公開可查的最新數據。

獨占鰲頭——英偉達

在人工智能領域,英偉達可以說是目前涉及面最廣、市場份額最大的公司,旗下產品線遍布自動駕駛汽車、高性能計算、機器人、醫療保健、云計算、游戲視頻等眾多領域。其針對自動駕駛汽車領域的全新人工智能超級計算機Xavier,用 NVIDIA 首席執行官黃仁勛的話來說就是 “這是我所知道的 SoC 領域非常了不起的嘗試,我們長期以來一直致力于開發芯片。”

國內AI芯片百家爭鳴,何以抗衡全球技術寡頭

Xavier是一款完整的片上系統 (SoC),集成了被稱為 Volta 的全新 GPU 架構、定制 8 核 CPU 架構以及新的計算機視覺加速器。該處理器提供 20 TOPS(萬億次運算 / 秒)的高性能,而功耗僅為 20 瓦。單個 Xavier 人工智能處理器包含 70 億個晶體管,采用最前沿的 16nm FinFET 加工技術進行制造,能夠取代目前配置了兩個移動 SoC 和兩個獨立 GPU 的 DRIVE PX 2,而功耗僅僅是它的一小部分。

而在 2018 年拉斯維加斯 CES 展會上,NVIDIA 又推出了三款基于 Xavier 的人工智能處理器,包括一款專注于將增強現實(AR)技術應用于汽車的產品、一款進一步簡化車內人工智能助手構建和部署的 DRIVE IX 和一款對其現有自主出租車大腦——Pegasus 的修改,進一步擴大自己的優勢。

產學研的集大成者——谷歌

如果你只是知道谷歌的 AlphaGo、無人駕駛和 TPU 等這些人工智能相關的產品,那么你還應該知道這些產品背后的技術大牛們:谷歌傳奇芯片工程師 Jeff Dean、谷歌云計算團隊首席科學家、斯坦福大學AI實驗室主管李飛飛、Alphabet 董事長 John Hennessy 和谷歌杰出工程師 David Patterson。

時至今日,摩爾定律遇到了技術和經濟上的雙重瓶頸,處理器性能的增長速度越來越慢,然而社會對于計算能力的需求增速卻并未減緩,甚至在移動應用、大數據、人工智能等新的應用興起后,對于計算能力、計算功耗和計算成本等提出了新的要求。與完全依賴于通用 CPU 及其編程模型的傳統軟件編寫模式不同,異構計算的整個系統包含了多種基于特定領域架構(Domain-Specific Architecture, DSA)設計的處理單元,每一個 DSA 處理單元都有負責的獨特領域并針對該領域做優化,當計算機系統遇到相關計算時便由相應的 DSA 處理器去負責。而谷歌就是異構計算的踐行者,TPU 就是異構計算在人工智能應用的一個很好例子。

2017 年發布的第二代 TPU 芯片,不僅加深了人工智能在學習和推理方面的能力,而且谷歌是認真地要將它推向市場。根據谷歌的內部測試,第二代芯片針對機器學習的訓練速度能比現在市場上的圖形芯片(GPU)節省一半時間;第二代 TPU 包括了四個芯片,每秒可處理 180 萬億次浮點運算;如果將 64 個 TPU 組合到一起,升級為所謂的 TPU Pods,則可提供大約 11500 萬億次浮點運算能力。

計算機視覺領域的攪局者——英特爾

英特爾作為世界上最大的計算機芯片制造商,近年來一直在尋求計算機以外的市場,其中人工智能芯片爭奪成為英特爾的核心戰略之一。為了加強在人工智能芯片領域的實力,不僅以 167 億美元收購 FPGA 生產商 Altera 公司,還以 153 億美元收購自動駕駛技術公司 Mobileye,以及機器視覺公司 Movidius 和為自動駕駛汽車芯片提供安全工具的公司 Yogitech,背后凸顯這家在 PC 時代處于核心位置的巨頭面向未來的積極轉型。

Myriad X就是英特爾子公司 Movidius 在 2017 年推出的視覺處理器 (VPU,vision processing unit),這是一款低功耗的系統芯片 (SoC),用于在基于視覺的設備上加速深度學習和人工智能——如無人機、智能相機和 VR / AR 頭盔。Myriad X 是全球第一個配備專用神經網絡計算引擎的片上系統芯片(SoC),用于加速設備端的深度學習推理計算。該神經網絡計算引擎是芯片上集成的硬件模塊,專為高速、低功耗且不犧牲精確度地運行基于深度學習的神經網絡而設計,讓設備能夠實時地看到、理解和響應周圍環境。引入該神經計算引擎之后,Myriad X 架構能夠為基于深度學習的神經網絡推理提供 1TOPS 的計算性能。

-

AI

+關注

關注

87文章

30947瀏覽量

269213 -

人工智能

+關注

關注

1791文章

47314瀏覽量

238648

發布評論請先 登錄

相關推薦

百家爭鳴 智能物聯網應用未來如何發展

百家爭鳴下的智能語音助手,誰能真正成為領導者?

CPU/MCU/FPGA/SoC芯片異同點是什么

MWC國產手機百家爭鳴 魅族下午5點亮底牌

半自動駕駛技術“百家爭鳴”

工業機器人市場百家爭鳴,未來前景良好

國內AI芯片需下沉終端芯片 百度、阿里、華為共同制造“中國芯”

AI芯片能否成為安防行業的發力者

國內物聯網:“百花齊放,百家爭鳴”

多款5G集成手機芯片發布,產品百家爭鳴,技術優勢最強集成

海康威視:國內眾多廠家芯片都可以使用

政策助高端醫械補齊短板,Medtec創新活動促品牌“百家爭鳴”

國內AI芯片百家爭鳴_如何抗衡全球技術寡頭

國內AI芯片百家爭鳴_如何抗衡全球技術寡頭

評論