Mobileye 認(rèn)為,人類駕駛員是一個很復(fù)雜,在計(jì)算機(jī)看來“非標(biāo)準(zhǔn)”的群體:有激進(jìn)的司機(jī),也有保守的司機(jī),想準(zhǔn)確預(yù)測個體司機(jī)的意圖很難。人類在駕駛中無時無刻不在進(jìn)行博弈,而無人車想要與人類駕駛員共存,就不得不參與這種博弈。Mobileye提出的RSS理論模型想要做到的事,就是把人們的駕駛常識總結(jié)歸納為數(shù)學(xué)模型,并且教會每一輛無人車。

機(jī)器人不得傷害人類,或坐視人類受到傷害;

除非違背第一法則,否則機(jī)器人必須服從人類命令;

除非違背第一或第二法則,否則機(jī)器人必須保護(hù)自己。

所有突破界限新技術(shù)的誕生,都不可避免地伴隨著道德倫理和關(guān)于人類存亡的討論。

過去是機(jī)器人,今天輪到無人車了。

至今我們已經(jīng)對機(jī)器人做了足夠多的討論,業(yè)界也有像馬斯克和扎克伯格這樣的對人工智能堅(jiān)持不同看法的大佬,至少當(dāng)強(qiáng)人工智能到來之時,人類不會是全無準(zhǔn)備的羔羊。

而比起機(jī)器人,無人車無疑是命途多舛的。從上路開始,不斷發(fā)生的重大負(fù)面新聞就一直在刺激人們的神經(jīng),無人車就像個剛學(xué)會跑步,就不得不接受眾人審判的孩子。

今年三月在美國亞利桑那州坦佩市,面對一名違反交規(guī)橫穿馬路的女性,Uber 公司旗下的無人車選擇了不減速直接碾過;同月,特斯拉 Model X 在輔助自動駕駛 (Autopilot) 模式下撞上隔離帶,致車主死亡;上周,其它駕駛員的錯誤導(dǎo)致一輛 Waymo 自動駕駛車卷入車禍。

這些事故的發(fā)生,究竟是誰的責(zé)任很重要,但在當(dāng)下的輿論環(huán)境下沒人關(guān)心。盡管經(jīng)過近兩個月的調(diào)查,警方認(rèn)為安全員和違規(guī)過馬路的行人亦負(fù)有責(zé)任,但 Uber 無人車這個“第一起自動駕駛汽車殺人事件”的帽子,一時半會兒肯定摘不掉了。前幾天 Waymo 車禍發(fā)生時,很多人在了解現(xiàn)場情況之前,下意識地就覺得是無人車的錯。

無人駕駛技術(shù)的成熟只是時間問題,然而想讓公眾信任無人車,和無人車分享道路,甚至是把生命安全交給無人車,仍然是個棘手的難題。無人車的每一次事故,哪怕只是被卷入車禍,都會引起公眾的懷疑和恐慌。長此以往,這種不信任足以摧毀這個新興的行業(yè)。

還好,已經(jīng)有人在考慮這個問題,并且給出了一份很有說服力的答卷。

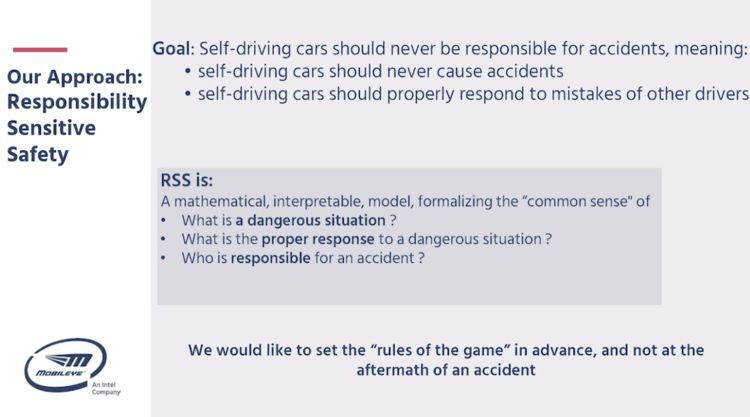

英特爾旗下,汽車圖像技術(shù)老牌公司 Mobileye,發(fā)表了一篇名為《安全、可擴(kuò)展自動駕駛汽車的正式模型》的論文。在這篇論文里,該公司提出了一個名叫RSS(Responsibility-Sensitive Safety)的理論模型。

這個理論主張?jiān)谑鹿拾l(fā)生之前規(guī)避事故,而不是等事故發(fā)生后再進(jìn)入復(fù)雜的定責(zé)程序。

英特爾和 Mobileye 希望,這個理論像自動駕駛界的“阿西莫夫機(jī)器人三定律”一樣,成為讓業(yè)界普遍接受、讓公眾感到放心的無人車守則。

Mobileye 認(rèn)為,人類駕駛員是一個很復(fù)雜,在計(jì)算機(jī)看來“非標(biāo)準(zhǔn)”的群體:有激進(jìn)的司機(jī),也有保守的司機(jī),想準(zhǔn)確預(yù)測個體司機(jī)的意圖很難。人類在駕駛中無時無刻不在進(jìn)行博弈,而無人車想要與人類駕駛員共存,就不得不參與這種博弈。

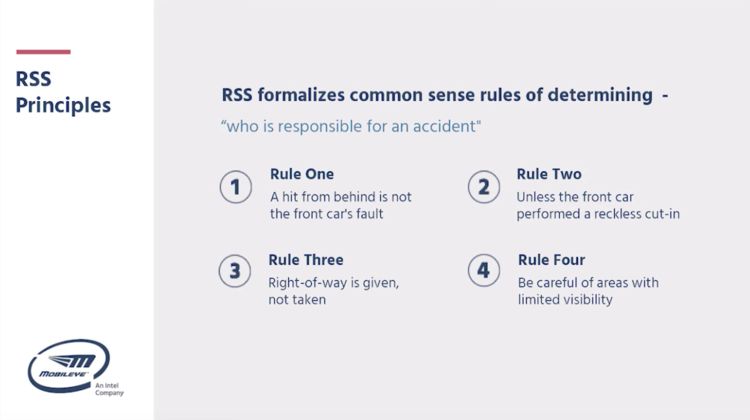

以汽車并道為例,在并道時發(fā)生刮蹭,前車會說后車進(jìn)得太急,后車會說前車司機(jī)跑神反應(yīng)太慢,到底誰說的是真誰說的是假,還得交警和保險公司一起來決定。無人車又沒有嘴,最好的辦法就是在保證絕對安全的前提下再行動。

Mobileye 航拍的真實(shí)路況,擠不進(jìn)去的白車心里苦

在英特爾投資全球峰會上,Mobileye CTO 兼聯(lián)合創(chuàng)始人阿姆農(nóng)·沙書亞 (Amnon Shashua) 談及車禍定責(zé)問題時表示:

在 RSS 的框架下,如果無人車出了事故,那一定是人的責(zé)任。

為了做到這點(diǎn),Mobileye 也提出了無人車的兩條定律:

第一,無人駕駛車永不主動造成事故;

第二,無人駕駛車對其他司機(jī)的不當(dāng)行為有正確反應(yīng),不擴(kuò)大事故。

這兩條鐵律應(yīng)當(dāng)如同不能傷害人類、不能坐視人類被傷害的機(jī)器人定律一樣,高懸在每一輛無人車做出的每一個決策之上。

沙書亞指出,RSS 的數(shù)學(xué)模型可以解決三個問題:1,什么是危險的情況;2,什么是正確的反應(yīng);3,事故的責(zé)任方是誰。

首先,通過攝像頭、雷達(dá)、和激光雷達(dá)的傳感融合,無人車能同時檢測周圍車輛、行人以及可駕駛路徑,同時計(jì)算距離,因此能更好地判斷路況。

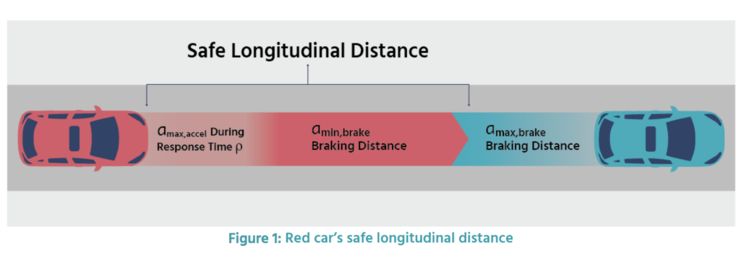

RSS 數(shù)學(xué)模型中計(jì)算的安全距離,只有滿足安全距離的要求,無人車才會并線。

然后,在采取行動時,RSS 則會保證在擁有路權(quán)、前方和兩側(cè)都滿足安全距離要求、且沒有視覺死角時才變道、并線、轉(zhuǎn)彎。

RSS 四原則

利用數(shù)據(jù)驅(qū)動的機(jī)器學(xué)習(xí)算法,Mobileye 已經(jīng)在 RSS 模型下進(jìn)行了 10 萬次路測駕駛模擬實(shí)驗(yàn),系統(tǒng)性能達(dá)到每秒 10hz 的頻率響應(yīng),沒有發(fā)生任何事故。

在提到 RSS 模型的必要性時,沙書亞表示,“技術(shù)的成熟只是第一步。RSS 做到的事,就是把人們的駕駛常識總結(jié)歸納為數(shù)學(xué)模型,并且教會每一輛無人車。”

然而,如果無人車過度敏感,則會走向另一個低效率的極端。乘客宛如一個被保護(hù)得很好但行駛緩慢、不斷經(jīng)歷加速減速過程的雞蛋,同樣體驗(yàn)不佳。這個問題又要怎么解決?

沙書亞說,“在無人車產(chǎn)業(yè)中,沒有大概能行這回事,為了保證用戶和其他車輛的安全,無人車要做到的是一定能行。

統(tǒng)計(jì)學(xué)中有假陰性和假陽性的概念,用在今天討論的話題上,就是‘該剎車沒剎車’,和‘不該剎車但是剎車了’。

假陰性是很好測試的,因?yàn)樵搫x車的時候沒剎車,車絕對要撞,只需要設(shè)置路障,統(tǒng)計(jì)無人車的通過率就可以了。而檢測假陽性相對較難。你能想象你的無人車,路上遇見個礦泉水瓶都要抖三抖么?沒人愿意坐這樣的車。經(jīng)過 RSS 系統(tǒng)的訓(xùn)練,英特爾已經(jīng)收集了兩億公里的實(shí)際行駛數(shù)據(jù),將假陽性出現(xiàn)概率降低到了萬分之 2.5,也即每五萬公里只出現(xiàn)一次。

“一旦 RSS 被無人車產(chǎn)業(yè)接受,事故定責(zé)將變得更容易。如果沒有這個模型,無人車就沒法真正上路。看看 Waymo 的事故錄像,撞來的小車的確無處閃避,但 Waymo 還是承擔(dān)了責(zé)難。因此我們急需一個模型來劃分責(zé)任、定義危險行為,能被監(jiān)管部門接受,能向公眾明確解釋事故原因,而不是呈現(xiàn)給大家一個似是而非的黑箱。”

如果將人工智能比做蒸汽,將無人車比做火車,毫無疑問,如今正在發(fā)生的是一場如蒸汽火車第一次開動一般翻天覆地的交通革命。

沙書亞說,“無人車替代其他汽車的過程是漫長的循序漸進(jìn)的,在這個過程中必須優(yōu)先考慮無人車與人類司機(jī)共存的情況。等到無人車達(dá)到了一定數(shù)量,我們或許可以讓無人車之間實(shí)現(xiàn)溝通,但那就是另一個故事了。”

另一個故事里,塞車不存在了,紅綠燈也消失了,保險公司失業(yè)了,人只要坐在后座,看無人車表演就夠了。

-

機(jī)器人

+關(guān)注

關(guān)注

211文章

28418瀏覽量

207097 -

數(shù)學(xué)模型

+關(guān)注

關(guān)注

0文章

83瀏覽量

11935 -

無人駕駛

+關(guān)注

關(guān)注

98文章

4059瀏覽量

120509

原文標(biāo)題:Mobileye RSS理論模型:把人類駕駛常識總結(jié)為數(shù)學(xué)模型,教會每一輛無人車

文章出處:【微信號:IV_Technology,微信公眾號:智車科技】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

把人們的駕駛常識總結(jié)歸納為數(shù)學(xué)模型編入無人駕駛汽車內(nèi)

把人們的駕駛常識總結(jié)歸納為數(shù)學(xué)模型編入無人駕駛汽車內(nèi)

評論