IBM正在研制一種可兼顧高精度學(xué)習(xí)和低精度推理的深度學(xué)習(xí)芯片。

深度學(xué)習(xí)領(lǐng)域仍在不斷發(fā)展,特別地,專家們認(rèn)識(shí)到如果芯片能夠使用低精度的計(jì)算方式得出近似答案,神經(jīng)網(wǎng)絡(luò)就可以用很少的資源完成大量的計(jì)算。這在移動(dòng)設(shè)備和其他功率受限的設(shè)備中尤其有用。但對(duì)某些任務(wù),尤其是訓(xùn)練神經(jīng)網(wǎng)絡(luò)去完成某些事情的任務(wù)來說,精確性仍然是必需的。IBM最近在IEEE VLSI研討會(huì)上展示了其最新的解決方案(目前仍然是原型):一款在上述兩方面都有良好表現(xiàn)的芯片。

訓(xùn)練神經(jīng)網(wǎng)絡(luò)與使用該網(wǎng)絡(luò)執(zhí)行其功能(稱為推理)的需求之間存在脫節(jié),這對(duì)那些從事于設(shè)計(jì)芯片以加速AI功能的人來說是一個(gè)巨大的挑戰(zhàn)。IBM的新型AI加速器芯片能夠滿足該公司提出的所謂范圍精度(scaled precision)要求。也就是說,它可以在32位、16位,甚至1位或2位模式下進(jìn)行訓(xùn)練和推理。

IBM約克鎮(zhèn)高地(Yorktown Heights)研究中心的杰出技術(shù)人員、該項(xiàng)工作的領(lǐng)導(dǎo)者Kailash Gopalakrishnan解釋說:“在訓(xùn)練中,你能夠使用的最好精度是16位,而在推理中可以應(yīng)用的最好精度是2位。這個(gè)芯片可能涵蓋了目前已知的最佳訓(xùn)練和最好推理。”

該芯片能夠獲得上述表現(xiàn)的原因來自于兩項(xiàng)創(chuàng)新,而這兩項(xiàng)創(chuàng)新的目標(biāo)都是實(shí)現(xiàn)相同的結(jié)果——保持所有處理器組件能夠得到數(shù)據(jù)和工作。

Gopalakrishnan說:“在深度學(xué)習(xí)方面,傳統(tǒng)芯片架構(gòu)面臨的挑戰(zhàn)之一是利用率一般非常低。”也就是說,即使芯片可能具有非常高的峰值性能,通常只有20%到30%的資源能夠被用于解決問題。IBM始終將所有任務(wù)的目標(biāo)定為90%。

利用率低通常是因?yàn)榇嬖谟谛酒車臄?shù)據(jù)流瓶頸。為了突破這些信息障礙,Gopalakrishnan的團(tuán)隊(duì)開發(fā)了一個(gè)“定制”的數(shù)據(jù)流系統(tǒng)。該數(shù)據(jù)流系統(tǒng)是一種網(wǎng)絡(luò)方案,可以加速數(shù)據(jù)從一個(gè)處理引擎到下一個(gè)處理引擎的傳輸過程。它還針對(duì)要處理的是學(xué)習(xí)任務(wù)還是推理任務(wù)以及不同的精度進(jìn)行了優(yōu)化。

第二項(xiàng)創(chuàng)新是使用專門設(shè)計(jì)的“便箋本”形式的片上存儲(chǔ)器,而不是CPU或GPU上的傳統(tǒng)高速緩沖存儲(chǔ)器。構(gòu)建高速緩存是為了遵守某些對(duì)一般計(jì)算有意義的規(guī)則,但會(huì)導(dǎo)致深度學(xué)習(xí)的延遲。例如,在某些情況下,緩存會(huì)將一大塊數(shù)據(jù)推送到計(jì)算機(jī)的主存儲(chǔ)器(強(qiáng)制推送),但如果神經(jīng)網(wǎng)絡(luò)的推理或?qū)W習(xí)過程需要用到該數(shù)據(jù),則系統(tǒng)將不得不保持等待狀態(tài),直到可以從主存儲(chǔ)器中檢索到該數(shù)據(jù)。

便箋本遵循不同的規(guī)則。構(gòu)建它的目標(biāo)是為了保持?jǐn)?shù)據(jù)流經(jīng)芯片的處理引擎,并確保數(shù)據(jù)在恰當(dāng)?shù)臅r(shí)間處于正確的位置。為了獲得90%的利用率,IBM必須使設(shè)計(jì)出的便箋本具有巨大的讀/寫帶寬(每秒192千兆字節(jié))。

由此產(chǎn)生的芯片可以執(zhí)行當(dāng)前所有的三種主要深度學(xué)習(xí)AI:卷積神經(jīng)網(wǎng)絡(luò)(CNN)、多層感知器(MLP)和長-短期記憶(LSTM)。Gopalakrishnan解釋說,這些技術(shù)共同主導(dǎo)了語言、視覺和自然語言處理。在16位精度(尤其是針對(duì)訓(xùn)練)情況下,IBM的新芯片能夠在每秒鐘內(nèi)執(zhí)行1.5萬億次浮點(diǎn)運(yùn)算;在2位精度下(推理的最佳設(shè)置)則躍升到每秒12萬億次運(yùn)算。

Gopalakrishnan指出,由于芯片是采用先進(jìn)的硅CMOS工藝(GlobalFoundries的14納米工藝)制造的,每秒鐘內(nèi)發(fā)生的所有這些操作都被限制在一個(gè)相當(dāng)小的區(qū)域內(nèi)。為了推理出一個(gè)CNN網(wǎng)絡(luò),該芯片可以在每平方毫米內(nèi)每秒執(zhí)行平均1.33萬億次操作。這個(gè)數(shù)字很重要,“因?yàn)樵诤芏鄳?yīng)用中,你的成本受到尺寸的限制,”他說。

新的架構(gòu)也證明了IBM研究人員幾年來一直在探索的東西:如果以高得多的精度訓(xùn)練神經(jīng)網(wǎng)絡(luò),真正低精度的推理就無法正常進(jìn)行。Gopalakrishnan說:“當(dāng)?shù)陀?位時(shí),訓(xùn)練與推理將開始直接相互影響。一個(gè)在16位模式下訓(xùn)練但以1位模式部署的神經(jīng)網(wǎng)絡(luò)系統(tǒng)將出現(xiàn)無法接受的重大錯(cuò)誤。因此,以與最終部署方式類似的精度訓(xùn)練網(wǎng)絡(luò)將帶來最好的結(jié)果。”

尚無任何消息披露這項(xiàng)技術(shù)什么時(shí)候可能以Watson或其他形式進(jìn)行商業(yè)化,但Gopalakrishnan的領(lǐng)導(dǎo)、IBM半導(dǎo)體研究所的副總裁Mukesh Khare表示希望它能夠發(fā)展和改進(jìn)。他說:“這只是冰山一角,我們正在進(jìn)行更多創(chuàng)新。”

-

IBM

+關(guān)注

關(guān)注

3文章

1760瀏覽量

74760 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5510瀏覽量

121334

原文標(biāo)題:IBM正在研制通用型深度學(xué)習(xí)芯片

文章出處:【微信號(hào):AI_News,微信公眾號(hào):人工智能快報(bào)】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評(píng)論請先 登錄

相關(guān)推薦

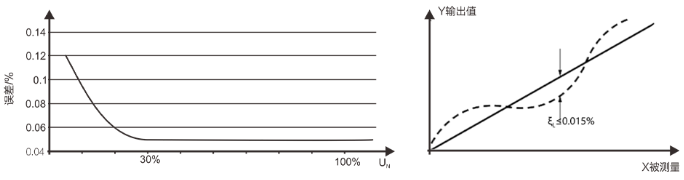

ADS7142如果保證其高精度呢?

GPU深度學(xué)習(xí)應(yīng)用案例

AI大模型與深度學(xué)習(xí)的關(guān)系

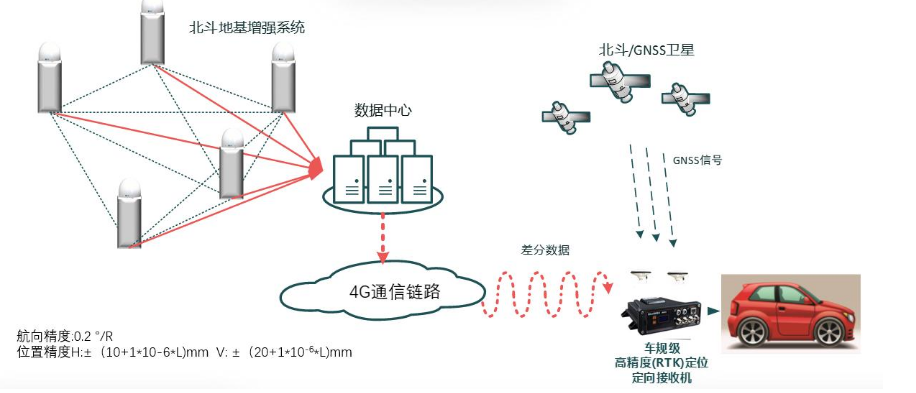

物聯(lián)網(wǎng)系統(tǒng)中高精度RTK定位方案的實(shí)現(xiàn)_高精度定位模塊

VS高精度電壓傳感器

深度學(xué)習(xí)編譯器和推理引擎的區(qū)別

深度神經(jīng)網(wǎng)絡(luò)模型量化的基本方法

深度學(xué)習(xí)模型量化方法

什么是高精度定位平板?

北斗高精度定位終端的工作原理和精度范圍

幾款高精度時(shí)鐘芯片的規(guī)格選型分析

深度解析深度學(xué)習(xí)下的語義SLAM

友思特應(yīng)用 | 高精度呈現(xiàn):PCB多類型缺陷檢測系統(tǒng)

IBM研制可兼顧高精度學(xué)習(xí)和低精度推理的深度學(xué)習(xí)芯片

IBM研制可兼顧高精度學(xué)習(xí)和低精度推理的深度學(xué)習(xí)芯片

評(píng)論