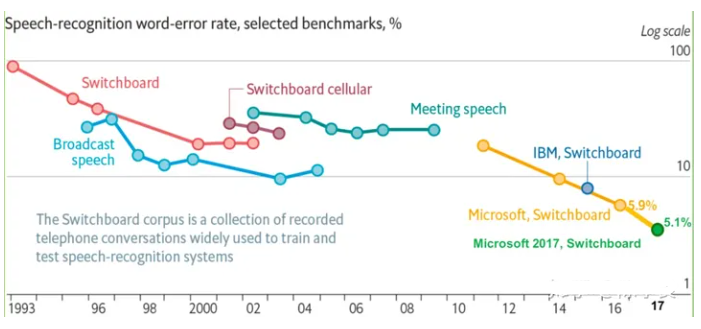

有數據顯示,到2020年,全球語音市場規模預計將達到 191.7 億美元。語音識別作為研究人工智能的方向之一,隨著語音交互技術的發展,語音AI芯片也隨之誕生。現在不論是互聯網巨頭,還是AI 初創公司,都陸續宣布進軍芯片領域。

回頭看國內車載語音市場,真正開始發展可以說是在2013年。在此之前,車內語音部分的運用最多也就是聽音樂和廣播,雖然車載語音已經出現,但系統還處于初級階段,準確率還不夠高,市場普及度很低。

2013年是一個轉折點,行業開始變革,更多人開始關注車載語音市場的發展。2015年之后側重云端方向,和智能汽車、車聯網的發展方向相關,產品形態也越來越標準。

2016年,隨著人工智能領域的發展,很多公司在智能語音部分加大了力度, 特別是對語音芯片的研發。今年更是語音芯片“爆發”的一年,并且在之后的一段時間,語音芯片還會持續作為熱點。

多場景、低功耗

不同的語音技術公司研發語音芯片的考慮可能都不太一樣,大體上來講有幾方面原因。

首先是快速集成和低功耗的需要。語音芯片能夠更好地將本地功能進行集成,同時由于現在涉及深度學習的計算量巨大,終端設備對功耗的要求也很高,低功耗的芯片成為市場需求。

其次是IoT時代下多樣化場景的需要。物聯網場景下,設備形態是多樣化的,需要一個硬件載體,成本低,算力強,同時能承載多樣化終端設備的需求,芯片在這個過程中扮演著核心的角色。

此外還有盈利的目的。任何語音技術公司,推出產品或者技術、以及軟硬件一體化的方案,最終都是為了盈利。研發語音芯片也不例外,現在正是物聯網時代推動產品落地的時間點,增加硬件功能之后的產品會帶來更高的市場效益。

語音芯片,從IOT到車載

不久前,云知聲,思必馳、出門問問等語音技術公司相繼發布了自己的AI芯片計劃。

5月16日,云知聲發布了首款面向物聯網領域的AI芯片UniOne,同時,億咖通和云知聲簽署了戰略合作,將攜手在UniOne芯片的基礎上打造車規級AI芯片,這一芯片可以為用戶與車之間提供更深層次的智能語音交互能力。

5月24日,出門問問發布了國內首款已經量產的AI語音芯片模組“問芯”Mobvoi A1,它可以幫助傳統家電廠商獲得遠場語音交互的能力,之后會在創維電視和微鯨電視上實現合作落地。

6月26日,智能語音技術公司思必馳宣布已完成新一輪融資,并宣布已與某芯片巨頭在AI芯片方面達成合作,雙方將成立合資公司,并且適用于智能語音交互的AI芯片已在研發過程中。

雖然語音技術公司陸續宣布自己在研發語音芯片,但高工智能汽車咨詢了多家語音技術公司以及主機廠,了解到現在還沒有專門針對車載領域的語音芯片。

云知聲芯片負責人李霄寒博士介紹,云知聲5月16日發布的這款芯片是UniOne 系列芯片中的第一款,從語音AI切入,芯片命名“雨燕”,主要面向的是IoT領域,適合智能家電、智能車載等多個人機交互場景。目前在積極推進車規級芯片設計,預計明年推出符合車規要求的“雨燕”產品。

另一家語音公司思必馳宣布研發的AI芯片,也不是專門針對車載領域的語音芯片,預計下半年流片;出門問問推出“問芯”Mobvoi A1是語音芯片模組,即語音模組和芯片的結合,最先是在智能家居領域,也不是針對車載領域的語音芯片。

現在市場上推出的“語音芯片”可以稱作是傳統芯片的“智能化”,將芯片和語音技術融合在一起,相比傳統的芯片和語音技術獨立而言,語音和芯片一體化之后,二者相互結合,如果芯片能夠和語音技術很好地匹配,不僅能夠解決兼容性的問題,同時還能實現降低功耗需求。

車規級的語音芯片是市場需求

車載領域的語音芯片首先一定要滿足車規的技術要求,通過溫度、穩定性的測試才可以上車,研發出可以通過車規的語音芯片還存在難點。

技術上,開發芯片本身就有一定的難度。軟件和芯片要結合在一起,其實就是把交互的東西放到硬件載體上,配比和兼容就是有難度的,還要做到識別速度快、適配不同的CPU、最后到實現量產,都需要強大的技術支撐。

雖然現在缺乏車載領域的語音芯片,隨著汽車智能化以及車載語音交互的發展,未來車規級的語音芯片會成為市場需求。

吉利汽車負責HMI的相關人士表示,現在車載語音控制能力還遠遠不夠,就目前已經上市的車型而言,語音的在線控制識別速度很慢,而本地詞庫又很少,自然語音狀況下語音內容和詞庫無法匹配,就會出現無法識別或識別有誤。

而目前市面上推出“云+端+芯片”或者“云端芯”一體化的芯片,優化了網絡識別的能力,但本地識別的能力依舊比較差,識別速度慢,用戶是比較難接受的。

語音芯片需要提高本地識別功能,但未來比較理想的是,隨著網絡傳輸速度的完善,研發出能夠將本地識別和在線識別結合在一起的語音芯片。

億咖通相關人士表示,隨著車聯網,人工智能的發展,車載芯片性能遠遠不能滿足汽車娛樂和多樣化交互功能需求。語音作為車載系統的剛需和亮點,更希望有強勁的硬件加速能力和適應力的平臺,車規級智能語音芯片會是大勢所趨。

響應速度和識別率如何提升

最近,首款搭載“祺云概念”智聯系統的中期換代車型傳祺GS4搭載的智能語音控制系統,用戶發出語音指令,系統便能在1.2秒內快速反應。官方宣稱,速度和靈敏度遠超同級。

傳祺智能語音控制系統能夠在正常環境中實現95%識別正確率并具備多方言口音普通話的識別能力,離線語音識別能力、汽車訓練的麥克陣列降噪能力、語音打斷技術、可見即可說、自定義語音喚醒等多項核心技術能力。

針對傳祺GS4智能語音控制系統這一大賣點,有業內人士表示:“在網速、使用環境、車機CPU、內存等各方面最佳工況時,達到1.2S響應、95%識別率并不難。”

而在實際應用中,車輛噪音、網速波動、車機后臺多進程、硬件資源被占用、第三方執行器件延遲等等,都會造成語音控制系統延遲

科大訊飛相關人士表示:“影響語音識別響應時間有:音頻后端檢測、網絡傳輸、引擎處理和應用處理四個方面。”

音頻后端點檢測是影響語音響應速度最重要的部分,也是不可減少和用時最長的部分。講完一句語音指令,系統需要800ms-1000ms靜音段來識別講話是否結束,減少這個時間,則會帶來體驗下降。例如,用戶說話停頓,系統誤認為用戶已經說完了,導致錯誤的識別結果。

引擎處理,車機硬件配置低或其它進程占用CPU、內存等硬件資源,導致語音處理進程沒有足夠的系統資源,引起處理延遲。

通過升級車機硬件和優化引擎算法兩種方案可以有效解決問題,但升級硬件配置需要增加成本,所以主機廠更加傾向于,優化引擎算法,在低成本硬件平臺上實現高效語音系統應用。

網絡速度慢、不穩定也是會導致語音識別延遲的一大因素。通過提升網絡傳輸速率,如未來的5G通訊,也可以有效減少延遲。

除此之外,優化信源(地圖、音樂、電臺等等)和第三方執行器件(開車內燈、開天窗、座椅加熱等等),也能減少語音控制系統延遲,提升用戶體驗。

語音控制、觸屏、機械按鍵等都屬于控制層,最終做出執行反饋的是信源和第三方執行器件。如果信源和第三方執行器件運行緩慢,也會影響用戶對語音控制系統的體驗。

目前,車載領域已經量產的語音產品大多數響應時間在1.5s-3s之間,當響應時間達到2s以上時,用戶能夠感覺到明顯的延遲。

低NVH可提高識別率

識別率對用戶體驗至關重要,識別率太低、不準確,用戶好似對牛彈琴,不但不能體現語音控制系統的便利性,反而會成為雞肋配置。

主機廠相關人士表示:“提升語音識別率除了技術方面,降低車輛NVH也是一個重要的途徑。”

車輛行駛中,外界環境噪音、發動機震動噪音、胎噪、風噪、車身共振等等都會影響語音指令識別率,所以除了不斷對語音系統優化之外,降低車輛NVH也是提升語音識別率和用戶體驗的方法之一。

-

芯片

+關注

關注

456文章

51019瀏覽量

425399 -

AI

+關注

關注

87文章

31262瀏覽量

269627 -

人工智能

+關注

關注

1792文章

47497瀏覽量

239211 -

車聯網

+關注

關注

76文章

2594瀏覽量

91689

原文標題:“語音AI芯片”持續發酵,車載語音去向何處?| GGAI深度

文章出處:【微信號:ilove-ev,微信公眾號:高工智能汽車】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

【「嵌入式系統設計與實現」閱讀體驗】+ 基于語音識別的智能杯墊

語音識別與自然語言處理的關系

語音識別技術的應用與發展

ASR與傳統語音識別的區別

ASR語音識別技術應用

物聯網系統智能控制產品的語音識別方案_離線語音識別芯片分析

什么是離線語音識別芯片?與在線語音識別的區別

網絡延遲為何如此重要

環保又高效:365nm固化燈為何如此受歡迎?

RISC-V為何如此重要?

百億美元市場的語音識別為何如此受青睞?

百億美元市場的語音識別為何如此受青睞?

評論