引入Mask R-CNN思想通過語義分割進行任意形狀文本檢測與識別。

華中科技大學白翔老師團隊在自然場景文本檢測與識別領域成果頗豐,這篇被ECCV2018接收的論文《Mask TextSpotter: An End-to-End Trainable Neural Network for Spotting Text with Arbitrary Shapes》是其最新力作。

文章指出,最近,基于深度神經網絡的模型已經主導了場景文本檢測和識別領域。在該文中,研究了場景“text spotting”的問題,其旨在自然圖像中同時進行文本檢測和識別。

該文受到Mask R-CNN的啟發提出了一種用于場景text spotting的可端到端訓練的神經網絡模型:Mask TextSpotter。與以前使用端到端可訓練深度神經網絡完成text spotting的方法不同,Mask TextSpotter利用簡單且平滑的端到端學習過程,通過語義分割獲得精確的文本檢測和識別。此外,它在處理不規則形狀的文本實例(例如,彎曲文本)方面優于之前的方法。

在ICDAR2013、ICDAR2015和Total-Text數據庫上的實驗表明,所提出的方法在場景文本檢測和端到端文本識別任務中都達到了state-of-the-art的水平。

彎曲形狀文本檢測與識別的例子:

左圖是水平text spotting方法的結果,它的檢測框是水平的;中間圖是具有方向的text spotting方法的結果,它的檢測框傾斜;右圖是該文提出的Mask TextSpotter算法的結果,它的檢測框不是外接矩形而是一個最小外接多邊形,對這種彎曲文本達到了更精確的文本檢測和識別。

▌網絡架構

網絡架構由四部分組成,骨干網feature pyramid network (FPN),文本候選區域生成網絡region proposal network (RPN),文本包圍盒回歸網絡Fast R-CNN,文本實例分割與字符分割網絡mask branch。

▌訓練階段

RPN首先生成大量的文本候選區域,然后這些候選區域的RoI特征被送入Fast R-CNN branch和mask branch,由它們去分別生成精確的文本候選包圍盒(text candidate boxes)、文本實例分割圖(text instance segmentation maps)、字符分割圖(character segmentation maps)。

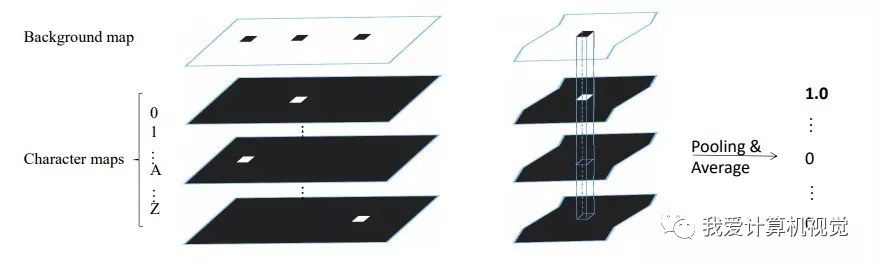

尤其值得一提的是Mask Branch,如下圖:

它將輸入的RoI(固定大小16*64)經過4層卷積層和1層反卷積層,生成38通道的圖(大小32*128),包括一個全局文本實例圖——它給出了文本區域的精確定位,無論文本排列的形狀如何它都能分割出來,還包括36個字符圖(對應于字符0~9,A~Z),一個字符背景圖(排除字符后的的所有背景區域),在后處理階段字符背景圖會被用到。

這是一個多任務模型,其Loss組成:

▌推理階段

推理階段mask branch的輸入RoIs來自于Fast R-CNN的輸出。

推理的過程如下:首先輸入一幅測試圖像,通過Fast R-CNN獲取候選文本區域,然后通過NMS(非極大抑制)過濾掉冗余的候選區域,剩下的候選區域resize后送入mask branch,得到全局文本實例圖,和字符圖。通過計算全局文本實例圖的輪廓可以直接得到包圍文本的多邊形,通過在字符圖上使用提出的pixel voting方法生成字符序列。

如上圖所示,Pixel voting方法根據字符背景圖中每一個聯通區域,計算每一字符層相應區域的平均字符概率,即得到了識別的結果。

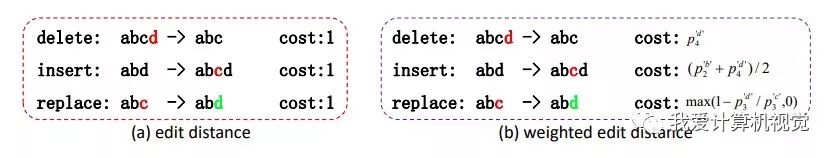

為了在識別出來的字符序列中找到最佳匹配單詞,作者在編輯距離(Edit Distance)基礎上發明了加權編輯距離(Weighted Edit Distance)。

識別結果示例:

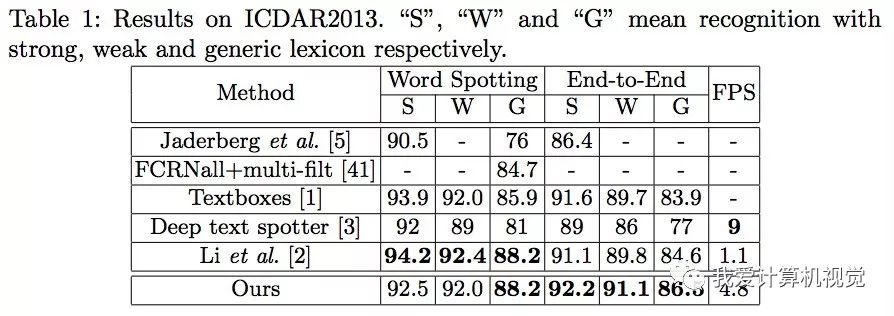

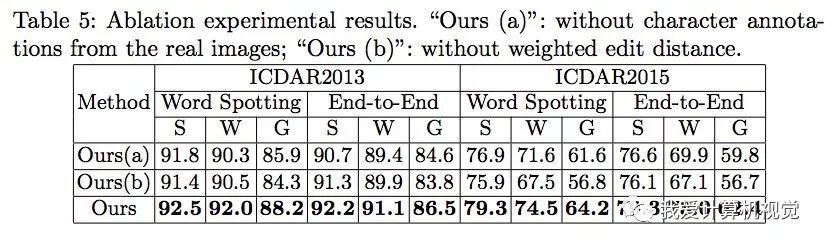

▌ICDAR2013的結果

該庫主要用來驗證在水平文本上的識別效果。

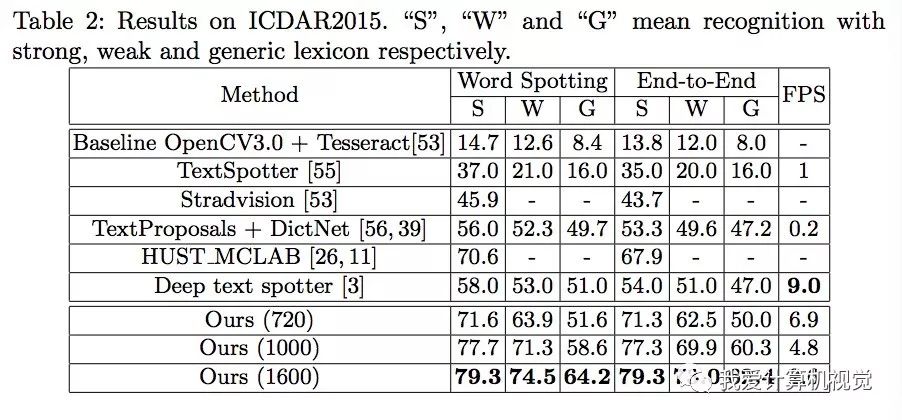

▌ICDAR2015的結果

用來驗證方向變化的文本的結果。

▌Total-Text結果

驗證彎曲的文本檢測識別結果。

彎曲文本識別示例

▌速度

在Titan Xp顯卡上,720*1280的圖像,速度可以達到6.9FPS。

▌效果分析

作者通過進一步的實驗分析,發現:如果去除字符圖子網絡,只訓練檢測模型,檢測的性能會下降,說明檢測可以受益于識別模塊。下圖中Ours(det only)為只有檢測的模型。

如果去除訓練樣本中的真實世界字符標注圖像,模型依然可以達到相當競爭力的性能。下圖中Ours(a)即不使用真實世界字符標注圖像的訓練結果。

通過加權編輯距離(weighted edit distance)和原始編輯距離的比較,發現,加權編輯距離可以明顯提高識別性能。下圖中Ours(b)為原始編輯距離的結果。

該文將Mask R-CNN語義分割的方法用于文本檢測與識別,取得了顯著的性能改進,并能成功應對任意形狀的文本,其他語義分割方法是否也能拿來試一下呢?(該文目前還沒有開源代碼。)

-

神經網絡

+關注

關注

42文章

4772瀏覽量

100792 -

文本

+關注

關注

0文章

118瀏覽量

17086

原文標題:ECCV 2018 | 華科白翔老師團隊ECCV2018 OCR論文:Mask TextSpotter

文章出處:【微信號:rgznai100,微信公眾號:rgznai100】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

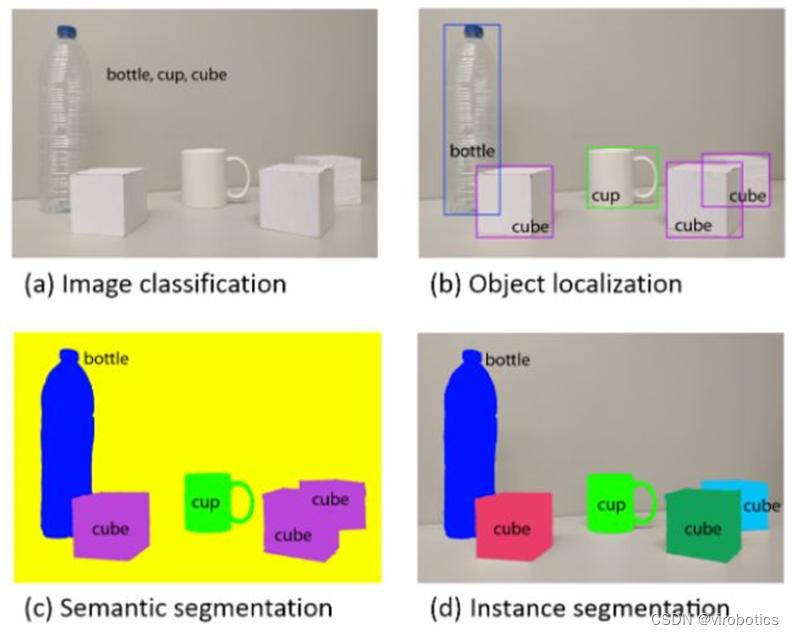

什么是Mask R-CNN?Mask R-CNN的工作原理

手把手教你操作Faster R-CNN和Mask R-CNN

FAIR何愷明、Ross等人最新提出實例分割的通用框架TensorMask

Facebook AI使用單一神經網絡架構來同時完成實例分割和語義分割

基于改進Faster R-CNN的目標檢測方法

一種基于Mask R-CNN的人臉檢測及分割方法

基于Mask R-CNN的遙感圖像處理技術綜述

用于實例分割的Mask R-CNN框架

3D視覺技術內容理解領域的研究進展

PyTorch教程14.8之基于區域的CNN(R-CNN)

引入Mask R-CNN思想通過語義分割進行任意形狀文本檢測與識別

引入Mask R-CNN思想通過語義分割進行任意形狀文本檢測與識別

評論