Scikit-Learn發布0.20預覽版,Scikit-Learn與Pandas的新融合會使以往的工作流程更為簡單,其功能也更為豐富、更具魯棒性。

Scikit-Learn的0.20版本,將會是進行近年來最重磅的升級。

對于許多數據科學家來說,一個典型的工作流程是在Scikit-Learn進行機器學習之前,用Pandas進行探索性的數據分析。新版本的Scikit-Learn將會讓這個過程變得更加簡單、功能更加豐富、更魯棒以及更加標準化。

注:本文中的0.20版本的是指預覽版,最終版本目前還沒有發布。

升級到0.20版本

幾日前,官方剛剛發布這個0.20的預覽版。用戶可以通過conda命令進行安裝:

condainstallscikit-learn=0.20rc1-cconda-forge/label/rc-cconda-forge

也可以通過pip命令進行安裝:

pipinstall—prescikit-learn

ColumnTransformer、升級版OneHotEncoder介紹

隨著0.20版本的升級,從Pandas到Scikit-Learn的許多工作流會變得比較相似。ColumnTransformer估計器會將一個轉換應用到Pandas DataFrame(或數組)列的特定子集。

OneHotEncoder估計器不是“新生物”,但已經升級為編碼字符串列。以前,它只對包含數字分類數據的列進行編碼。

接下來,讓我們看看這些新添加的功能是如何處理Pandas DataFrame中的字符串列的。

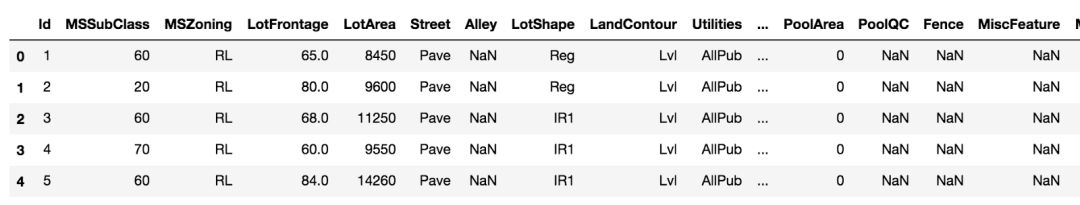

Kaggle住房數據集

Kaggle最早的機器學習競賽題目之一是《住房價格:先進的回歸技術》。其目標是在給定80個特征情況下,預測房價。

數據一覽

在DataFrame中讀取數據并輸出前幾行。

>>>importpandasaspd>>>importnumpyasnp>>>train=pd.read_csv(‘data/housing/train.csv’)>>>train.head()

>>>train.shape(1460,81)

從訓練集中刪除目標變量

目標變量是SalePrice,我們將它作為數組移除并分配給它自己的變量。我們將在后面的機器學習中用到它。

>>>y=train.pop('SalePrice').values

編碼單個字符串列

首先,我們編碼一個字符串列HoustStyle,它具有房子外觀的值。讓我們輸出每個字符串值的唯一計數。

>>>vc=train['HouseStyle'].value_counts()>>>vc1Story7262Story4451.5Fin154SLvl65SFoyer371.5Unf142.5Unf112.5Fin8Name:HouseStyle,dtype:int64

這一列中有8個唯一值(unique value)。

scikitlearn Gotcha必須有2D數據

大多數Scikit-Learn估計器嚴格要求數據是的2D的。從技術角度講,如果我們選擇上面的列作為train[“HouseStyle”],Pandas Series是數據的單一維度。我們可以強制Pandas創建一個單列DataFrame,方法是將一個單項列表傳遞到方括號中,如下所示:

>>>hs_train=train[['HouseStyle']].copy()>>>hs_train.ndim2

評估器的三個步驟過程——導入、實例化、匹配

Scikit-Learn API對于所有的估計器都是一致的,它根據下面三個步驟來匹配(訓練)數據。

從它所在的模塊中導入我們想要的估計器

實例化估計器,可能改變它的默認值

根據數據擬合估計量。在必要情況下,可以將數據轉換到新的空間。

下面,我們導入一個hotencoder,將它實例化,并確保返回一個密集(而不是稀疏)的數組,然后用fit_transform方法對單個列進行編碼。

>>>fromsklearn.preprocessingimportOneHotEncoder>>>ohe=OneHotEncoder(sparse=False)>>>hs_train_transformed=ohe.fit_transform(hs_train)>>>hs_train_transformedarray([[0.,0.,0.,...,1.,0.,0.],[0.,0.,1.,...,0.,0.,0.],[0.,0.,0.,...,1.,0.,0.],...,[0.,0.,0.,...,1.,0.,0.],[0.,0.,1.,...,0.,0.,0.],[0.,0.,1.,...,0.,0.,0.]])

正如預期的那樣,它將每個唯一的值編碼為自己的二進制列。

>>>hs_train_transformed.shape(1460,8)

得到了NumPy數組,那么列名在哪里?

注意,我們的輸出是一個NumPy數組,而不是Pandas DataFrame。Scikit-Learn最初不是為了直接與Pandas整合而建的。所有的Pandas對象都在內部轉換成NumPy數組,并且在轉換后總是返回NumPy數組。

我們仍然可以通過其get_feature_names方法從OneHotEncoder對象獲得列名。

>>>feature_names=ohe.get_feature_names()>>>feature_namesarray(['x0_1.5Fin','x0_1.5Unf','x0_1Story','x0_2.5Fin','x0_2.5Unf','x0_2Story','x0_SFoyer','x0_SLvl'],dtype=object)

驗證第一行數據的正確性

接下來讓我們驗證估計值是否正確。首先是第一行編碼的數據。

>>>row0=hs_train_transformed[0]>>>row0array([0.,0.,0.,0.,0.,1.,0.,0.])

這將數組中的第6個值編碼為1。讓我們使用布爾索引(boolean index)來顯示特征名稱。

>>>feature_names[row0==1]array(['x0_2Story'],dtype=object)

現在,讓我們驗證原始DataFrame列中的第一個值是否相同。

>>>hs_train.values[0]array(['2Story'],dtype=object)

使用inverse_transform來實現自動化

與大多數transformer對象一樣,有一個inverse_transform方法可以返回原始數據。在這里,我們必須將row0包裝在一個列表中,使其成為一個2D數組。

>>>ohe.inverse_transform([row0])array([['2Story']],dtype=object)

我們可以通過轉置整個轉換后的數組來驗證所有的值。

>>>hs_inv=ohe.inverse_transform(hs_train_transformed)>>>hs_invarray([['2Story'],['1Story'],['2Story'],...,['2Story'],['1Story'],['1Story']],dtype=object)>>>np.array_equal(hs_inv,hs_train.values)True

將轉換應用到測試集中

無論我們對訓練集做什么轉換,我們都必須應用到測試集。

>>>test=pd.read_csv('data/housing/test.csv')>>>hs_test=test[['HouseStyle']].copy()>>>hs_test_transformed=ohe.transform(hs_test)>>>hs_test_transformedarray([[0.,0.,1.,...,0.,0.,0.],[0.,0.,1.,...,0.,0.,0.],[0.,0.,0.,...,1.,0.,0.],...,[0.,0.,1.,...,0.,0.,0.],[0.,0.,0.,...,0.,1.,0.],[0.,0.,0.,...,1.,0.,0.]])

我們又得到了8列。

>>>hs_test_transformed.shape(1459,8)

必須impute缺失數據

現在,我們必須impute缺失數據。預處理模塊中舊的Imputer已經被棄用。一個新的模塊——impute,由一個新的估計值SimpleImputer和一個新的策略“常量”組成。默認情況下,此策略將用字符串“missing_value”來填充缺失值。我們可以選擇使用fill_value參數設置它。

>>>hs_train=train[['HouseStyle']].copy()>>>hs_train.iloc[0,0]=np.nan>>>fromsklearn.imputeimportSimpleImputer>>>si=SimpleImputer(strategy='constant',fill_value='MISSING')>>>hs_train_imputed=si.fit_transform(hs_train)>>>hs_train_imputedarray([['MISSING'],['1Story'],['2Story'],...,['2Story'],['1Story'],['1Story']],dtype=object)

接下來,我們可以像以前那樣編碼啦!

>>>hs_train_transformed=ohe.fit_transform(hs_train_imputed)>>>hs_train_transformedarray([[0.,0.,0.,...,1.,0.,0.],[0.,0.,1.,...,0.,0.,0.],[0.,0.,0.,...,0.,0.,0.],...,[0.,0.,0.,...,0.,0.,0.],[0.,0.,1.,...,0.,0.,0.],[0.,0.,1.,...,0.,0.,0.]])

注意,我們現在有了一個額外的列和一個額外的特征名稱。

>>>hs_train_transformed.shape(1460,9)>>>ohe.get_feature_names()array(['x0_1.5Fin','x0_1.5Unf','x0_1Story','x0_2.5Fin','x0_2.5Unf','x0_2Story','x0_MISSING','x0_SFoyer','x0_SLvl'],dtype=object)

更多關于fit_transform的細節

對于所有的估計器,fit_transform方法將首先調用fit方法,然后調用transform方法。fit方法找到轉換過程中使用的關鍵屬性。例如,對于SimpleImputer,如果策略是“均值”,那么它就會在fit方法中找到每一列的均值。它會存儲每一列的均值。當調用transform時,它使用每個列的這個存儲平均值來填充缺失值并返回轉換后的數組。

OneHotEncoder原理是類似的。在fit方法中,它會找到每個列的所有唯一值,并再次存儲這些值。在調用transform時,它使用這些存儲的惟一值來生成二進制數組。

將兩個轉換應用到測試集

我們可以手動應用上面的兩個步驟,如下所示:

>>>hs_test=test[['HouseStyle']].copy()>>>hs_test.iloc[0,0]='uniquevaluetotestset'>>>hs_test.iloc[1,0]=np.nan>>>hs_test_imputed=si.transform(hs_test)>>>hs_test_transformed=ohe.transform(hs_test_imputed)>>>hs_test_transformed.shape(1459,8)>>>ohe.get_feature_names()array(['x0_1.5Fin','x0_1.5Unf','x0_1Story','x0_2.5Fin','x0_2.5Unf','x0_2Story','x0_SFoyer','x0_SLvl'],dtype=object)

使用一個Pipeline來替代

Scikit-Learn提供了一個Pipeline估計器,它獲取一個轉換列表并依次應用它們。您還可以運行機器學習模型作為最終評估器。在這里,我們只是簡單地impute和編碼。

>>>fromsklearn.pipelineimportPipeline

每個步驟是一個two-item元組,由一個標記步驟和實例化估計器的字符串組成。前一個步驟的輸出是后一個步驟的輸入。

>>>si_step=('si',SimpleImputer(strategy='constant',fill_value='MISSING'))>>>ohe_step=('ohe',OneHotEncoder(sparse=False,handle_unknown='ignore'))>>>steps=[si_step,ohe_step]>>>pipe=Pipeline(steps)>>>hs_train=train[['HouseStyle']].copy()>>>hs_train.iloc[0,0]=np.nan>>>hs_transformed=pipe.fit_transform(hs_train)>>>hs_transformed.shape(1460,9)

通過簡單地將測試集傳遞給transform方法,可以輕松地通過Pipeline的每個步驟轉換測試集。

>>>hs_test=test[['HouseStyle']].copy()>>>hs_test_transformed=pipe.transform(hs_test)>>>hs_test_transformed.shape(1459,9)

為什么只對測試集轉換方法?

在轉換測試集時,重要的是只調用transform方法,而不是fit_transform。當我們在訓練集中運行fit_transform時,Scikit-Learn找到了它需要的所有必要信息,以便轉換包含相同列名的任何其他數據集。

多字符串列轉換

對多列字符串進行編碼不成問題。先選擇你要編碼的列,再通過同樣的流程傳遞新的數據框架。

>>>string_cols=['RoofMatl','HouseStyle']>>>string_train=train[string_cols]>>>string_train.head(3)RoofMatlHouseStyle0CompShg2Story1CompShg1Story2CompShg2Story>>>string_train_transformed=pipe.fit_transform(string_train)>>>string_train_transformed.shape(1460,16)

把握pipeline的每個部分

我們可以通過named_steps字典屬性中的名稱檢索pipeline中的每個轉換器。在本例中,我們可以得到一個熱門編碼器,用來輸出特征名稱。

>>>ohe=pipe.named_steps['ohe']>>>ohe.get_feature_names()array(['x0_ClyTile','x0_CompShg','x0_Membran','x0_Metal','x0_Roll','x0_Tar&Grv','x0_WdShake','x0_WdShngl','x1_1.5Fin','x1_1.5Unf','x1_1Story','x1_2.5Fin','x1_2.5Unf','x1_2Story','x1_SFoyer','x1_SLvl'],dtype=object)

使用新的列轉換器來選擇列

全新的列轉換器(屬于新組合模塊的一部分)可以讓用戶選擇要讓哪些列獲得哪些轉換。 與連續列相比,分類列幾乎總是需要單獨的轉換。

列轉換器目前是還是實驗性的,其功能將來可能會發生變化。

ColumnTransformer獲取三項元組(tuple)的列表。 元組中的第一個值其標記作用的名稱,第二個是實例化的估算器,第三個是要進行轉換的列的列表。 元組如下所示:

('name',SomeTransformer(parameters),columns)

這里的列實際上不必一定是列名。用戶可以使用列的整數索引,布爾數組,甚至函數(它可以使用整個DataFrame作為參數,并且必須返回選擇的列)。

用戶也可以將NumPy數組與列轉換器一起使用,但本教程主要關注Pandas的集成,因此我們這里繼續使用DataFrames。

將pipeline傳遞給列轉換器

我們甚至可以將多個轉換的流程傳遞給列轉換器,我們現在正是要這樣做,因為在字符串列上有多個轉換。

下面,我們使用列轉換器重現上述流程和編碼。 請注意,實際流程與上面的流程完全相同,只是附加了每個變量名稱的cat。 我們將在下一章節中為數字列添加不同的流程。

>>>fromsklearn.composeimportColumnTransformer>>>cat_si_step=('si',SimpleImputer(strategy='constant',fill_value='MISSING'))>>>cat_ohe_step=('ohe',OneHotEncoder(sparse=False,handle_unknown='ignore'))>>>cat_steps=[cat_si_step,cat_ohe_step]>>>cat_pipe=Pipeline(cat_steps)>>>cat_cols=['RoofMatl','HouseStyle']>>>cat_transformers=[('cat',cat_pipe,cat_cols)]>>>ct=ColumnTransformer(transformers=cat_transformers)

將整個DataFrame傳遞給列轉換器

列轉換器實例可以選擇我們想要使用的列,因此我們只需將整個DataFrame傳遞給fit_transform方法,就可以選擇我們所需的列。

>>>X_cat_transformed=ct.fit_transform(train)>>>X_cat_transformed.shape(1460,16)

然后可以使用同樣的方法轉換測試集。

>>>X_cat_transformed_test=ct.transform(test)>>>X_cat_transformed_test.shape(1459,16)

檢索特征名

我們必須進一步挖掘,來獲取特征名。所有的轉換器都存儲在named_transformers_ dictionary屬性中。 然后使用特征名、含有三項要素的元組中的第一項,來選擇特定的轉換器。 下面的代碼就是選擇轉換器(此例中只有一個流程,名為cat)。

>>>pl=ct.named_transformers_['cat']

然后從這個流程中選擇一個熱編碼器對象,最后得到特征名。

>>>ohe=pl.named_steps['ohe']>>>ohe.get_feature_names()array(['x0_ClyTile','x0_CompShg','x0_Membran','x0_Metal','x0_Roll','x0_Tar&Grv','x0_WdShake','x0_WdShngl','x1_1.5Fin','x1_1.5Unf','x1_1Story','x1_2.5Fin','x1_2.5Unf','x1_2Story','x1_SFoyer','x1_SLvl'],dtype=object)

轉換數字列

數字列需要一組不同的轉換。我們不使用常亮來填充缺失值,而是經常選擇中值或均值。一般不對列中的值進行編碼,而是通常將列中的值減去每列的平均值并除以標準差,對列中的值進行標準化。這有助于讓許多模型產生更好的擬合結果(比如脊回歸)。

使用所有數字列

我們可以選擇所有數字列,而不是像處理字符串列一樣,手動選擇一列或兩列。首先使用dtypes屬性查找每列的數據類型,然后測試每個dtype的類型是否為“O”。 dtypes屬性會返回一系列NumPy dtype對象,每個對象都有一個單一字符的kind屬性。我們可以利用它來查找數字或字符串列。 Pandas將其所有字符串列存儲為kind屬性等于“O”的對象。有關kind屬性的更多信息,請參閱NumPy文檔。

>>>train.dtypes.head()Idint64MSSubClassint64MSZoningobjectLotFrontagefloat64LotAreaint64dtype:object

獲取kind屬性,該屬性是表示dtype的單字字符串。

>>>kinds=np.array([dt.kindfordtintrain.dtypes])>>>kinds[:5]array(['i','i','O','f','i'],dtype='

假設所有的數字列都是非對象性的。我們可以使用同樣的方法來獲取類別列。

>>>all_columns=train.columns.values>>>is_num=kinds!='O'>>>num_cols=all_columns[is_num]>>>num_cols[:5]array(['Id','MSSubClass','LotFrontage','LotArea','OverallQual'],dtype=object)>>>cat_cols=all_columns[~is_num]>>>cat_cols[:5]array(['MSZoning','Street','Alley','LotShape','LandContour'],dtype=object)

獲取數字列列名之后,可以再次使用列轉換器。

>>>fromsklearn.preprocessingimportStandardScaler>>>num_si_step=('si',SimpleImputer(strategy='median'))>>>num_ss_step=('ss',StandardScaler())>>>num_steps=[num_si_step,num_ss_step]>>>num_pipe=Pipeline(num_steps)>>>num_transformers=[('num',num_pipe,num_cols)]>>>ct=ColumnTransformer(transformers=num_transformers)>>>X_num_transformed=ct.fit_transform(train)>>>X_num_transformed.shape(1460,37)

類別列和數字列轉換的結合

我們可以使用類轉換器對DataFrame的每個部分進行單獨轉換。在本文的示例中,我們將使用每一列。

然后,將類別列和數字列分別創建單獨的流程,然后使用列轉換器進行獨立轉換。這兩個轉換過程是并行的。最后,將每個轉換結果連接在一起。

>>>transformers=[('cat',cat_pipe,cat_cols),('num',num_pipe,num_cols)]>>>ct=ColumnTransformer(transformers=transformers)>>>X=ct.fit_transform(train)>>>X.shape(1460,305)

機器學習

本文的重點就是設置數據,以便進行機器學習。我們可以創建一個最終流程,并添加機器學習模型作為最終的估算器。這個流程的第一步就是我們上文剛剛完成的整個轉換過程。我們在本文開始處設定y表示售價。在這里,我們將使用thefit方法,而不是fit_transform方法,因為流程的最后一步是機器學習模型,而且不進行轉換。

>>>fromsklearn.linear_modelimportRidge>>>ml_pipe=Pipeline([('transform',ct),('ridge',Ridge())])>>>ml_pipe.fit(train,y)

我們可以用score方法來評估模型,它將返回一個R-Squared值:

>>>ml_pipe.score(train,y)0.92205

交叉驗證

當然,在訓練集上進行自我評分是沒有用的。我們需要做一些K重交叉驗證,以了解如何處理不可見的數據。這里我們設置一個隨機狀態,以便在整個教程的其余各部分保持同樣的狀態。

>>>fromsklearn.model_selectionimportKFold,cross_val_score>>>kf=KFold(n_splits=5,shuffle=True,random_state=123)>>>cross_val_score(ml_pipe,train,y,cv=kf).mean()0.813

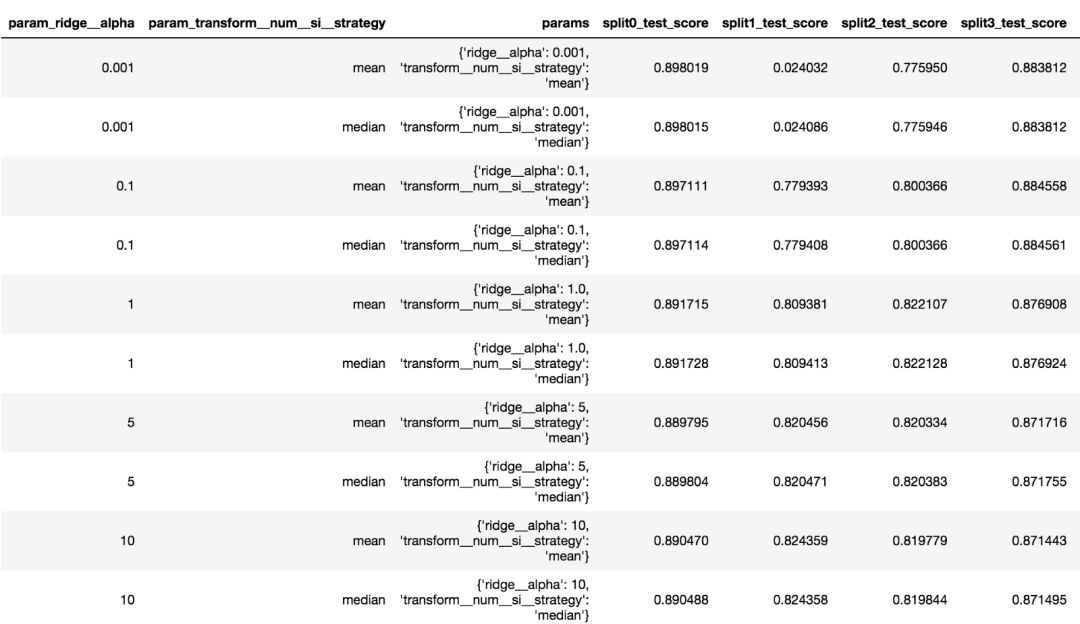

在網格搜索時選擇參數

在Scikit-Learn中進行網格搜索,要求我們將映射傳遞至到可能值的參數名稱字典中。 在流程中,我們必須將步驟的名稱加上雙下劃線,然后使用參數名。 如果流程中有多個層級,必須繼續使用雙下劃線,向上移動一級,直至到達我們想要優化其參數的估算器為止。

>>>fromsklearn.model_selectionimportGridSearchCV>>>param_grid={'transform__num__si__strategy':['mean','median'],'ridge__alpha':[.001,0.1,1.0,5,10,50,100,1000],}>>>gs=GridSearchCV(ml_pipe,param_grid,cv=kf)>>>gs.fit(train,y)>>>gs.best_params_{'ridge__alpha':10,'transform__num__si__strategy':'median'}>>>gs.best_score_0.819

在Pandas DataFrame中獲取所有網格搜索結果

網格搜索的所有結果都存儲在cv_results_屬性中。 這是一個字典,可以轉換為Pandas DataFrame以獲得更好的顯示效果,該屬性使用一種更容易進行手動掃描的結構。

>>>pd.DataFrame(gs.cv_results_)

參數網格中每一種組合中都包含大量數據

構建一個具備全部基礎功能的自定義轉換器

在上述工作流程中存在一些限制。例如,如果熱編碼器允許在使用fit方法期間忽略缺失值,那就更好了,那就可以簡單地將缺失值編碼為全零行。而目前,它還要強制用戶用一些字符串去填充缺失值,然后將此字符串編碼為單獨的列。

低頻字符串

此外,在訓練集中僅出現幾次的字符串列,可能不是測試集中的可靠預測變量。我們可能希望將它們編碼為缺失值。

編寫自己的估算器類

Scikit-Learn可以幫助用戶編寫自己的估算器類。基本模塊中的BaseEstimator類可以提供get_params和set_params方法。當進行網格搜索時,set_params方法是必需的。用戶可以自己編寫,也可以用BaseEstimator。還有一個TransformerMixin,但只是為用戶編寫fit_transform方法。

以下代碼構建的類基本轉換器可執行以下操作:

?使用數字列的均值或中位數填充缺失值

?對所有數字列進行標準化

?對字符串列使用一個熱編碼

?不用再填充類別列中的缺失值,而是直接將其編碼為0

?忽略測試集中字符串列中的少數獨特值

?允許您為字符串列中值必須具有的出現次數選擇閾值。低于此閾值的字符串將被編碼為全0

?僅適用于DataFrames,并且只是實驗性的,未經過測試,因此可能會破壞某些數據集。

?之所以稱其為“基本”轉換器,是因為對許多數據集而言,這些操作屬于最基本的轉換。

fromsklearn.baseimportBaseEstimatorclassBasicTransformer(BaseEstimator):def__init__(self,cat_threshold=None,num_strategy='median',return_df=False):#storeparametersaspublicattributesself.cat_threshold=cat_thresholdifnum_strategynotin['mean','median']:raiseValueError('num_strategymustbeeither"mean"or"median"')self.num_strategy=num_strategyself.return_df=return_dfdeffit(self,X,y=None):#AssumesXisaDataFrameself._columns=X.columns.values#Splitdataintocategoricalandnumericself._dtypes=X.dtypes.valuesself._kinds=np.array([dt.kindfordtinX.dtypes])self._column_dtypes={}is_cat=self._kinds=='O'self._column_dtypes['cat']=self._columns[is_cat]self._column_dtypes['num']=self._columns[~is_cat]self._feature_names=self._column_dtypes['num']#Createadictionarymappingcategoricalcolumntounique#valuesabovethresholdself._cat_cols={}forcolinself._column_dtypes['cat']:vc=X[col].value_counts()ifself.cat_thresholdisnotNone:vc=vc[vc>self.cat_threshold]vals=vc.index.valuesself._cat_cols[col]=valsself._feature_names=np.append(self._feature_names,col+'_'+vals)#gettotalnumberofnewcategoricalcolumnsself._total_cat_cols=sum([len(v)forcol,vinself._cat_cols.items()])#getmeanormediannum_cols=self._column_dtypes['num']self._num_fill=X[num_cols].agg(self.num_strategy)returnselfdeftransform(self,X):#checkthatwehaveaDataFramewithsamecolumnnamesas#theonewefitifset(self._columns)!=set(X.columns):raiseValueError('PassedDataFramehasdifferentcolumnsthanfitDataFrame')eliflen(self._columns)!=len(X.columns):raiseValueError('PassedDataFramehasdifferentnumberofcolumnsthanfitDataFrame')#fillmissingvaluesnum_cols=self._column_dtypes['num']X_num=X[num_cols].fillna(self._num_fill)#Standardizenumericsstd=X_num.std()X_num=(X_num-X_num.mean())/stdzero_std=np.where(std==0)[0]#Ifthereis0standarddeviation,thenallvaluesarethe#same.Setthemto0.iflen(zero_std)>0:X_num.iloc[:,zero_std]=0X_num=X_num.values#createseparatearrayfornewencodedcategoricalsX_cat=np.empty((len(X),self._total_cat_cols),dtype='int')i=0forcolinself._column_dtypes['cat']:vals=self._cat_cols[col]forvalinvals:X_cat[:,i]=X[col]==vali+=1#concatenatetransformednumericandcategoricalarraysdata=np.column_stack((X_num,X_cat))#returneitheraDataFrameoranarrayifself.return_df:returnpd.DataFrame(data=data,columns=self._feature_names)else:returndatadeffit_transform(self,X,y=None):returnself.fit(X).transform(X)defget_feature_names():returnself._feature_names

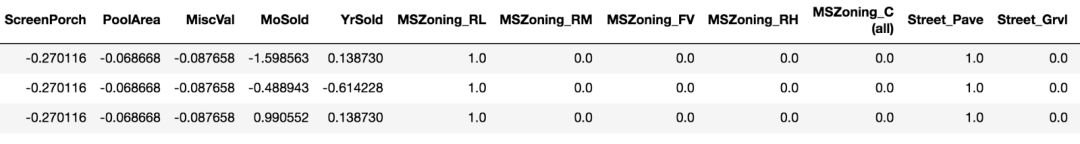

使用基礎轉換器

上面構建的基礎轉換器估算器應該可以像任何其他scikit-learn估算器一樣使用。我們可以將其實例化,然后轉換數據。

>>>bt=BasicTransformer(cat_threshold=3,return_df=True)>>>train_transformed=bt.fit_transform(train)>>>train_transformed.head(3)

DataFrame中數字列和類別列相交處的列

在pipeline中使用轉換器

上文構建的轉換器可以作為流程的一部分。

>>>basic_pipe=Pipeline([('bt',bt),('ridge',Ridge())])>>>basic_pipe.fit(train,y)>>>basic_pipe.score(train,y)0.904

用戶也可以使用它進行交叉驗證,獲得與上面的scikit-learn列轉換器流程相似的分數。

>>>cross_val_score(basic_pipe,train,y,cv=kf).mean()0.816

我們也可以將其用作網格搜索的一部分。事實證明,將低頻字符串排除在外,并沒有明顯改善模型的表現,盡管它可以在其他模型中使用。不過,在最佳評分方面確實有所提高,這可能是由于使用了略微不同的編碼方案。

>>>param_grid={'bt__cat_threshold':[0,1,2,3,5],'ridge__alpha':[.1,1,10,100]}>>>gs=GridSearchCV(p,param_grid,cv=kf)>>>gs.fit(train,y)>>>gs.best_params_{'bt__cat_threshold':0,'ridge__alpha':10}>>>gs.best_score_0.830

使用新的KBinsDiscretizer對數字列進行分裝(bin)和編碼

對于包含年份的一些數字列,將其中的值視為類別列更有意義。 Scikit-Learn推出了新的估算器KBinsDiscretizer來實現這一點。它不僅可以存儲值,還可以對這些值進行編碼。在使用Pandas cut或qcut函數手動完成此這類操作之前,一起來看看它如何處理年份數字列的。

>>>fromsklearn.preprocessingimportKBinsDiscretizer>>>kbd=KBinsDiscretizer(encode='onehot-dense')>>>year_built_transformed=kbd.fit_transform(train[['YearBuilt']])>>>year_built_transformedarray([[0.,0.,0.,0.,1.],[0.,0.,1.,0.,0.],[0.,0.,0.,1.,0.],...,[1.,0.,0.,0.,0.],[0.,1.,0.,0.,0.],[0.,0.,1.,0.,0.]])

在默認設置下,每個bin中都包括相等數量的觀察數據。下面對每列求和來驗證這一點。

>>>year_built_transformed.sum(axis=0)array([292.,274.,307.,266.,321.])

這就是“分位數策略”,用戶可以選擇“統一”模式,為bin邊界劃定相等的空間,也可以選擇“k平均”聚類,自定義bin邊界。

>>>kbd.bin_edges_array([array([1872.,1947.8,1965.,1984.,2003.,2010.])],dtype=object)

使用列轉換器分別處理所有年份列

現在有一個需要單獨處理的列子集,我們可以使用列轉換器來執行此操作。下面的代碼為我們之前的轉換添加了一個步驟。此外還刪除了標識列,只標識出每一行。

>>>year_cols=['YearBuilt','YearRemodAdd','GarageYrBlt','YrSold']>>>not_year=~np.isin(num_cols,year_cols+['Id'])>>>num_cols2=num_cols[not_year]>>>year_si_step=('si',SimpleImputer(strategy='median'))>>>year_kbd_step=('kbd',KBinsDiscretizer(n_bins=5,encode='onehot-dense'))>>>year_steps=[year_si_step,year_kbd_step]>>>year_pipe=Pipeline(year_steps)>>>transformers=[('cat',cat_pipe,cat_cols),('num',num_pipe,num_cols2),('year',year_pipe,year_cols)]>>>ct=ColumnTransformer(transformers=transformers)>>>X=ct.fit_transform(train)>>>X.shape(1460,320)

通過交叉驗證和評分,發現所有這些處理都沒有帶來任何改進。

>>>ml_pipe=Pipeline([('transform',ct),('ridge',Ridge())])>>>cross_val_score(ml_pipe,train,y,cv=kf).mean()0.813

為每列使用不同數量的bin可能會改善我們的結果。盡管如此,KBinsDiscretizer還可以輕松地對數字變量進行分裝。

標題:Scikit-Learn 0.20的更多亮點

本次即將發布的版本附帶了更多新功能。更多詳細信息,請查看文檔的“新增內容”部分。有很多變化哦。

結論

本文介紹了一個新的工作流程,提供了一個基于Pandas進行初步數據探索和準備的Scikit-Learn用戶方案。現在,改進型的新估算器ColumnTransformer,SimpleImputer,OneHotEncoder和KBinsDiscretizer,讓整個數據處理流程變得更加平滑,功能也更加豐富。用戶可以獲取Pandas DataFrame,并對其進行轉換,為機器學習做好準備。

-

機器學習

+關注

關注

66文章

8419瀏覽量

132674 -

數據分析

+關注

關注

2文章

1449瀏覽量

34060

原文標題:AI開發最大升級:Pandas與Scikit-Learn合并,新工作流程更簡單強大!

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

Python機器學習庫談Scikit-learn技術

在PyODPS DataFrame自定義函數中使用pandas、scipy和scikit-learn

迅為RK3399開發板人工智能深度學習框架

如何在移動和嵌入式設備上部署機器學習模型

Python機器學習回歸部分的應用與教程

基于Python的scikit-learn編程實例

詳細解析scikit-learn進行文本分類

基于Pandas進行初步數據探索和準備的Scikit-Learn用戶方案

基于Pandas進行初步數據探索和準備的Scikit-Learn用戶方案

評論