脫離上下文時,每個英文單詞都有多重含義。例如,“bank”可以指銀行或河岸;“Fair”可以指展覽會,也可以指對展覽會的評價;“Duck”可以是躲避傷害的動作,也可以指鴨子。

對于人類來說搞清楚一個單詞在某場景中適用的含義是非常簡單的。但是,對于自然語言處理模型就是另一回事了。

近些年已經出現很多用于解析文本的AI工具,但是當涉及到多重含義的單詞時,這些工具往往會陷入困境。來自艾倫人工智能研究所(Allen Institute for Artificial Intelligence)和華盛頓大學的研究人員正在努力解決這一難題,他們使用了可以根據上下文來確定英文單詞含義的神經網絡。

向前和向后閱讀

通常,NLP模型通過詞向量(在每個單詞中附加語言含義和單詞語法的基礎元素)中的結構化數據進行訓練。此算法基于假設每個單詞只有一種向量表示,但實際上英文單詞并非如此。

研究人員利用名為“ELMo”的神經系統打破了這一假設,此神經系統可以為每個單詞創造出無限數量的向量。

“‘ELMo’是‘Embeddings from Language Models’的縮寫,而不是毛茸茸的紅色芝麻街角色”,論文“Deep contextualized word representations”的第一作者Matthew Peters解釋道。

ELMo喜歡閱讀:這不是美國幼兒教育電視節目《芝麻街》中的Elmo,而是使用雙向語言模型的神經系統ELMo。

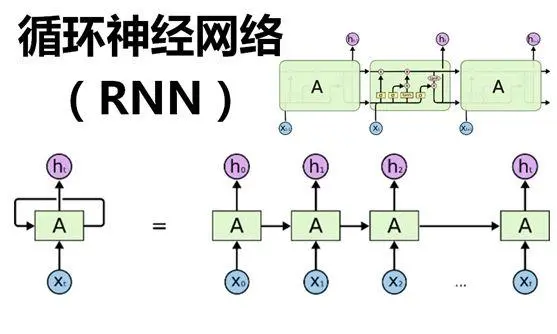

常規語言模型嘗試預測句子中即將出現的下一個單詞。如果片段是“The people sat down on the …,”,那么算法將預測出“bench”或“grass”之類的單詞。為了給單詞附加所有潛在含義的詞向量,這個團隊使用了雙向語言模型。

使用雙向模型意味著,該模型可以通過一個二次的回顧性算法,獲取句子的結尾并嘗試預測出現在句子結尾前邊的單詞。當模型嘗試分析的單詞出現在句首,并且相關上下文隨即出現時,這會非常有用。

“就像‘He lies to his teacher’與‘He lies on the sofa’這種情況”,Peters說道。

為測試ELMo的技能,該團隊利用六種不同的NLP任務(包括情緒分析和問答等)對算法進行測試。與之前使用相同訓練數據的方法相比,ELMo每次都會得到更新、更出色的結果,在某些情況下可以比之前的領先模型提升25%的速度。

“在NLP中,很重要的一點是,單一的方法能夠提高多樣化任務的性能”,Peters指出。

ELMo在半監督式學習領域大放異彩

在進行自然語言處理時,訓練數據的類型非常關鍵。例如,問答系統使用的模型無法在任何舊文本上進行訓練。通常,此類模型需要在由帶標注的問題和答案對組成的大型數據庫中訓練,以學習如何做出正確的回答。

標注數據非常耗時并且成本高昂。因此,研究人員首先選擇使用包含大約十億個單詞的大型無標記學術數據庫來訓練ELMo。然后,針對特定任務(例如問答)將此數據庫調整為一個帶標注的小型數據庫。對于這種結合使用大量無標記數據和一小部分已標記數據的方法,統稱為“半監督式學習”。

減少對已標記和帶標注數據的依賴后,研究人員可以更輕松地在現實問題中應用其NLP模型應用。

“在我們的示例中,我們選擇了一個未標記的學術數據庫來訓練語言模型”,Peters說道。但是研究人員能夠調整算法,以便在任何其他未標記的數據庫中運行該算法,也可以將其應用于生物醫學論文、法律合同或其他語言等專業領域中。

與之前最先進(SOTA)的基準相比,ELMo在六個基準NLP任務中都增強了神經模型的性能。從左到右,這些任務依次是:語義推理、命名實體識別、問題回答、指代消解、語義角色標注和情感分類。

研究人員通過Amazon Web Service,使用NVIDIA Tesla V100和K80 GPU助力訓練和推理。

在后續論文中,研究人員指出其僅使用了幾百個已標記示例,便可應用ELMo模式回答幾何問題。人工需要花費幾個小時便能完成此標記工作,但卻會顯著提高NLP模型的性能。

ELMo已作為開源庫提供。Peters表示其他的NLP研究人員已經將此模型應用到了他們自己的工作中,包括除英語外的其他語言。

-

AI

+關注

關注

87文章

30896瀏覽量

269110 -

模型

+關注

關注

1文章

3244瀏覽量

48842 -

深度學習

+關注

關注

73文章

5503瀏覽量

121170

原文標題:“躲避”or“鴨子”:看深度學習如何解釋多義詞

文章出處:【微信號:NVIDIA_China,微信公眾號:NVIDIA英偉達】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

NPU在深度學習中的應用

AI大模型與深度學習的關系

FPGA做深度學習能走多遠?

深度學習中的時間序列分類方法

深度學習中的無監督學習方法綜述

深度學習在視覺檢測中的應用

深度學習與nlp的區別在哪

深度學習中的模型權重

深度學習常用的Python庫

深度學習與傳統機器學習的對比

深度解析深度學習下的語義SLAM

【技術科普】主流的深度學習模型有哪些?AI開發工程師必備!

“躲避”or“鴨子”:看深度學習如何解釋多義詞

“躲避”or“鴨子”:看深度學習如何解釋多義詞

評論