實時視頻通信質量評價的方法思路并不復雜,其難點一是在于實時通訊通常并沒有參考,其準確度與精度難以達到一個客觀最佳值;二是在于我們并不希望實時通信的計算量過大,應當盡量避免傳統編碼與那些會明顯提升算法復雜度的方法。在介紹完實時視頻通信質量評價的方法研究之后,我將為大家分享如何根據質量模型設計質量甜點算法。

PART1 評價實時視頻通信質量

1.動機

我們能否找到一種可靠的評價視頻通話質量的自動化方法?能否實現對視頻通話端到端質量的實時監控?想必這兩項都是產品上線測試與運營中亟需的衡量標尺。

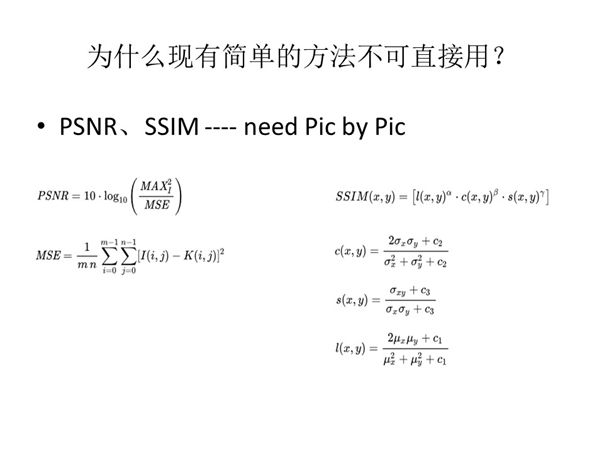

但我們并不能將現有的簡單方法直接用于評價實時視頻通信質量,首先是因為傳統方法中比較常用的 PSNR、SSIM需要參考圖像用以比較并且每一幀都要計算,這對實時視頻通信來說計算量較大;其次,傳統方法僅考慮空間維度的質量而未考慮時間維度的質量,實時視頻通信還需重點考慮到時間間緯度的質量,即低延遲和流暢度。

當然,從2008年到2017年陸陸續續有改進方法被提出,如PEVQ、VQuad-HD、VMAF等,雖然相對于之前的方法有所進步,但由于這些方法需要全參考,其背后龐大的計算量并不適用于實時視頻通訊。

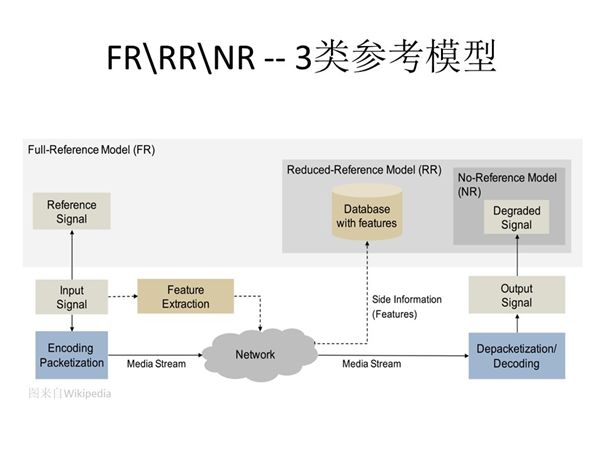

視頻質量評價模型有以下三種:全參考、半參考、無參考。考慮到運營系統中可以獲取部分參考信息,我們主要選用了半參考模型。半參考模型雖然不需要獲取原始視頻作為對比,但也可獲取原始視頻中的一些編碼和網絡信息特征作為對比如QP、PSNR、RTT等。

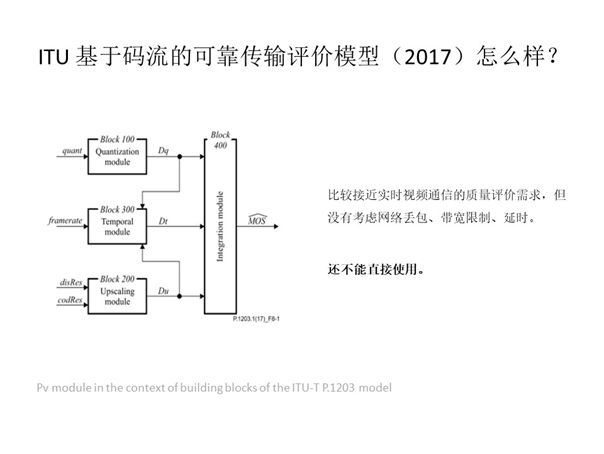

至于ITU在2017年提出的基于碼流的傳輸評價模型,可以說與我們的需求較為貼近。此類模型原理可總結為輸入所需特征值并通過訓練模型輸出結果,但此方法輸入的特征值并不包括實時視頻通訊中容易出現的網絡丟包、延時、帶寬限制等影響因素,并不適用于實時視頻通訊。

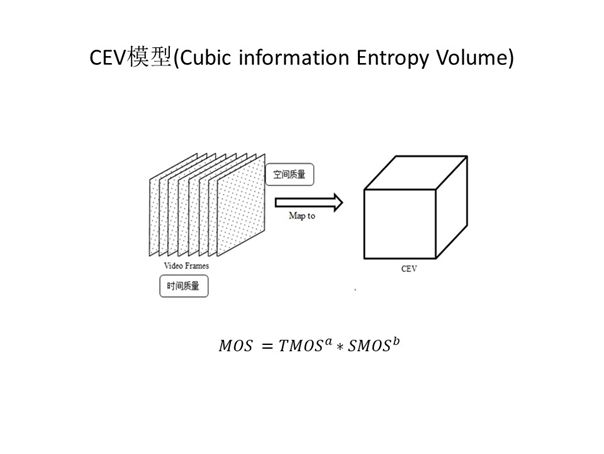

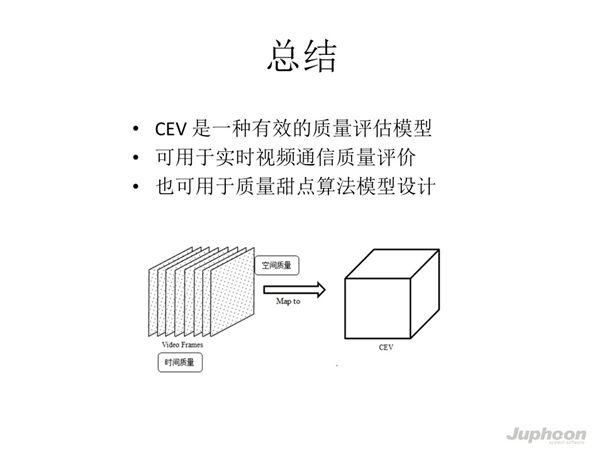

綜上所述,為了實現符合要求的評價實時視頻通信質量方法,我們根據自身需求提出了一種涵蓋時間質量與空間質量兩個維度的全新質量模型CEV。實時視頻通訊的質量由時間質量與空間質量共同決定二者缺一不可,時間質量包括流暢度、延時等確保視頻流暢播放的指標,空間質量包括清晰度等確保畫面觀感的指標。

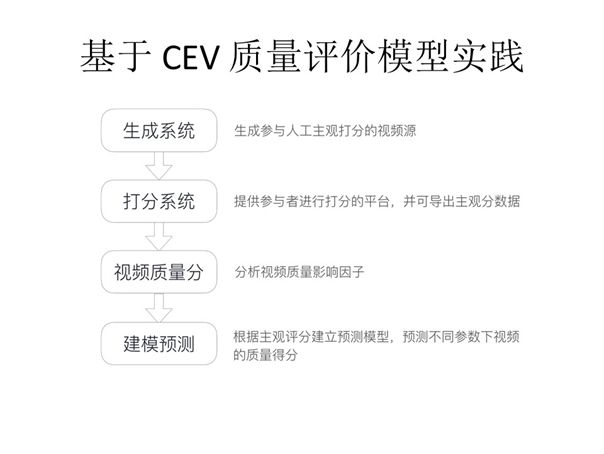

2.基于CEV質量評價模型的實踐

我們基于CEV質量評價模型的實踐主要分為以下四步驟:

生成系統

主要用于生成參與人工主觀打分的視頻源。

打分系統

由于主觀MOS分質量評價是一個黃金標準,此項標準需要人工主觀打分進行統計,我們需要大量的人工評估數據才能讓質量評價算法標準具有良好匹配度。通過建立的打分系統,我們收集參與者的打分結果并導出主觀分數據用于接下來的分析。

視頻質量分

基于打分系統得到的人工主觀分數據我們分析影響視頻質量的多項因子。

建模預測

根據主觀評分建立預測模型并預測不同參數下視頻的質量得分。

2.1 生成系統

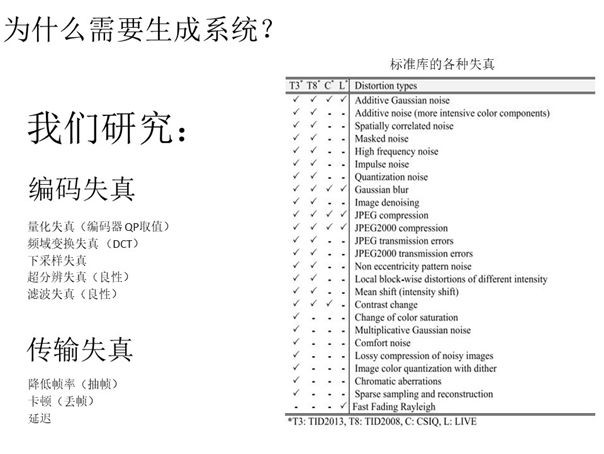

我們的研究主要針對于實時視頻通信,著重于研究編碼失真與傳輸失真。雖然在標準庫中有很多失真類型如高頻噪聲、高斯模糊、壓縮失真等等,但對不適用于實時視頻的質量評價。在編碼失真方面我們的研究主要圍繞量化失真、頻域變換失真(DCT)、下采樣失真、良性超分辨率失真與良性濾波失真展開;在傳輸失真方面則主要圍繞降低幀率(抽幀)、卡幀丟幀與延遲展開。

雖然失真類型復雜多樣,但我們的研究主要針對傳輸失真與編碼失真,并未著重考慮如高斯模糊或偏移失真等其他失真類型。基于此前提我們積累了900個視頻失真試例,其中600個為傳輸失真;并讓35人參與實驗,得到生成系統的實驗數據。

如果將我們的實驗數據與公共數據集進行對比,可以看到我們的數據量處在第三名左右的位置。

在生成系統中,系統會首先分析視頻源并依據其在時間與空間復雜度上的不同將視頻進行分類,按照分辨率等指標整理得到無損視頻序列;隨后系統會對其中部分視頻進行模擬丟包、編碼器失真等操作從而生成一定數量的低質量視頻;最后再將這些低質量視頻與原始視頻混合推送至實驗端進行打分操作。

2.2 眾包打分系統

實驗端是簡易的Web頁面,參與者通過Web端觀看視頻并打分,以便接下來的影響因子分析。

影響因子分析主要會從時間質量與空間質量兩大方面全面衡量影響視頻通信質量的因素。在時間質量方面,除了時間戳,系統會著重分析視頻延時RTT與流暢性(幀速率、卡頓時間)。一般的直播系統,流暢性較易達成而低延時無法完全保證,而實時性則是實時視頻通訊之根本。所以,一般的實時系統為了保證嚴苛的實時性體驗會犧牲一部分畫面質量與流暢性。在空間質量方面,系統會重點考量顯示分辨率、編碼分辨率、編碼量化參數等。帶寬資源是否充足會對空間質量產生顯著影響,而量化損失分析主要通過記錄QP編碼的量化參數實現,SSIM/PSNR則是在計算資源允許的條件下得到空間質量。

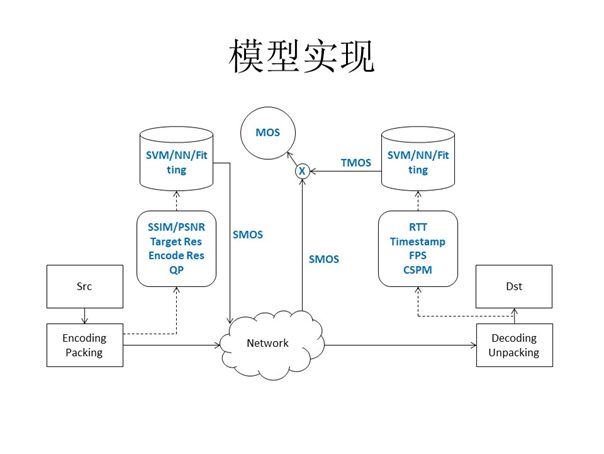

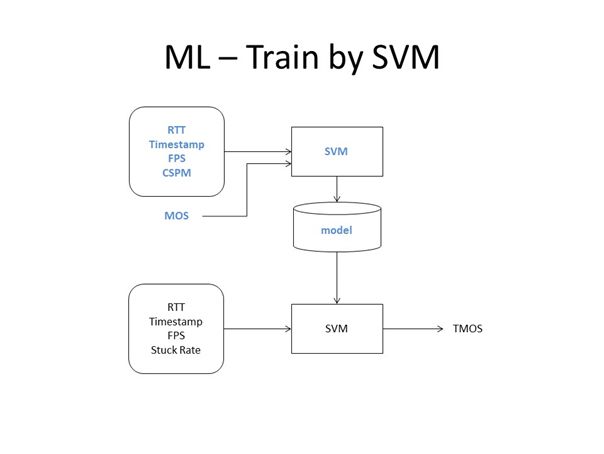

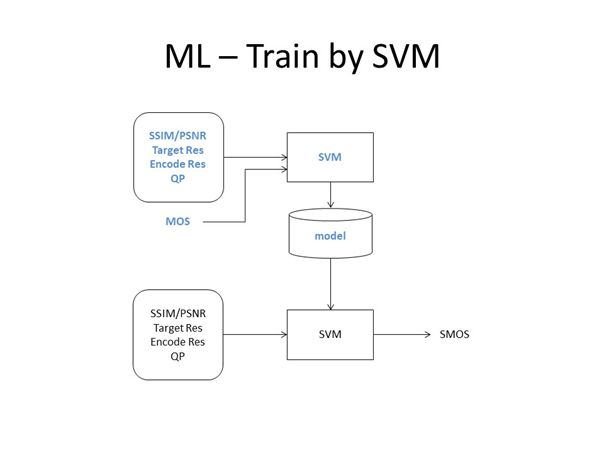

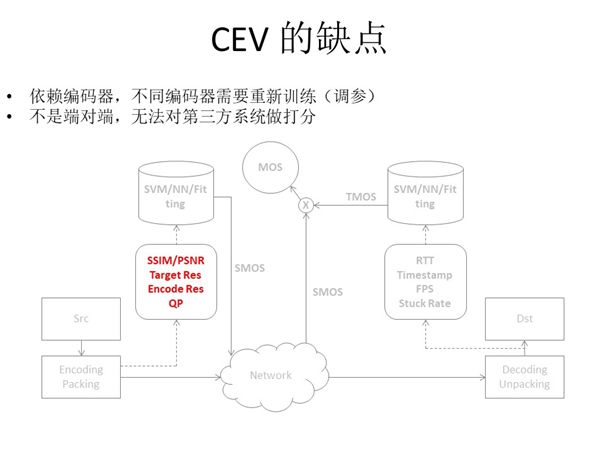

于是我們實現了前文提到的半參考模型在影響因子分析上的運用。位于上圖右側的TMOS分是對時間質量的量化,其所需要的RTT、Timestamp、FPS、CSPM等參數主要來源于解碼端;左側的SMOS分是對空間質量的量化,其所需要的SSIM/PSNR、分辨率、QP等參數主要來源于編碼端。此模型主要的功能便是將來自解碼端與編碼端的數據整合分析最終生成一個整體模型,這些數據都會經過SVM/NN(神經網絡)/Fitting的處理得到相應的時間質量/空間質量評價值,用以實現對視頻通信質量的估計。

分析時間質量TMOS

在分析時間質量TMOS時,我們會優先采取擬合模型處理RTT、Play Timestamp、Frame rate、CSPM,原因是我們希望用最小的代價快速得到最有價值的數據。

1)回歸預測

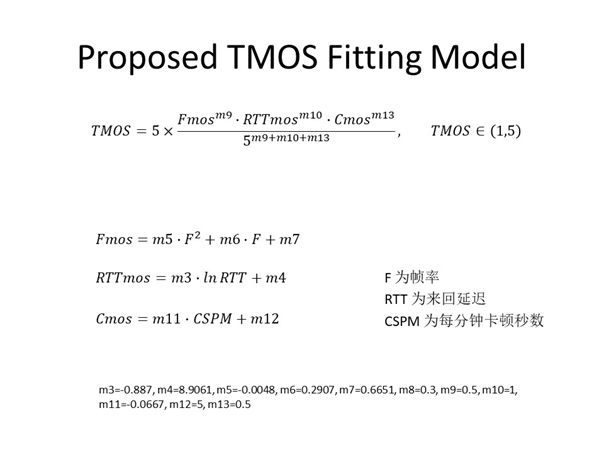

最佳策略便是僅將所有變量代入一個公式就可直接得到TMOS,我們使用圖中的公式對Fmos、RTTmos、Cmos等進行擬合,公式中的m9、m10、m13等等代表的就是這些擬合參數,此公式利用梯度下降法訓練,將這些實際評測出的數據進行均方差最小(損失函數)的擬合,即可得到這個公式的一系列參數。

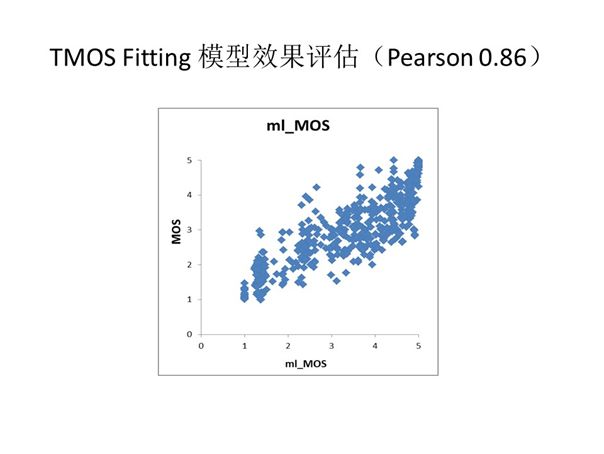

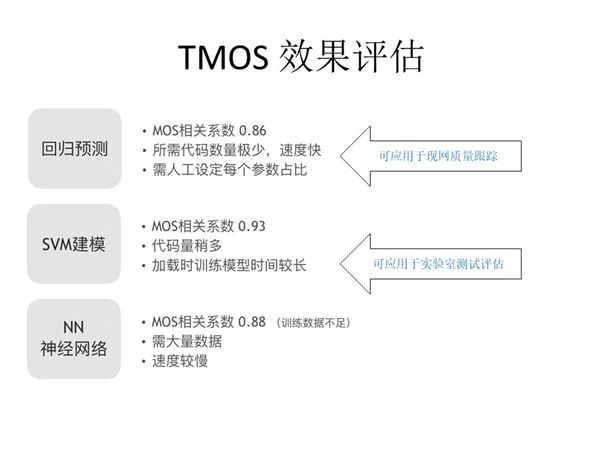

我們會選取其中70%的數據用于訓練,30%的數據用于測試并得出相關系數,上圖展示的是便是我們的一個測試集得出的相關系數為0.86。

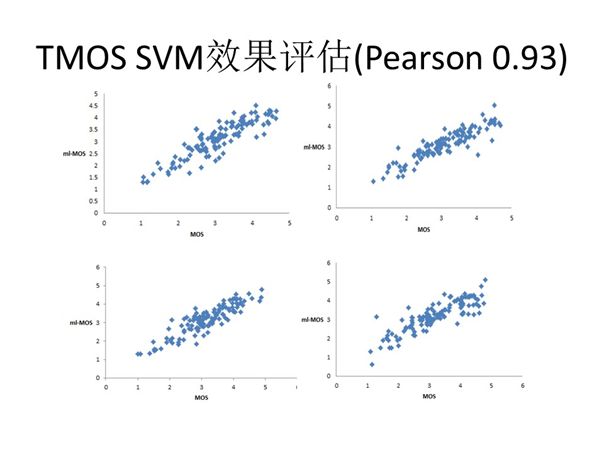

2)SVM建模

除了上述實踐,我們還使用了SVM方法訓練系統。SVM的意義在于可將原本難以量化的時間戳引入公式作為參數的一部分影響最終的評估結果,使用SVM后相同測試集得到的相關系數由原來的0.86變為0.93,精度進一步提升。

3)NN神經網絡

除了回歸預測與SVM建模,神經網絡也能為提升MOS分的精度帶來幫助,前提是需要足夠的訓練數據規模。在實踐中我們使用了七至八層的深度網絡,也嘗試了兩至三層的淺度網絡,測試得到的最高相關系數為0.88,比不上SVM建模優化后的0.93,其原因可能是訓練的數據量不夠,具體原因還需要進一步分析。因此,最終我們選擇了可用于現網質量跟蹤的回歸預測與可用于實驗室測試評估的SVM建模優化TMOS時間質量分析模型。

分析空間質量SMOS

1)回歸預測

分析空間質量首先需要評估PSNR/SSIM指標。

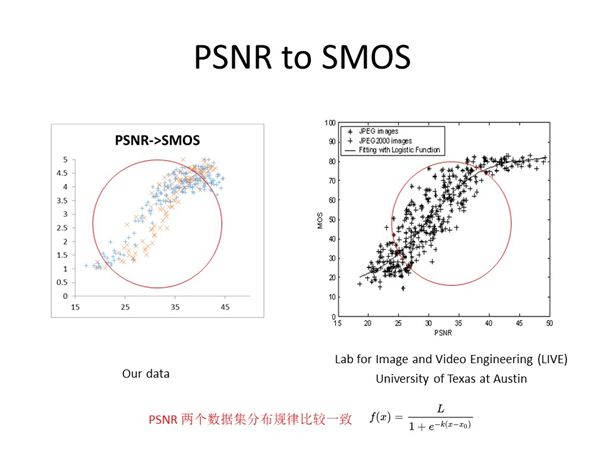

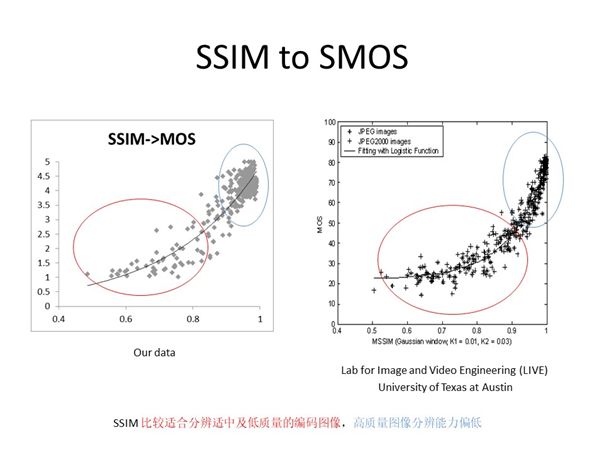

上面兩張圖的左側分別表示我們經過測試得到的PSNR/SSIM數據集分布規律,右側表示互聯網上公開的PSNR/SSIM數據集分布規律,可以看到二者大致相同。

如果討論具體的量化指標,上圖展示的是SMOS的幾個實用數據。我們可以看到當PSNR為30時SMOS分為3.00。

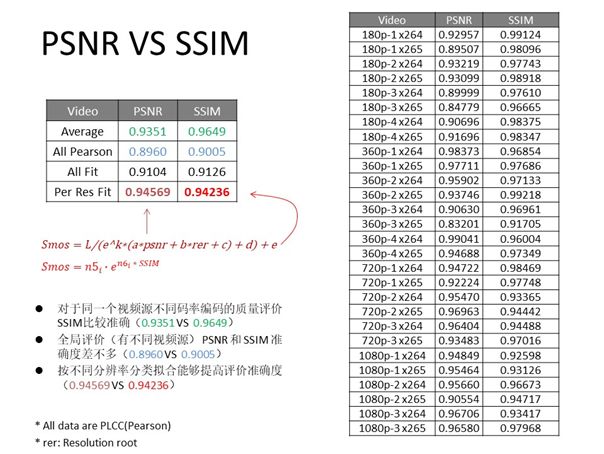

根據上圖數據進一步分析PSNR與SSIM,我們發現即使在有些場景下SSIM并不準確,但處理同一個視頻源不同碼率編碼的相對質量評價SSIM還是較為準確的,而面對有不同視頻源的全局評價時PSNR與SSIM勢均力敵,準確度相似;因此,我們可以對同一個視頻按照不同分辨率比較來分類擬合提高評價準確度,比如對于不同分辨率的視頻基于PSNR/SSIM估計質量值的相關度只有0.89,而對于相同尺寸同類型的視頻基于PSNR/SSIM估計質量值其相關度可達到0.93~0.96。對于不同分辨率的視頻,集合越大其準確度越低;而對于同一類視頻其預測準確度較高。

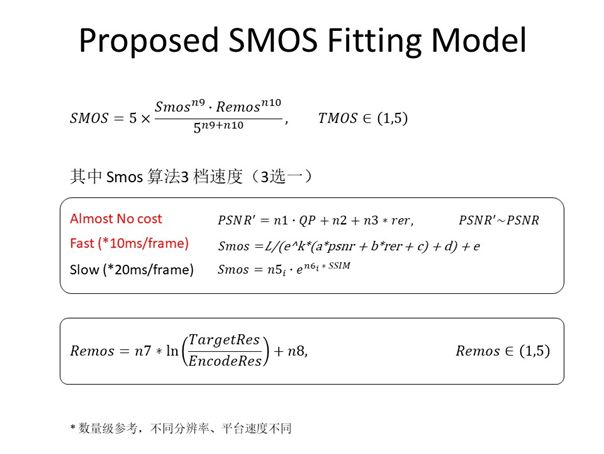

同樣,空間質量分析也存在一個擬合模型,主要分為編碼質量損失與下采樣質量損失。上圖公式中 代表編碼質量損失, 代表下采樣質量損失,我們建議以下三種預測方法:方法一是直接通過QP預測,這是幾乎沒有任何代價的方法;方法二是通過PSNR預測,此方法計算量較大,一般會采取10幀取1幀或一秒一幀的方式預測;方法三是通過SSIM預測,但這種方法的處理速度最為緩慢但精度最高。我們需要根據PSNR/SSIM MOS分曲線的走向選用不同的擬合公式,需要強調的是,方法一可直接在編碼或解碼端實現,而方法二、三必須在編碼端完成計算后才能將得到的數據發送給解碼端,單純解碼端無法實現。

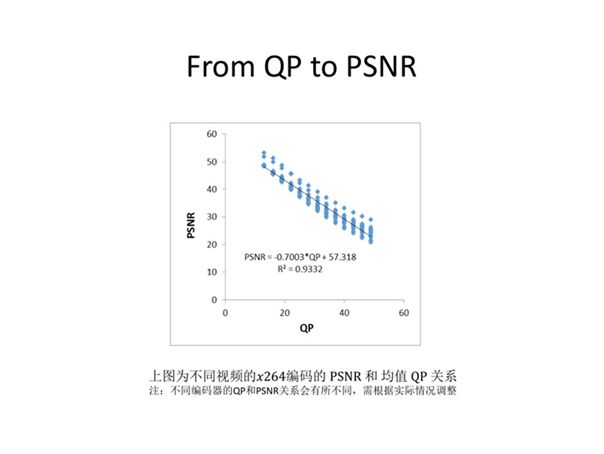

上圖較為清晰地展示了H.264下QP與PSNR的關系,可以看到QP與視頻空間質量呈現明顯的線性負相關關系,QP越大視頻空間質量越低。

2)SVM建模

與時間質量分析的思路類似,我們也可以借助SVM建模優化空間質量分析。

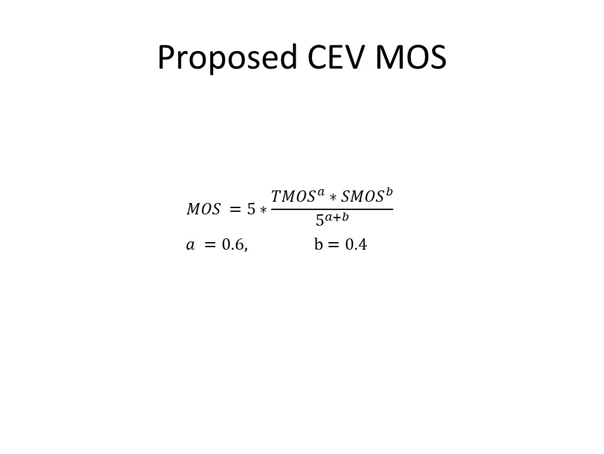

在分別得到空間模式與時間模式對應的MOS分后,我們就可計算總的MOS分。這里的a、b兩個參數可以根據應用場景需求做出一些變化:如果此應用場景對流暢度要求較高那么我們就可以適當增大a的值(權重),如果此應用場景對清晰度要求更高則適當增大b的值(權重)。

2.3 現網與實驗室應用

將此分析工具運用于現網的實時通話質量統計,我們可以看到隨著版本的升級,計算得到的MOS分也在增加,反應出版本迭代帶來的實時視頻通話質量的提升或下降。

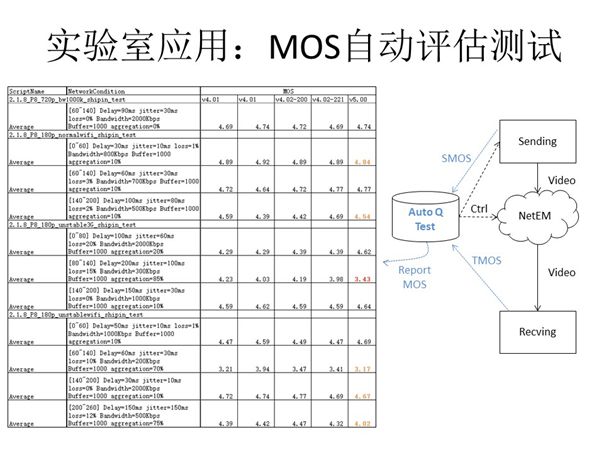

將此分析工具運用于實驗室等理想環境,根據上圖左側表格展示的自動化測試統計結果我們可以看到,設置網絡條件千變萬化(延時30毫秒,抖動10毫秒等等),系統能較為準確且自動計算出相應MOS分。右側展示的就是與此實驗相關的拓撲結構,其中NetEM代表網絡模擬器。

2.4 CEV缺點

當然,CEV也存在一定局限性。首先就是非端對端的,CEV現在僅能作為我們內部的測試方案而未實現端對端,這就導致我們無法用此方法評估對比微信、FaceTime等第三方應用場景的實時視頻質量。其次就是由于CEV依賴編碼器,面對不同編碼器(如VP8、VP9在QP取值范圍上存在不一致)需要重新訓練并調整參數,由此造成的工作量無疑是巨大的。

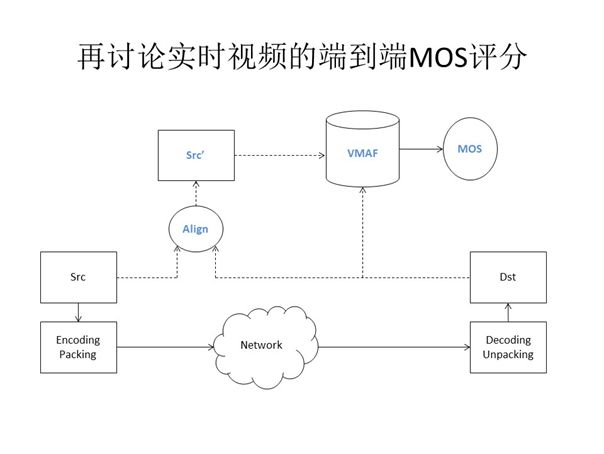

2.5 端到端MOS評分

那么我們如何實現實時視頻的端到端MOS評分,達成對第三方平臺的評估與對比?下一步的計劃就是使用“增強版“的VMAF。所謂增強版就是,VMAF存在原始參考視頻與目標視頻對齊的要求,那么我們可通過在輸入VMAF之前進行對齊操作,從而實現實時視頻的端到端MOS評分。

PART2 根據質量模型設計質量甜點算法

1.動機

在構建CEV質量評估模型后我們繼續探索,能否將此模型用于尋找基于感知編碼的視頻質量甜點?之前的試驗并不涉及編碼過程,那么我們能否更進一步,將其用于優化對編碼的使用?

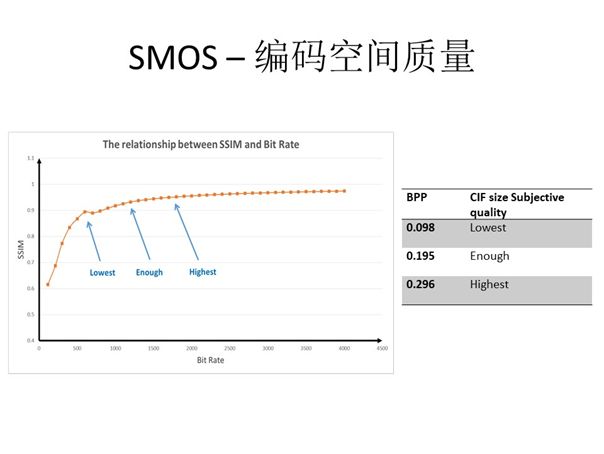

從概念上來說編碼也存在時間質量與空間質量。首先就空間質量而言,在我們常見的質量與碼率曲線上二者呈正相關關系且并非直線,其曲線上存在三個值得我們關注的點:第一個點是圖中的Lowest也就是質量明顯下降的點,表明在碼率超過此點瞬間視頻質量會出現一陣快速衰減,我們將此點定義為保底碼率;第二個點位于圖中指示的Highest,表示在此點后視頻質量幾乎不會隨碼率出現明顯提升;而中間的Enough點所示就是我們的建議碼率。考慮到不同分辨率與幀率的情況,(那我們把它再規劃到BPP,就是Bit Per Pixel,即每個像素壓縮以后,需要的占用的位數。)

在空間質量指標中影響編碼的主要有影響幀間參考的幀率與影響幀內參考的分辨率。針對這種情況我們對幀率與分辨率進行了調整:幀率的調整在于隨著幀率增高,維持同樣質量需要增加的碼率就相應降低且基本遵循測試得到的線性關系;分辨率的調整在于隨著分辨率的增高,維持同樣質量所需碼率的也相應降低。這兩點很容易理解:隨著分辨率的提升,幀內參考信息越多壓縮率則增高;而在相同質量下幀率越高,前后幀的相關性越強,每幀的變化越小那么壓縮率也隨之增高,碼率的的提升與質量的提升呈現log函數的關系特點。

2. 思路:規模法則

我們使用杰弗里·韋斯特法則明確規定規律,有些情景是線性,也有部分情景是超線性或亞線性的。

根據數據我們可得到分辨率與質量的關系描述,但一般多為亞性關系。為了更好地研究相關參數,我們提供了這樣一個公式:

應用規模法則我們可以得到,公式中x的取值為1.5~3,x越大則編碼器越適合高分辨率。

3. Openh264編碼舉例

我們以Openh264編碼作為示例,由圖表我們可以看到隨著分辨率的提高維持相同質量所需要的BPP不斷下降,這符合我們之前對這個法則規律的期待。

除了編碼空間質量SMOS,我們還需要衡量編碼時間質量TMOS。之前提到的無論是SMOS還是TMOS其本質都是通過一些數據的訓練擬合得到的數值,這里提到的編碼時間質量也不例外,從曲線當中我們可以看到當幀率在7FPS以下時時間質量已經不符合我們的要求了。需要強調的是,無論是時間質量還是空間質量都是基于主觀感受確定的。一旦超過25FPS也就是人眼視覺暫留原理的閾值那么繼續提升幀率對質量的影響微乎其微了。由于在這里我們不考慮丟包、延時等額外變量,時間質量的問題比較容易解決。

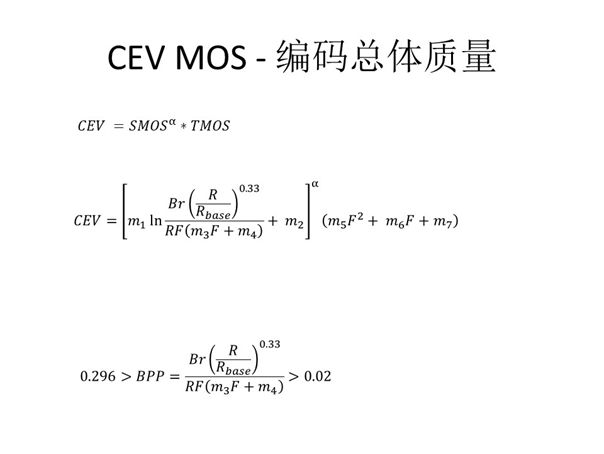

在得到了SMOS與TMOS之后,我們就可結合二者數值得到一個類似于“立方體”的模型,其公式如圖所示,CEV由時間質量與空間質量共同決定。需要強調的是為保證質量符合實際需求,這里存在一項約束條件:BPP須大于0.02且小于0.296。

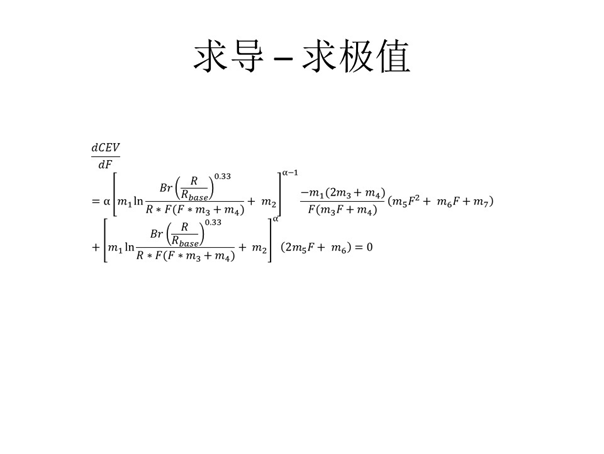

仔細觀察不難看出CEV是一個凸函數,如果可用帶寬確定,對方訂閱的視頻大小確定,那么我們需要得到最佳幀率是多少?我們對幀率求導,得到上圖所示公式。若求導結果為0相當于“立方體”體積最大化,此時就是最佳幀率。

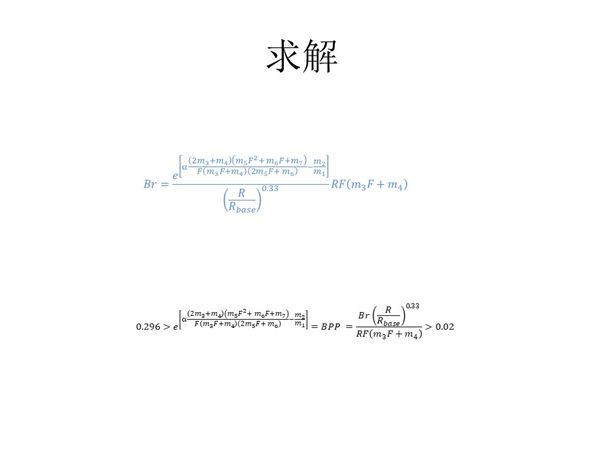

對公式進行簡化與求導即可計算碼率值,再使用約束公式即可求解最終結果。

最終我們得到了由分辨率與幀率兩項變量組成的關系式,根據此公式可算出給定碼率下分辨率與幀率之間的關系,將其圖像畫出我們可以看到最頂端代表最佳值。這里需要解釋的是,在實際應用中相同復雜度的視頻得出值可能較為近似,我們得到的是時間與空間復雜度的平均狀況。但是,若視頻復雜度較低則幀率可提高,反之幀率應當下降,這里需要根據復雜度做動態調整,視頻復雜度可以以特定碼率下的量化參數來估計,相同碼率下QP越大復雜度就越高。

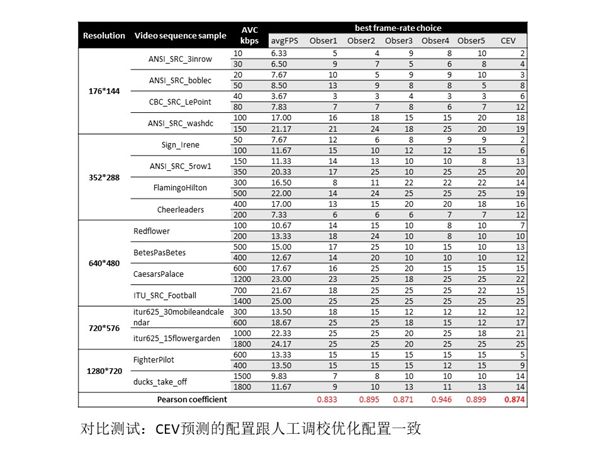

繼續反向驗證此模型,讓五位參與者對不同分辨率進行測試,最終我們得到的相關系數為0.87,結果符合我們的預期,可以說我們成功將視頻通話質量模型應用到編碼參數的自動化優化。

通過CEV模型,我們可在實現評估實時視頻通訊質量的同時確定視頻通訊的質量甜點,希望算法背后的思路能為大家帶來幫助,謝謝。

-

Web

+關注

關注

2文章

1263瀏覽量

69485 -

模型

+關注

關注

1文章

3244瀏覽量

48844

原文標題:CEV模型與質量甜點算法設計

文章出處:【微信號:livevideostack,微信公眾號:LiveVideoStack】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

TMS320VC5509A PGE IBIS Model DSP IBIS行為模型的詳細資料概述

TMS320VC5510 GGW IBIS Model DSP IBIS行為模型的詳細資料概述

TMS320C5501 GZZ IBIS ModelDSP行為模型的詳細資料概述

TMS320C5504 ZCH IBIS Model DSP行為模型的詳細資料概述

TMS320VC5507 GHH BSDL Model DSP邊界掃描模型的詳細資料概述

TMS320C5515 ZCH BSDL Model DSP邊界掃描模型的詳細資料概述

如何設計CEV模型與質量甜點算法詳細資料概述

如何設計CEV模型與質量甜點算法詳細資料概述

評論