醫學影像人工智能協作平臺,基于NVIDIA GPU Cloud (NGC) 的遠程醫學影像診斷平臺,使高精度遠程診療成為現實,幫助逐步實現醫療資源均衡化。

“互聯網+醫學影像”AI助推實現醫療資源均衡化

目前,我國公共醫療資源分配不均,大型醫院醫療資源緊張,同時小型醫院醫療資源又未得到充分發揮。分級診療是醫療資源均衡化的一個突破口,通過整合醫療服務的需求入口,使各級醫療服務機構能夠更好地發揮自身價值,提高醫療體系的整體服務效率。

在就診過程中,醫學影像結論有著重要的作用,而AI 輔助影像診斷可以有效地提升醫療資源運轉效率;此外,醫學影像極具互聯網基因,在人工智能提升醫療能力的過程中,將首先推進實現分級診療。

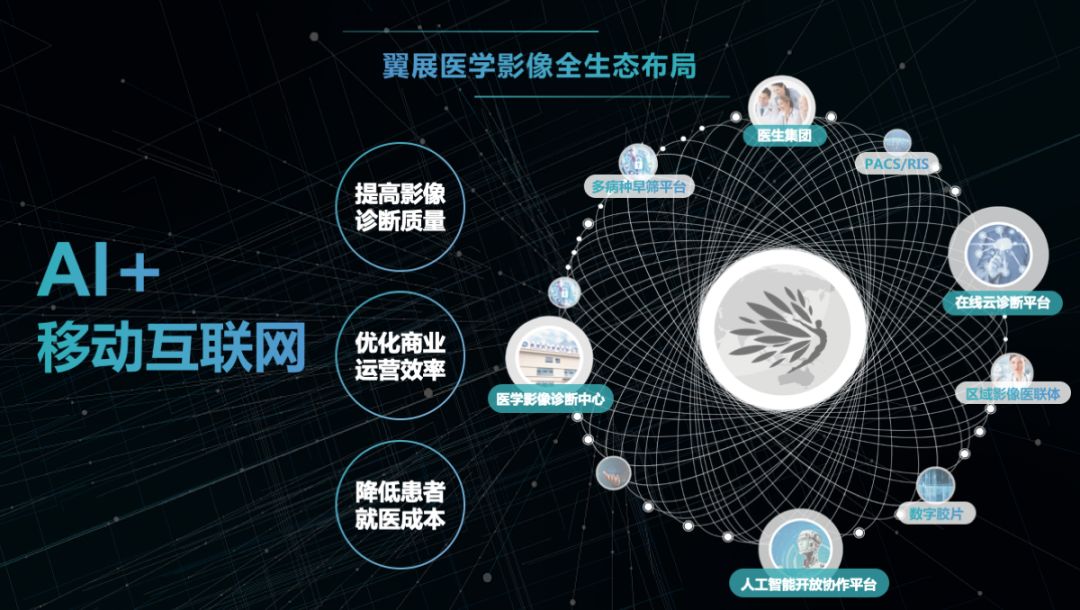

翼展醫療集團是一家提供智慧醫學影像解決方案的專業醫療機構,同時也是一家專注于醫學影像人工智能應用研發的高科技企業。翼展醫療集團通過建立人工智能開放協作平臺、在線云診斷平臺、翼展醫學影像診斷中心、影像醫生集團、多病種早篩中心,打造了行業獨有的多維生態進化體系,使高精度遠程診療成為現實,逐步幫助醫療資源均衡化。借助NVIDIA GPU Cloud (NGC),翼展醫療集團解決了其在平臺建立之初遭遇的深度學習團隊機時分配困難和平臺兼容性較差等問題,使其平臺變得更加靈活,且具備強大的兼容性,能夠易于部署及運維人工智能應用產品。

從平臺建立到運維 翼展遭遇重重挑戰

為了更好地落地AI產品,貼近臨床,翼展醫療集團打造了人工智能開放協作平臺,為人工智能企業和創業團隊提供人工智能產品的發布和搭建平臺,在云診斷平臺集成各病種AI診斷工具,主要分為高端篩查及專項篩查兩個方向;同時,通過建立人工智能開放協作平臺、在線云診斷平臺、翼展醫學影像診斷中心、影像醫生集團、多病種早篩中心,打造了行業獨有的多維生態進化體系,為人工智能產品提供了充足的落地應用場景,使其更加貼近臨床,更好地服務于醫生和患者,使高精度遠程診療成為現實,逐步幫助醫療資源均衡化。

然而,在平臺搭建之初,翼展醫療集團遭遇了諸多挑戰。

從頭搭建機器學習平臺——費時費力

2016年,翼展開始進行醫學影像人工智能應用的研發。由于當時公有云廠商能夠提供GPU實例的還非常少,于是翼展選擇自行采購硬件設備搭建服務器。其首先配置了一臺雙卡工作站,按照網上教程一步步安裝ubuntu,NVIDIA GPU驅動程序,CUDA,cuDNN,但最后編譯Caffe的時候發現庫版本不對,只能從頭配置,花費了一周左右的時間才開始正式訓練模型。之后,翼展升級了服務器,采用由第三方廠商配置好操作系統和底層驅動的8卡服務器,但隨著內部團隊成員的增加,新的問題又隨之而來。

機器學習團隊需求各不同,機時分配遇窘境

起初,翼展團隊中只有一名專職深度學習專家,可以在雙卡工作站做小批量數據預訓練,然后在服務器上做大規模訓練,本地和遠程環境可以設置成一樣的。但隨著團隊成員的增加,就開始需要分配訓練機時了。由于每個人的項目不同,使用的模型不同,底層依賴的深度學習框架及庫版本也不同,一個統一的完全沒有隔離的環境越來越不能滿足日常訓練的要求。曾經出現過的事故是,有模型需要將Python版本升級,升級之后導致其他人的模型無法正常工作。

翼展采取了嚴格的規章制度,劃分用戶空間,每個人需要的 Python執行環境、深度學習框架及第三方庫都自行安裝在各自的用戶空間。對于GPU驅動程序及CUDA等底層庫,則只能由管理員來進行安裝和升級。升級前還須要做好兼容性測試,一旦不同用戶的模型有沖突便難以解決。后來隨著開始租用公有云的GPU實例,情況得到了一定程度的好轉,不過在公有云上安裝配置環境依然費時費力。

深度學習模型多種多樣,平臺難以招架

2017年,翼展開始布局人工智能開放協作平臺,為人工智能企業和創業團隊提供醫學影像人工智能產品發布和運行平臺。該平臺需要接入不同廠商的產品,有的產品是通過API接入,后臺深度學習模型的運行環境由廠商自行維護;有的則是廠商直接將模型發布給翼展,由其提供運行時環境,并且模型的迭代速度很快,新版本模型底層依賴版本也會相應變化,每次升級的操作都不只是簡單地部署一個新模型,還需要同時將運行時環境一并升級,而且工程團隊通常至少需要同時維護一套測試環境和生產環境。雖然當時工程團隊已經采用了DevOps,有了Docker的運維經驗,但是管理GPU云上實例及各種機器學習框架不同版本仍然是一個巨大的挑戰——直到NGC的出現。

“2017年翼展開始布局醫學影像人工智能開放協作平臺后,我們需要部署的機器學習應用越來越多,手工方式的落后管理必然要被工程化管理所取代。雖然這個時候工程團隊已經擁抱DevOps,有了Docker的運維經驗,不過管理 GPU云上實例及各種機器學習框架不同版本仍然是一個噩夢…直到NGC的出現。”

--- 邊海鋒 翼展醫療集團 CTO

“NGC提供流行常用的第三方兼容GPU、符合NGC標準和最佳實踐的高性能計算應用容器,使用戶可以方便的在最短的時間內啟動和運行起來。這正是我們一直在尋找的東西。看到這個介紹的吋候,我們第一時間在NGC網站進行了注冊,并且很快在自己的服務器上pull了一個NGC容器試用,發現真的非常簡單。”

--- 謝鋒波 翼展醫療集團 高級研發總監

NGC帶來簡單高效的解決方案

NVIDIA GPU Cloud (NGC)是針對深度學習和科學計算優化的基于GPU加速的云平臺。在當前的發行版本中,NGC包含了NGC容器,NGC容器注冊,NGC網站,以及用以運行深度學習容器的平臺軟件。

NGC容器旨在提供一個軟件平臺,該平臺基于最小的操作系統要求、安裝在服務器或工作站上Docker和驅動,通過NGC容器注冊里的NGC容器提供所有的應用程序和SDK軟件。

NGC管理著一份目錄,包含了完全集成和優化的深度學習框架容器,適用于單GPU以及多GPU配置環境。這些容器包括:CUDA工具包,DIGITS工作流,以及以下深度學習框架:NVCaffe, Caffe2, Microsoft Cognitive Toolkit (CNTK), MXNet, PyTorch, TensorFlow, Theano 和 Torch。這些框架容器以開箱即可用的方式交付,包含了所有必須的依賴,比如CUDA運行時環境、 NVIDIA庫和運行系統環境。每個框架容器鏡像還包含了框架源代碼,以支持用戶自定義修改和增強功能,以及完整的軟件開發棧。

NGC也提供流行常用的第三方兼容GPU、符合NGC標準和最佳實踐的高性能計算應用容器,使用戶可以方便的在最短的時間內啟動和運行起來。基于NGC,工程師們能夠快速啟動應用開發程序,使應用程序盡早開始運行,減少了通常與設置軟件相關的復雜性以往需要幾周的工作,現在幾分鐘就可以解決。

NVIDIA每月對這些深度學習的容器進行更新,以確保提供最佳性能。在深度學習框架容器的基礎上,NGC也提供了一系列高性能計算可視化應用容器,采用支持業界領先的可視化工具,包括集成了NVIDIA Index 立體渲染的ParaView, NVIDIA OptiX 光線追蹤庫和NVIDIA Holodeck,以實現高質量可交互的實時視覺效果。

NGC既可以在自建服務器上使用,也可以在其他公有云上使用。如今有新的合作伙伴加入申請機器學習訓練環境,或者新的項目要啟動,亦或新的模型要部署,翼展醫療集團的運維工程師只需對方告知其深度學習框架的版本,然后在NGC網站找到對應的鏡像,運行一個docker pull命令,然后就可以悠閑的去喝杯咖啡了。

翼展醫療集團如今正在做的事情,是利用NGC的自定義容器功能,將自研的深度學習應用發布為 NVIDIA-docker鏡像,這樣可以進一步簡化應用部署,同時可以與工程團隊其他項目共用一套持續集成及運維的流程。

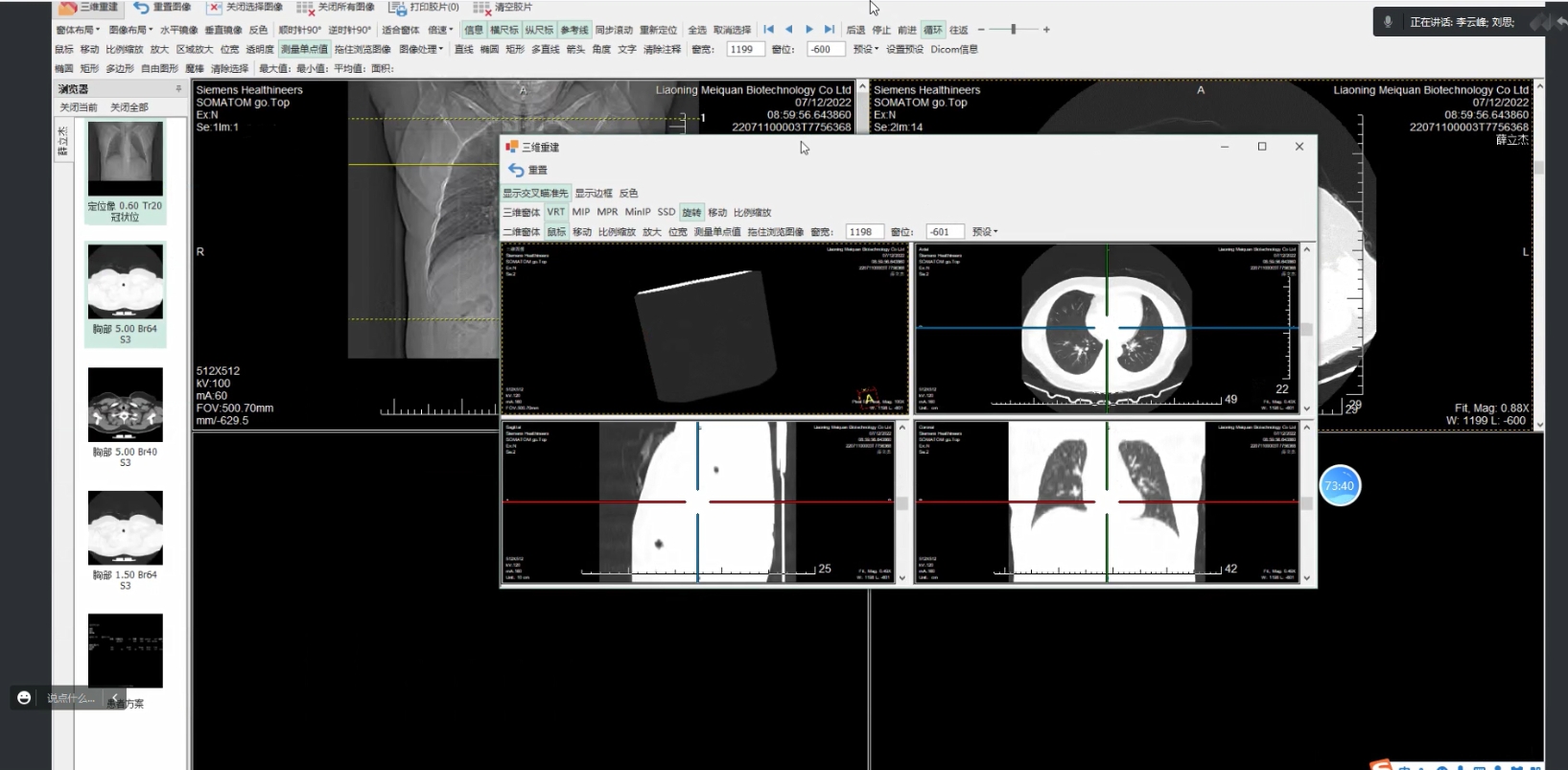

目前翼展的醫學影像人工智能協作平臺已上線十余種人工智能產品,包括用于血管壁分割及斑塊成分分析的磁共振斑塊成像解決方案、CT下肺結節篩查、DR胸肺常見疾病篩查、DR智能報告自動生成系統等,為合作醫院及各類醫療機構提供了有力的支撐,促進診斷能力提升。

-

互聯網

+關注

關注

54文章

11177瀏覽量

103555 -

人工智能

+關注

關注

1792文章

47514瀏覽量

239229 -

機器學習

+關注

關注

66文章

8428瀏覽量

132841

原文標題:NGC賦能翼展醫療“互聯網+醫學影像”新平臺,助推醫療資源均衡化

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

云互聯網是什么意思

NVIDIA助力西門子醫療加速醫學影像AI部署

東軟發布新一代醫學影像解決方案

圖像識別技術在醫療領域的應用

esp8266已連接到Wifi但無法連接到互聯網,為什么?

工業互聯網平臺中什么是關鍵

利用NVIDIA的nvJPEG2000庫分析DICOM醫學影像的解碼功能

AI醫學影像企業深智透醫完成B+輪近千萬美元融資

工業互聯網和ERP的關系

醫療設備IPv6化是數字化醫療發展的必然選擇

“AI+工業互聯網”賦能新型工業化的路徑分析

西門子醫療與山東第一醫科大學放射學院達成戰略合作

“互聯網+醫學影像”AI助推實現醫療資源均衡化

“互聯網+醫學影像”AI助推實現醫療資源均衡化

評論