無監督學習是一種用于在數據中查找模式的機器學習技術。無監督算法給出的數據不帶標記,只給出輸入變量(X),沒有相應的輸出變量。在無監督學習中,算法自己去發現數據中有趣的結構。

人工智能研究總監嚴樂群解釋說,非監督學習教學機器能夠自主學習,而不需要被明確告知它們所做的一切是對是錯,這是實現真正人工智能的關鍵。

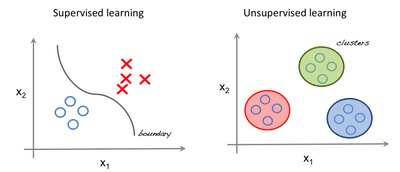

監督與無監督學習

在監督學習中,系統試圖從前面給出的例子中學習。(另一方面,在無監督學習中,系統試圖直接從給出的例子中找到模式。)如果數據集被標記,它就會遇到監督問題,如果數據集沒有標記,那么它就是一個監督問題。

SRC

左邊的圖像是監督學習的一個例子;我們使用回歸技術來尋找特征之間的最佳匹配線。而在無監督學習中,輸入是基于特征分離的,預測是基于它所屬的集群。

重要術語

特性:用于預測的輸入變量。

預測:當提供一個輸入示例時,模型s的輸出。

示例:數據集的一行。示例包含一個或多個特性,可能還有一個標簽。

標簽:特性的結果。

為無監督學習準備數據

在本文中,我們使用Iris數據集進行第一次預測。該數據集包含一組150條記錄,包含5個屬性:花瓣長度、花瓣寬度、萼片長度、萼片寬度和類別。蝴蝶花,蝴蝶花和花色蝴蝶花是三個等級。對于我們的無監督算法,我們給出虹膜花的這四個特征,并預測它屬于哪一類。

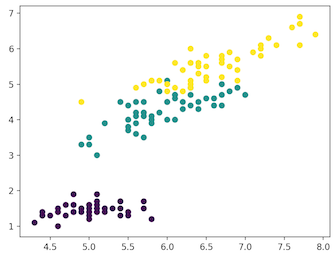

我們使用Python中的sklearn庫加載Iris數據集,使用matplotlib實現數據可視化。下面是用于研究數據集的代碼片段。

# Importing Modules from sklearn import datasets import matplotlib.pyplot as plt # Loading dataset iris_df = datasets.load_iris() # Available methods on dataset print(dir(iris_df)) # Features print(iris_df.feature_names) # Targets print(iris_df.target) # Target Names print(iris_df.target_names) label = {0: 'red', 1: 'blue', 2: 'green'} # Dataset Slicing x_axis = iris_df.data[:, 0] # Sepal Length y_axis = iris_df.data[:, 2] # Sepal Width # Plotting plt.scatter(x_axis, y_axis, c=iris_df.target) plt.show()

['DESCR','data','feature_names','target','target_names'] ['sepal length(cm)','sepal width(cm)','petal length(cm)','petal width(厘米)']

[0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2]

['setosa''versicolor''virginica']

紫羅蘭:瀨戶草,綠色:雜色,黃色:弗吉尼亞

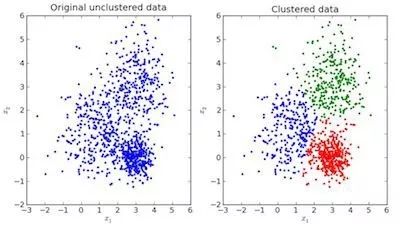

在上面的圖像中,左邊的圖像是未分類的原始數據,右邊的圖像是聚類的(根據數據的特征進行分類)。當給定一個要預測的輸入時,它會根據它的特性檢查它所屬的集群,然后進行預測。

Python中的K-Means聚類

K均值是一種迭代聚類算法,其目標是在每次迭代中尋找局部最大值。選擇初始所需的集群數量。因為我們知道有3個類,所以我們編寫算法將數據分組到3個類中,方法是將參數n個集群傳遞到KMeans模型中。現在隨機將三個點(輸入)分配到三個集群中。根據每個點之間的質心距離,下一個給定的輸入被分離成受尊重的集群。現在,重新計算所有集群的質心。

集群的每個質心是定義結果組的特征值的集合。質心特征權值的檢驗可以定性地解釋每個聚類所代表的組的類型。

從sklearn庫中導入KMeans模型,進行特征擬合和預測。

K是Python中的實現。

# Importing Modules from sklearn import datasets from sklearn.cluster import KMeans # Loading dataset iris_df = datasets.load_iris() # Declaring Model model = KMeans(n_clusters=3) # Fitting Model model.fit(iris_df.data) # Predicitng a single input predicted_label = model.predict([[7.2, 3.5, 0.8, 1.6]]) # Prediction on the entire data all_predictions = model.predict(iris_df.data) # Printing Predictions print(predicted_label) print(all_predictions)

[0] [0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 2 2 1 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 1 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 1 2 1 1 1 1 2 1 1 1 1 1 2 2 1 1 1 1 2 1 1 2 1 1 2 2 1 1 1 1 2 1 1 1 1 2 1 1 1 2 1 1 1 2 1 1 2]

分層聚類

分層聚類,顧名思義,是一種構建集群層次結構的算法。該算法首先將所有數據分配給自己的集群。然后將兩個最近的集群連接到同一個集群中。最后,當只剩下一個集群時,該算法就結束了。

利用樹狀圖可以顯示層次聚類的完成情況。現在讓我們看一個谷物數據分層聚類的例子。數據集可以在這里找到。

Python中的分層集群實現。

# Importing Modules from scipy.cluster.hierarchy import linkage, dendrogram import matplotlib.pyplot as plt import pandas as pd # Reading the DataFrame seeds_df = pd.read_csv( "https://raw.githubusercontent.com/vihar/unsupervised-learning-with-python/master/seeds-less-rows.csv") # Remove the grain species from the DataFrame, save for later varieties = list(seeds_df.pop('grain_variety')) # Extract the measurements as a NumPy array samples = seeds_df.values """ Perform hierarchical clustering on samples using the linkage() function with the method='complete' keyword argument. Assign the result to mergings. """ mergings = linkage(samples, method='complete') """ Plot a dendrogram using the dendrogram() function on mergings, specifying the keyword arguments labels=varieties, leaf_rotation=90, and leaf_font_size=6. """ dendrogram(mergings, labels=varieties, leaf_rotation=90, leaf_font_size=6, ) plt.show()

K均值和分層聚類之間的差異

層次聚類不能很好地處理大數據,K表示聚類可以。這是因為K均值的時間復雜度是線性的,即O(n),而層次聚類的時間復雜度是二次的,即O(n2)。

在K均值聚類中,當我們從任意選擇的聚類開始時,多次運行該算法生成的結果可能會有所不同。而結果在層次聚類中是可重復的。

當星系團的形狀是超球形(如二維的圓形,三維的球形)時,發現K 代表工作良好。

K-Means不允許有噪聲的數據,而在分層中我們可以直接使用有噪聲的數據集進行聚類。

t-SNE聚類

它是一種無監督的可視化學習方法。t-SNE代表t分布隨機鄰居嵌入。它將高維空間映射到可以可視化的二維或三維空間。具體地說,它通過一個二維或三維點對每個高維物體進行建模,其方法是用附近的點對相似的物體建模,用高概率的遠點對不同的物體建模。

Python中Iris數據集的t-SNE聚類實現。

# Importing Modules from sklearn import datasets from sklearn.manifold import TSNE import matplotlib.pyplot as plt # Loading dataset iris_df = datasets.load_iris() # Defining Model model = TSNE(learning_rate=100) # Fitting Model transformed = model.fit_transform(iris_df.data) # Plotting 2d t-Sne x_axis = transformed[:, 0] y_axis = transformed[:, 1] plt.scatter(x_axis, y_axis, c=iris_df.target) plt.show()

紫色:Setosa,綠色:Versicolor,黃色:Virginica

這里,由于Iris數據集具有四個特征(4d),將其轉換成二維圖表示。類似地,t-SNE模型可以應用于具有n個特征的數據集。

DBSCAN群集

DBSCAN(基于密度的噪聲應用空間聚類)是一種常用的聚類算法,用于替代預測分析中的k均值。它不需要您輸入集群的數量才能運行。但作為交換,您必須調優其他兩個參數。

scikit-learn實現為eps和min示例參數提供了默認值,但是通常需要對它們進行調優。eps參數是在同一個鄰域內需要考慮的兩個數據點之間的最大距離。最小樣本參數是一個鄰域內被認為是一個集群的數據點的最小數量。

-

機器學習

+關注

關注

66文章

8418瀏覽量

132635 -

python

+關注

關注

56文章

4797瀏覽量

84689

原文標題:使用Python進行無監督學習

文章出處:【微信號:gh_ecbcc3b6eabf,微信公眾號:人工智能和機器人研究院】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

使用Python進行串口通信的案例

時空引導下的時間序列自監督學習框架

如何幫助孩子高效學習Python:開源硬件實踐是最優選擇

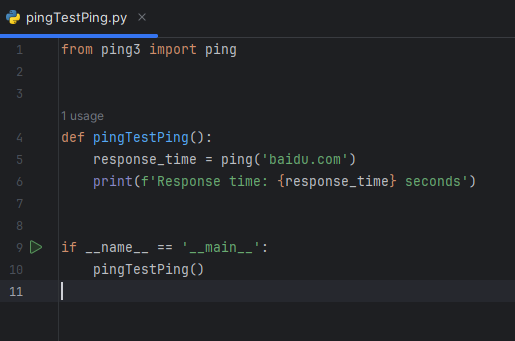

使用Python進行Ping測試

如何用Python進行無監督學習

如何用Python進行無監督學習

評論