定義為記憶力。 算法可以復(fù)制這種模式嗎?神經(jīng)網(wǎng)絡(luò)(NN)是最先被想到的技術(shù)。但令人遺憾的是傳統(tǒng)的神經(jīng)網(wǎng)絡(luò)還無法做到這一點。 舉個例子,如果讓傳統(tǒng)的神經(jīng)網(wǎng)絡(luò)預(yù)測一個視頻中接下來會發(fā)生什么,它很難有精確的結(jié)果。 這就是循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)發(fā)揮作用的

2020-12-10 17:10:30 1539

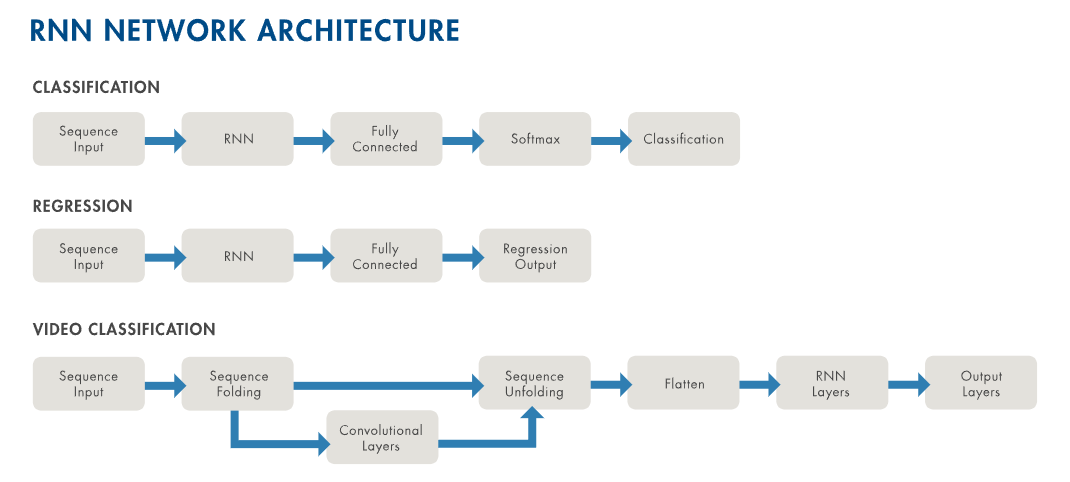

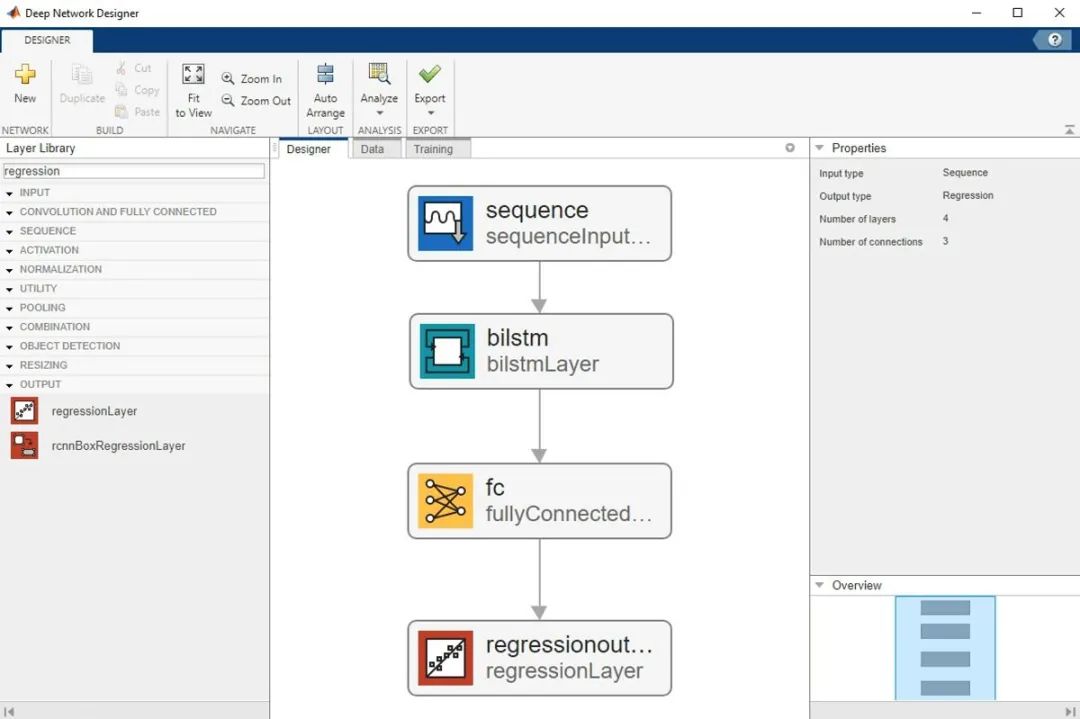

1539 RNN(循環(huán)神經(jīng)網(wǎng)絡(luò))是一種強大的深度學(xué)習(xí)模型,經(jīng)常被用于時間序列預(yù)測。RNN通過在時間上展開神經(jīng)網(wǎng)絡(luò),將歷史信息傳遞到未來,從而能夠處理時間序列數(shù)據(jù)中的時序依賴性和動態(tài)變化。

2023-06-16 16:15:59 1085

1085

神經(jīng)網(wǎng)絡(luò)50例

2012-11-28 16:49:56

神經(jīng)網(wǎng)絡(luò)Matlab程序

2009-09-15 12:52:24

大家有知道labview中神經(jīng)網(wǎng)絡(luò)和SVM的工具包是哪個嗎?求分享一下,有做這方面的朋友也可以交流一下,大家共同進步

2017-10-13 11:41:43

神經(jīng)網(wǎng)絡(luò)基本介紹

2018-01-04 13:41:23

第1章 概述 1.1 人工神經(jīng)網(wǎng)絡(luò)研究與發(fā)展 1.2 生物神經(jīng)元 1.3 人工神經(jīng)網(wǎng)絡(luò)的構(gòu)成 第2章人工神經(jīng)網(wǎng)絡(luò)基本模型 2.1 MP模型 2.2 感知器模型 2.3 自適應(yīng)線性

2012-03-20 11:32:43

將神經(jīng)網(wǎng)絡(luò)移植到STM32最近在做的一個項目需要用到網(wǎng)絡(luò)進行擬合,并且將擬合得到的結(jié)果用作控制,就在想能不能直接在單片機上做神經(jīng)網(wǎng)絡(luò)計算,這樣就可以實時計算,不依賴于上位機。所以要解決的主要是兩個

2022-01-11 06:20:53

神經(jīng)網(wǎng)絡(luò)簡介

2012-08-05 21:01:08

基于深度學(xué)習(xí)的神經(jīng)網(wǎng)絡(luò)算法

2019-05-16 17:25:05

MATLAB神經(jīng)網(wǎng)絡(luò)

2013-07-08 15:17:13

Matlab神經(jīng)網(wǎng)絡(luò)工具箱是什么?Matlab神經(jīng)網(wǎng)絡(luò)工具箱在同步中的應(yīng)用有哪些?

2021-04-26 06:42:29

請問:我在用labview做BP神經(jīng)網(wǎng)絡(luò)實現(xiàn)故障診斷,在NI官網(wǎng)找到了機器學(xué)習(xí)工具包(MLT),但是里面沒有關(guān)于這部分VI的幫助文檔,對于”BP神經(jīng)網(wǎng)絡(luò)分類“這個范例有很多不懂的地方,比如

2017-02-22 16:08:08

習(xí)神經(jīng)神經(jīng)網(wǎng)絡(luò),對于神經(jīng)網(wǎng)絡(luò)的實現(xiàn)是如何一直沒有具體實現(xiàn)一下:現(xiàn)看到一個簡單的神經(jīng)網(wǎng)絡(luò)模型用于訓(xùn)練的輸入數(shù)據(jù):對應(yīng)的輸出數(shù)據(jù):我們這里設(shè)置:1:節(jié)點個數(shù)設(shè)置:輸入層、隱層、輸出層的節(jié)點

2021-08-18 07:25:21

原文鏈接:http://tecdat.cn/?p=6585本文介紹了用于渦輪槳距角控制的永磁同步發(fā)電機(PMSG)和高性能在線訓(xùn)練遞歸神經(jīng)網(wǎng)絡(luò)(RNN)的混合模糊滑模損失最小化控制的設(shè)計。反向傳播學(xué)

2021-07-12 07:55:17

前言前面我們通過notebook,完成了在PYNQ-Z2開發(fā)板上編寫并運行python程序。我們的最終目的是基于神經(jīng)網(wǎng)絡(luò),完成手寫的數(shù)字識別。在這之前,有必要講一下神經(jīng)網(wǎng)絡(luò)的基本概念和工作原理。何為

2019-03-03 22:10:19

今天學(xué)習(xí)了兩個神經(jīng)網(wǎng)絡(luò),分別是自適應(yīng)諧振(ART)神經(jīng)網(wǎng)絡(luò)與自組織映射(SOM)神經(jīng)網(wǎng)絡(luò)。整體感覺不是很難,只不過一些最基礎(chǔ)的概念容易理解不清。首先ART神經(jīng)網(wǎng)絡(luò)是競爭學(xué)習(xí)的一個代表,競爭型學(xué)習(xí)

2019-07-21 04:30:00

傳播的,不會回流),區(qū)別于循環(huán)神經(jīng)網(wǎng)絡(luò)RNN。BP算法(Back Propagation):誤差反向傳播算法,用于更新網(wǎng)絡(luò)中的權(quán)重。BP神經(jīng)網(wǎng)絡(luò)思想:表面上:1. 數(shù)據(jù)信息的前向傳播,從輸入層到隱含層

2019-07-21 04:00:00

人工神經(jīng)網(wǎng)絡(luò)是根據(jù)人的認(rèn)識過程而開發(fā)出的一種算法。假如我們現(xiàn)在只有一些輸入和相應(yīng)的輸出,而對如何由輸入得到輸出的機理并不清楚,那么我們可以把輸入與輸出之間的未知過程看成是一個“網(wǎng)絡(luò)”,通過不斷地給

2008-06-19 14:40:42

人工神經(jīng)網(wǎng)絡(luò)(Artificial Neural Network,ANN)是一種類似生物神經(jīng)網(wǎng)絡(luò)的信息處理結(jié)構(gòu),它的提出是為了解決一些非線性,非平穩(wěn),復(fù)雜的實際問題。那有哪些辦法能實現(xiàn)人工神經(jīng)網(wǎng)絡(luò)呢?

2019-08-01 08:06:21

人工神經(jīng)網(wǎng)絡(luò)課件

2016-06-19 10:15:48

簡單理解LSTM神經(jīng)網(wǎng)絡(luò)

2021-01-28 07:16:57

圖卷積神經(jīng)網(wǎng)絡(luò)

2019-08-20 12:05:29

優(yōu)化神經(jīng)網(wǎng)絡(luò)訓(xùn)練方法有哪些?

2022-09-06 09:52:36

全連接神經(jīng)網(wǎng)絡(luò)和卷積神經(jīng)網(wǎng)絡(luò)的區(qū)別

2019-06-06 14:21:42

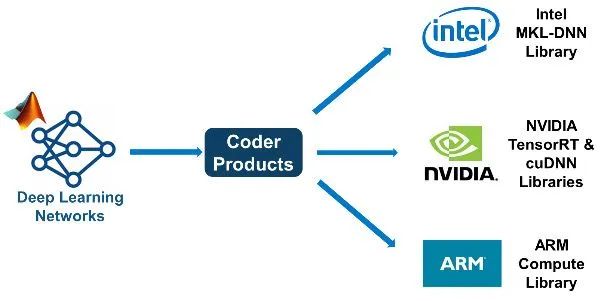

以前的神經(jīng)網(wǎng)絡(luò)幾乎都是部署在云端(服務(wù)器上),設(shè)備端采集到數(shù)據(jù)通過網(wǎng)絡(luò)發(fā)送給服務(wù)器做inference(推理),結(jié)果再通過網(wǎng)絡(luò)返回給設(shè)備端。如今越來越多的神經(jīng)網(wǎng)絡(luò)部署在嵌入式設(shè)備端上,即

2021-12-23 06:16:40

卷積神經(jīng)網(wǎng)絡(luò)為什么適合圖像處理?

2022-09-08 10:23:10

卷積神經(jīng)網(wǎng)絡(luò)(CNN)究竟是什么,鑒于神經(jīng)網(wǎng)絡(luò)在工程上經(jīng)歷了曲折的歷史,您為什么還會在意它呢? 對于這些非常中肯的問題,我們似乎可以給出相對簡明的答案。

2019-07-17 07:21:50

卷積神經(jīng)網(wǎng)絡(luò)模型發(fā)展及應(yīng)用轉(zhuǎn)載****地址:http://fcst.ceaj.org/CN/abstract/abstract2521.shtml深度學(xué)習(xí)是機器學(xué)習(xí)和人工智能研究的最新趨勢,作為一個

2022-08-02 10:39:39

卷積神經(jīng)網(wǎng)絡(luò)的優(yōu)點

2020-05-05 18:12:50

卷積神經(jīng)網(wǎng)絡(luò)的層級結(jié)構(gòu) 卷積神經(jīng)網(wǎng)絡(luò)的常用框架

2020-12-29 06:16:44

什么是卷積神經(jīng)網(wǎng)絡(luò)?ImageNet-2010網(wǎng)絡(luò)結(jié)構(gòu)是如何構(gòu)成的?有哪些基本參數(shù)?

2021-06-17 11:48:22

反饋神經(jīng)網(wǎng)絡(luò)算法

2020-04-28 08:36:58

卷積運算,從而發(fā)現(xiàn)這種關(guān)聯(lián)性。● 循環(huán)神經(jīng)網(wǎng)絡(luò) (RNN)RNN 在很多序列建模任務(wù)中都展現(xiàn)出了出色的性能,特別是在語音識別、語言建模和翻譯中。RNN 不僅能夠發(fā)現(xiàn)輸入信號之間的時域關(guān)系,還能使用“門控

2021-07-26 09:46:37

為提升識別準(zhǔn)確率,采用改進神經(jīng)網(wǎng)絡(luò),通過Mnist數(shù)據(jù)集進行訓(xùn)練。整體處理過程分為兩步:圖像預(yù)處理和改進神經(jīng)網(wǎng)絡(luò)推理。圖像預(yù)處理主要根據(jù)圖像的特征,將數(shù)據(jù)處理成規(guī)范的格式,而改進神經(jīng)網(wǎng)絡(luò)推理主要用于輸出結(jié)果。 整個過程分為兩個步驟:圖像預(yù)處理和神經(jīng)網(wǎng)絡(luò)推理。需要提前安裝Tengine框架,

2021-12-23 08:07:33

最近在學(xué)習(xí)電機的智能控制,上周學(xué)習(xí)了基于單神經(jīng)元的PID控制,這周研究基于BP神經(jīng)網(wǎng)絡(luò)的PID控制。神經(jīng)網(wǎng)絡(luò)具有任意非線性表達能力,可以通過對系統(tǒng)性能的學(xué)習(xí)來實現(xiàn)具有最佳組合的PID控制。利用BP

2021-09-07 07:43:47

基于BP神經(jīng)網(wǎng)絡(luò)的辨識

2018-01-04 13:37:27

FPGA實現(xiàn)神經(jīng)網(wǎng)絡(luò)關(guān)鍵問題分析基于FPGA的ANN實現(xiàn)方法基于FPGA的神經(jīng)網(wǎng)絡(luò)的性能評估及局限性

2021-04-30 06:58:13

基于RBF神經(jīng)網(wǎng)絡(luò)的辨識

2018-01-04 13:38:52

如何用stm32cube.ai簡化人工神經(jīng)網(wǎng)絡(luò)映射?如何使用stm32cube.ai部署神經(jīng)網(wǎng)絡(luò)?

2021-10-11 08:05:42

原文鏈接:http://tecdat.cn/?p=5725 神經(jīng)網(wǎng)絡(luò)是一種基于現(xiàn)有數(shù)據(jù)創(chuàng)建預(yù)測的計算系統(tǒng)。如何構(gòu)建神經(jīng)網(wǎng)絡(luò)?神經(jīng)網(wǎng)絡(luò)包括:輸入層:根據(jù)現(xiàn)有數(shù)據(jù)獲取輸入的層隱藏層:使用反向傳播優(yōu)化輸入變量權(quán)重的層,以提高模型的預(yù)測能力輸出層:基于輸入和隱藏層的數(shù)據(jù)輸出預(yù)測

2021-07-12 08:02:11

神經(jīng)網(wǎng)絡(luò)(Neural Networks)是人工神經(jīng)網(wǎng)絡(luò)(Ar-tificial Neural Networks)的簡稱,是當(dāng)前的研究熱點之一。人腦在接受視覺感官傳來的大量圖像信息后,能迅速做出反應(yīng)

2019-08-08 06:11:30

, Depthwise 深度 卷積層, RNN 循環(huán)神經(jīng)網(wǎng)絡(luò),LSTM 神經(jīng)網(wǎng)絡(luò)和各類矩陣乘法、圖像卷積等常見 的 MAC 運算密集型算法,支 持 Max/Min/Average Pooling

2020-12-07 17:05:00

譯者|VincentLee來源 |曉飛的算法工程筆記脈沖神經(jīng)網(wǎng)絡(luò)(Spiking neural network, SNN)將脈沖神經(jīng)元作為計算單...

2021-07-26 06:23:59

有提供編寫神經(jīng)網(wǎng)絡(luò)預(yù)測程序服務(wù)的嗎?

2011-12-10 13:50:46

求助地震波神經(jīng)網(wǎng)絡(luò)程序,共同交流!!

2013-05-11 08:14:19

小女子做基于labview的蒸發(fā)過程中液位的控制,想使用神經(jīng)網(wǎng)絡(luò)pid控制,請問這個控制方法可以嗎?有誰會神經(jīng)網(wǎng)絡(luò)pid控制么。。。叩謝

2016-09-23 13:43:16

求助大神 小的現(xiàn)在有個難題: 一組車重實時數(shù)據(jù) 對應(yīng)一個車重的最終數(shù)值(一個一維數(shù)組輸入對應(yīng)輸出一個數(shù)值) 這其中可能經(jīng)過均值、方差、去掉N個最大值、、、等等的計算 我的目的就是弄清楚這個中間計算過程 最近實在想不出什么好辦法就打算試試神經(jīng)網(wǎng)絡(luò) 請教大神用什么神經(jīng)網(wǎng)絡(luò)好求神經(jīng)網(wǎng)絡(luò)程序

2016-07-14 13:35:44

求高手,基于labview的BP神經(jīng)網(wǎng)絡(luò)算法的實現(xiàn)過程,最好有程序哈,謝謝!!

2012-12-10 14:55:50

多層感知機 深度神經(jīng)網(wǎng)絡(luò)in collaboration with Hsu Chung Chuan, Lin Min Htoo, and Quah Jia Yong. 與許忠傳,林敏濤和華佳勇合作

2021-07-12 06:35:22

最簡單的神經(jīng)網(wǎng)絡(luò)

2019-09-11 11:57:36

脈沖耦合神經(jīng)網(wǎng)絡(luò)(PCNN)在FPGA上的實現(xiàn),實現(xiàn)數(shù)據(jù)分類功能,有報酬。QQ470345140.

2013-08-25 09:57:14

我在matlab中訓(xùn)練好了一個神經(jīng)網(wǎng)絡(luò)模型,想在labview中調(diào)用,請問應(yīng)該怎么做呢?或者labview有自己的神經(jīng)網(wǎng)絡(luò)工具包嗎?

2018-07-05 17:32:32

為什么要用卷積神經(jīng)網(wǎng)絡(luò)?

2020-06-13 13:11:39

本文介紹了用于渦輪槳距角控制的永磁同步發(fā)電機(PMSG)和高性能在線訓(xùn)練遞歸神經(jīng)網(wǎng)絡(luò)(RNN)的混合模糊滑模損失最小化控制的設(shè)計。反向傳播學(xué)習(xí)算法用于調(diào)節(jié)RNN控制器。PMSG速度使用低于額定速度

2021-07-12 06:46:57

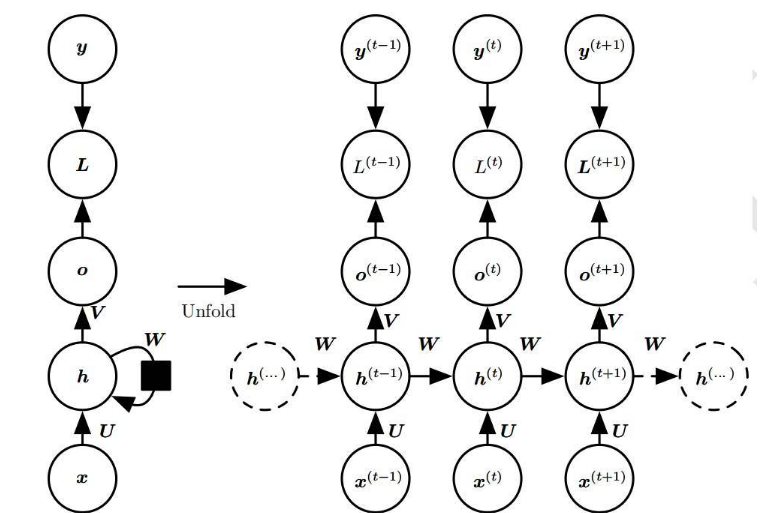

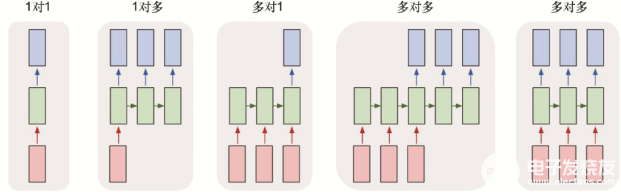

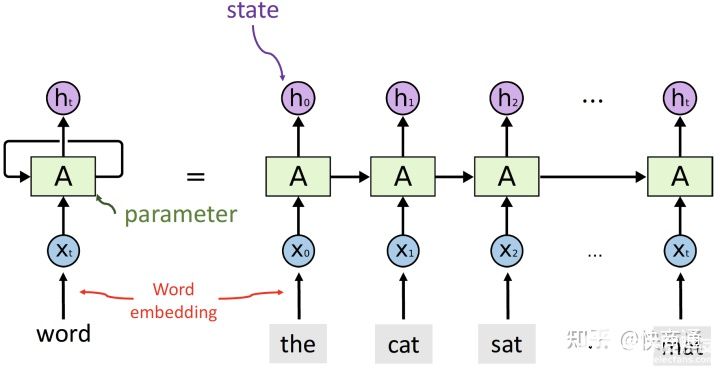

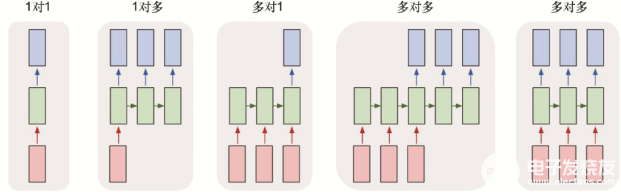

文本中的一個詞。RNN也是一種包含某特殊層的神經(jīng)網(wǎng)絡(luò),它并不是一次處理所有數(shù)據(jù)而是通過循環(huán)來處理數(shù)據(jù)。由于RNN可以按順序處理數(shù)據(jù),因此可以使用不同長度的向量并生成不同長度的輸出。圖6.3提供了一些

2022-07-20 09:27:59

將神經(jīng)網(wǎng)絡(luò)模型訓(xùn)練好之后,在輸入層給定一個x,通過網(wǎng)絡(luò)之后就能夠在輸出層得到特定的y,那么既然有了這么強大的模型,為什么還需要RNN(循環(huán)神經(jīng)網(wǎng)絡(luò))呢?

2018-05-05 10:51:00 5037

5037

,IndRNN和傳統(tǒng)RNN都忽略了偏差。假設(shè)一個有N個神經(jīng)元的雙層神經(jīng)網(wǎng)絡(luò),其中第二層的循環(huán)權(quán)重為零,那么就表示第二層只是一個完全連接層。

2018-03-16 16:05:07 9592

9592

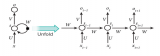

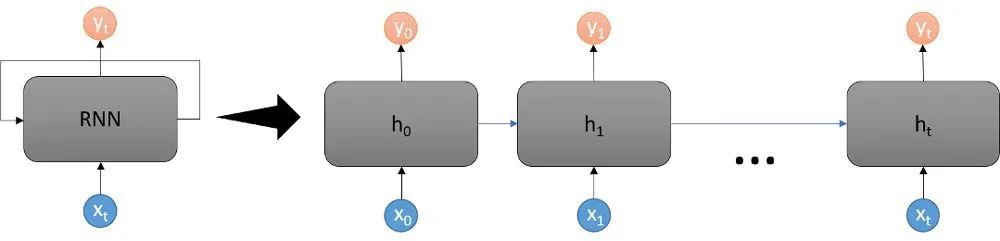

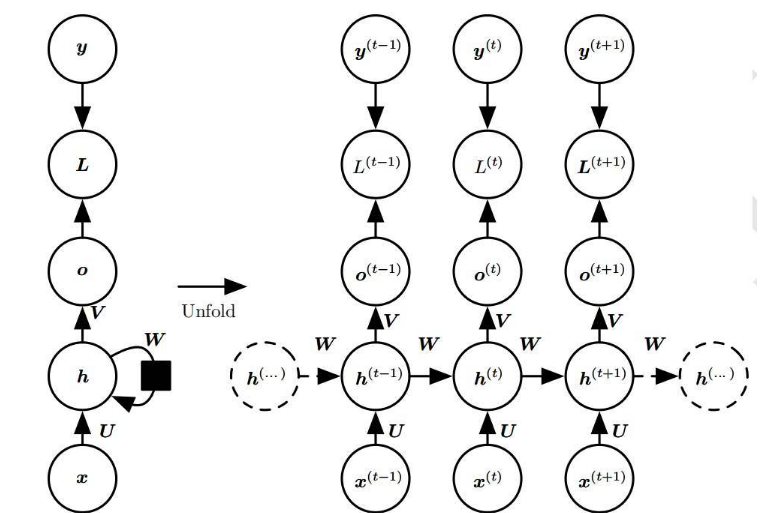

循環(huán)神經(jīng)網(wǎng)絡(luò)是處理序列數(shù)據(jù)相關(guān)任務(wù)最成功的多層神經(jīng)網(wǎng)絡(luò)模型(RNN)。 RNN,其結(jié)構(gòu)示意圖如下圖所示,它可以看作是神經(jīng)網(wǎng)絡(luò)的一種特殊類型,隱藏單元的輸入由當(dāng)前時間步所觀察到的數(shù)據(jù)中獲取輸入以及它在前一個時間步的狀態(tài)組合而成。

2018-05-07 10:25:43 9385

9385 在循環(huán)神經(jīng)網(wǎng)絡(luò)可以用于文本生成、機器翻譯還有看圖描述等,在這些場景中很多都出現(xiàn)了RNN的身影。

2018-05-11 14:58:41 13295

13295

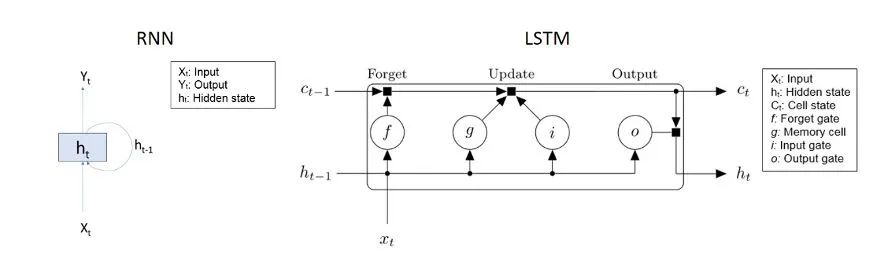

通過上一篇文章[人工智能之循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)] 介紹,我們知道,RNN是一類功能強大的人工神經(jīng)網(wǎng)絡(luò)算法,RNN一個重要的優(yōu)點在于,其能夠在輸入和輸出序列之間的映射過程中利用上下文相關(guān)信息。但是RNN存在著梯度消失或梯度爆炸等問題。因此,為了解決上述問題,長短時記憶神經(jīng)網(wǎng)絡(luò)(LSTM)誕生了。

2018-06-29 14:44:00 4211

4211 循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)現(xiàn)已成為國際上神經(jīng)網(wǎng)絡(luò)專家研究的重要對象之一。它是一種節(jié)點定向連接成環(huán)的人工神經(jīng)網(wǎng)絡(luò),最初由Jordan,Pineda.Williams,Elman等于上世紀(jì)80年代末提出的一種神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)模型。

2018-06-25 10:22:00 915

915 我們進行了一個交互式網(wǎng)絡(luò)實驗,讓你能與一個名為 sketch-rnn 的循環(huán)神經(jīng)網(wǎng)絡(luò)模型一起繪制作品。我們利用來自于 Quick Draw! 游戲的數(shù)百萬涂鴉訓(xùn)練該神經(jīng)網(wǎng)絡(luò)。一旦開始繪制對象,sketch-rnn 將提出許多可行的方法基于你中斷的位置繼續(xù)繪制此對象。試試第一個演示。

2018-07-25 10:24:18 3175

3175

卷積神經(jīng)網(wǎng)絡(luò)(CNN)最開始是用于計算機視覺中,然而現(xiàn)在也被廣泛用于自然語言處理中,而且有著不亞于RNN(循環(huán)神經(jīng)網(wǎng)絡(luò))的性能。

2018-08-04 11:26:25 2873

2873 循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)現(xiàn)已成為國際上神經(jīng)網(wǎng)絡(luò)專家研究的重要對象之一。它是一種節(jié)點定向連接成環(huán)的人工神經(jīng)網(wǎng)絡(luò),最初由Jordan,Pineda.Williams,Elman等于上世紀(jì)80年代末提出的一種神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)模型。

2018-09-05 10:00:00 3367

3367 的對比。 二、CNN與RNN對比 1、CNN卷積神經(jīng)網(wǎng)絡(luò)與RNN遞歸神經(jīng)網(wǎng)絡(luò)直觀圖 2、相同點: 2.1. 傳統(tǒng)神經(jīng)網(wǎng)絡(luò)的擴展。 2.2. 前向計算產(chǎn)生結(jié)果,反向計算模型更新。 2.3. 每層神經(jīng)網(wǎng)絡(luò)

2018-09-06 22:32:01 539

539 AI對話的未來已經(jīng)取得了第一個重大突破,這一切都要感謝語言建模的發(fā)電廠,循環(huán)神經(jīng)網(wǎng)絡(luò)。

2018-10-04 08:52:00 4519

4519 針對電力信息網(wǎng)絡(luò)中的高級持續(xù)性威脅問題,提出一種基于混合卷積神經(jīng)網(wǎng)絡(luò)( CNN)和循環(huán)神經(jīng)網(wǎng)絡(luò)( RNN)的入侵檢測模型。該模型根據(jù)網(wǎng)絡(luò)數(shù)據(jù)流量的統(tǒng)計特征對當(dāng)前網(wǎng)絡(luò)狀態(tài)進行分類。首先,獲取日志文件

2018-12-12 17:27:20 19

19 最近,有一篇入門文章引發(fā)了不少關(guān)注。文章中詳細(xì)介紹了循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN),及其變體長短期記憶(LSTM)背后的原理。

2019-02-05 13:43:00 673

673 很多“長相相似”的專有名詞,比如我們今天要說的“三胞胎”DNN(深度神經(jīng)網(wǎng)絡(luò))、CNN(卷積神經(jīng)網(wǎng)絡(luò))、RNN(遞歸神經(jīng)網(wǎng)絡(luò)),就讓許許多多的AI初學(xué)者們傻傻分不清楚。而今天,就讓我們一起擦亮眼睛,好好

2019-03-13 14:32:34 3081

3081 本文將討論:循環(huán)神經(jīng)網(wǎng)絡(luò)(Recurrent Neural Networks ,以下簡稱RNN),它廣泛的用于自然語言處理中的語音識別,手寫書別以及機器翻譯等領(lǐng)域。

2019-05-10 08:48:32 2890

2890

關(guān)于時間展開的循環(huán)神經(jīng)網(wǎng)絡(luò),在序列結(jié)束時具有單個輸出。

2019-07-05 14:44:50 927

927

長短期記憶網(wǎng)絡(luò)(LSTM),作為一種改進之后的循環(huán)神經(jīng)網(wǎng)絡(luò),不僅能夠解決 RNN無法處理長距離的依賴的問題,還能夠解決神經(jīng)網(wǎng)絡(luò)中常見的梯度爆炸或梯度消失等問題,在處理序列數(shù)據(jù)方面非常有效。 有效背后

2021-03-19 11:22:58 2468

2468

動態(tài)推薦系統(tǒng)通過學(xué)習(xí)動態(tài)變化的興趣特征來考慮推薦系統(tǒng)中的動態(tài)因素,實現(xiàn)推薦任務(wù)隨著時間變化而實時更新。該文提出一種攜帶歷史元素的循環(huán)神經(jīng)網(wǎng)絡(luò)( ecurrent Neural Net works

2021-03-31 09:31:51 5

5 動態(tài)推薦系統(tǒng)通過學(xué)習(xí)動態(tài)變化的興趣特征來考慮推薦系統(tǒng)中的動態(tài)因素,實現(xiàn)推薦任務(wù)隨著時間變化而實時更新。該文提出一種攜帶歷史元素的循環(huán)神經(jīng)網(wǎng)絡(luò)( Recurrent Neural Networks

2021-04-28 16:30:20 3

3 通過精確的電力負(fù)荷預(yù)測,智能電網(wǎng)可以提供比傳統(tǒng)電網(wǎng)更高效、可靠和環(huán)保的電力服務(wù)。現(xiàn)實生活中,電力負(fù)荷數(shù)據(jù)往往存在著與歷史數(shù)據(jù)較高的時間相關(guān)性,而傳統(tǒng)的神經(jīng)網(wǎng)絡(luò)卻很少關(guān)注它。近年來,循環(huán)神經(jīng)網(wǎng)絡(luò)

2021-05-07 11:25:30 18

18 神經(jīng)網(wǎng)絡(luò)是深度學(xué)習(xí)的載體,而神經(jīng)網(wǎng)絡(luò)模型中,最經(jīng)典非RNN模型所屬,盡管它不完美,但它具有學(xué)習(xí)歷史信息的能力。后面不管是encode-decode 框架,還是注意力模型,以及自注意力模型,以及更加

2021-05-10 10:22:45 11005

11005

上一章我們詳細(xì)介紹了小樣本做文本分類中的膠囊網(wǎng)絡(luò),那么這一章我們就來看看RNN(循環(huán)神經(jīng)網(wǎng)絡(luò))。大神們準(zhǔn)備好了嗎,我們要發(fā)車了~ 首先就是我們?yōu)槭裁葱枰?b class="flag-6" style="color: red">RNN? 舉個簡單的例子,最近娛樂圈頂流明

2021-09-27 18:03:01 1167

1167

傳統(tǒng)電影推薦算法多數(shù)基于用戶和電影的靜態(tài)屬性進行推薦,忽略了時間序列數(shù)據(jù)內(nèi)在的時間和因果因素,推薦質(zhì)量不高。為此,利用循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)在處理時間序列上的優(yōu)勢,提出一種推薦算法R-RNN。采用

2021-06-09 16:33:47 4

4 基于層級循環(huán)神經(jīng)網(wǎng)絡(luò)的X線線圖像腰椎識別

2021-06-27 11:24:46 23

23 基于循環(huán)神經(jīng)網(wǎng)絡(luò)的Modbus/TCP安全漏洞測試

2021-06-27 16:39:16 30

30 循環(huán)神經(jīng)網(wǎng)絡(luò)(Recurrent Neural Network,RNN)是一種用于處理序列數(shù)據(jù)的神經(jīng)網(wǎng)絡(luò)。相比一般的神經(jīng)網(wǎng)絡(luò)來說,他能夠處理序列變化的數(shù)據(jù)。比如某個單詞的意思會因為上文提到的內(nèi)容不同而有不同的含義,RNN就能夠很好地解決這類問題。

2022-03-15 10:44:42 1544

1544 當(dāng)數(shù)據(jù)點之間存在依賴關(guān)系時,例如時間序列數(shù)據(jù)和文本分析,數(shù)據(jù)科學(xué)家會使用RNN(循環(huán)神經(jīng)網(wǎng)絡(luò)) 。LSTM(長期短期記憶)通過一系列重復(fù)模塊創(chuàng)建一種形式的長期記憶,每個模塊都有提供類似記憶功能的門。

2022-04-25 17:34:37 1825

1825 遞歸神經(jīng)網(wǎng)絡(luò)(RNN) RNN是最強大的模型之一,它使我們能夠開發(fā)如分類、序列數(shù)據(jù)標(biāo)注、生成文本序列(例如預(yù)測下一輸入詞的SwiftKey keyboard應(yīng)用程序),以及將一個序列轉(zhuǎn)換為另一個序列

2022-07-20 10:17:04 618

618

神經(jīng)網(wǎng)絡(luò)一般可以分為以下常用的三大類:CNN(卷積神經(jīng)網(wǎng)絡(luò))、RNN(循環(huán)神經(jīng)網(wǎng)絡(luò))、Transformer(注意力機制)。

2022-12-12 14:48:43 4288

4288 在介紹卷積神經(jīng)網(wǎng)絡(luò)之前,我們先回顧一下神經(jīng)網(wǎng)絡(luò)的基本知識。就目前而言,神經(jīng)網(wǎng)絡(luò)是深度學(xué)習(xí)算法的核心,我們所熟知的很多深度學(xué)習(xí)算法的背后其實都是神經(jīng)網(wǎng)絡(luò)。

2023-02-23 09:14:44 2256

2256 在本文中,我們將了解深度神經(jīng)網(wǎng)絡(luò)的基礎(chǔ)知識和三個最流行神經(jīng)網(wǎng)絡(luò):多層神經(jīng)網(wǎng)絡(luò)(MLP),卷積神經(jīng)網(wǎng)絡(luò)(CNN)和遞歸神經(jīng)網(wǎng)絡(luò)(RNN)。

2023-05-15 14:19:18 1096

1096

電子發(fā)燒友網(wǎng)站提供《PyTorch教程之循環(huán)神經(jīng)網(wǎng)絡(luò).pdf》資料免費下載

2023-06-05 09:52:33 0

0 2014-2017年,神經(jīng)網(wǎng)絡(luò)得到一系列的發(fā)展,包括CNN卷積神經(jīng)網(wǎng)絡(luò)RNN、循環(huán)神經(jīng)網(wǎng)絡(luò)、VAE、GAN生成對抗網(wǎng)絡(luò)等,AI在很多領(lǐng)域有了落地的應(yīng)用。

2023-08-16 10:21:00 463

463

本文來源:MomodelAI循環(huán)神經(jīng)網(wǎng)絡(luò)是一類人工神經(jīng)網(wǎng)絡(luò),其中節(jié)點之間的連接可以創(chuàng)建一個循環(huán),允許某些節(jié)點的輸出影響對相同節(jié)點的后續(xù)輸入。涉及序列的任務(wù),如自然語言處理、語音識別和時間序列分析

2023-12-15 08:28:11 217

217

電子發(fā)燒友App

電子發(fā)燒友App

評論