資料介紹

描述

Xilinx 提供了 Vitis? Video Analytics SDK,我們可以使用它來運行我們自己的對象檢測。我們將展示如何使用 yolov4-tiny 訓練您的自定義數據集并在 KV260 上運行它。

確保您已準備好以下工作:

- 安裝智能相機應用:https ://xilinx.github.io/kria-apps-docs/main/build/html/docs/smartcamera/docs/app_deployment.html

- 安裝 Vitis AI:https ://github.com/Xilinx/Vitis-AI (1.4 版)

1.在yolov4-tiny上訓練一個自定義數據集

一個。git clone https://github.com/XiongDa0001/yolov4-tiny-keras

灣。制作 VOC 格式的數據集

C。運行 voc_annotation.py 得到 2007_train.txt 和 2007_val.txt 進行訓練

d。修改 classes_path 中的內容以包含您檢測到的內容

e. 安裝 tensorflow-gpu==1.13.1 和 Cuda 10.0 或 10.1

更多訓練過程請參考https://github.com/bubbliiiing/yolov4-tiny-keras

2.將h5轉換為pb

我們的代碼提供了一個轉換腳本keras2pb.py 。

您應該按如下方式修改變量:

一個。指定input_model

乙。指定output_model

C。指定num_class

然后你會得到 freeze pb 文件。

3.模型量化

該項目使用Vitis-AI 1.4 。首先進入docker環境,然后

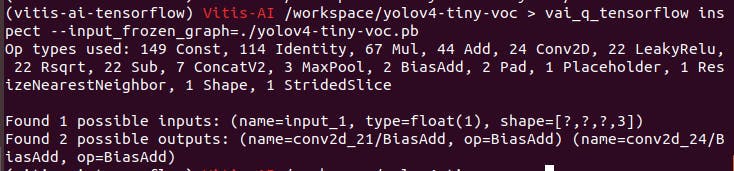

在量化之前,可以使用如下命令查看mode的輸入輸出節點

vai_q_tensorflow inspect --input_frozen_graph=~.pb

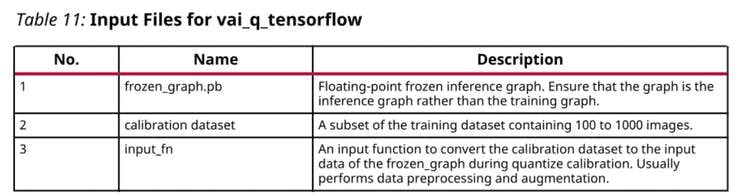

量化需要準備如下:

input_fn.py如下:

from PIL import Image

import numpy as np

def letterbox_image(image, size):

'''resize image with unchanged aspect ratio using padding'''

iw, ih = image.size

w, h = size

scale = min(w/iw, h/ih)

nw = int(iw*scale)

nh = int(ih*scale)

image = image.resize((nw,nh), Image.BICUBIC)

new_image = Image.new('RGB', size, (128,128,128))

new_image.paste(image, ((w-nw)//2, (h-nh)//2))

return new_image

#image = Image.open(img_path)

def preprocessing_fn(image, model_image_size=(416,416)):

if model_image_size != (None, None):

assert model_image_size[0]%32 == 0, 'Multiples of 32 required'

assert model_image_size[1]%32 == 0, 'Multiples of 32 required'

boxed_image = letterbox_image(image, tuple(reversed(model_image_size)))

else:

new_image_size = (image.width - (image.width % 32), image.height - (image.height % 32))

boxed_image = letterbox_image(image, new_image_size)

image_data = np.array(boxed_image, dtype='float32')

image_data /= 255.

return image_data

calib_image_dir = "calibrate_images"

calib_image_list = "calibrate.txt"

calib_batch_size = 8

def calib_input(iter):

images = []

line = open(calib_image_list).readlines()

for index in range(0, calib_batch_size):

curline = line[iter * calib_batch_size + index]

image_name = curline.strip()

image = Image.open(image_name)

image = preprocessing_fn(image)

images.append(image)

return {"input_1": images}

我們提供get_name.py來獲取每個圖像的名稱。

#!/usr/bin/python

#coding:utf-8

import os

num=0

path_imgs = './calibrate_images'

for files in os.listdir(path_imgs):

print(files)

img_path = path_imgs + '/' + files

num = num + 1

with open("./calibrate_images/calibrate.txt", "a") as f:

f.write(str(img_path) + '\n')

創建一個“量化”文件夾來保存量化文件

* 下一步是量化模型。

vai_q_tensorflow quantize \

--input_frozen_graph ./yolov4-tiny-voc.pb \

--input_nodes input_1 \

--input_shapes ?,416,416,3 \

--output_dir ./quantize \

--output_nodes conv2d_21/BiasAdd,conv2d_24/BiasAdd \

--input_fn input_fn.calib_input \

--calib_iter 25

calibrate_images 數量 = calib_iter * calib_batch_size

然后你會在quantized文件夾下得到quantize_eval_model.pb

4. 編譯模型

VAI_C 的常用選項如下所示。

--arch:JSON 格式的 VAI_C 編譯器的 DPU 架構配置文件。它包含編譯期間云和邊緣 DPU 的專用選項。

您需要創建 arch.json 文件,如下所示:

{

"target": "DPUCZDX8G_ISA0_B3136_MAX_BG2"

}

- --frozen_pb:量化文件(quantize_eval_model.pb )

- --output-dir:存放編譯輸出的文件夾

- --net_name:VAI_C編譯后網絡模型的DPU內核名稱

有時,T ensorFlow 模型不包含輸入張量形狀信息,導致編譯失敗。您可以使用

--options '{"input_shape":"1, 224, 224, 3"}'指定輸入張量形狀。

創建一個“編譯”文件夾來保存量化文件

使用以下命令獲取xmodel文件

vai_c_tensorflow \

--f ./quantize14/quantize_eval_model.pb \

--a kv260arch_B3136.json \

--output_dir compile \

--n mask_detection \

--options '{"input_shape": "1,224,224,3"}'

5. 數據準備

我們需要準備以下文件,這些文件位于我的 github https://github.com/XiongDa0001/yolov4-tiny-keras

├─face_mask

|_____aiinference.json

|_____drawresult.json

|_____preprocess.json

└─mask-detection-yolo4-tiny

|_____mask-detection-yolo4-tiny.prototxt

|_____mask-detection-yolo4-tiny.xmodel

|_____label.json

將“face_mask”文件夾放在 /opt/xilinx/share/ivas/smartcam 文件夾中

同時,將“mask-detection-yolo4-tiny”放入/opt/xilinx/share/ivas/vitis_??ai_library/models/kv260-smartcam文件夾中

6.運行模型

sudo xmutil unloadapp

sudo xmutil loadapp kv260-smartcam

sudo smartcam --mipi -W 1920 -H 1080 --target dp -a face_mask

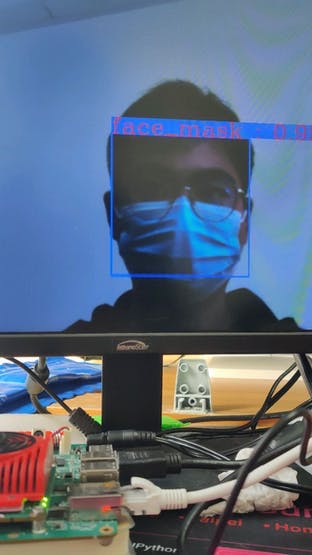

這是一個運行示例的演示

?

- Kria KV260視覺AI入門套件用戶指南

- 適用于AWS IoT Greengrass的Xilinx KV260入門指南

- 基于DeepSORT YOLOv4的目標跟蹤

- 創建自定義Kria KV260加速ML應用程序

- 使用KV260進行事故檢測

- 使用Xilinx KV260對智能家居設備進行手勢控制

- Vitis ai 1.4 KV260鏡像開源

- 為Kria KV260添加USB WiFi

- Nvidia Jetson Nano面罩Yolov4探測器

- Kria KV260 AI視覺套件入門

- Xilinx Kria KV260套件的第一個硬件項目

- Vivado 2021.1中的Kria KV260入門

- 使用Xilinx Kria KV260進行AI火災探測

- Kria KV260上的動態交通燈系統

- 基于Tengine實現yolov4的cpu推理

- AMD Kria KR260 DPU配置教程3 1098次閱讀

- 深入淺出Yolov3和Yolov4 581次閱讀

- 如何在KV260上快速體驗Vitsi AI圖像分類示例程序 1289次閱讀

- 在AI愛克斯開發板上用OpenVINO?加速YOLOv8-seg實例分割模型 764次閱讀

- 在AI愛克斯開發板上用OpenVINO?加速YOLOv8-seg實例分割模型 849次閱讀

- AI愛克斯開發板上使用OpenVINO加速YOLOv8目標檢測模型 1067次閱讀

- 在AI愛克斯開發板上用OpenVINO?加速YOLOv8目標檢測模型 1134次閱讀

- 使用旭日X3派的BPU部署Yolov5 734次閱讀

- 英偉達Jetson設備上的YOLOv8性能基準測試 5550次閱讀

- 復雜野外環境下油茶果快速魯棒檢測算法 875次閱讀

- YOLOv5在OpenCV上的推理程序 1681次閱讀

- 深度解析YOLOv7的網絡結構 7281次閱讀

- 關于YOLOU中模型的測試 741次閱讀

- 在u-boot中使用ethernet的方法 3671次閱讀

- 如何在LiDAR點云上進行3D對象檢測 2032次閱讀

下載排行

本周

- 1山景DSP芯片AP8248A2數據手冊

- 1.06 MB | 532次下載 | 免費

- 2RK3399完整板原理圖(支持平板,盒子VR)

- 3.28 MB | 339次下載 | 免費

- 3TC358743XBG評估板參考手冊

- 1.36 MB | 330次下載 | 免費

- 4DFM軟件使用教程

- 0.84 MB | 295次下載 | 免費

- 5元宇宙深度解析—未來的未來-風口還是泡沫

- 6.40 MB | 227次下載 | 免費

- 6迪文DGUS開發指南

- 31.67 MB | 194次下載 | 免費

- 7元宇宙底層硬件系列報告

- 13.42 MB | 182次下載 | 免費

- 8FP5207XR-G1中文應用手冊

- 1.09 MB | 178次下載 | 免費

本月

- 1OrCAD10.5下載OrCAD10.5中文版軟件

- 0.00 MB | 234315次下載 | 免費

- 2555集成電路應用800例(新編版)

- 0.00 MB | 33566次下載 | 免費

- 3接口電路圖大全

- 未知 | 30323次下載 | 免費

- 4開關電源設計實例指南

- 未知 | 21549次下載 | 免費

- 5電氣工程師手冊免費下載(新編第二版pdf電子書)

- 0.00 MB | 15349次下載 | 免費

- 6數字電路基礎pdf(下載)

- 未知 | 13750次下載 | 免費

- 7電子制作實例集錦 下載

- 未知 | 8113次下載 | 免費

- 8《LED驅動電路設計》 溫德爾著

- 0.00 MB | 6656次下載 | 免費

總榜

- 1matlab軟件下載入口

- 未知 | 935054次下載 | 免費

- 2protel99se軟件下載(可英文版轉中文版)

- 78.1 MB | 537798次下載 | 免費

- 3MATLAB 7.1 下載 (含軟件介紹)

- 未知 | 420027次下載 | 免費

- 4OrCAD10.5下載OrCAD10.5中文版軟件

- 0.00 MB | 234315次下載 | 免費

- 5Altium DXP2002下載入口

- 未知 | 233046次下載 | 免費

- 6電路仿真軟件multisim 10.0免費下載

- 340992 | 191187次下載 | 免費

- 7十天學會AVR單片機與C語言視頻教程 下載

- 158M | 183279次下載 | 免費

- 8proe5.0野火版下載(中文版免費下載)

- 未知 | 138040次下載 | 免費

電子發燒友App

電子發燒友App

創作

創作 發文章

發文章 發帖

發帖  提問

提問  發資料

發資料 發視頻

發視頻 上傳資料賺積分

上傳資料賺積分

評論