完善資料讓更多小伙伴認(rèn)識你,還能領(lǐng)取20積分哦,立即完善>

標(biāo)簽 > 語言模型

文章:509個 瀏覽:10277次 帖子:3個

Falcon-7B大型語言模型在心理健康對話數(shù)據(jù)集上使用QLoRA進(jìn)行微調(diào)

使用領(lǐng)域適應(yīng)技術(shù)對預(yù)訓(xùn)練LLM進(jìn)行微調(diào)可以提高在特定領(lǐng)域任務(wù)上的性能。但是,進(jìn)行完全微調(diào)可能會很昂貴,并且可能會導(dǎo)致CUDA內(nèi)存不足錯誤。當(dāng)進(jìn)行完全微調(diào)...

2023-09-19 標(biāo)簽:模型語言模型數(shù)據(jù)集 589 0

從原理到代碼理解語言模型訓(xùn)練和推理,通俗易懂,快速修煉LLM

要理解大語言模型(LLM),首先要理解它的本質(zhì),無論預(yù)訓(xùn)練、微調(diào)還是在推理階段,核心都是next token prediction,也就是以自回歸的方式...

開源大模型FLM-101B:訓(xùn)練成本最低的超100B參數(shù)大模型

近期,一支來自中國的研究團(tuán)隊正是針對這些問題提出了解決方案,他們推出了FLM-101B模型及其配套的訓(xùn)練策略。FLM-101B不僅大幅降低了訓(xùn)練成本,而...

AI Agents的框架構(gòu)成以及LLMs的基礎(chǔ)知識

智能代理(AI Agents)長期以來都被視為通往人工通用智能(AGI)的一條希望途徑,預(yù)期中其能夠通過自主規(guī)劃和指令來自動完成相關(guān)任務(wù)。然而,早期的代...

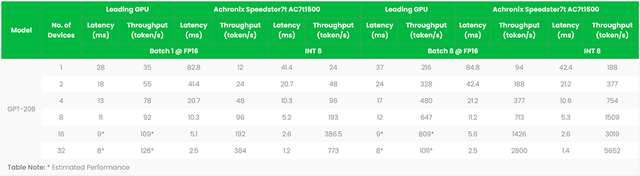

FPGA加速器支撐ChatGPT類大語言模型創(chuàng)新

作者:Bill Jenkins,Achronix人工智能/機(jī)器學(xué)習(xí)產(chǎn)品營銷總監(jiān) 探索FPGA加速語言模型如何通過更快的推理、更低的延遲和更好的語言理解來...

中科大&字節(jié)提出UniDoc:統(tǒng)一的面向文字場景的多模態(tài)大模型

如上圖所示,UniDoc基于預(yù)訓(xùn)練的視覺大模型及大語言模型,將文字的檢測、識別、spotting(圖中未畫出)、多模態(tài)理解等四個任務(wù),通過多模態(tài)指令微調(diào)...

2023-08-31 標(biāo)簽:語言模型數(shù)據(jù)集大模型 1566 0

通過循環(huán)訓(xùn)練實現(xiàn)忠實的低資源數(shù)據(jù)文本生成

從結(jié)構(gòu)化數(shù)據(jù)中自然語言生成(NLG)往往會產(chǎn)生多種錯誤,從而限制了這些模型在面向客戶的應(yīng)用中的實用性。當(dāng)NLG 模型在生成的輸出文本時注入與輸入結(jié)構(gòu)化數(shù)...

2023-08-24 標(biāo)簽:數(shù)據(jù)庫模型語言模型 482 0

這對知識表示領(lǐng)域來說是一個巨大的步驟。長時間以來,人們關(guān)注的是明確的知識,例如嵌入在文本中的知識,有時也被稱為非結(jié)構(gòu)化數(shù)據(jù),以及以結(jié)構(gòu)化形式存在的知識,...

AGI離我們還有多遠(yuǎn)?大模型不是最終解,世界模型才是未來

大型語言模型(如 GPT-4)在解決特定任務(wù)和提取因果關(guān)系方面表現(xiàn)出色,但缺乏抽象的因果推理能力。它們傾向于從數(shù)據(jù)中提取已知的因果模式,而無法生成新的因果見解。

中科大提出:LLMs的個性化綜述,詳述大模型與個性化的挑戰(zhàn)與機(jī)遇

因此,我們認(rèn)為現(xiàn)在是時候?qū)徱晜€性化服務(wù)的挑戰(zhàn)以及用大型語言模型來解決它們的機(jī)會了。特別是,我們在這篇展望性論文中專門討論了以下幾個方面:現(xiàn)有個性化系統(tǒng)的...

考慮到強(qiáng)化學(xué)習(xí)[10]訓(xùn)練大語言模型的困難性,我們從語言建模的角度對大語言模型進(jìn)行解毒。已有工作將解毒視為單一的任務(wù),可以實現(xiàn)從有毒內(nèi)容到無毒內(nèi)容的直接...

2023-08-21 標(biāo)簽:API語言模型強(qiáng)化學(xué)習(xí) 524 0

? 本篇內(nèi)容是對于ACL‘23會議上陳丹琦團(tuán)隊帶來的Tutorial所進(jìn)行的學(xué)習(xí)記錄,以此從問題設(shè)置、架構(gòu)、應(yīng)用、挑戰(zhàn)等角度全面了解檢索增強(qiáng)的語言模型,...

嘉楠開源通用大語言模型Toucan中的INT4量化技術(shù)解析

ChatGPT與其之后不斷涌現(xiàn)的大語言模型(LLM)迅速席卷了整個時代。隨著計算機(jī)對人類自然語言的領(lǐng)悟程度突飛猛進(jìn),我們與計算機(jī)的交互方式正在迅速而深刻...

當(dāng)然,有些商業(yè)生成式AI SaaS產(chǎn)品承諾不使用提交的數(shù)據(jù)來改進(jìn)其公共模型。但是,并非所有公司都愿意將私人數(shù)據(jù)發(fā)送到他們幾乎無法控制的cloud 服務(wù)中...

大型語言模型在關(guān)鍵任務(wù)和實際應(yīng)用中的挑戰(zhàn)

大型語言模型的出現(xiàn)極大地推動了自然語言處理領(lǐng)域的進(jìn)步,但同時也存在一些局限性,比如模型可能會產(chǎn)生看似合理但實際上是錯誤或虛假的內(nèi)容,這一現(xiàn)象被稱為幻覺(...

2023-08-15 標(biāo)簽:解碼器數(shù)據(jù)語言模型 1524 0

Llama 2是 Meta 發(fā)布了其最新的大型語言模型,Llama2 是基于 Transformer 的人工神經(jīng)網(wǎng)絡(luò),以一系列單詞作為輸入,遞歸地預(yù)測下...

2023-08-06 標(biāo)簽:英特爾神經(jīng)網(wǎng)絡(luò)AI 786 0

ToolLLM:促進(jìn)大型語言模型掌握16000+真實世界的APIs

盡管開源大語言模型 (LLM) 及其變體(例如 LLaMA 和 Vicuna)取得了進(jìn)步,但它們在執(zhí)行更高級別的任務(wù)方面仍然受到很大限制,例如遵循人類指...

2023-08-02 標(biāo)簽:數(shù)據(jù)開源語言模型 738 0

爆火Llama 2一周請求下載超15萬,有人開源了Rust實現(xiàn)版本

隨著 Llama 2 的逐漸走紅,大家對它的二次開發(fā)開始流行起來。前幾天,OpenAI 科學(xué)家 Karpathy 利用周末時間開發(fā)了一個明星項目 lla...

華南理工賈奎團(tuán)隊ICCV'23新作:支持重新照明、編輯和物理仿真

現(xiàn)有的文本到三維模型的生成方法通常使用NeRF等隱式表達(dá),通過體積渲染將幾何和外觀耦合在一起,但在恢復(fù)更精細(xì)的幾何結(jié)構(gòu)和實現(xiàn)逼真渲染方面存在不足,所以在...

換一批

換一批

編輯推薦廠商產(chǎn)品技術(shù)軟件/工具OS/語言教程專題

| 電機(jī)控制 | DSP | 氮化鎵 | 功率放大器 | ChatGPT | 自動駕駛 | TI | 瑞薩電子 |

| BLDC | PLC | 碳化硅 | 二極管 | OpenAI | 元宇宙 | 安森美 | ADI |

| 無刷電機(jī) | FOC | IGBT | 逆變器 | 文心一言 | 5G | 英飛凌 | 羅姆 |

| 直流電機(jī) | PID | MOSFET | 傳感器 | 人工智能 | 物聯(lián)網(wǎng) | NXP | 賽靈思 |

| 步進(jìn)電機(jī) | SPWM | 充電樁 | IPM | 機(jī)器視覺 | 無人機(jī) | 三菱電機(jī) | ST |

| 伺服電機(jī) | SVPWM | 光伏發(fā)電 | UPS | AR | 智能電網(wǎng) | 國民技術(shù) | Microchip |

| Arduino | BeagleBone | 樹莓派 | STM32 | MSP430 | EFM32 | ARM mbed | EDA |

| 示波器 | LPC | imx8 | PSoC | Altium Designer | Allegro | Mentor | Pads |

| OrCAD | Cadence | AutoCAD | 華秋DFM | Keil | MATLAB | MPLAB | Quartus |

| C++ | Java | Python | JavaScript | node.js | RISC-V | verilog | Tensorflow |

| Android | iOS | linux | RTOS | FreeRTOS | LiteOS | RT-THread | uCOS |

| DuerOS | Brillo | Windows11 | HarmonyOS |